Clear Sky Science · pt

Uma estrutura híbrida baseada em convolução e atenção com explicação visual para identificação de doenças em frutas

Por que verificações mais inteligentes de frutas importam

De bananas no café da manhã a morangos em smoothies, a fruta é um alimento diário — e uma fonte importante de renda para agricultores no mundo todo. Mas manchas ocultas, podridão e infecções fúngicas podem dizimar colheitas, reduzir a vida útil e aumentar preços. Este estudo investiga como um sistema de inteligência artificial avançado, porém leve, pode detectar automaticamente doenças em frutas comuns a partir de fotos simples, ao mesmo tempo em que mostra às pessoas exatamente o que ele “observou” para tomar cada decisão.

O problema das frutas doentes

Culturas frutíferas como banana, uva, limão, manga e morango são vulneráveis a uma ampla variedade de doenças causadas por fungos, bactérias, vírus e problemas nutricionais. Essas questões frequentemente aparecem como pequenas manchas nas folhas, áreas descoloridas ou regiões de podridão na superfície do fruto. Quando detectadas tardiamente, as infecções se espalham rapidamente pelos pomares, reduzindo a produtividade e obrigando os agricultores a gastar mais com produtos químicos e inspeções manuais. O diagnóstico tradicional depende de especialistas que percorrem os campos e examinam visualmente as plantas — um processo lento, subjetivo e difícil de escalar em fazendas grandes. Sintomas iniciais ou sutis são facilmente perdidos, especialmente sob luz variável, fundos confusos ou quando frutas de variedades diferentes têm aparência semelhante.

Ensinando computadores a ver defeitos em frutas

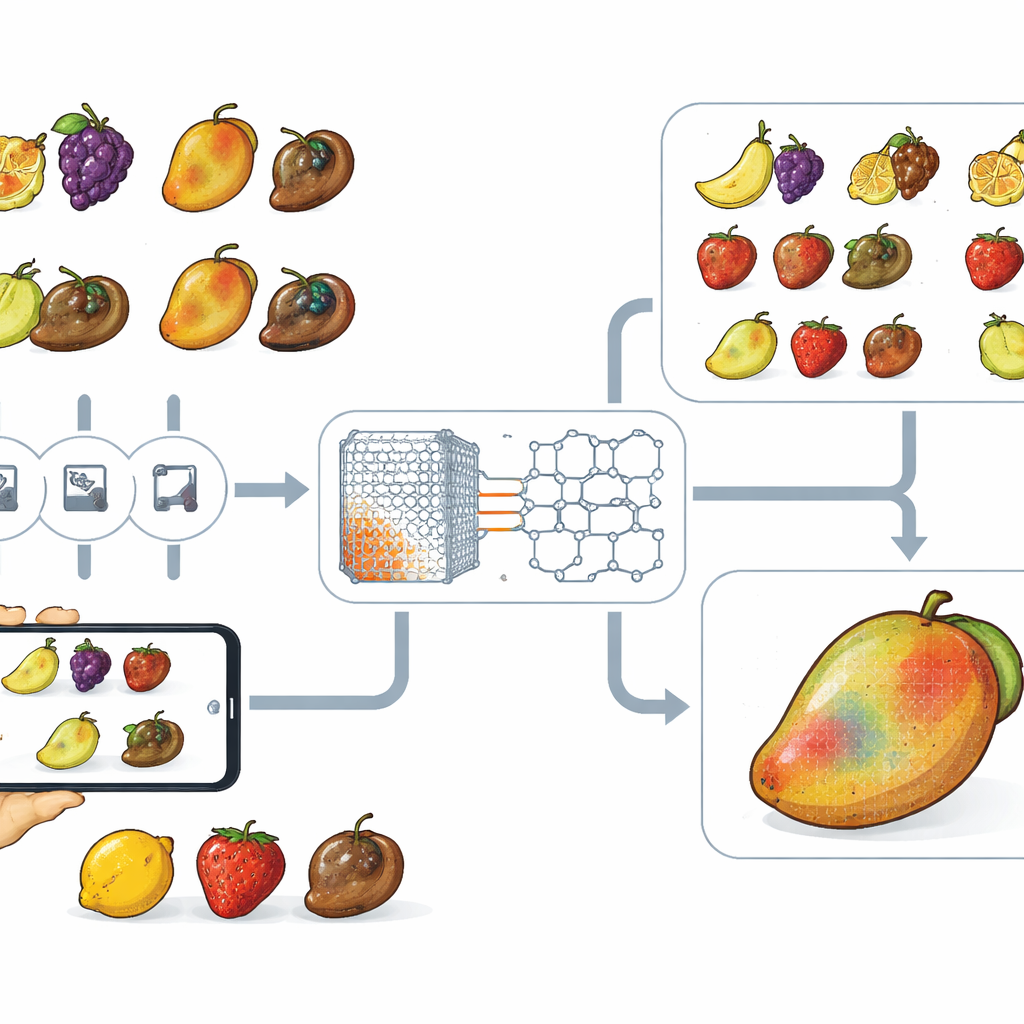

Os pesquisadores recorreram ao aprendizado profundo, uma forma de inteligência artificial que aprende padrões diretamente a partir de imagens. Eles usaram um conjunto de dados público com 22.457 fotos mostrando cinco tipos de frutas, cada uma rotulada como saudável ou podre. As imagens foram cuidadosamente redimensionadas, corrigidas em cor e aumentadas com rotações, espelhamentos e ruído para imitar variação do mundo real e evitar sobreajuste a condições restritas. Quatro modelos fortes existentes foram testados como referência: dois baseados em redes neurais convolucionais (que se destacam em captar texturas e contornos locais) e dois baseados em arquiteturas transformer (que capturam bem relações de longo alcance na imagem). Cada modelo foi re-treinado no conjunto de frutas e avaliado quanto à acurácia, robustez em validação cruzada e custo computacional.

Um modelo híbrido que enxerga detalhes e panorama

Partindo das forças e fraquezas dessas linhas de base, os autores projetaram um novo modelo híbrido chamado CoAT‑AgriLite. Ele combina um “tronco” convolucional que foca em detalhes espaciais finos — como pequenas lesões ou rugosidade da superfície — com blocos baseados em atenção emprestados de redes transformer que capturam como diferentes regiões da fruta se relacionam entre si ao longo da imagem. Em vez de simplesmente empilhar uma rede convolucional e uma transformer, o CoAT‑AgriLite funde suas características no meio do fluxo, permitindo que informação local e global interajam diretamente. O projeto é propositalmente leve: usa menos parâmetros e menos operações de ponto flutuante do que modelos transformer típicos, tornando‑o adequado para uso em tempo real em hardware modesto como celulares, drones ou dispositivos de borda em casas de embalagem.

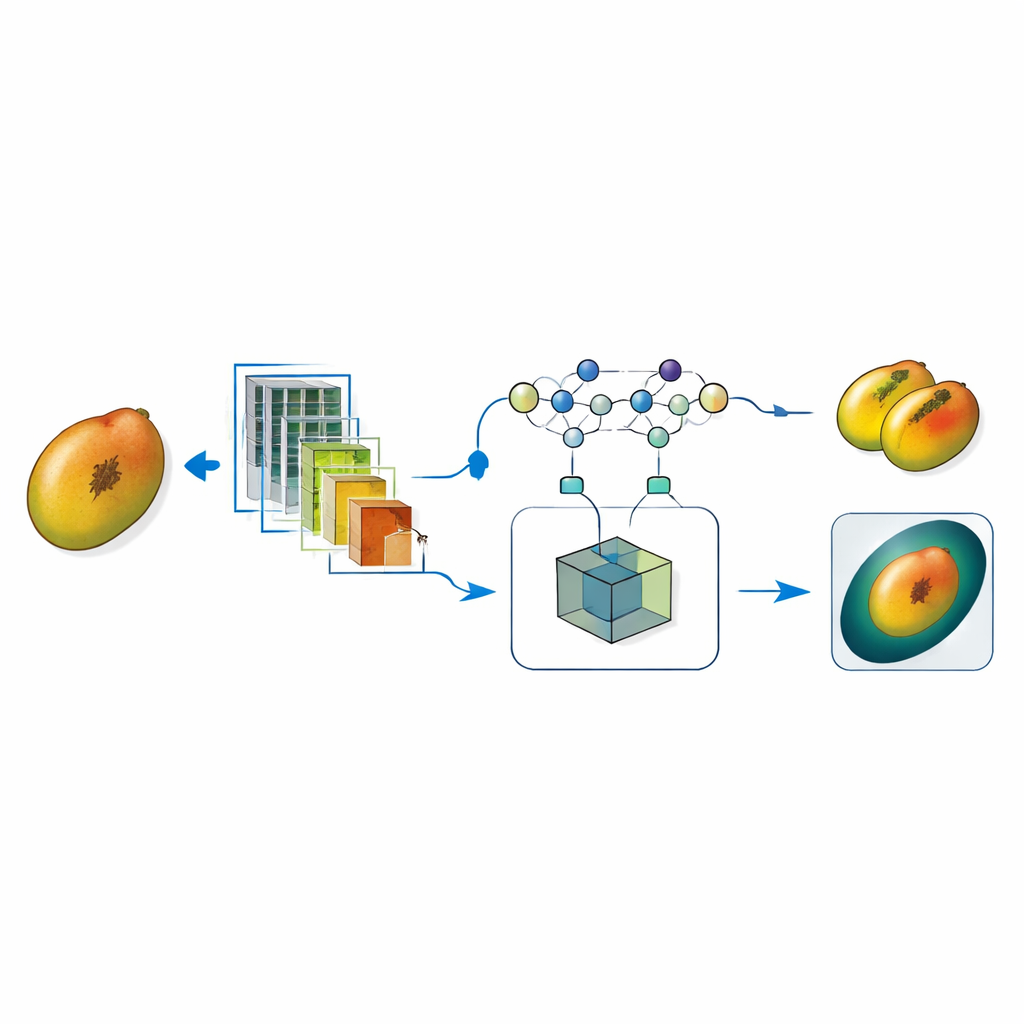

Ver como a IA toma suas decisões

Acurácia por si só não basta na agricultura, onde um diagnóstico incorreto pode significar frutas perdidas ou espalhamento não controlado de doenças. Para gerar confiança, a equipe integrou uma ferramenta de explicabilidade conhecida como Grad‑CAM. Para cada previsão, o Grad‑CAM produz um mapa de calor destacando áreas da imagem que mais contribuíram para a decisão do modelo. Em frutas saudáveis, a atenção se distribui de forma mais uniforme ou permanece baixa, enquanto em frutas doentes ela se concentra em manchas escuras, áreas descoloridas ou regiões amolecidas. Experimentos mostraram que mais de 90% da energia de ativação do modelo incidia sobre áreas de lesão reais em vez de ruído de fundo, e até mesmo os poucos erros tendiam a ocorrer em imagens com danos extremamente sutis ou parcialmente ocultos, e não por ruído aleatório.

Desempenho e por que isso importa

Em testes extensivos, o CoAT‑AgriLite superou claramente os quatro modelos de referência e uma série de sistemas previamente publicados. Em imagens de teste não vistas, alcançou 99,37% de acurácia global, com precisão, recall e F1 igualmente altos para cada tipo de fruta, indicando que raramente deixou de identificar amostras doentes e dificilmente gerou falsos positivos. Também igualou ou superou modelos mais complexos e pesados exigindo menos poder de computação, confirmando que um design híbrido cuidadoso pode ser ao mesmo tempo potente e eficiente. Para não especialistas, a mensagem principal é que uma IA compacta e explicável agora pode olhar fotos comuns de frutas e identificar doenças de forma confiável, justificando visualmente suas escolhas. Esses sistemas podem apoiar agricultores, agrônomos e gestores da cadeia de suprimentos no monitoramento da saúde das culturas, automação de linhas de triagem e redução de desperdício — ajudando a levar frutas mais saudáveis do pomar à mesa com mais transparência e menor custo.

Citação: Kothandaraman, R., Srinivasan, S., Mathivanan, S. et al. A hybrid convolution and attention-based framework with visual explanation for fruit disease identification. Sci Rep 16, 12771 (2026). https://doi.org/10.1038/s41598-026-42135-5

Palavras-chave: detecção de doenças em frutas, IA explicável, aprendizado profundo, visão computacional, agricultura de precisão