Clear Sky Science · de

Ein hybrides konvolutions- und aufmerksamkeitbasiertes Framework mit visueller Erklärung zur Identifizierung von Obstkrankheiten

Warum intelligentere Obstkontrollen wichtig sind

Von Frühstücksbananen bis zu Erdbeeren im Smoothie ist Obst ein tägliches Grundnahrungsmittel – und eine wichtige Einkommensquelle für Landwirtinnen und Landwirte weltweit. Verborgene Flecken, Fäulnis und Pilzinfektionen können jedoch Ernten unbemerkt vernichten, die Haltbarkeit verkürzen und die Preise in die Höhe treiben. Diese Studie untersucht, wie ein fortschrittliches, dabei leichtgewichtiges System der künstlichen Intelligenz Krankheiten an gängigen Früchten aus einfachen Fotos automatisch erkennen kann und zugleich Menschen genau zeigt, worauf es bei jeder Entscheidung „geschaut“ hat.

Das Problem kranker Früchte

Obstern wie Bananen, Trauben, Zitronen, Mangos und Erdbeeren sind anfällig für eine Vielzahl von Krankheiten, die durch Pilze, Bakterien, Viren oder Nährstoffmängel verursacht werden. Diese Probleme zeigen sich oft als kleine Blattflecken, verfärbte Stellen oder faule Stellen an der Fruchtoberfläche. Wird ein Befall zu spät erkannt, breiten sich Infektionen schnell über Plantagen aus, reduzieren den Ertrag und zwingen Landwirtinnen und Landwirte zu höheren Ausgaben für Chemikalien und arbeitsintensive Kontrollen. Die traditionelle Diagnose beruht auf geschulten Expertinnen und Experten, die die Felder begehen und Pflanzen visuell untersuchen – ein langsamer, subjektiver Prozess, der sich schwer auf große Flächen skalieren lässt. Frühe oder subtile Symptome werden leicht übersehen, insbesondere bei wechselnden Lichtverhältnissen, unruhigem Hintergrund oder wenn sich Früchte zwischen Sorten ähnlich sehen.

Computern beibringen, Fehler an Früchten zu erkennen

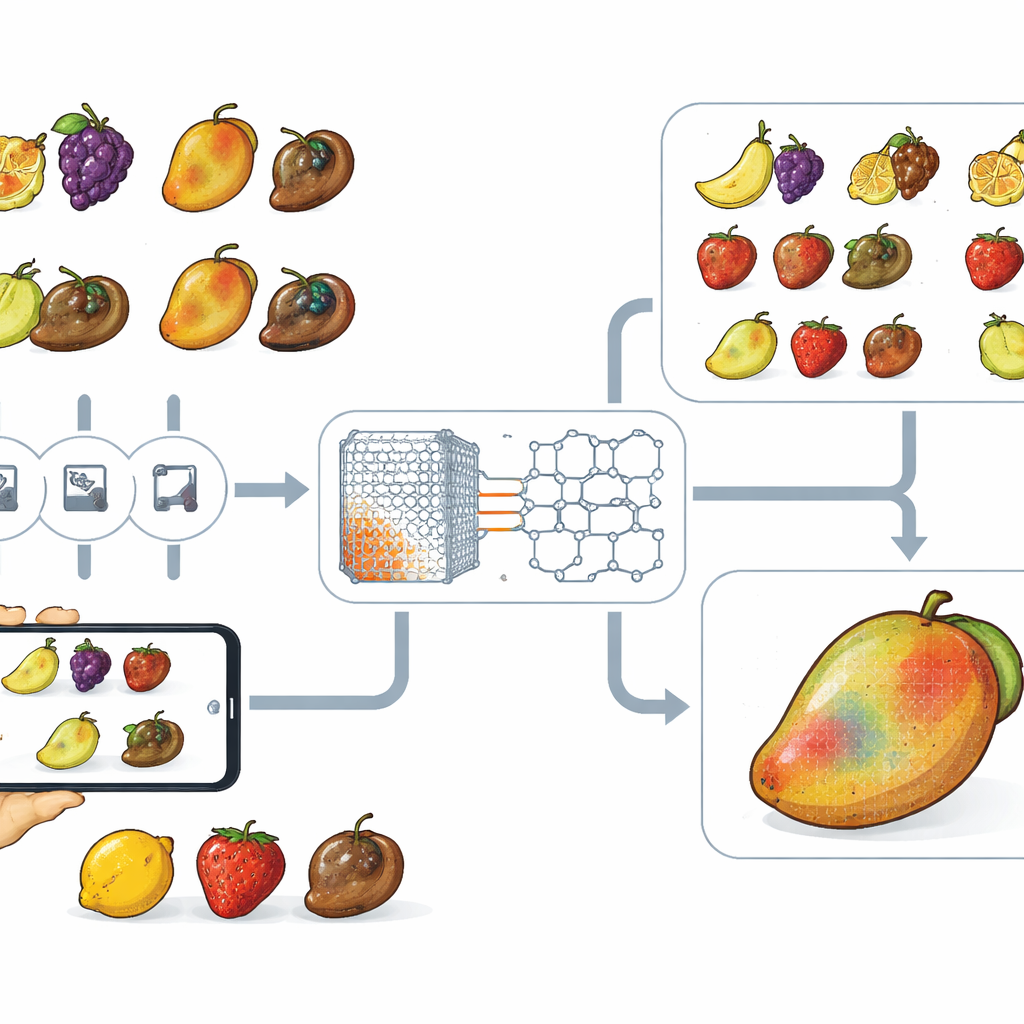

Die Forschenden griffen auf Deep Learning zurück, eine Form der künstlichen Intelligenz, die Muster direkt aus Bildern lernt. Sie nutzten einen öffentlichen Datensatz mit 22.457 Fotos von fünf Fruchttypen, die jeweils als gesund oder faul gekennzeichnet waren. Die Bilder wurden sorgfältig skaliert, farbkorrigiert und mit Rotationen, Spiegelungen und Rauschen augmentiert, um realweltliche Variationen zu simulieren und ein Überanpassen an enge Bedingungen zu vermeiden. Vier leistungsfähige bestehende Modelle dienten als Benchmarks: zwei basierend auf konvolutionalen neuronalen Netzen (die lokale Texturen und Kanten gut erfassen) und zwei auf Transformer-Architekturen (die langfristige Beziehungen über das Bild hinweg erfassen). Jedes Modell wurde auf dem Obst-Datensatz neu trainiert und hinsichtlich Genauigkeit, Robustheit bei Kreuzvalidierung und Rechenaufwand bewertet.

Ein hybrides Modell, das Details und Gesamtbild sieht

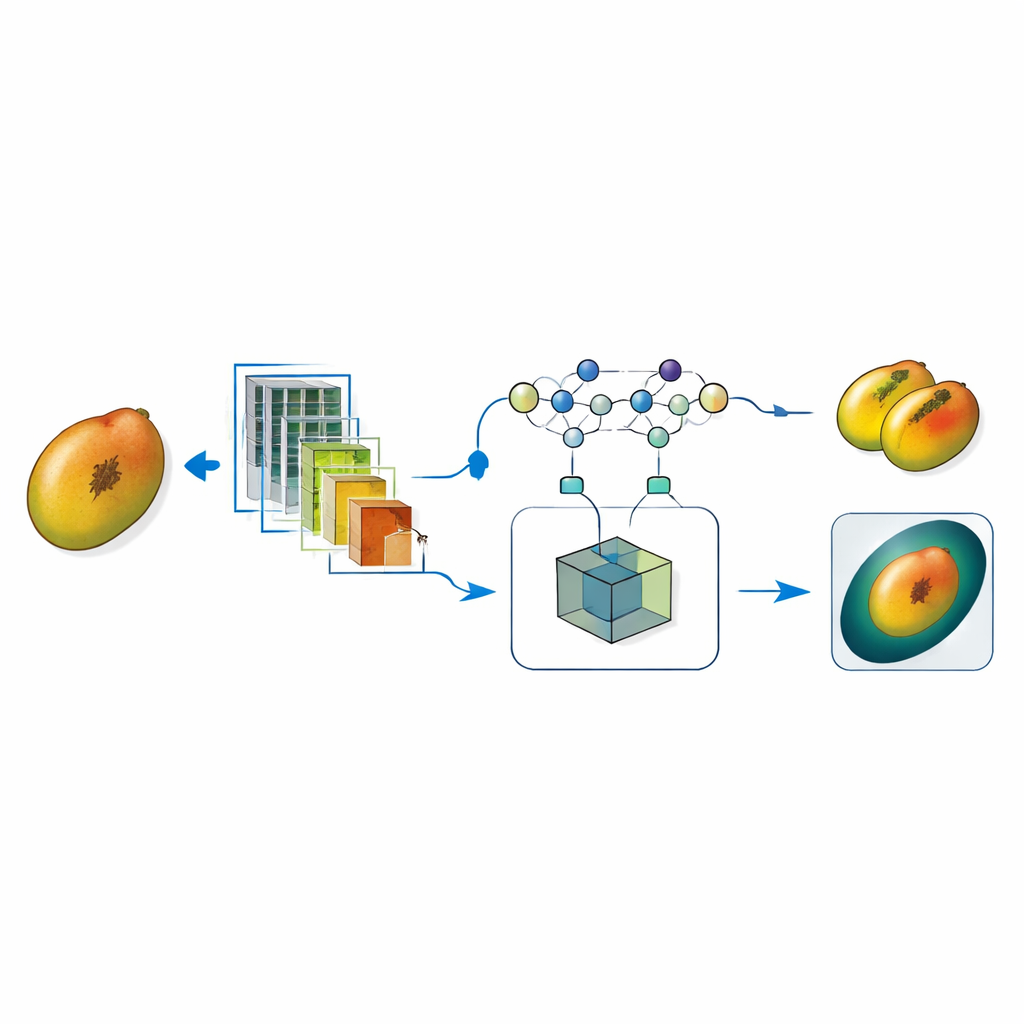

Aufbauend auf Stärken und Schwächen dieser Baselines entwarfen die Autorinnen und Autoren ein neues Hybridmodell namens CoAT‑AgriLite. Es kombiniert einen konvolutionalen „Stamm“, der sich auf feine räumliche Details wie kleine Läsionen oder Oberflächenrauigkeiten konzentriert, mit aufmerksamkeitsbasierten Blöcken aus Transformer-Netzen, die erfassen, wie verschiedene Bildregionen zueinander in Beziehung stehen. Anstatt einfach ein konvolutionales Netz und ein Transformer-Netz hintereinander zu schalten, verschmilzt CoAT‑AgriLite deren Merkmale in der Mitte, sodass lokale und globale Informationen direkt interagieren können. Das Design ist bewusst leichtgewichtig: Es verwendet weniger Parameter und weniger Gleitkommaoperationen als typische Transformer-Modelle, sodass es für Echtzeitanwendungen auf bescheidener Hardware wie Mobiltelefonen, Drohnen oder Edge-Geräten in Verpackungsbetrieben geeignet ist.

Nachvollziehen, wie die KI zu ihren Entscheidungen kommt

Allein hohe Genauigkeit genügt in der Landwirtschaft nicht, wo ein falsches Urteil verschwendete Früchte oder unkontrollierten Krankheitsbefall bedeuten kann. Um Vertrauen zu schaffen, integrierte das Team ein Erklärungswerkzeug namens Grad‑CAM. Für jede Vorhersage erzeugt Grad‑CAM eine Heatmap, die Bereiche des Fruchtbildes hervorhebt, die am stärksten zur Entscheidung des Modells beigetragen haben. Bei gesunden Früchten verteilt sich die Aufmerksamkeit gleichmäßiger oder bleibt niedrig, bei kranken konzentriert sie sich auf dunkle Flecken, verfärbte Stellen oder aufgeweichte Bereiche. Experimente zeigten, dass über 90 Prozent der Aktivierungsenergie des Modells auf echte Läsionsbereiche fielen statt auf Hintergrundstörungen, und selbst die seltenen Fehler betrafen meist Bilder mit extrem subtilen oder teilweise verdeckten Schäden statt zufälligem Rauschen.

Wie gut es funktioniert und warum das wichtig ist

In umfangreichen Tests übertraf CoAT‑AgriLite deutlich alle vier Benchmark-Modelle und eine Reihe zuvor veröffentlichter Systeme. Auf unbekannten Testbildern erreichte es eine Gesamtgenauigkeit von 99,37 Prozent sowie ähnlich hohe Werte für Precision, Recall und F1-Score in den einzelnen Fruchttypen, was darauf hindeutet, dass es selten kranke Proben übersah und kaum Fehlalarme erzeugte. Gleichzeitig erreichte oder übertraf es komplexere, schwerere Modelle bei geringerem Rechenaufwand, was bestätigt, dass ein sorgfältiges hybrides Design sowohl leistungsfähig als auch effizient sein kann. Für Nicht-Spezialisten lautet die Kernaussage: Eine kompakte, erklärbare KI kann heute gewöhnliche Fotos von Früchten zuverlässig auf Krankheiten prüfen und ihre Entscheidungen visuell begründen. Solche Systeme könnten Landwirtinnen und Landwirte, Agronomen und Lieferkettenmanager beim Überwachen des Pflanzenzustands, beim Automatisieren von Sortierlinien und beim Reduzieren von Verlusten unterstützen – und so gesünderes Obst vom Feld bis auf den Tisch mit größerer Transparenz und geringeren Kosten liefern.

Zitation: Kothandaraman, R., Srinivasan, S., Mathivanan, S. et al. A hybrid convolution and attention-based framework with visual explanation for fruit disease identification. Sci Rep 16, 12771 (2026). https://doi.org/10.1038/s41598-026-42135-5

Schlüsselwörter: Erkennung von Obstkrankheiten, erklärbare KI, Deep Learning, Computer Vision, präzise Landwirtschaft