Clear Sky Science · es

Un marco híbrido basado en convolución y atención con explicación visual para la identificación de enfermedades en frutas

Por qué importan los controles de fruta más inteligentes

Desde los plátanos del desayuno hasta las fresas en batidos, la fruta es un alimento diario y una fuente importante de ingresos para agricultores de todo el mundo. Sin embargo, manchas ocultas, podredumbre e infecciones fúngicas pueden arruinar cosechas, acortar la vida útil y encarecer los precios. Este estudio explora cómo un sistema de inteligencia artificial avanzado pero ligero puede detectar automáticamente enfermedades en frutas comunes a partir de fotos sencillas, y además mostrar a las personas exactamente en qué "miró" para tomar cada decisión.

El problema de la fruta enferma

Los cultivos frutales como plátanos, uvas, limones, mangos y fresas son vulnerables a una amplia gama de enfermedades causadas por hongos, bacterias, virus y deficiencias nutricionales. Estos problemas suelen manifestarse como pequeñas manchas en las hojas, parches descoloridos o zonas de podredumbre en la superficie del fruto. Si se detectan tarde, las infecciones se propagan rápidamente por los huertos, reduciendo rendimientos y obligando a los agricultores a gastar más en productos químicos e inspecciones intensivas en mano de obra. El diagnóstico tradicional depende de expertos que recorren los campos y examinan visualmente las plantas: un proceso lento, subjetivo y difícil de escalar a explotaciones grandes. Los síntomas tempranos o sutiles se pasan fácilmente por alto, sobre todo con iluminación variable, fondos recargados o cuando los frutos de distintas variedades se parecen entre sí.

Enseñar a los ordenadores a ver los defectos de la fruta

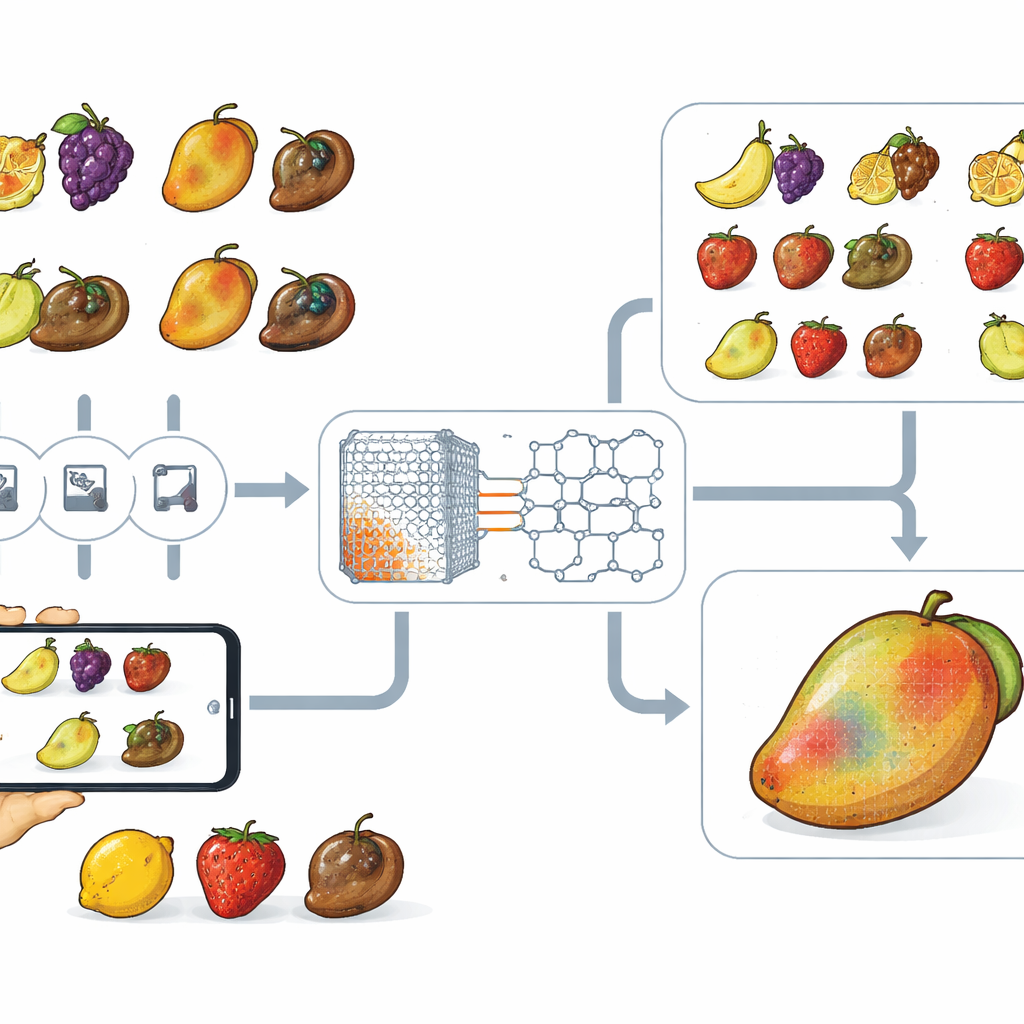

Los investigadores recurrieron al aprendizaje profundo, una forma de inteligencia artificial que aprende patrones directamente de las imágenes. Utilizaron un conjunto de datos público con 22.457 fotos de cinco tipos de fruta, cada una etiquetada como sana o podrida. Las imágenes se redimensionaron cuidadosamente, se corrigió el color y se aumentaron mediante rotaciones, volteos y ruido para imitar la variación del mundo real y evitar el sobreajuste a condiciones limitadas. Se probaron cuatro modelos sólidos existentes como referencia: dos basados en redes neuronales convolucionales (que sobresalen en captar texturas y bordes locales) y dos basados en arquitecturas transformer (buenas para capturar relaciones de largo alcance en una imagen). Cada modelo se reentrenó con el conjunto de frutas y se evaluó en precisión, robustez mediante validación cruzada y coste computacional.

Un modelo híbrido que ve tanto el detalle como el panorama general

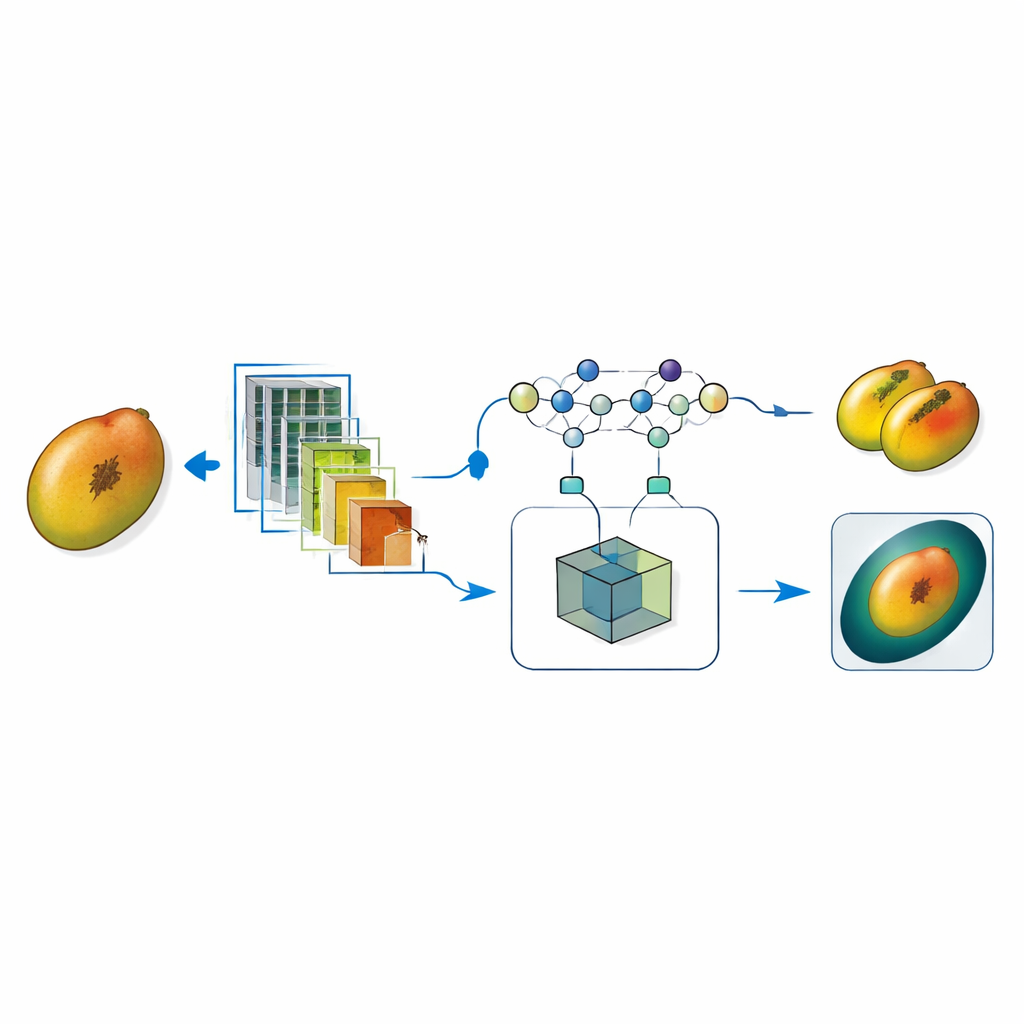

Tomando como base las fortalezas y debilidades de esos modelos de referencia, los autores diseñaron un nuevo modelo híbrido llamado CoAT‑AgriLite. Combina un "tallo" convolucional que se centra en el detalle espacial fino —como pequeñas lesiones o rugosidad de la superficie— con bloques basados en atención tomados de redes transformer que capturan cómo se relacionan distintas regiones del fruto a lo largo de toda la imagen. En lugar de apilar simplemente una red convolucional y una transformer una tras otra, CoAT‑AgriLite fusiona sus características a mitad de camino, permitiendo que la información local y global interactúe directamente. El diseño es intencionadamente ligero: usa menos parámetros y menos operaciones en coma flotante que los modelos transformer típicos, lo que lo hace adecuado para uso en tiempo real en hardware modesto como teléfonos móviles, drones o dispositivos en las líneas de envasado.

Ver cómo la IA toma sus decisiones

La precisión por sí sola no es suficiente en agricultura, donde un diagnóstico erróneo puede significar fruta desperdiciada o una enfermedad sin control. Para generar confianza, el equipo integró una herramienta de explicabilidad conocida como Grad‑CAM. Para cada predicción, Grad‑CAM produce un mapa de calor que resalta las zonas de la imagen del fruto que más contribuyeron a la decisión del modelo. En frutas sanas, la atención se distribuye de forma uniforme o permanece baja, mientras que en frutas enfermas se concentra alrededor de manchas oscuras, parches descoloridos o zonas reblandecidas. Los experimentos mostraron que más del 90 por ciento de la energía de activación del modelo recaía en áreas de lesión verdaderas en lugar de en el desorden de fondo, y que incluso sus raros errores tendían a darse con imágenes con daños extremadamente sutiles o parcialmente ocultos, más que por ruido aleatorio.

Qué tan bien funciona y por qué importa

En extensas pruebas, CoAT‑AgriLite superó claramente a los cuatro modelos de referencia y a una serie de sistemas publicados previamente. En imágenes de prueba no vistas, alcanzó un 99,37 por ciento de precisión global, con niveles igualmente altos de precisión, recall y F1 para cada tipo de fruta, lo que indica que rara vez fallaba al detectar muestras enfermas y apenas generaba falsas alarmas. También igualó o venció a modelos más complejos y pesados requiriendo menos cálculo, confirmando que un diseño híbrido cuidadoso puede ser a la vez potente y eficiente. Para el público general, el mensaje clave es que una IA compacta y explicable puede ahora analizar fotos ordinarias de frutas y señalar la enfermedad de forma fiable, justificando visualmente sus elecciones. Tales sistemas podrían ayudar a agricultores, agrónomos y gestores de la cadena de suministro a monitorizar la salud de los cultivos, automatizar líneas de clasificación y reducir el desperdicio, contribuyendo a llevar fruta más sana del huerto a la mesa con mayor transparencia y menor coste.

Cita: Kothandaraman, R., Srinivasan, S., Mathivanan, S. et al. A hybrid convolution and attention-based framework with visual explanation for fruit disease identification. Sci Rep 16, 12771 (2026). https://doi.org/10.1038/s41598-026-42135-5

Palabras clave: detección de enfermedades en frutas, IA explicable, aprendizaje profundo, visión por computador, agricultura de precisión