Clear Sky Science · it

Un framework ibrido basato su convoluzione e attention con spiegazioni visive per l’identificazione delle malattie della frutta

Perché controlli più intelligenti sulla frutta contano

Dalle banane a colazione alle fragole nei frullati, la frutta è un alimento quotidiano ed è anche una fonte di reddito fondamentale per gli agricoltori in tutto il mondo. Ma macchie nascoste, marciume e infezioni fungine possono spazzare via i raccolti, ridurre la durata di conservazione e far lievitare i prezzi. Questo studio esplora come un sistema di intelligenza artificiale avanzato ma leggero possa individuare automaticamente le malattie su frutti comuni a partire da semplici fotografie, mostrando al contempo alle persone esattamente ciò che ha “guardato” per prendere ogni decisione.

Il problema della frutta malata

Colture frutticole come banane, uva, limoni, mango e fragole sono vulnerabili a una vasta gamma di malattie causate da funghi, batteri, virus e carenze nutrizionali. Questi problemi si manifestano spesso come piccole macchie sulle foglie, chiazze scolorite o aree di marciume sulla superficie del frutto. Se individuate tardi, le infezioni si diffondono rapidamente nei frutteti, riducendo le rese e costringendo gli agricoltori a sostenere costi maggiori per prodotti chimici e ispezioni manuali intensive. La diagnosi tradizionale si basa su esperti che camminano nei campi ed esaminano visivamente le piante: un processo lento, soggettivo e difficile da scalare su aziende di grandi dimensioni. Sintomi precoci o sottili vengono facilmente trascurati, specialmente con luce variabile, sfondi complessi o quando i frutti sono simili tra varietà diverse.

Insegnare ai computer a vedere i difetti della frutta

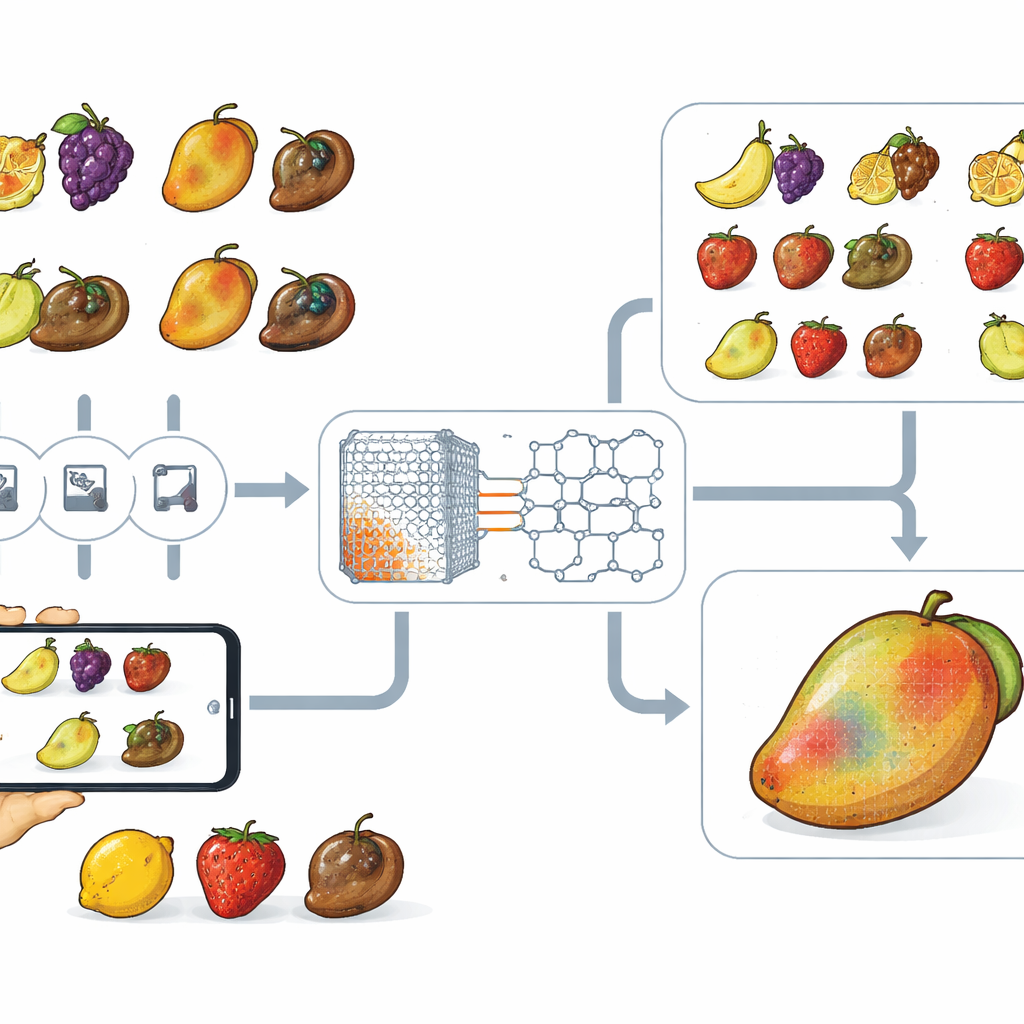

I ricercatori si sono rivolti all’apprendimento profondo, una forma di intelligenza artificiale che apprende pattern direttamente dalle immagini. Hanno utilizzato un dataset pubblico di 22.457 foto rappresentanti cinque tipi di frutta, ciascuna etichettata come sana o marcia. Le immagini sono state ridimensionate con cura, corrette nel colore e aumentate tramite rotazioni, ribaltamenti e rumore per imitare la variazione del mondo reale e evitare l’overfitting a condizioni ristrette. Quattro modelli forti esistenti sono stati testati come benchmark: due basati su reti neurali convoluzionali (che eccellono nell’individuare texture ed edge locali) e due basati su architetture transformer (ottime nel catturare relazioni a lungo raggio attraverso l’immagine). Ogni modello è stato riaddestrato sul dataset di frutta e valutato in termini di accuratezza, robustezza con cross‑validation e costo computazionale.

Un modello ibrido che vede sia i dettagli che il quadro generale

Sfruttando i punti di forza e le debolezze di questi modelli di riferimento, gli autori hanno progettato un nuovo modello ibrido chiamato CoAT‑AgriLite. Combina uno “stelo” convoluzionale che si concentra sui dettagli spaziali fini — come piccole lesioni o ruvidità della superficie — con blocchi basati su attention presi in prestito dalle reti transformer che catturano come regioni diverse del frutto si relazionano tra loro sull’intera immagine. Invece di sovrapporre semplicemente una rete convoluzionale e una transformer una dopo l’altra, CoAT‑AgriLite fonde le loro feature a metà percorso, permettendo alle informazioni locali e globali di interagire direttamente. Il design è intenzionalmente leggero: utilizza meno parametri e meno operazioni in virgola mobile rispetto ai tipici modelli transformer, rendendolo adatto all’uso in tempo reale su hardware modesti come telefoni cellulari, droni o dispositivi edge nei magazzini di confezionamento.

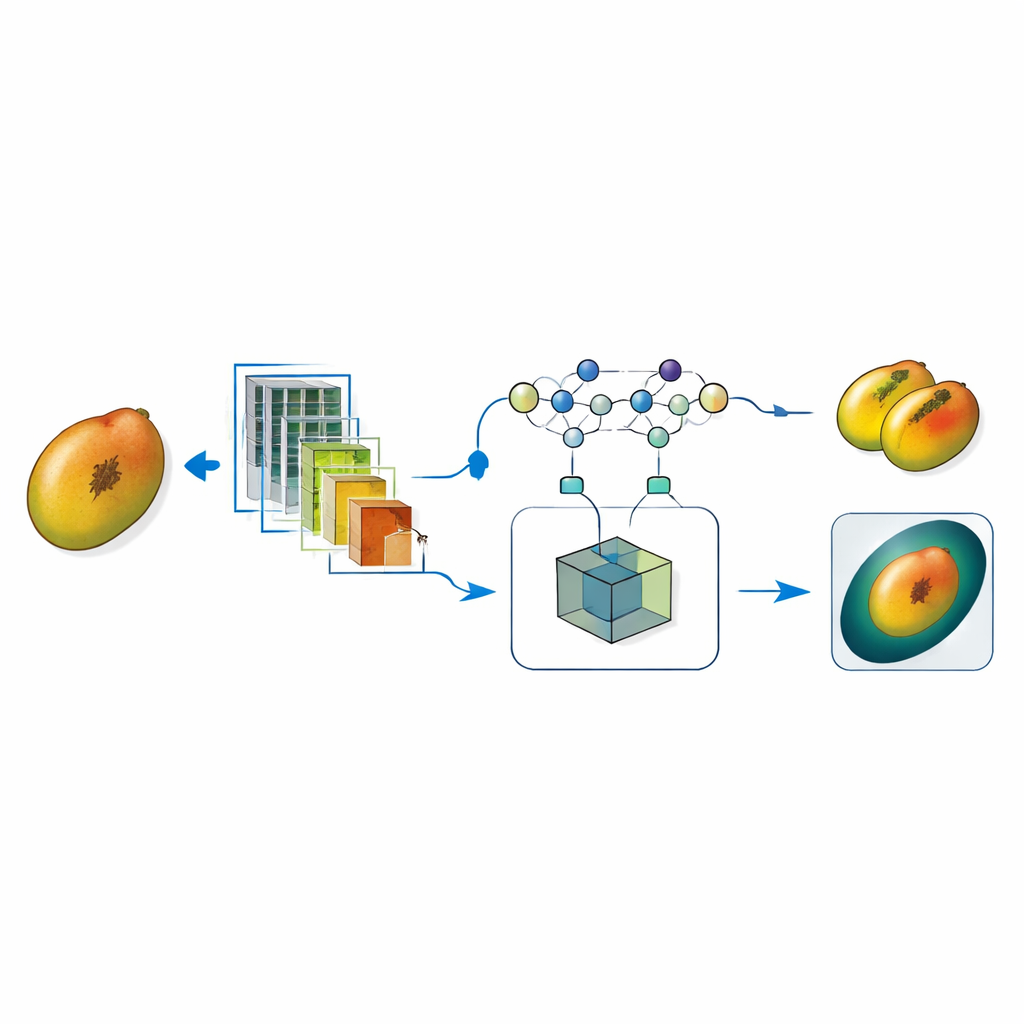

Vedere come l’IA prende le sue decisioni

La sola accuratezza non basta in agricoltura, dove un errore può significare frutta sprecata o diffusione non controllata di una malattia. Per costruire fiducia, il team ha integrato uno strumento di spiegabilità noto come Grad‑CAM. Per ogni previsione, Grad‑CAM produce una heatmap che evidenzia le aree dell’immagine del frutto che hanno contribuito maggiormente alla decisione del modello. Nei frutti sani l’attenzione si distribuisce in modo uniforme o rimane bassa, mentre nei frutti malati si concentra attorno a macchie scure, chiazze scolorite o regioni ammorbidite. Gli esperimenti hanno mostrato che oltre il 90 percento dell’energia di attivazione del modello cadeva su vere aree lesionate piuttosto che sullo sfondo, e anche gli errori rari tendevano a riguardare immagini con danni estremamente sottili o parzialmente nascosti piuttosto che rumore casuale.

Quanto funziona bene e perché è importante

Nei test estesi, CoAT‑AgriLite ha superato chiaramente tutti e quattro i modelli di riferimento e una serie di sistemi pubblicati in precedenza. Su immagini di test non viste ha raggiunto il 99,37 percento di accuratezza complessiva, con valori di precision, recall e F1 altrettanto elevati per ciascun tipo di frutta, indicando che raramente mancava campioni malati e raramente generava falsi allarmi. Ha inoltre eguagliato o battuto modelli più complessi e pesanti richiedendo meno risorse computazionali, confermando che un progetto ibrido ben calibrato può essere sia potente che efficiente. Per i non specialisti, il messaggio chiave è che ora un’IA compatta e spiegabile può guardare foto ordinarie di frutta e segnalare con affidabilità le malattie, giustificando visivamente le sue scelte. Tali sistemi potrebbero supportare agricoltori, agronomi e responsabili della filiera nel monitoraggio della salute delle colture, nell’automazione delle linee di selezione e nella riduzione degli sprechi — aiutando a portare frutta più sana dal frutteto alla tavola con maggiore trasparenza e costi inferiori.

Citazione: Kothandaraman, R., Srinivasan, S., Mathivanan, S. et al. A hybrid convolution and attention-based framework with visual explanation for fruit disease identification. Sci Rep 16, 12771 (2026). https://doi.org/10.1038/s41598-026-42135-5

Parole chiave: rilevamento malattie della frutta, IA spiegabile, apprendimento profondo, visione artificiale, agricoltura di precisione