Clear Sky Science · pl

Hybrydowe podejście oparte na splotach i mechanizmie uwagi z wizualnym wyjaśnieniem do identyfikacji chorób owoców

Dlaczego inteligentniejsze kontrole owoców mają znaczenie

Od bananów na śniadanie po truskawki w koktajlach — owoce to codzienny podstawowy produkt i znaczące źródło dochodu dla rolników na całym świecie. Ukryte plamy, gnicie i infekcje grzybicze mogą jednak potajemnie zniszczyć plony, skrócić trwałość i podnieść ceny. W tym badaniu zbadano, jak zaawansowany, lecz lekki system sztucznej inteligencji może automatycznie wykrywać choroby powszechnych owoców na podstawie prostych zdjęć, jednocześnie pokazując ludziom dokładnie, na co „patrzył” przy podejmowaniu każdej decyzji.

Problem z chorymi owocami

Uprawy owocowe, takie jak banany, winogrona, cytryny, mango i truskawki, są podatne na wiele chorób wywoływanych przez grzyby, bakterie, wirusy oraz zaburzenia odżywiania. Problemy te często ujawniają się jako drobne plamki na liściach, przebarwienia lub miejsca gnicie na powierzchni owocu. Jeśli zostaną wykryte zbyt późno, infekcje szybko rozprzestrzeniają się po sadach, obniżając plony i zmuszając rolników do większych wydatków na środki chemiczne i czasochłonne inspekcje. Tradycyjna diagnostyka opiera się na wyszkolonych ekspertach chodzących po polach i oglądających rośliny wzrokowo — proces ten jest powolny, subiektywny i trudny do skalowania na duże gospodarstwa. Wczesne lub subtelne objawy łatwo przeoczyć, szczególnie przy zmiennym oświetleniu, zagraconym tle lub gdy owoce różnych odmian wyglądają podobnie.

Nauka komputera rozpoznawania wad owoców

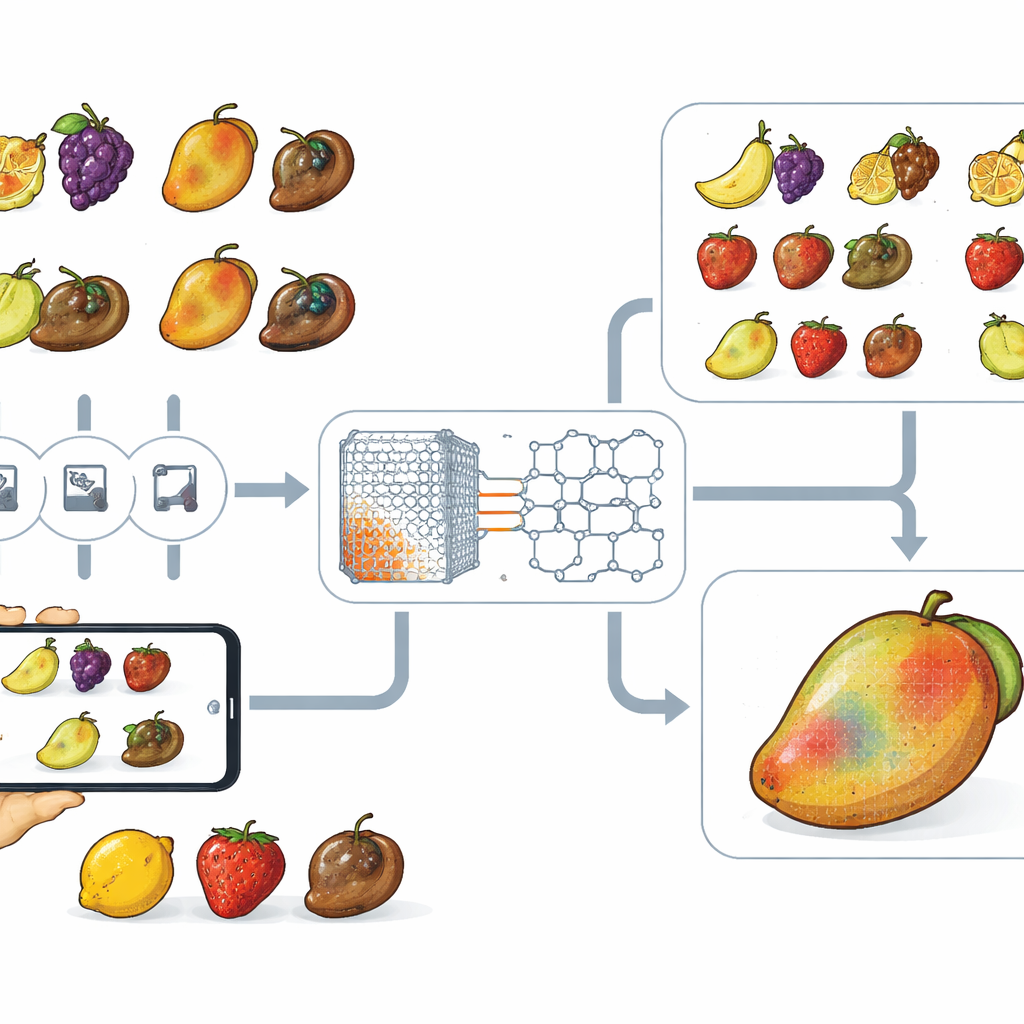

Naukowcy sięgnęli po głębokie uczenie — formę sztucznej inteligencji, która uczy się wzorców bezpośrednio z obrazów. Wykorzystali publiczny zbiór 22 457 zdjęć przedstawiających pięć rodzajów owoców, z etykietami: zdrowe lub zgniłe. Obrazy zostały starannie zmienione rozmiarowo, skorygowano ich kolory i rozszerzono o rotacje, odbicia i szumy, by odwzorować rzeczywistą zmienność i zapobiec przeuczeniu na wąskim zestawie warunków. Jako punkty odniesienia przetestowano cztery silne istniejące modele: dwa oparte na splotowych sieciach neuronowych (dobrych w wykrywaniu lokalnych tekstur i krawędzi) oraz dwa oparte na architekturach transformatorowych (dobrych w wychwytywaniu zależności na dużą odległość w obrazie). Każdy model został ponownie wytrenowany na zbiorze owoców i oceniony pod kątem dokładności, odporności w walidacji krzyżowej oraz kosztu obliczeniowego.

Hybrydowy model widzący szczegóły i całość

Wychodząc od mocnych i słabych stron tych bazowych modeli, autorzy zaprojektowali nowy hybrydowy model nazwany CoAT‑AgriLite. Łączy on splotowy „trzon”, skupiający się na drobnych cechach przestrzennych — takich jak małe zmiany chorobowe czy chropowatość powierzchni — z blokami opartymi na mechanizmie uwagi zapożyczonymi z sieci transformatorowych, które wychwytują, jak różne regiony owocu odnoszą się do siebie w całym obrazie. Zamiast prostego ułożenia sieci splotowej i transformatora jedna za drugą, CoAT‑AgriLite łączy ich cechy w środku sieci, pozwalając na bezpośrednią interakcję informacji lokalnych i globalnych. Projekt jest celowo lekki: używa mniej parametrów i mniejszej liczby operacji zmiennoprzecinkowych niż typowe modele transformatorowe, co czyni go odpowiednim do pracy w czasie rzeczywistym na skromnym sprzęcie, takim jak telefony komórkowe, drony czy urządzenia brzegowe w sortowniach.

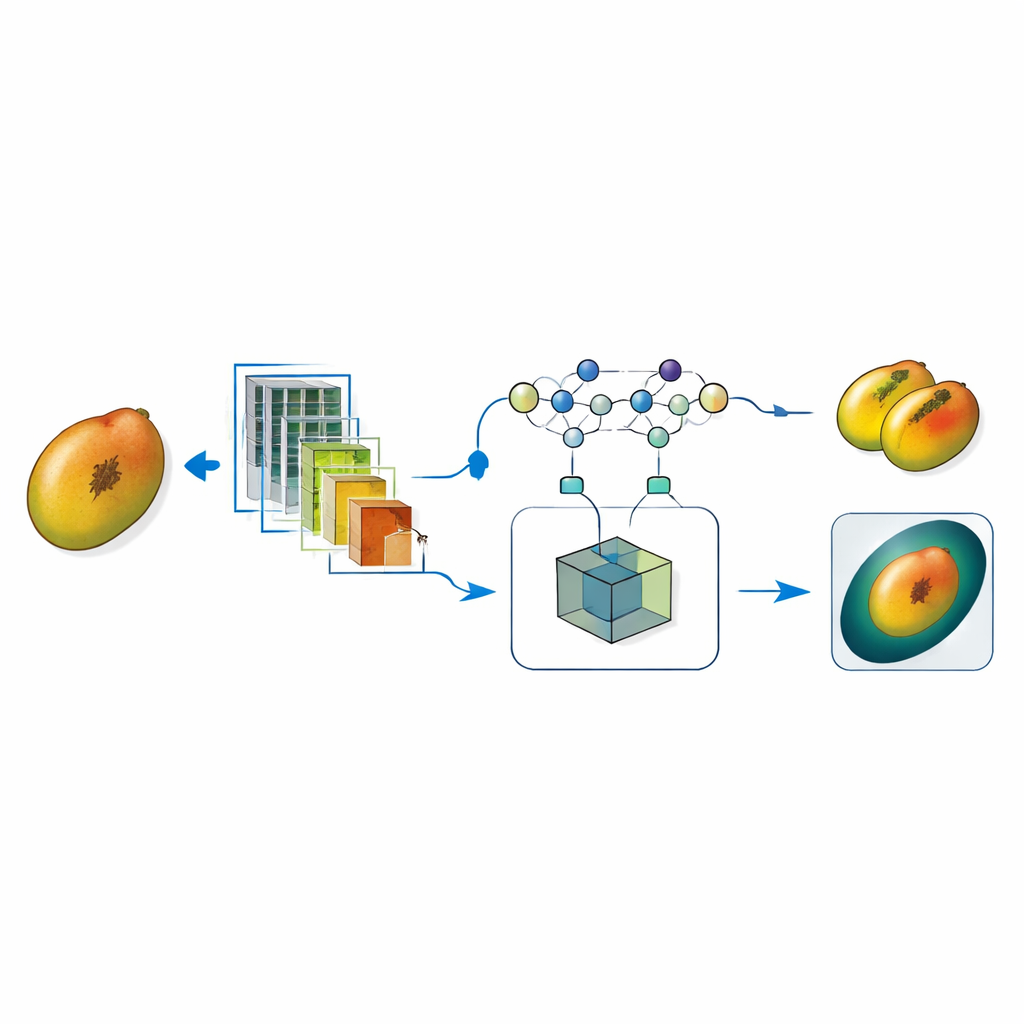

Wizualizacja, jak SI podejmuje decyzje

Sama dokładność nie wystarcza w rolnictwie, gdzie błędna ocena może oznaczać zmarnowane owoce lub niekontrolowane rozprzestrzenianie się chorób. Aby budować zaufanie, zespół zintegrował narzędzie wyjaśnialności znane jako Grad‑CAM. Dla każdej predykcji Grad‑CAM generuje mapę cieplną podkreślającą obszary obrazu owocu, które najsilniej przyczyniły się do decyzji modelu. W zdrowych owocach uwaga rozkłada się równomiernie lub pozostaje niska, podczas gdy w owocach chorych skupia się wokół ciemnych plam, przebarwień lub zmiękczonych miejsc. Eksperymenty wykazały, że ponad 90 procent energii aktywacji modelu trafiało na rzeczywiste obszary zmian chorobowych, a nawet sporadyczne błędy dotyczyły zwykle obrazów z niezwykle subtelnymi lub częściowo ukrytymi uszkodzeniami, a nie losowym szumem.

Skuteczność i znaczenie

W szerokich testach CoAT‑AgriLite wyraźnie przewyższył wszystkie cztery modele odniesienia oraz szereg wcześniej opublikowanych systemów. Na nieznanych obrazach testowych osiągnął 99,37 procent ogólnej dokładności, z równie wysokimi wynikami precyzji, czułości i F1 dla każdego rodzaju owocu, co wskazuje, że rzadko pomijał przypadki chorób i rzadko sygnalizował fałszywe alarmy. Przewyższał lub dorównywał także bardziej złożonym, cięższym modelom przy mniejszym zapotrzebowaniu obliczeniowym, potwierdzając, że staranny projekt hybrydowy może być zarówno efektywny, jak i wydajny. Dla osób niebędących specjalistami kluczowy wniosek jest taki, że zwarty, wyjaśnialny system AI może dziś obejrzeć zwykłe zdjęcia owoców i niezawodnie wykryć chorobę, wizualnie uzasadniając swoje wybory. Takie systemy mogą wspierać rolników, agronomów i menedżerów łańcuchów dostaw w monitorowaniu zdrowia upraw, automatyzacji linii sortowania i redukcji strat — pomagając dostarczać zdrowsze owoce z sadu na stół z większą przejrzystością i niższymi kosztami.

Cytowanie: Kothandaraman, R., Srinivasan, S., Mathivanan, S. et al. A hybrid convolution and attention-based framework with visual explanation for fruit disease identification. Sci Rep 16, 12771 (2026). https://doi.org/10.1038/s41598-026-42135-5

Słowa kluczowe: wykrywanie chorób owoców, wyjaśnialna sztuczna inteligencja, głębokie uczenie, widzenie komputerowe, rolnictwo precyzyjne