Clear Sky Science · fr

Cadre hybride basé sur convolution et attention avec explication visuelle pour l’identification des maladies des fruits

Pourquoi des contrôles plus intelligents des fruits sont importants

Des bananes du petit‑déjeuner aux fraises des smoothies, les fruits font partie de l’alimentation quotidienne — et constituent une source de revenu majeure pour les agriculteurs du monde entier. Mais des taches cachées, la pourriture et des infections fongiques peuvent anéantir des récoltes, réduire la durée de conservation et faire grimper les prix. Cette étude examine comment un système d’intelligence artificielle avancé mais léger peut repérer automatiquement les maladies sur des fruits courants à partir de photos simples, tout en montrant aux humains ce qu’il « a regardé » pour prendre chaque décision.

Le problème des fruits malades

Les cultures fruitières comme la banane, le raisin, le citron, la mangue et la fraise sont vulnérables à une large gamme de maladies causées par des champignons, des bactéries, des virus et des carences nutritives. Ces problèmes se manifestent souvent par de petites taches sur les feuilles, des zones décolorées ou des parties de fruit en décomposition. Si l’on intervient trop tard, les infections se propagent rapidement dans les vergers, réduisant les rendements et obligeant les agriculteurs à dépenser davantage en produits chimiques et en inspections manuelles. Le diagnostic traditionnel repose sur des experts formés parcourant les parcelles et examinant visuellement les plantes — un processus lent, subjectif et difficile à étendre aux grandes exploitations. Les symptômes précoces ou discrets passent facilement inaperçus, surtout sous des éclairages changeants, des arrière‑plans encombrés ou lorsque des variétés se ressemblent.

Apprendre aux ordinateurs à voir les défauts des fruits

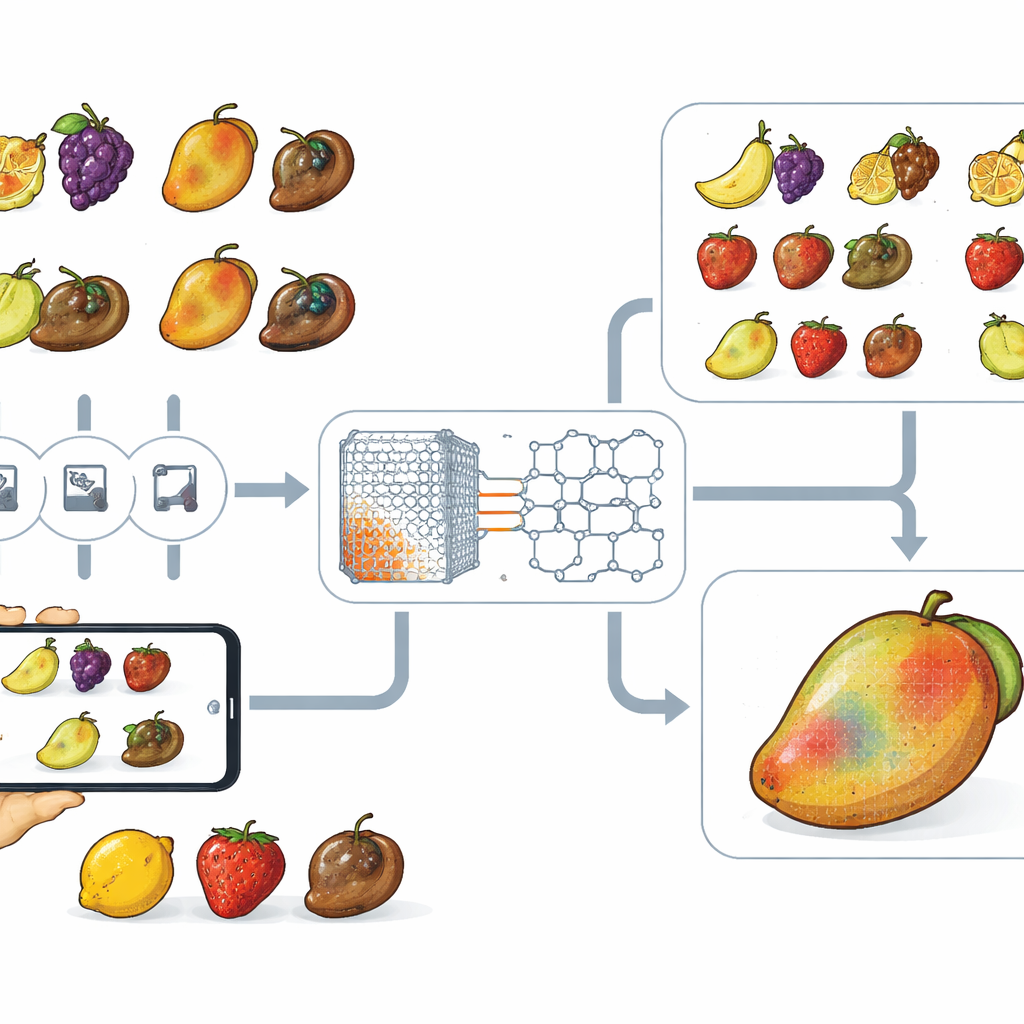

Les chercheurs se sont tournés vers l’apprentissage profond, une forme d’intelligence artificielle qui apprend les motifs directement à partir des images. Ils ont utilisé un jeu de données public de 22 457 photos montrant cinq types de fruits, chacune étiquetée comme saine ou pourrie. Les images ont été soigneusement redimensionnées, corrigées en couleur et augmentées par rotations, retournements et bruit pour reproduire la variation du monde réel et éviter le surapprentissage à un ensemble restreint de conditions. Quatre modèles solides existants ont servi de références : deux basés sur des réseaux neuronaux convolutionnels (excellents pour détecter textures locales et contours) et deux basés sur des architectures de type transformeur (efficaces pour capturer des relations à longue portée dans l’image). Chaque modèle a été réentraîné sur le jeu de données fruitier et évalué pour la précision, la robustesse en validation croisée et le coût computationnel.

Un modèle hybride qui voit à la fois le détail et la vue d’ensemble

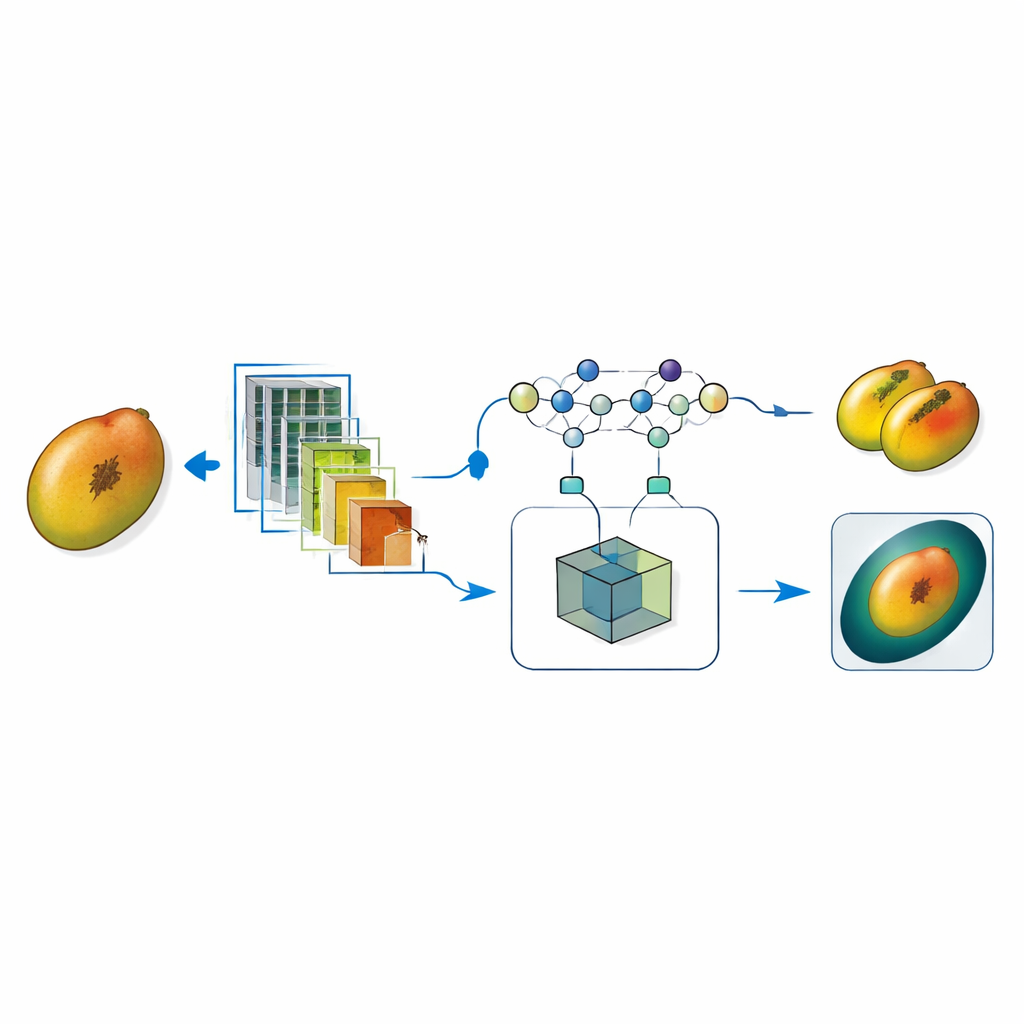

S’appuyant sur les forces et les faiblesses de ces modèles de référence, les auteurs ont conçu un nouveau modèle hybride nommé CoAT‑AgriLite. Il combine une « tige » convolutionnelle qui se concentre sur le détail spatial fin — comme de petites lésions ou la rugosité de la surface — avec des blocs basés sur l’attention empruntés aux transformeurs, qui captent la façon dont différentes régions d’un fruit se relient entre elles à l’échelle de l’image. Plutôt que d’empiler simplement un réseau convolutionnel et un transformeur l’un après l’autre, CoAT‑AgriLite fusionne leurs caractéristiques en milieu de réseau, permettant une interaction directe entre informations locales et globales. Le design est volontairement léger : il utilise moins de paramètres et moins d’opérations en virgule flottante que les transformeurs typiques, ce qui le rend adapté à une utilisation en temps réel sur du matériel modeste comme les téléphones mobiles, les drones ou les dispositifs en périphérie des lignes de conditionnement.

Voir comment l’IA prend ses décisions

La seule précision ne suffit pas en agriculture, où une erreur peut signifier des fruits gaspillés ou la propagation non contrôlée d’une maladie. Pour instaurer la confiance, l’équipe a intégré un outil d’explicabilité connu sous le nom de Grad‑CAM. Pour chaque prédiction, Grad‑CAM produit une carte thermique mettant en évidence les zones de l’image du fruit qui ont le plus contribué à la décision du modèle. Sur les fruits sains, l’attention se répartit de manière homogène ou reste faible, tandis que sur les fruits malades elle se concentre autour des taches sombres, des zones décolorées ou des parties ramollies. Les expériences ont montré que plus de 90 % de l’énergie d’activation du modèle se focalisait sur de véritables zones de lésion plutôt que sur le bruit d’arrière‑plan, et que ses rares erreurs impliquaient généralement des images avec des dommages extrêmement subtils ou partiellement cachés plutôt que du bruit aléatoire.

Performances et importance

Lors d’essais étendus, CoAT‑AgriLite a nettement surpassé les quatre modèles de référence et une série de systèmes publiés antérieurement. Sur des images de test inconnues, il a atteint 99,37 % de précision globale, avec des scores de précision, rappel et F1 tout aussi élevés pour chaque type de fruit, indiquant qu’il manquait rarement des échantillons malades et déclenchait peu de faux positifs. Il a également égalé ou battu des modèles plus complexes et plus lourds tout en demandant moins de calculs, confirmant qu’un design hybride soigné peut être à la fois performant et efficace. Pour le grand public, le message clé est qu’une IA compacte et explicable peut désormais analyser des photos ordinaires de fruits et signaler de manière fiable les maladies, tout en justifiant visuellement ses choix. De tels systèmes pourraient aider agriculteurs, agronomes et gestionnaires de la chaîne d’approvisionnement à surveiller la santé des cultures, automatiser les lignes de tri et réduire le gaspillage — contribuant à livrer des fruits plus sains du verger à la table avec plus de transparence et à moindre coût.

Citation: Kothandaraman, R., Srinivasan, S., Mathivanan, S. et al. A hybrid convolution and attention-based framework with visual explanation for fruit disease identification. Sci Rep 16, 12771 (2026). https://doi.org/10.1038/s41598-026-42135-5

Mots-clés: détection des maladies des fruits, IA explicable, apprentissage profond, vision par ordinateur, agriculture de précision