Clear Sky Science · nl

Een hybride kader met convolutie en aandacht, met visuele uitleg voor de identificatie van fruitziekten

Waarom slimere fruitcontroles ertoe doen

Van bananen bij het ontbijt tot aardbeien in smoothies: fruit is een dagelijkse basisproducten en een belangrijke inkomstenbron voor boeren wereldwijd. Verborgen vlekken, rot en schimmelinfecties kunnen echter stilletjes oogsten vernietigen, de houdbaarheid verkorten en de prijzen opdrijven. Deze studie onderzoekt hoe een geavanceerd maar lichtgewicht kunstmatig intelligentiesysteem automatisch ziektes aan gewone vruchten kan detecteren op basis van eenvoudige foto’s, en tegelijkertijd aan mensen precies kan tonen waar het naar “keek” om tot elke beslissing te komen.

Het probleem van zieke vruchten

Fruitgewassen zoals bananen, druiven, citroenen, mango’s en aardbeien zijn gevoelig voor een breed scala aan ziekten veroorzaakt door schimmels, bacteriën, virussen en voedingsstoornissen. Deze problemen verschijnen vaak als kleine vlekken op bladeren, verkleurde plekken of rotte gebieden op het oppervlak van de vrucht. Als ze laat worden ontdekt, verspreiden infecties zich snel over boomgaarden, verminderen ze de opbrengst en dwingen ze boeren meer uit te geven aan chemische middelen en arbeidsintensieve inspecties. Traditionele diagnose berust op getrainde experts die door de velden lopen en planten visueel inspecteren — een proces dat traag, subjectief en moeilijk schaalbaar is naar grote bedrijven. Vroege of subtiele symptomen worden gemakkelijk gemist, zeker bij wisselend licht, rommelige achtergronden of wanneer vruchten tussen rassen sterk op elkaar lijken.

Computers leren vruchtfouten te zien

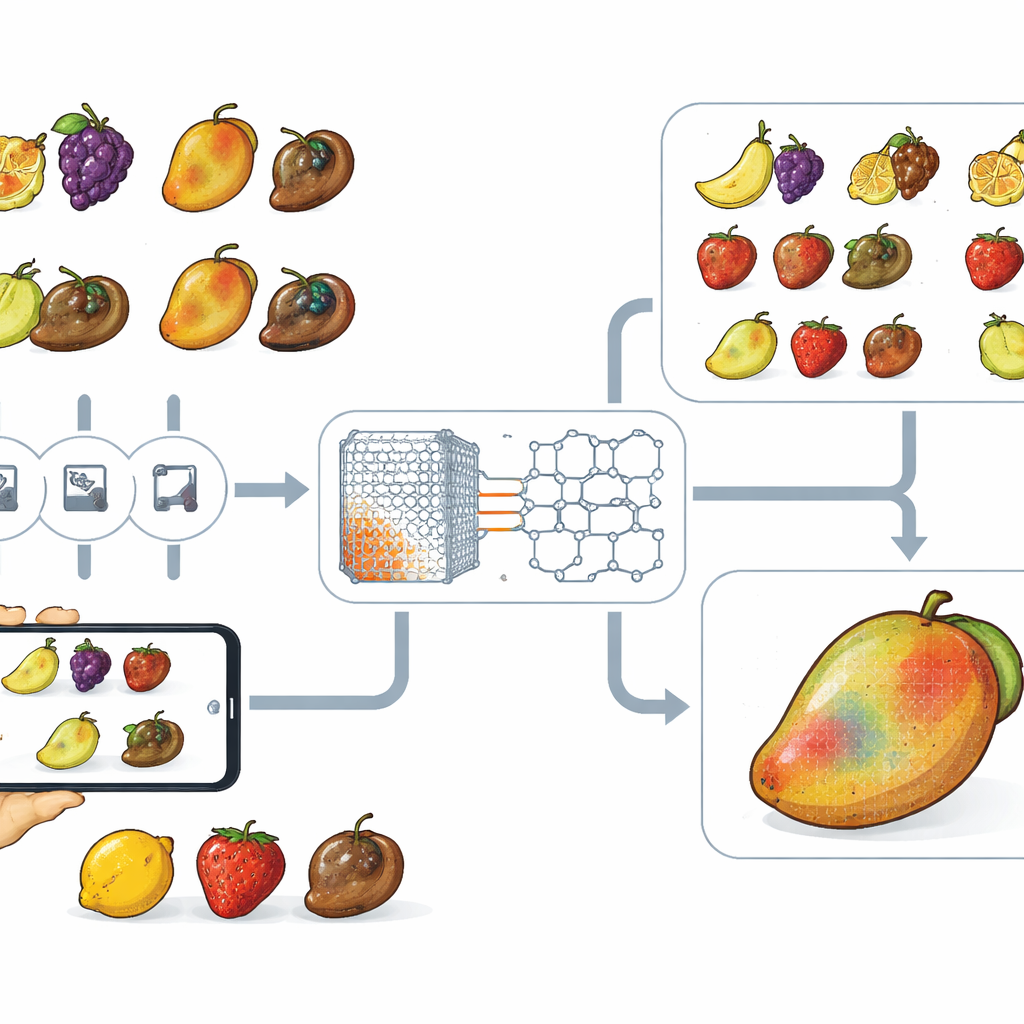

De onderzoekers grepen naar deep learning, een vorm van kunstmatige intelligentie die patronen rechtstreeks uit beelden leert. Ze gebruikten een openbare dataset van 22.457 foto’s van vijf fruitsoorten, telkens gelabeld als gezond of rot. De afbeeldingen werden zorgvuldig van formaat veranderd, kleurgecorrigeerd en verrijkt met rotaties, omkeringen en ruis om reële variatie na te bootsen en overfitting aan een beperkte set condities te voorkomen. Vier sterke bestaande modellen dienden als referentie: twee gebaseerd op convolutionele neurale netwerken (die uitblinken in het oppikken van lokale texturen en randen) en twee op transformer-architecturen (die goed zijn in het vastleggen van langafstandrelaties over een beeld). Elk model werd opnieuw getraind op de fruitdataset en geëvalueerd op nauwkeurigheid, robuustheid via cross-validatie en rekencost.

Een hybride model dat zowel detail als het geheel ziet

Voortbouwend op de sterke en zwakke punten van deze basislijnen ontwierpen de auteurs een nieuw hybride model genaamd CoAT‑AgriLite. Het combineert een convolutionele “stam” die zich richt op fijne ruimtelijke details — zoals kleine laesies of oppervlakteruwheid — met aandachtgebaseerde blokken ontleend aan transformer-netwerken die vastleggen hoe verschillende regio’s van een vrucht zich tot elkaar verhouden over het hele beeld. In plaats van eenvoudigweg een convolutioneel netwerk en een transformer achter elkaar te stapelen, fuseert CoAT‑AgriLite hun kenmerken halverwege, waardoor lokale en globale informatie direct met elkaar kunnen interageren. Het ontwerp is bewust lichtgewicht: het gebruikt minder parameters en minder floating-point operaties dan typische transformer-modellen, wat het geschikt maakt voor realtime gebruik op bescheiden hardware zoals mobiele telefoons, drones of edge-apparaten in verpakhallen.

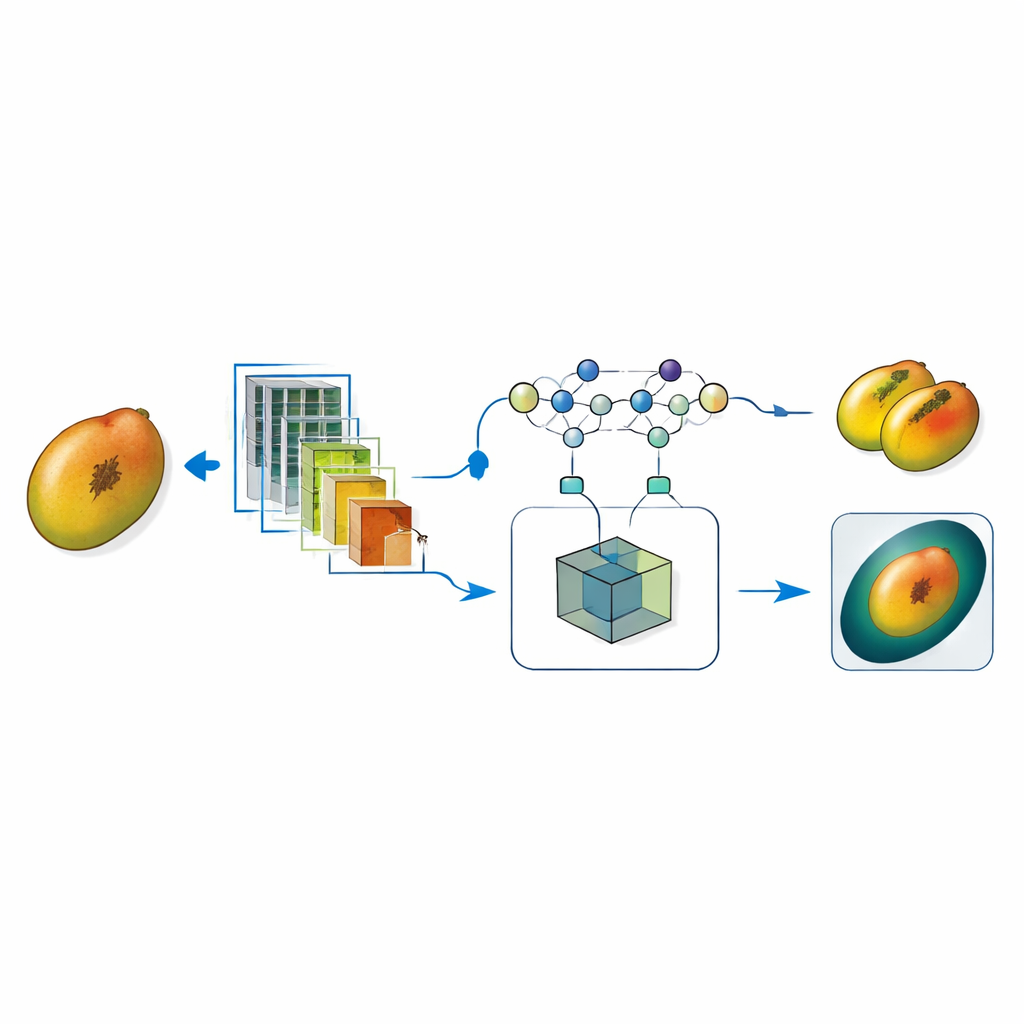

Zien hoe de AI haar beslissingen neemt

Nauwkeurigheid alleen is niet genoeg in de landbouw, waar een foutieve beslissing kan leiden tot verspilde vruchten of ongecontroleerde ziekteverspreiding. Om vertrouwen op te bouwen integreerde het team een verklaarbaarheidstool bekend als Grad‑CAM. Voor elke voorspelling genereert Grad‑CAM een warmtekaart die de gebieden van de fruitfoto benadrukt die het sterkst bijdroegen aan de beslissing van het model. Bij gezonde vruchten verspreidt de aandacht zich gelijkmatig of blijft laag, terwijl bij zieke vruchten de aandacht concentreert rond donkere vlekken, verkleurde plekken of verweekte gebieden. Experimenten toonden aan dat meer dan 90 procent van de activatie-energie van het model viel op echte laesiegebieden in plaats van op achtergrondrommel, en dat zelfs de zeldzame fouten meestal te maken hadden met beelden met zeer subtiele of gedeeltelijk verborgen schade in plaats van met willekeurige ruis.

Hoe goed het werkt en waarom het belangrijk is

In uitgebreide tests presteerde CoAT‑AgriLite duidelijk beter dan alle vier referentiemodellen en een reeks eerder gepubliceerde systemen. Op niet eerder geziene testafbeeldingen behaalde het 99,37 procent totale nauwkeurigheid, met vergelijkbaar hoge precisie-, recall- en F1-scores voor elk type fruit, wat aangeeft dat het zelden zieke monsters miste en zelden valse alarmen gaf. Het evenaarde of overtrof ook complexere, zwaardere modellen terwijl het minder rekenkracht vereiste, wat bevestigt dat zorgvuldig hybride ontwerp zowel krachtig als efficiënt kan zijn. Voor niet-specialisten is de kernboodschap dat een compact, verklaarbaar AI-systeem nu gewone foto’s van fruit betrouwbaar kan scannen op ziektes en zijn keuzes visueel kan onderbouwen. Dergelijke systemen kunnen boeren, agronomen en ketenmanagers ondersteunen bij het monitoren van gewasgezondheid, het automatiseren van sorteerlijnen en het verminderen van verspilling — en zo gezonder fruit van boomgaard tot tafel leveren met meer transparantie en lagere kosten.

Bronvermelding: Kothandaraman, R., Srinivasan, S., Mathivanan, S. et al. A hybrid convolution and attention-based framework with visual explanation for fruit disease identification. Sci Rep 16, 12771 (2026). https://doi.org/10.1038/s41598-026-42135-5

Trefwoorden: detectie van fruitziekten, verklaarbare AI, deep learning, computer vision, precisie-landbouw