Clear Sky Science · sv

SAM2-ARAFNet: att anpassa SAM2 med ett uppmärksamhetsförstärkt residualt ASPP-fusionsnätverk för semantisk segmentering av högupplöst fjärranalys

Skarpare blick över vår föränderliga planet

Från att kartlägga stormskador till att vägleda stadsplanering har flyg- och satellitbilder blivit ett av mänsklighetens mest kraftfulla verktyg för att förstå världen. Men att omvandla dessa detaljerade bilder till klara kartor över byggnader, vägar, träd och bilar är fortfarande förvånansvärt svårt, särskilt när datorer måste arbeta snabbt på drönare eller små enheter. Denna artikel presenterar SAM2-ARAFNet, ett nytt kartläggningssystem som bygger på en kraftfull visionsmodell och varsamt trimmas ned för att leverera mycket precisa markskapskartor från högupplösta bilder samtidigt som det använder betydligt mindre beräkningskraft än dagens ledande metoder.

Varför det är svårt att kartlägga städer ovanifrån

Högupplösta flygfoton fångar städer i anmärkningsvärd detalj: enskilda hus, trädkronor, parkerade bilar och till och med smala trottoarer syns. Men denna rikedom innebär också utmaningar. Ytor som hör till samma kategori, som olika typer av beläggning, kan se mycket olika ut, medan skilda klasser som låga buskar och trädkronor kan framstå som förvillande lika. Bilder kan vara suddiga, delvis dolda av skuggor eller moln, och variera från en region till en annan. Traditionella regelbaserade metoder och tidigare maskininlärningssystem har svårt att hantera denna variation, och även moderna djupa nätverk kräver ofta stora märkta dataset och kraftfull hårdvara, vilket begränsar deras användning på satelliter, obemannade luftfarkoster och edge-enheter.

Anpassa en generell visionsmodell till fjärranalys

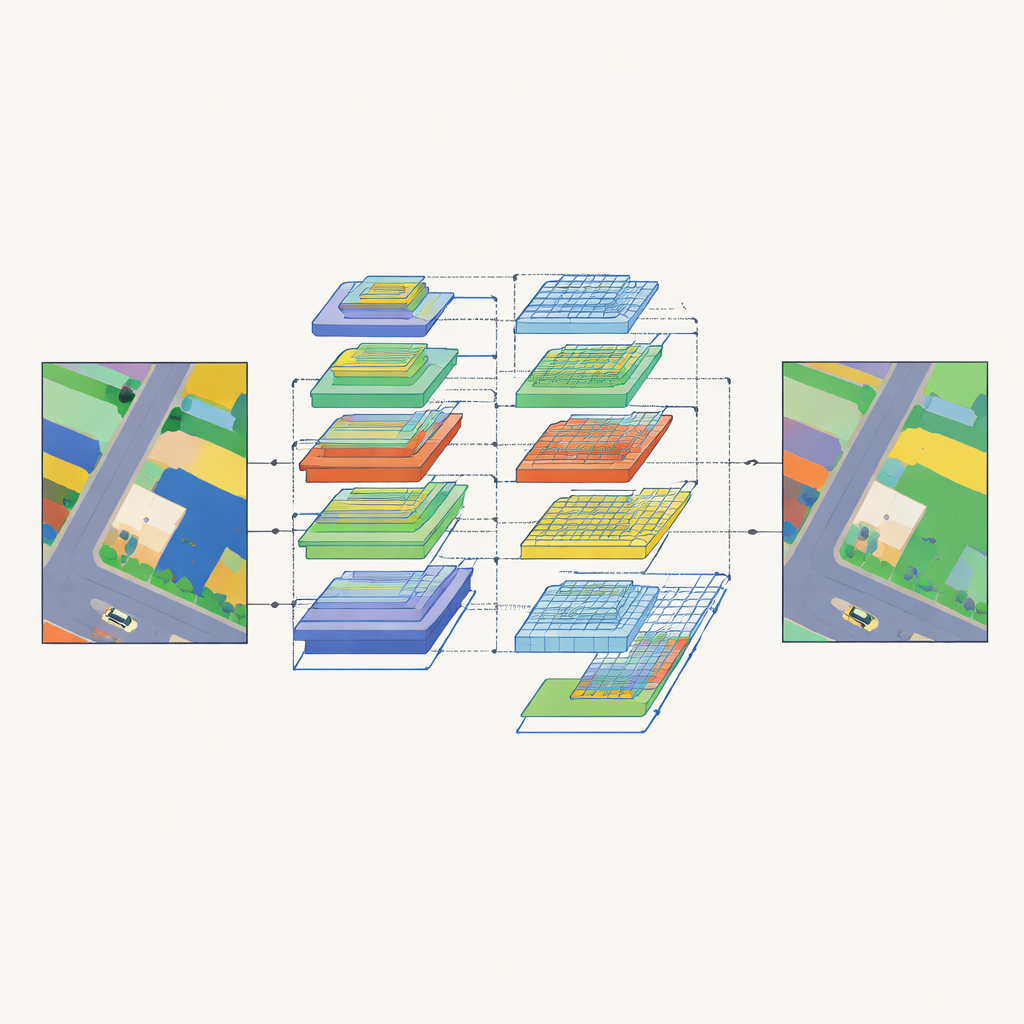

Nyare ”foundation”-modeller för vision, tränade på enorma samlingar av vardagsbilder, har visat en imponerande förmåga att segmentera nästan vad som helst i en bild. En av de starkaste är Segment Anything Model 2 (SAM2), som kan rita objektkonturer utan att i förväg få veta vad dessa objekt är. SAM2 är dock anpassad för naturliga bilder och producerar klass-agnostiska regioner, vilket gör den mindre lämpad för fjärranalysuppgifter där varje pixel måste tilldelas en specifik markskapsklass. Författarna utformar därför SAM2-ARAFNet, som behåller SAM2:s kraftfulla encoder fryst och lägger till lätta adaptermoduler som varsamt justerar dess interna representationer för att matcha det unika utseendet i flyg- och satellitscener. Detta undviker omträning av den enorma backbone från grunden samtidigt som modellen anpassas till fjärranalysdomänen.

Se helheten och de fina detaljerna samtidigt

För att omvandla kodade funktioner till fullständiga markskapskartor använder SAM2-ARAFNet en särskilt utformad decoder som kombinerar information över många skalor. På lägre nivåer bevaras skarpa kanter och små objekt genom att tidiga feature-kartor fusas via flera grenar och en uppmärksamhetsmodul som framhäver informativa mönster och undertrycker brus. På högre nivåer introduceras en uppmärksamhetsförstärkt residualmodul som sprider sitt ”receptiva fält” över allt större närliggande områden, vilket hjälper nätverket att förstå bredare kontext, till exempel hur byggnader, vägar och vegetation förhåller sig till varandra. En bilateral fusionsblock förenar därefter låg-nivådetaljer och hög-nivåbetydelse så att till exempel bilkonturer förblir skarpa samtidigt som de korrekt särskiljs från närliggande tak eller asfalt.

Lära ett mindre nätverk att efterlikna ett större

Medan hela SAM2-ARAFNet-modellen levererar hög noggrannhet gör dess storlek den ändå tung för ombordinstallation. För att lösa detta tränar författarna ett kompakt ”student”-nätverk, byggt på EfficientNet-b0-backbone, för att efterlikna prediktionerna från den stora ”teacher”-modellen. Istället för att bara kopiera slutliga etiketter lär sig studenten från lärarens rikare utdata, och fångar hur olika klasser relaterar till varandra och hur pixlar inom samma klass beter sig över scenen. Denna kunskapsdestillationsprocess minskar antalet parametrar med cirka 97 procent — från ungefär 223 miljoner till 6,7 miljoner — samtidigt som den bevarar mer än 99 procent av lärarens noggrannhet i övergripande termer. Resultatet är en mycket lättare modell som fortfarande producerar högkvalitativa segmenteringar lämpliga för drönare och andra edge-plattformar.

Hur väl fungerar det i verkliga städer?

Teamet utvärderar både lärare- och studentmodellerna på två vida använda benchmarks för urbana flygbilder: ISPRS Vaihingen och Potsdam-datamängderna. Jämfört med ett brett spektrum av starka konkurrenter baserade på konvolutionsnätverk, Transformatorer och hybriddesigner uppnår SAM2-ARAFNet konsekvent högre poäng på standardmått för segmenteringskvalitet. Den är särskilt effektiv när det gäller att hantera svåra situationer som fordon delvis dolda av byggnader, eller de subtila övergångarna mellan lågvuxen vegetation, träd och skräp runt byggnadsfasader. Visuella jämförelser visar att dess utsignaler har renare objektgränser och färre felklassificerade fläckar, vilket understryker fördelarna med dess flerskaliga uppmärksamhets- och fusionsdesign.

Smartare kartor för en resursbegränsad värld

I praktiska termer visar detta arbete hur en kraftfull men otymplig visionsmodell kan anpassas och göras slankare för att skapa precisa, effektiva kartor från flygbilder. Genom att återanvända SAM2:s starka encoder, noggrant utforma flerskaliga uppmärksamhetsmoduler och sedan destillera denna kunskap till en lättviktsstudent levererar SAM2-ARAFNet detaljerade urbana markskapskartor med avsevärt lägre beräkningskostnad. Denna balans mellan noggrannhet och effektivitet gör den till ett lovande verktyg för miljöövervakning, katastrofbedömning och stadsförvaltning direkt på satelliter, drönare eller andra enheter som inte kan förlita sig på ständig molnuppkoppling.

Citering: Shi, W., Ding, J., Lei, J. et al. SAM2-ARAFNet: adapting SAM2 with an attention-enhanced residual ASPP fusion network for high-resolution remote sensing semantic segmentation. Sci Rep 16, 10225 (2026). https://doi.org/10.1038/s41598-026-38047-z

Nyckelord: fjärranalys, semantisk segmentering, satellitbilder, djuplärande, kunskapsdestillation