Clear Sky Science · ru

SAM2-ARAFNet: адаптация SAM2 с сетью ASPP‑смешения с остаточными и вниманиями для семантической сегментации высокоразрешённого дистанционного зондирования

Более острый взгляд на меняющуюся планету

От учёта последствий штормов до помощи в градостроительном планировании — аэро- и спутниковые снимки стали одним из мощнейших инструментов для понимания мира. Но превращать эти детальные изображения в чёткие карты зданий, дорог, деревьев и автомобилей по‑прежнему непросто, особенно когда вычисления должны выполняться быстро на дронах или малых устройствах. В этой статье представлена система SAM2‑ARAFNet, которая опирается на мощную модель зрения и аккуратно её упрощает, стремясь давать высокоточную разметку земной поверхности по высокоразрешённым снимкам при значительно меньших вычислительных затратах по сравнению с современными ведущими методами.

Почему картографирование городов сверху так сложно

Высокоразрешённые аэрофотоснимки фиксируют города с выдающейся детализацией: видны отдельные дома, кроны деревьев, припаркованные машины и даже узкие тротуары. Но такое богатство деталей создаёт и уникальные трудности. Поверхности одного класса, например разные типы покрытий, могут выглядеть очень по‑разному, в то время как разные классы, например низкие кусты и кроны деревьев, могут визуально сбивать с толку. Снимки могут быть размытыми, частично закрыты тенями или облаками и сильно различаться между регионами. Традиционные правило‑ориентированные методы и ранние алгоритмы машинного обучения плохо справляются с этой вариативностью, а даже современные глубокие сети часто требуют больших размеченных наборов данных и мощного оборудования, что ограничивает их применение на спутниках, БПЛА и периферийных устройствах.

Адаптация общей модели зрения к задачам ДЗЗ

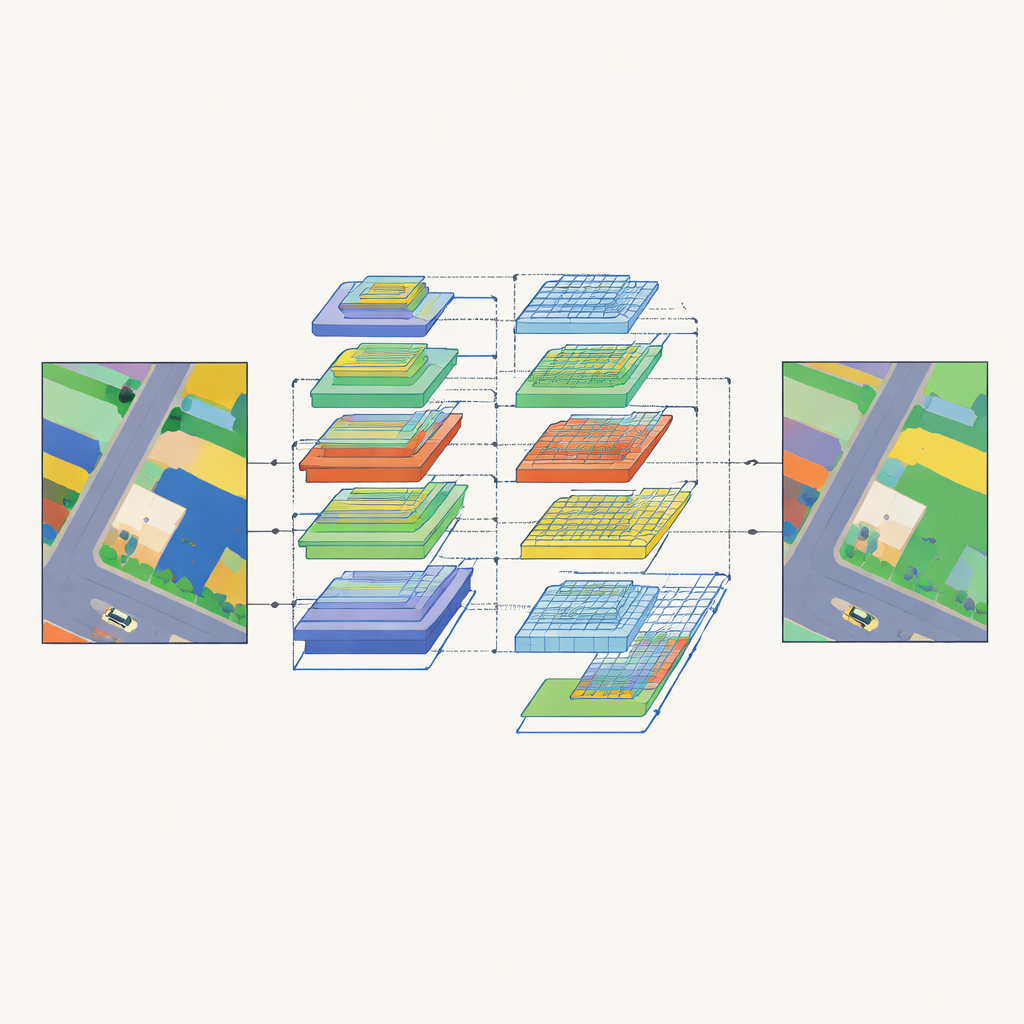

Недавние «фундаментальные» модели зрения, обученные на огромных коллекциях повседневных фотографий, продемонстрировали впечатляющую способность сегментировать практически любые объекты на изображении. Одна из сильнейших таких моделей — Segment Anything Model 2 (SAM2), которая умеет выделять контуры объектов без предварительного указания их классов. Однако SAM2 настроен на натуралистичные фото и выдаёт классо‑независимые регионы, что делает её менее пригодной для задач ДЗЗ, где требуется присвоить каждому пикселю конкретную метку покрытия поверхности. Авторы поэтому разработали SAM2‑ARAFNet: они сохраняют мощный энкодер SAM2 замороженным и добавляют лёгкие адаптеры, которые мягко корректируют его внутренние представления под особенности аэрофотосъёмки. Это позволяет избежать дообучения огромного бэкбона с нуля, при этом подогнав модель под домен дистанционного зондирования.

Одновременное видение общей картины и мелких деталей

Чтобы превратить закодированные признаки в полные карты покровов, SAM2‑ARAFNet использует специально разработанный декодер, объединяющий информацию на многих масштабах. На низких уровнях он сохраняет резкие границы и мелкие объекты, сливая ранние карты признаков через несколько ветвей и модуль внимания, который усиливает информативные шаблоны и подавляет шум. На более высоких уровнях вводится остаточный модуль с усиленным вниманием, который расширяет «рецептивное поле» на всё большие окрестности, помогая сети учитывать более широкий контекст — например взаимосвязь зданий, дорог и растительности. Билатеральный блок слияния затем объединяет мелкоуровневые детали и высокоуровневое значение, так что, например, контуры автомобилей остаются чёткими и одновременно правильно отделяются от близлежащих крыш или асфальта.

Обучение компактной сети подражать большой

Хотя полная модель SAM2‑ARAFNet демонстрирует высокую точность, её размер всё ещё делает её тяжёлой для размещения на борту. Чтобы решить эту проблему, авторы обучают компактную «студенческую» сеть на базе EfficientNet‑b0, чтобы она имитировала предсказания большой «учительской» модели. Вместо копирования только финальных меток, студент учится по более богатым выходным паттернам учителя, улавливая взаимосвязи между классами и поведение пикселей внутри одного класса по всей сцене. Этот процесс дистилляции знаний уменьшает число параметров примерно на 97 % — с примерно 223 миллионов до 6,7 миллиона — при сохранении более 99 % от общей точности учителя. В результате получается значительно более лёгкая модель, всё ещё дающая высококачественные сегментации, пригодные для дронов и других периферийных платформ.

Насколько хорошо это работает в реальных городах?

Команда оценивает и учительскую, и студенческую модели на двух широко используемых бенчмарках городских аэроизображений: наборах данных ISPRS Vaihingen и Potsdam. По сравнению с широким кругом сильных конкурентов на базе свёрточных сетей, трансформеров и гибридных архитектур, SAM2‑ARAFNet стабильно показывает более высокие результаты по стандартным метрикам качества сегментации. Она особенно эффективно справляется со сложными ситуациями, такими как части машин, скрытые зданиями, или тонкие переходы между низкой растительностью, деревьями и захламлёнными участками у фасадов. Визуальные сравнения показывают, что её выходы имеют более чистые границы объектов и меньше ошибочно классифицированных участков, что подчёркивает преимущества мульти‑масштабных модулей внимания и слияния.

Умнее карты для мира с ограниченными ресурсами

Говоря простыми словами, эта работа демонстрирует, как мощную, но громоздкую модель зрения можно адаптировать и «похудеть», чтобы получать точные и эффективные карты по аэроизображениям. Повторно используя сильный энкодер SAM2, продуманно проектируя мульти‑масштабные модули внимания и затем дистиллируя полученные знания в лёгкую модель‑студент, SAM2‑ARAFNet даёт подробные городские карты покровов при существенно меньших вычислительных затратах. Такое сочетание точности и эффективности делает её перспективным инструментом для экологического мониторинга, оценки последствий бедствий и управления городом непосредственно на спутниках, дронах или других устройствах, которые не могут полагаться на постоянное подключение к облаку.

Цитирование: Shi, W., Ding, J., Lei, J. et al. SAM2-ARAFNet: adapting SAM2 with an attention-enhanced residual ASPP fusion network for high-resolution remote sensing semantic segmentation. Sci Rep 16, 10225 (2026). https://doi.org/10.1038/s41598-026-38047-z

Ключевые слова: дистанционное зондирование, семантическая сегментация, спутниковые изображения, глубокое обучение, перенос знаний