Clear Sky Science · pt

SAM2-ARAFNet: adaptando o SAM2 com uma rede de fusão ASPP residual aprimorada por atenção para segmentação semântica de sensoriamento remoto em alta resolução

Olhos mais nítidos sobre nosso planeta em mudança

Do monitoramento de danos causados por tempestades ao planejamento urbano, imagens aéreas e de satélite tornaram-se uma das ferramentas mais poderosas da humanidade para entender o mundo. Mas transformar essas imagens detalhadas em mapas claros de prédios, ruas, árvores e carros ainda é surpreendentemente difícil, especialmente quando os computadores precisam operar rapidamente em drones ou dispositivos pequenos. Este artigo apresenta o SAM2-ARAFNet, um novo sistema de mapeamento que se baseia em um modelo de visão poderoso e o reduz com cuidado, com o objetivo de fornecer mapas de cobertura do solo altamente precisos a partir de imagens de alta resolução, usando muito menos poder computacional do que os métodos líderes atuais.

Por que mapear cidades a partir do alto é tão difícil

Fotos aéreas em alta resolução capturam as cidades com detalhes notáveis: casas individuais, copas de árvores, carros estacionados e até calçadas estreitas ficam visíveis. Ainda assim, essa riqueza traz desafios. Superfícies que pertencem à mesma categoria, como diferentes tipos de pavimento, podem parecer muito diferentes, enquanto classes distintas como arbustos baixos e copas de árvores podem aparentar uma semelhança confusa. As imagens podem estar borradas, parcialmente ocultas por sombras ou nuvens, e variar de uma região para outra. Abordagens tradicionais baseadas em regras e sistemas de aprendizado de máquina anteriores têm dificuldade em lidar com essa variedade, e mesmo redes profundas modernas frequentemente exigem grandes conjuntos de dados rotulados e hardware potente, limitando seu uso em satélites, veículos aéreos não tripulados e dispositivos de borda.

Adaptando um modelo de visão geral para sensoriamento remoto

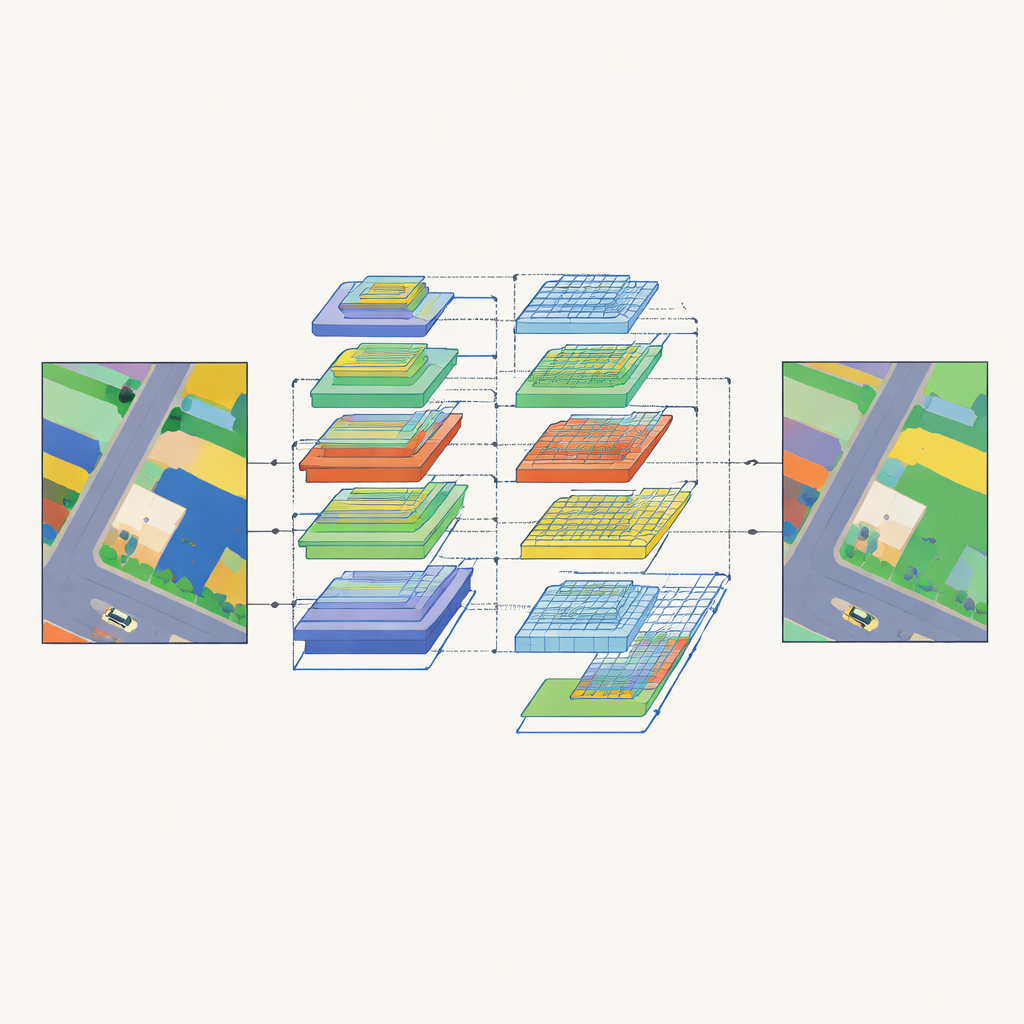

Modelos fundamentais recentes para visão, treinados em coleções massivas de fotos do cotidiano, mostraram uma habilidade impressionante de segmentar quase qualquer coisa em uma imagem. Um dos mais potentes é o Segment Anything Model 2 (SAM2), que pode traçar contornos de objetos sem saber previamente quais são esses objetos. No entanto, o SAM2 é ajustado para imagens naturais e produz regiões agnósticas a classes, tornando‑o menos adequado para tarefas de sensoriamento remoto que precisam atribuir um rótulo específico de cobertura do solo a cada pixel. Os autores, portanto, projetam o SAM2-ARAFNet, que mantém o encoder poderoso do SAM2 congelado e adiciona módulos adaptadores leves que ajustam de forma sutil suas representações internas para corresponder ao aspecto único das cenas aéreas. Isso evita re-treinar a enorme espinha dorsal do zero, ao mesmo tempo em que a adapta ao domínio do sensoriamento remoto.

Ver o panorama e os detalhes finos ao mesmo tempo

Para transformar características codificadas em mapas completos de cobertura do solo, o SAM2-ARAFNet usa um decodificador especialmente elaborado que combina informação em muitas escalas. Em níveis mais baixos, preserva bordas nítidas e objetos pequenos fundindo mapas de características iniciais por meio de múltiplos ramos e um módulo de atenção que enfatiza padrões informativos e suprime ruído. Em níveis mais altos, introduz um módulo residual aprimorado por atenção que amplia seu “campo receptivo” sobre vizinhanças cada vez maiores, ajudando a rede a entender contextos mais amplos, como a relação entre prédios, ruas e vegetação. Um bloco de fusão bilateral então reúne detalhe de baixo nível e significado de alto nível para que, por exemplo, os contornos de carros permaneçam nítidos enquanto são corretamente diferenciados de telhados próximos ou do asfalto.

Ensinando uma rede menor a imitar uma maior

Embora o modelo completo SAM2-ARAFNet ofereça alta precisão, seu tamanho ainda o torna pesado para implantação embarcada. Para resolver isso, os autores treinam uma rede compacta “aluna”, construída sobre a espinha dorsal EfficientNet-b0, para imitar as predições do grande modelo “professor”. Em vez de copiar apenas os rótulos finais, a aluna aprende a partir dos padrões de saída mais ricos do professor, capturando como diferentes classes se relacionam entre si e como pixels dentro da mesma classe se comportam pela cena. Esse processo de destilação de conhecimento reduz a contagem de parâmetros em cerca de 97% — de aproximadamente 223 milhões para 6,7 milhões — preservando mais de 99% da acurácia geral do professor. O resultado é um modelo muito mais leve que ainda produz segmentações de alta qualidade adequadas para drones e outras plataformas de borda.

Quão bem isso funciona em cidades reais?

A equipe avalia tanto os modelos professor quanto aluna em dois benchmarks amplamente usados de imagens aéreas urbanas: os conjuntos de dados ISPRS Vaihingen e Potsdam. Em comparação com uma ampla gama de concorrentes fortes baseados em redes convolucionais, Transformers e designs híbridos, o SAM2-ARAFNet alcança pontuações consistentemente maiores em medidas padrão de qualidade de segmentação. É particularmente eficaz ao lidar com situações complicadas, como veículos parcialmente ocultos por edifícios ou as transições sutis entre vegetação baixa, árvores e entulho próximo às fachadas. Comparações visuais mostram que suas saídas têm contornos de objetos mais limpos e menos regiões mal classificadas, destacando os benefícios de seu projeto de atenção e fusão multi‑escala.

Mapas mais inteligentes para um mundo com recursos limitados

Em termos práticos, este trabalho mostra como um modelo de visão poderoso, porém volumoso, pode ser adaptado e enxugado para criar mapas precisos e eficientes a partir de imagens aéreas. Reutilizando o forte encoder do SAM2, projetando cuidadosamente módulos de atenção multi‑escala e depois destilando esse conhecimento em uma aluna leve, o SAM2-ARAFNet entrega mapas urbanos detalhados de cobertura do solo com muito menos custo computacional. Esse equilíbrio entre precisão e eficiência o torna uma ferramenta promissora para monitoramento ambiental, avaliação de desastres e gestão urbana diretamente em satélites, drones ou outros dispositivos que não podem depender de conexão constante com a nuvem.

Citação: Shi, W., Ding, J., Lei, J. et al. SAM2-ARAFNet: adapting SAM2 with an attention-enhanced residual ASPP fusion network for high-resolution remote sensing semantic segmentation. Sci Rep 16, 10225 (2026). https://doi.org/10.1038/s41598-026-38047-z

Palavras-chave: sensoriamento remoto, segmentação semântica, imagens de satélite, aprendizado profundo, destilação de conhecimento