Clear Sky Science · de

SAM2-ARAFNet: Anpassung von SAM2 mit einem auf Aufmerksamkeit erweiterten residualen ASPP-Fusionsnetzwerk für hochauflösende semantische Segmentierung in der Fernerkundung

Scharfere Augen für unseren sich verändernden Planeten

Von der Erfassung von Sturmschäden bis zur Unterstützung der Stadtplanung sind Luft- und Satellitenbilder zu einem der wichtigsten Werkzeuge geworden, um die Welt zu verstehen. Aus diesen detaillierten Aufnahmen jedoch klare Karten von Gebäuden, Straßen, Bäumen und Autos zu erstellen, ist weiterhin überraschend schwierig — insbesondere wenn Computer schnell auf Drohnen oder kleinen Geräten arbeiten müssen. Dieses Papier stellt SAM2-ARAFNet vor, ein neues Kartierungssystem, das auf einem leistungsfähigen Vision-Modell aufbaut und dieses gezielt verschlankt, mit dem Ziel, hochgenaue Landbedeckungskarten aus hochauflösenden Bildern zu liefern und dabei deutlich weniger Rechenleistung zu benötigen als die derzeit führenden Methoden.

Warum die Kartierung von Städten aus der Luft so schwierig ist

Hochauflösende Luftaufnahmen erfassen Städte mit bemerkenswerter Detailtreue: einzelne Häuser, Baumkronen, parkende Autos und sogar schmale Gehwege sind sichtbar. Diese Fülle an Informationen bringt jedoch Herausforderungen mit sich. Flächen derselben Kategorie, wie verschiedene Belagsarten, können sehr unterschiedlich aussehen, während unterschiedliche Klassen wie niedrige Büsche und Baumkronen verwirrend ähnlich erscheinen können. Bilder können unscharf sein, durch Schatten oder Wolken teilweise verdeckt und regional stark variieren. Traditionelle regelbasierte Ansätze und frühere maschinelle Lernverfahren haben Schwierigkeiten, mit dieser Vielfalt umzugehen, und selbst moderne tiefe Netze benötigen häufig große beschriftete Datensätze und starke Hardware, was ihren Einsatz auf Satelliten, unbemannten Luftfahrzeugen und Edge-Geräten einschränkt.

Anpassung eines allgemeinen Vision-Modells an die Fernerkundung

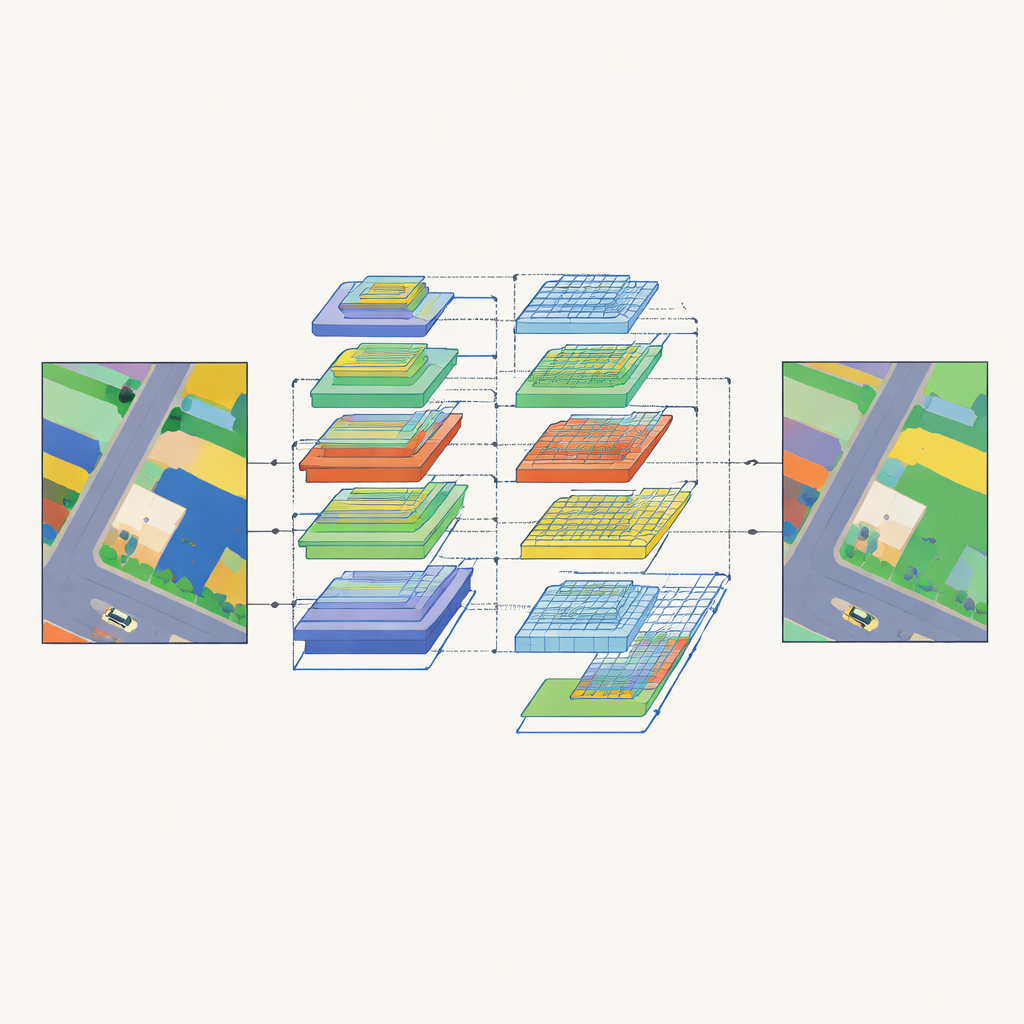

Jüngste „Foundation Models“ für die Bildverarbeitung, trainiert an riesigen Sammlungen alltäglicher Fotos, zeigen eine beeindruckende Fähigkeit, nahezu alles in einem Bild zu segmentieren. Eines der stärksten Modelle ist das Segment Anything Model 2 (SAM2), das Objektumrisse zeichnen kann, ohne vorher zu wissen, welche Objekte vorhanden sind. SAM2 ist jedoch auf natürliche Bilder abgestimmt und liefert klassenagnostische Regionen, weshalb es sich weniger gut für Fernerkundungsaufgaben eignet, bei denen jedem Pixel ein konkretes Landbedeckungsetikett zugewiesen werden muss. Die Autoren entwerfen daher SAM2-ARAFNet, das SAM2s leistungsfähigen Encoder einfriert und leichte Adaptermodule hinzufügt, die seine internen Repräsentationen behutsam an das spezifische Erscheinungsbild Luftaufnahmen anpassen. Das vermeidet ein vollständiges Retraining des großen Backbones und passt ihn trotzdem an die Domäne Fernerkundung an.

Großes Gesamtbild und feine Details zugleich erfassen

Um die kodierten Merkmale in vollständige Landbedeckungskarten zu überführen, verwendet SAM2-ARAFNet einen speziell entwickelten Decoder, der Informationen über viele Skalen hinweg kombiniert. Auf niedrigen Ebenen bewahrt er scharfe Kanten und kleine Objekte, indem frühe Feature-Maps über mehrere Zweige und ein Aufmerksamkeitsmodul verschmolzen werden, das informative Muster betont und Rauschen unterdrückt. Auf höheren Ebenen führt er ein auf Aufmerksamkeit erweitertes Residualmodul ein, das sein „empfangendes Feld“ über immer größere Nachbarschaften verteilt und dem Netzwerk hilft, breiteren Kontext zu verstehen — etwa wie Gebäude, Straßen und Vegetation zueinander in Beziehung stehen. Ein bilateraler Fusionsblock bringt dann niedrigstufige Details und hochstufige Bedeutung zusammen, sodass beispielsweise Autokonturen scharf bleiben und zugleich korrekt von nahen Dächern oder Asphaltflächen unterschieden werden.

Einem kleineren Netzwerk beibringen, ein größeres zu imitieren

Während das vollständige SAM2-ARAFNet-Modell hohe Genauigkeit liefert, macht seine Größe den Einsatz an Bord dennoch schwer. Um dem zu begegnen, trainieren die Autoren ein kompaktes „Student“-Netzwerk, aufgebaut auf dem EfficientNet-b0-Backbone, um die Vorhersagen des großen „Teacher“-Modells nachzuahmen. Anstatt nur die finalen Labels zu kopieren, lernt der Student aus den reichhaltigeren Ausgaben des Lehrermodells und erfasst, wie Klassen zueinander stehen und wie sich Pixel derselben Klasse über die Szene hinweg verhalten. Dieser Knowledge-Distillation-Prozess reduziert die Parameterzahl um etwa 97 Prozent — von rund 223 Millionen auf 6,7 Millionen — und bewahrt dabei mehr als 99 Prozent der Gesamtgenauigkeit des Lehrermodells. Das Ergebnis ist ein deutlich leichteres Modell, das dennoch hochwertige Segmentierungen liefert, geeignet für Drohnen und andere Edge-Plattformen.

Wie gut funktioniert es in realen Städten?

Das Team bewertet sowohl Lehrer- als auch Studentmodelle an zwei weithin genutzten Benchmarks für städtische Luftbilddaten: den ISPRS-Datensätzen Vaihingen und Potsdam. Verglichen mit einer breiten Palette starker Konkurrenten auf Basis von Faltungsnetzwerken, Transformern und Hybridarchitekturen erreicht SAM2-ARAFNet durchgängig höhere Werte bei gängigen Metriken zur Segmentierungsqualität. Es ist besonders wirkungsvoll bei schwierigen Situationen wie Fahrzeugen, die teilweise von Gebäuden verdeckt sind, oder den subtilen Übergängen zwischen niedriger Vegetation, Bäumen und Unrat an Gebäudefassaden. Visuelle Vergleiche zeigen sauberere Objektgrenzen und weniger fehlklassifizierte Bereiche, was die Vorteile seines Multi-Skalen-Aufmerksamkeits- und Fusionsdesigns unterstreicht.

Intelligentere Karten für eine ressourcenbegrenzte Welt

Fachlich zusammengefasst zeigt diese Arbeit, wie ein leistungsfähiges, aber sperriges Vision-Modell adaptiert und verschlankt werden kann, um aus Luftbildern genaue und effiziente Karten zu erstellen. Durch die Wiederverwendung von SAM2s starkem Encoder, das gezielte Design von Multi-Skalen-Aufmerksamkeitsmodulen und die anschließende Destillation dieses Wissens in einen leichten Studenten liefert SAM2-ARAFNet detaillierte städtische Landbedeckungskarten bei deutlich geringerem Rechenaufwand. Diese Verbindung aus Präzision und Effizienz macht es zu einem vielversprechenden Werkzeug für Umweltüberwachung, Schadensbewertung und Stadtmanagement direkt auf Satelliten, Drohnen oder anderen Geräten, die nicht durchgängig auf eine Cloud-Verbindung angewiesen sein können.

Zitation: Shi, W., Ding, J., Lei, J. et al. SAM2-ARAFNet: adapting SAM2 with an attention-enhanced residual ASPP fusion network for high-resolution remote sensing semantic segmentation. Sci Rep 16, 10225 (2026). https://doi.org/10.1038/s41598-026-38047-z

Schlüsselwörter: Fernerkundung, semantische Segmentierung, Satellitenbilder, Deep Learning, Knowledge Distillation