Clear Sky Science · es

SAM2-ARAFNet: adaptando SAM2 con una red de fusión ASPP residual mejorada con atención para la segmentación semántica de teledetección en alta resolución

Una visión más nítida de nuestro planeta cambiante

Desde el seguimiento de daños por tormentas hasta la orientación en la planificación urbana, las imágenes aéreas y satelitales se han convertido en una de las herramientas más poderosas para comprender el mundo. Pero convertir estas imágenes detalladas en mapas claros de edificios, carreteras, árboles y coches sigue siendo sorprendentemente difícil, sobre todo cuando los sistemas deben funcionar con rapidez en drones o dispositivos pequeños. Este artículo presenta SAM2-ARAFNet, un nuevo sistema de cartografiado que se apoya en un potente modelo de visión y lo adapta con cuidado, con el objetivo de ofrecer mapas de cobertura del suelo altamente precisos a partir de imágenes de alta resolución mientras emplea mucha menos potencia de cálculo que los métodos líderes actuales.

Por qué es tan difícil cartografiar las ciudades desde el aire

Las fotos aéreas de alta resolución capturan las ciudades con un detalle notable: viviendas individuales, copas de árboles, coches estacionados e incluso aceras estrechas son visibles. Sin embargo, esta riqueza presenta desafíos. Superficies que pertenecen a la misma categoría, como distintos tipos de pavimento, pueden parecer muy diferentes, mientras que clases distintas como arbustos bajos y copas arbóreas pueden resultar confusas y similares en apariencia. Las imágenes pueden estar desenfocadas, parcialmente ocultas por sombras o nubes, y variar de una región a otra. Los enfoques tradicionales basados en reglas y los primeros sistemas de aprendizaje automático tienen dificultades para afrontar esta variedad, e incluso las redes profundas modernas suelen necesitar grandes conjuntos de datos etiquetados y hardware potente, lo que limita su uso en satélites, vehículos aéreos no tripulados y dispositivos de borde.

Adaptando un modelo de visión general a la teledetección

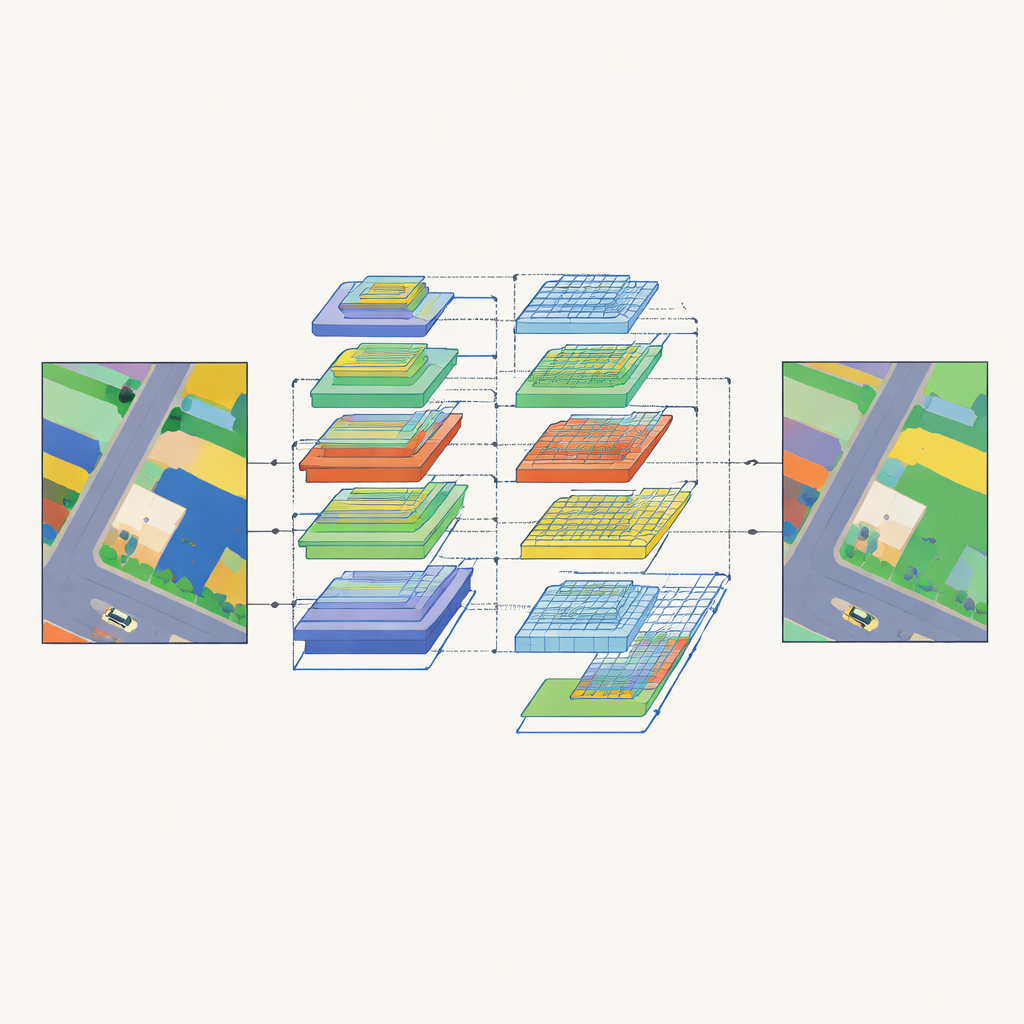

Los recientes “modelos fundacionales” para visión, entrenados con colecciones masivas de fotos cotidianas, han demostrado una notable capacidad para segmentar casi cualquier cosa en una imagen. Uno de los más potentes es Segment Anything Model 2 (SAM2), que puede trazar contornos de objetos sin que se le diga de antemano qué son esos objetos. Sin embargo, SAM2 está ajustado a imágenes naturales y produce regiones agnósticas a la clase, por lo que resulta menos adecuado para tareas de teledetección que deben asignar una etiqueta de cobertura del suelo específica a cada píxel. Por ello, los autores diseñan SAM2-ARAFNet, que mantiene el codificador potente de SAM2 congelado y añade módulos adaptadores ligeros que ajustan suavemente sus representaciones internas para coincidir con el aspecto particular de las escenas aéreas. Esto evita volver a entrenar la enorme columna vertebral desde cero mientras sigue adaptándolo al dominio de la teledetección.

Ver el panorama general y los detalles finos a la vez

Para convertir las características codificadas en mapas completos de cobertura del suelo, SAM2-ARAFNet utiliza un decodificador especialmente diseñado que combina información a través de múltiples escalas. En niveles bajos, preserva bordes nítidos y objetos pequeños fusionando mapas de características tempranas mediante varias ramas y un módulo de atención que enfatiza patrones informativos y suprime el ruido. En niveles altos, introduce un módulo residual mejorado con atención que expande su “campo receptivo” sobre vecindarios cada vez mayores, ayudando a la red a comprender un contexto más amplio, como las relaciones entre edificios, carreteras y vegetación. Un bloque de fusión bilateral reúne entonces el detalle de bajo nivel y el significado de alto nivel para que, por ejemplo, los contornos de los coches permanezcan nítidos y a la vez se distingan correctamente de tejados o asfalto cercanos.

Enseñar a una red más pequeña a imitar a una más grande

Si bien el modelo completo SAM2-ARAFNet ofrece una alta precisión, su tamaño lo hace pesado para despliegues a bordo. Para abordar esto, los autores entrenan una red “estudiante” compacta, basada en la columna vertebral EfficientNet-b0, para imitar las predicciones del gran modelo “profesor”. En lugar de copiar solo las etiquetas finales, la estudiante aprende a partir de los patrones de salida más ricos del profesor, capturando cómo se relacionan las distintas clases y cómo se comportan los píxeles dentro de la misma clase a lo largo de la escena. Este proceso de destilación de conocimiento reduce el número de parámetros en alrededor de un 97 por ciento —de aproximadamente 223 millones a 6,7 millones— mientras preserva más del 99 por ciento de la precisión global del profesor. El resultado es un modelo mucho más ligero que aún produce segmentaciones de alta calidad adecuadas para drones y otras plataformas de borde.

¿Qué tal funciona en ciudades reales?

El equipo evalúa tanto los modelos profesor como estudiante en dos bancos de prueba ampliamente usados de imágenes aéreas urbanas: los conjuntos de datos ISPRS Vaihingen y Potsdam. En comparación con una amplia gama de competidores fuertes basados en redes convolucionales, Transformers y diseños híbridos, SAM2-ARAFNet alcanza puntuaciones consistentemente más altas en medidas estándar de calidad de segmentación. Resulta especialmente eficaz en situaciones complejas como vehículos parcialmente ocultos por edificios, o las transiciones sutiles entre vegetación baja, árboles y el desorden alrededor de fachadas. Las comparaciones visuales muestran que sus salidas tienen límites de objetos más limpios y menos zonas mal clasificadas, subrayando los beneficios de su diseño de atención y fusión multiescala.

Mapas más inteligentes para un mundo con recursos limitados

En términos prácticos, este trabajo demuestra cómo un modelo de visión potente pero voluminoso puede adaptarse y reducirse para crear mapas precisos y eficientes a partir de imágenes aéreas. Al reutilizar el sólido codificador de SAM2, diseñar cuidadosamente módulos de atención multiescala y luego destilar ese conocimiento en una estudiante ligera, SAM2-ARAFNet ofrece mapas urbanos detallados de cobertura del suelo con un coste computacional mucho menor. Este equilibrio entre precisión y eficiencia lo convierte en una herramienta prometedora para el monitoreo ambiental, la evaluación de desastres y la gestión urbana directamente en satélites, drones u otros dispositivos que no pueden depender de una conexión constante a la nube.

Cita: Shi, W., Ding, J., Lei, J. et al. SAM2-ARAFNet: adapting SAM2 with an attention-enhanced residual ASPP fusion network for high-resolution remote sensing semantic segmentation. Sci Rep 16, 10225 (2026). https://doi.org/10.1038/s41598-026-38047-z

Palabras clave: teledetección, segmentación semántica, imágenes satelitales, aprendizaje profundo, destilación de conocimiento