Clear Sky Science · it

SAM2-ARAFNet: adattare SAM2 con una rete di fusione ASPP residua potenziata con attenzione per la segmentazione semantica di telerilevamento ad alta risoluzione

Sguardi più nitidi sul nostro pianeta in cambiamento

Dal monitoraggio dei danni causati dalle tempeste all'orientamento della pianificazione urbana, le immagini aeree e satellitari sono diventate uno degli strumenti più potenti dell'umanità per comprendere il mondo. Però trasformare queste immagini dettagliate in mappe chiare di edifici, strade, alberi e automobili rimane sorprendentemente difficile, soprattutto quando i calcoli devono essere eseguiti rapidamente su droni o dispositivi di piccole dimensioni. Questo articolo presenta SAM2-ARAFNet, un nuovo sistema di mappatura che sfrutta un potente modello di visione e lo ridimensiona con cura, con l'obiettivo di ottenere mappe di copertura del suolo molto accurate da immagini ad alta risoluzione usando molta meno potenza di calcolo rispetto ai metodi leader odierni.

Perché mappare le città dall'alto è così difficile

Le foto aeree ad alta risoluzione catturano le città con dettagli straordinari: singole abitazioni, chiome degli alberi, automobili parcheggiate e persino marciapiedi stretti sono visibili. Tuttavia questa ricchezza comporta sfide. Superfici appartenenti alla stessa categoria, come diversi tipi di pavimentazione, possono apparire molto diversi, mentre classi distinte come cespugli bassi e chiome arboree possono sembrare confondibili. Le immagini possono essere sfocate, parzialmente nascoste da ombre o nuvole e variare da una regione all'altra. Gli approcci tradizionali basati su regole e i primi sistemi di machine learning faticano a gestire questa varietà, e anche le reti profonde moderne spesso richiedono grandi dataset etichettati e hardware potente, limitandone l'uso su satelliti, veicoli aerei senza pilota e dispositivi edge.

Adattare un modello di visione generale al telerilevamento

I recenti “foundation model” per la visione, addestrati su collezioni immense di foto di uso quotidiano, hanno dimostrato un'impressionante capacità di segmentare quasi qualsiasi cosa in un'immagine. Uno dei più potenti è il Segment Anything Model 2 (SAM2), che può tracciare contorni degli oggetti senza sapere in anticipo quali siano quegli oggetti. Tuttavia SAM2 è tarato su immagini naturali e produce regioni agnostiche rispetto alle classi, risultando meno adatto ai compiti di telerilevamento che devono assegnare un'etichetta di copertura del suolo specifica a ogni pixel. Gli autori perciò progettano SAM2-ARAFNet, che mantiene l'encoder potente di SAM2 congelato e aggiunge moduli adattatori leggeri che adeguano delicatamente le sue rappresentazioni interne all'aspetto unico delle scene aeree. Questo evita di rieducare da zero l'enorme backbone pur adattandolo al dominio del telerilevamento.

Vedere il quadro generale e i dettagli fini contemporaneamente

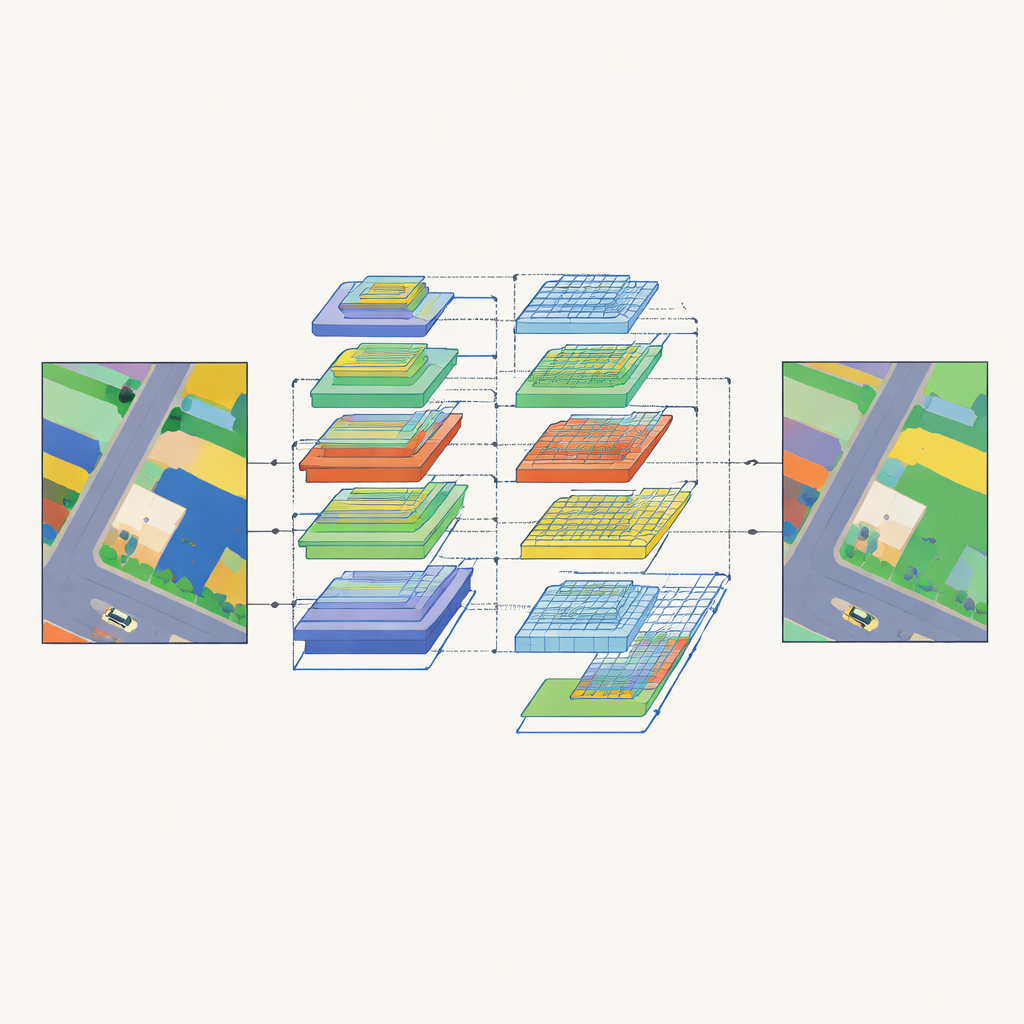

Per trasformare le caratteristiche codificate in mappe complete di copertura del suolo, SAM2-ARAFNet utilizza un decoder appositamente studiato che combina informazioni su molte scale. Ai livelli più bassi preserva bordi netti e oggetti piccoli fondendo mappe di caratteristiche precoci attraverso rami multipli e un modulo di attenzione che enfatizza pattern informativi e sopprime il rumore. Ai livelli più alti introduce un modulo residuo potenziato con attenzione che estende il suo “campo recettivo” su vicinanze progressivamente più ampie, aiutando la rete a comprendere il contesto esteso, ad esempio come edifici, strade e vegetazione si relazionano tra loro. Un blocco di fusione bilaterale poi riunisce dettaglio a basso livello e significato ad alto livello in modo che, per esempio, i contorni delle automobili restino nitidi pur venendo correttamente distinti da tetti o asfalto circostanti.

Insegnare a una rete più piccola a imitare una più grande

Benché il modello completo SAM2-ARAFNet offra un'elevata accuratezza, la sua dimensione lo rende comunque pesante per il deployment a bordo. Per affrontare questo problema, gli autori addestrano una rete compatta “student”, basata sul backbone EfficientNet-b0, per imitare le predizioni del grande modello “teacher”. Invece di copiare solo le etichette finali, lo student apprende dai pattern di output più ricchi del teacher, catturando come le diverse classi si relazionano tra loro e come i pixel appartenenti alla stessa classe si comportano nella scena. Questo processo di distillazione della conoscenza riduce il numero di parametri di circa il 97% — da circa 223 milioni a 6,7 milioni — preservando oltre il 99% dell'accuratezza complessiva del teacher. Il risultato è un modello molto più leggero che continua a produrre segmentazioni di alta qualità adatte a droni e altre piattaforme edge.

Quanto funziona bene nelle città reali?

Il team valuta sia i modelli teacher sia student su due benchmark ampiamente usati di immagini aeree urbane: i dataset ISPRS Vaihingen e Potsdam. Rispetto a un'ampia gamma di forti concorrenti basati su reti convoluzionali, Transformer e design ibridi, SAM2-ARAFNet raggiunge punteggi costantemente più alti nelle misure standard di qualità della segmentazione. È particolarmente efficace nel gestire situazioni difficili come veicoli parzialmente nascosti da edifici o le transizioni sottili tra vegetazione bassa, alberi e ingombri attorno alle facciate degli edifici. I confronti visivi mostrano che le sue uscite presentano confini degli oggetti più puliti e meno aree mal classificate, sottolineando i vantaggi del suo design a fusione e attenzione multi-scala.

Mappe più intelligenti per un mondo con risorse limitate

In termini pratici, questo lavoro mostra come un modello di visione potente ma ingombrante possa essere adattato e snellito per creare mappe accurate ed efficienti a partire da immagini aeree. Riutilizzando l'encoder robusto di SAM2, progettando con cura moduli di attenzione multi-scala e distillando poi questa conoscenza in uno student leggero, SAM2-ARAFNet produce mappe urbane dettagliate della copertura del suolo con un costo computazionale molto inferiore. Questo equilibrio tra precisione ed efficienza lo rende uno strumento promettente per il monitoraggio ambientale, la valutazione dei disastri e la gestione urbana direttamente su satelliti, droni o altri dispositivi che non possono fare affidamento su una connessione cloud continua.

Citazione: Shi, W., Ding, J., Lei, J. et al. SAM2-ARAFNet: adapting SAM2 with an attention-enhanced residual ASPP fusion network for high-resolution remote sensing semantic segmentation. Sci Rep 16, 10225 (2026). https://doi.org/10.1038/s41598-026-38047-z

Parole chiave: telerilevamento, segmentazione semantica, immagini satellitari, apprendimento profondo, distillazione della conoscenza