Clear Sky Science · nl

SAM2-ARAFNet: SAM2 aanpassen met een aandacht-versterkt residueel ASPP-fusienetwerk voor hoge-resolutie remote sensing semantische segmentatie

Scherpere blik op onze veranderende planeet

Van het volgen van stormschade tot het ondersteunen van stadsplanning: lucht- en satellietbeelden zijn een van de krachtigste instrumenten geworden om de wereld te doorgronden. Het omzetten van deze gedetailleerde beelden in heldere kaarten van gebouwen, wegen, bomen en auto’s blijft echter verrassend lastig — vooral wanneer computers snel moeten werken op drones of kleine apparaten. Dit artikel presenteert SAM2-ARAFNet, een nieuw kaartsysteem dat voortbouwt op een krachtig visiemodel en dit zorgvuldig versmalt, met als doel zeer nauwkeurige landbedekkingskaarten uit hoge-resolutiebeelden te leveren terwijl het veel minder rekenkracht gebruikt dan de huidige toonaangevende methoden.

Waarom steden van bovenaf zo moeilijk te kaarten zijn

Hoge-resolutie luchtfoto’s leggen steden in opmerkelijk detail vast: individuele huizen, boomkruinen, geparkeerde auto’s en zelfs smalle stoepen zijn zichtbaar. Maar deze rijkdom brengt uitdagingen met zich mee. Oppervlakken die tot dezelfde categorie behoren, zoals verschillende soorten verharding, kunnen er heel verschillend uitzien, terwijl verschillende klassen zoals lage struiken en boomkruinen verwarrend op elkaar kunnen lijken. Beelden kunnen wazig zijn, deels verborgen door schaduwen of wolken, en van regio tot regio variëren. Traditionele regelgebaseerde methoden en oudere machine-learningsystemen hebben moeite met deze variatie, en zelfs moderne diepe netwerken hebben vaak grote gelabelde datasets en krachtige hardware nodig, wat hun gebruik op satellieten, onbemande luchtvaartuigen en edge-apparaten beperkt.

Een algemeen visiemodel aanpassen voor remote sensing

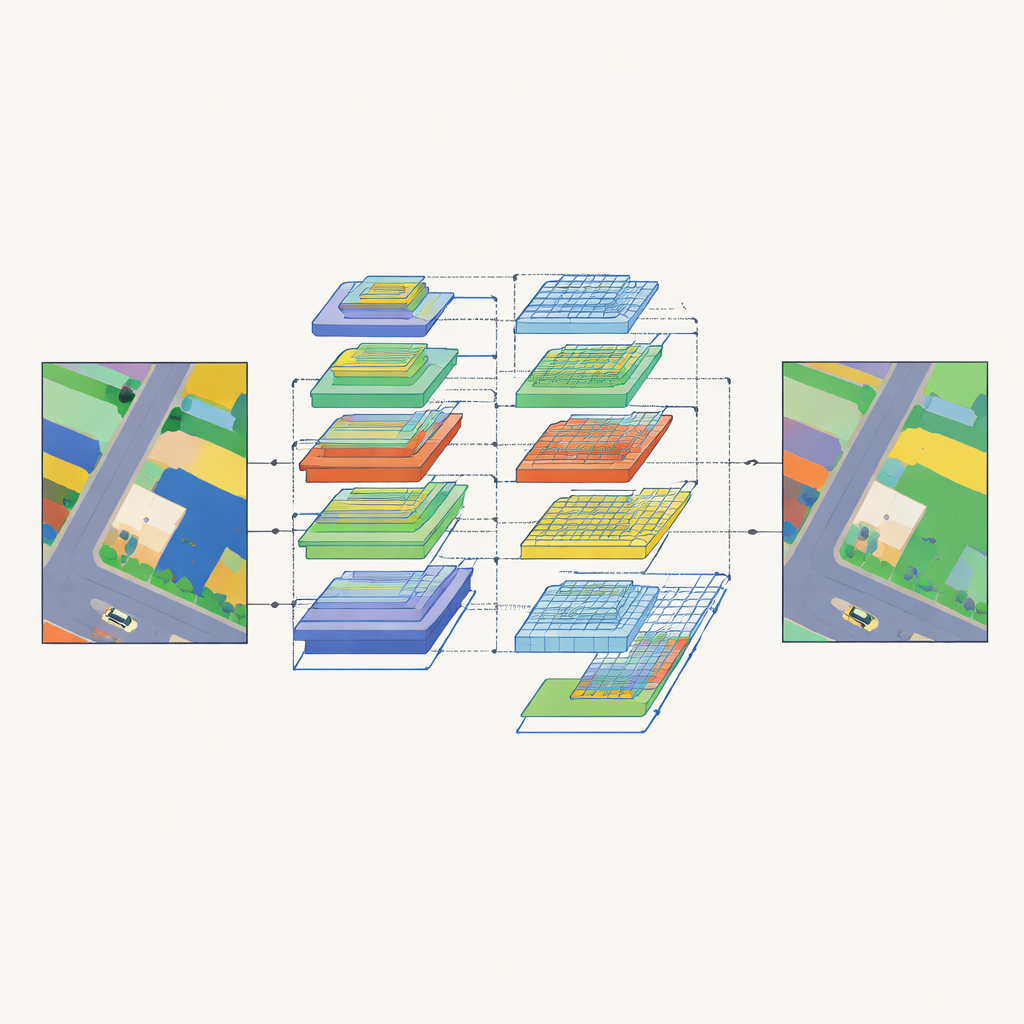

Recente “foundation models” voor visie, getraind op enorme verzamelingen alledaagse foto’s, tonen een indrukwekkend vermogen om vrijwel alles in een afbeelding te segmenteren. Een van de sterkste is Segment Anything Model 2 (SAM2), dat objectcontouren kan tekenen zonder vooraf te weten wat die objecten zijn. SAM2 is echter afgestemd op natuurlijke beelden en genereert klassenonafhankelijke regio’s, waardoor het minder geschikt is voor remote sensing-taken die elke pixel een specifieke landbedekkingslabel moeten toewijzen. De auteurs ontwerpen daarom SAM2-ARAFNet: ze laten SAM2’s krachtige encoder bevroren en voegen lichte adaptermodules toe die de interne representaties subtiel afstemmen op het unieke uiterlijk van luchtbeelden. Dit vermijdt het hertrainen van de enorme backbone vanaf nul terwijl het model toch wordt toegesneden op het remote sensing-domein.

Het grote geheel en de fijne details tegelijk zien

Om gecodeerde kenmerken om te zetten in volledige landbedekkingskaarten gebruikt SAM2-ARAFNet een speciaal samengestelde decoder die informatie over meerdere schalen combineert. Op lagere niveaus behoudt het scherpe randen en kleine objecten door vroege featuremaps via meerdere takken te fuseren en een attentiemodule te gebruiken die informatieve patronen benadrukt en ruis onderdrukt. Op hogere niveaus introduceert het een aandacht-versterkt residueel module die het ‘receptieve veld’ over steeds grotere buurten verspreidt, waardoor het netwerk een breder contextbegrip krijgt, bijvoorbeeld hoe gebouwen, wegen en vegetatie zich tot elkaar verhouden. Een bilaterale fusieblok brengt vervolgens laag-niveau detail en hoog-niveau betekenis samen, zodat bijvoorbeeld de omtrekken van auto’s scherp blijven terwijl ze correct worden onderscheiden van nabijgelegen daken of asfalt.

Een kleiner netwerk leren een groter netwerk na te bootsen

Hoewel het volledige SAM2-ARAFNet-model sterke nauwkeurigheid levert, maakt de grootte het nog steeds zwaar voor onboard-implementatie. Om dit aan te pakken trainen de auteurs een compact “student”-netwerk, gebaseerd op de EfficientNet-b0-backbone, om de voorspellingen van het grote “teacher”-model na te bootsen. In plaats van alleen de uiteindelijke labels te kopiëren, leert de student van de rijkere outputpatronen van de teacher, en legt zo vast hoe verschillende klassen zich tot elkaar verhouden en hoe pixels binnen dezelfde klasse zich over de scène gedragen. Dit kennisdistillatieproces verkleint het aantal parameters met ongeveer 97 procent — van ruwweg 223 miljoen naar 6,7 miljoen — terwijl het meer dan 99 procent van de nauwkeurigheid van de teacher in algemene termen behoudt. Het resultaat is een veel lichter model dat nog steeds segmentaties van hoge kwaliteit produceert, geschikt voor drones en andere edge-platforms.

Hoe goed werkt het in echte steden?

Het team evalueert zowel teacher- als studentmodellen op twee veelgebruikte benchmarks van stedelijke luchtbeelden: de ISPRS Vaihingen- en Potsdam-datasets. Vergeleken met een breed scala aan sterke concurrenten gebaseerd op convolutionele netwerken, transformers en hybride ontwerpen, behaalt SAM2-ARAFNet consistent hogere scores op gangbare maatstaven voor segmentatiekwaliteit. Het is bijzonder effectief in lastige situaties zoals voertuigen die gedeeltelijk door gebouwen worden verborgen, of de subtiele overgangen tussen lage vegetatie, bomen en rommel rond gevels. Visuele vergelijkingen tonen aan dat de output schonere objectgrenzen en minder fout geclassificeerde vlakken heeft, wat de voordelen van het multi-schaal aandacht- en fusieontwerp benadrukt.

Slimmere kaarten voor een middelenbeperkte wereld

In praktische zin laat dit werk zien hoe een krachtig maar omvangrijk visiemodel kan worden aangepast en uitgedund om nauwkeurige, efficiënte kaarten uit luchtbeelden te maken. Door SAM2’s sterke encoder te hergebruiken, multi-schaal attentiemodules zorgvuldig te ontwerpen en deze kennis vervolgens te distilleren naar een lichtgewicht student, levert SAM2-ARAFNet gedetailleerde stedelijke landbedekkingskaarten met veel minder rekenkosten. Deze balans tussen precisie en efficiëntie maakt het een veelbelovend hulpmiddel voor milieubewaking, schadebeoordeling en stadsbeheer direct op satellieten, drones of andere apparaten die niet op een constante cloudverbinding kunnen vertrouwen.

Bronvermelding: Shi, W., Ding, J., Lei, J. et al. SAM2-ARAFNet: adapting SAM2 with an attention-enhanced residual ASPP fusion network for high-resolution remote sensing semantic segmentation. Sci Rep 16, 10225 (2026). https://doi.org/10.1038/s41598-026-38047-z

Trefwoorden: remote sensing, semantische segmentatie, satellietbeelden, deep learning, kennisdistillatie