Clear Sky Science · sv

Inference i djupa neurala nätverk på en integrerad, omkonfigurerbar fotonisk tensorprocessor

Varför snabbare tänkande maskiner är viktiga

Varje gång du låser upp din telefon med ansiktet, talar med en röstassistent eller ser ett AI‑system känna igen objekt i en video sker enorma mängder beräkningar i bakgrunden. När dessa artificiella intelligensmodeller blir större och mer kapabla kräver de mer energi, mer hårdvara och mer tid. Den här artikeln utforskar en ny typ av ”optiskt hjärna” som använder ljus i stället för enbart elektricitet för att utföra dessa tyngre beräkningar, med målet att göra framtidens AI både snabbare och mer energieffektiv.

Ljus som ett nytt sätt att räkna

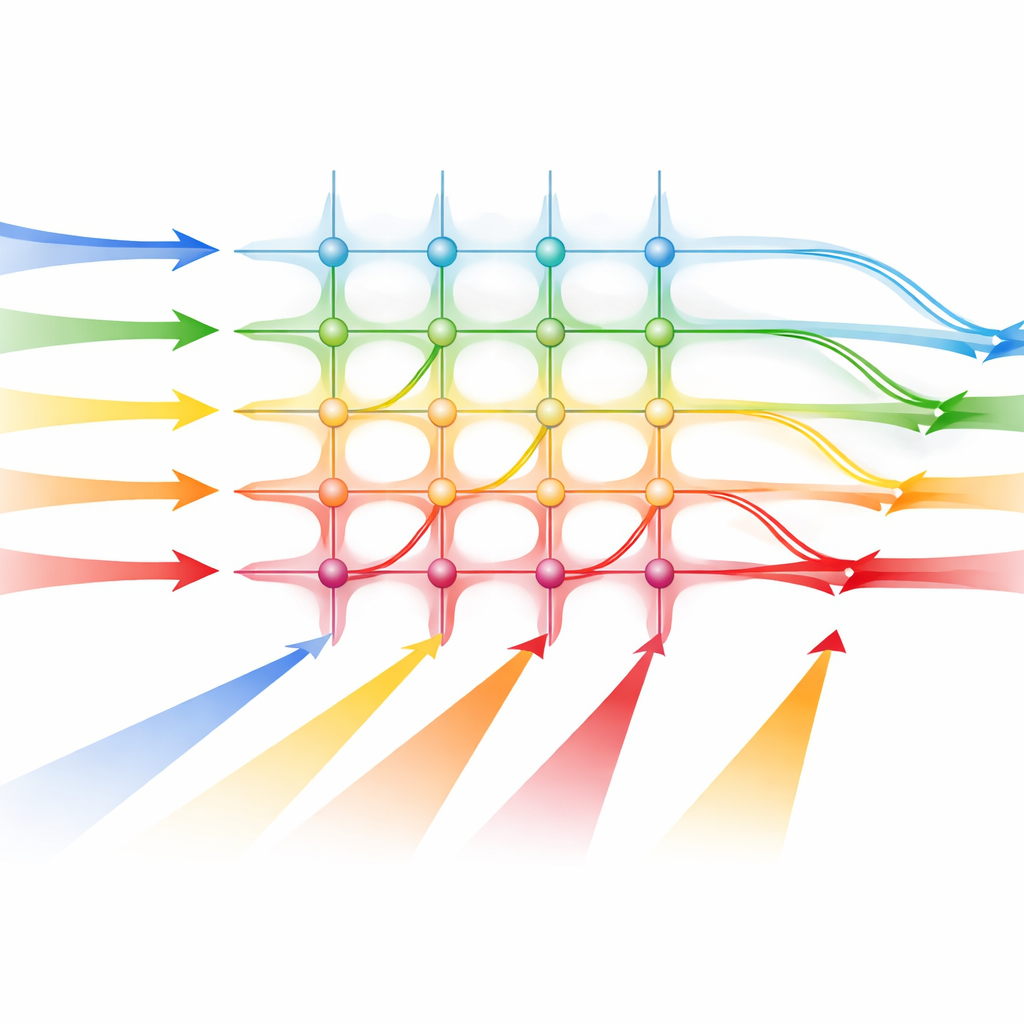

Modern AI drivs av djupa neurala nätverk, som i grunden handlar om upprepade tillämpningar av liknande matematiska operationer på stora tabeller av tal, så kallade tensorer. Idag körs dessa operationer på elektroniska kretsar som GPU:er, som närmar sig gränser i hastighet och strömförbrukning. Författarna vänder sig till fotonik — användningen av ljus i små on‑chip‑strukturer — för att utföra samma operationer. Eftersom ljus kan färdas snabbt och i många kanaler samtidigt kan en fotonisk processor i princip utföra många beräkningar parallellt med mycket låg fördröjning samtidigt som vissa energiförluster som plågar konventionell elektronik undviks.

Bygga en ljusdriven matematisk motor

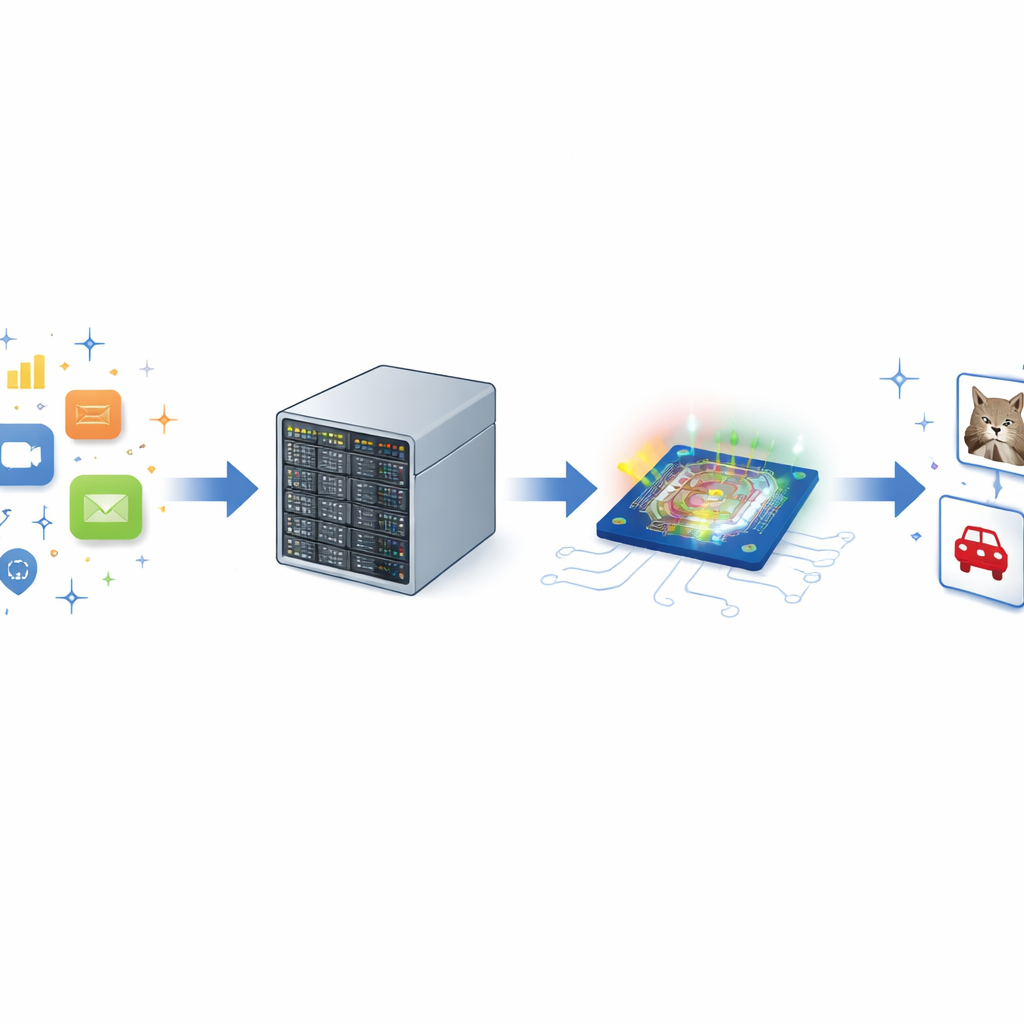

Teamet designade en fotonisk tensorprocessor som ryms i ett standard 19‑tums serverrack, vilket får den att likna annan serverhårdvara. I dess centrum finns en kisel‑fotonisk krets tillverkad med en industriell tillverkningsprocess, vilket ökar chansen att sådana enheter slutligen kan produceras i skala. På denna krets konverteras inkommande elektriska signaler som representerar data till ljusmönster med hjälp av särskilda modulatorer. Dessa ljussignaler färdas sedan genom ett rutnät av små vågledare som fungerar som en matris av justerbara kopplingar, där varje korsning kan förstärka eller försvaga det passerande ljuset. I slutet av varje kolumn omvandlar inbyggda ljussensorer den kombinerade ljusstyrkan tillbaka till elektriska signaler som motsvarar resultatet av en matris‑vektor‑multiplikation, den centrala operationen i många neurala nätverkslager.

Hålla ljuset stabilt och matematiken exakt

För att mata kretsen använder forskarna en enda avancerad ljuskälla som kallas en mikrokomb, vilken producerar många jämnt fördelade ljusfärger samtidigt. Varje färg fungerar som en separat kanal som bär en del av ingångsdata, vilket tillåter flera beräkningar att fortgå parallellt. Att arbeta med analoga ljussignaler introducerar dock brus och imperfektioner. Författarna hanterar detta med noggrann kalibrering: de mäter hur varje modulator och detektor svarar och justerar sedan styrspänningar och effektnivåer så att en önskad matematisk vikt motsvarar en specifik optisk inställning. De kompenserar också för korsprat mellan kanaler och för distorsioner som introduceras av den optiska förpackningen. Genom att i vissa fall ta medelvärden över upprepade mätningar kan de byta lite extra tid mot högre noggrannhet.

Köra verkliga AI‑uppgifter med ljus

För att visa att systemet inte bara är en laboratoriecuriositet kopplar teamet den fotoniska processorn direkt till PyTorch, ett allmänt använt AI‑programvaruramverk. De tränar två bildigenkänningsnätverk digitalt och finjusterar dem sedan samtidigt som de modellerar den typ av brus som hårdvaran kommer att introducera. När de väl är tränade körs samma nätverk på den fotoniska processorn utan att de behöver göras om för kretsen. På den enkla handskriftsdatamängden MNIST uppnår det optiska systemet cirka 98,1 % noggrannhet i ett högprecisionsläge och 91 % i ett låglatensläge, nära den helt digitala referensen. På den mer krävande färgbildsdataseten CIFAR‑10 når det 72 % noggrannhet i precisionsläge — lägre än den digitala versionen men ändå ett bevis på praktisk prestanda på en svårare uppgift.

Vad detta betyder för framtidens AI‑hårdvara

Även om den nuvarande prototypen är mindre energieffektiv än de senaste elektroniska acceleratorerna ligger merparten av dess effektförbrukning i stödelektroniken, inte i den optiska kärnan. Resultaten visar att en programmerbar, rackmonterbar fotonisk processor kan utföra nästan all tung linjär algebra i verkliga neurala nätverk, med stabil prestanda över tid och en avvägbar balans mellan hastighet och noggrannhet. När tekniken skalar upp till större optiska kärnor, fler våglängder och bättre omvandlare kan sådana ljusbaserade tensorprocessorer erbjuda ultravassa, låglatens‑AI‑motorer som kompletterar eller i vissa fall avlastar arbete från konventionella chip, vilket hjälper framtida system att hantera ständigt växande AI‑arbetsbelastningar mer effektivt.

Citering: Meyer, L., Dijkstra, J., Tebeck, S. et al. Deep neural network inference on an integrated, reconfigurable photonic tensor processor. Nat Commun 17, 3396 (2026). https://doi.org/10.1038/s41467-026-71599-2

Nyckelord: fotonisk beräkning, optisk AI‑accelerator, djupa neurala nätverk, kisel‑fotonik, tensorbearbetning