Clear Sky Science · es

Inferencia de redes neuronales profundas en un procesador tensorial fotónico integrado y reconfigurable

Por qué importan las máquinas que piensan más rápido

Cada vez que desbloqueas el móvil con tu rostro, hablas con un asistente de voz o ves a un sistema de IA detectar objetos en un vídeo, se realizan enormes cantidades de cálculos detrás de escena. A medida que estos modelos de inteligencia artificial crecen y se vuelven más capaces, exigen más energía, más hardware y más tiempo. Este artículo explora un nuevo tipo de “cerebro óptico” que utiliza la luz en lugar de solo electricidad para llevar a cabo estos cálculos intensivos, con el objetivo de que la IA futura sea tanto más rápida como más eficiente energéticamente.

La luz como una nueva forma de calcular

La IA moderna se impulsa con redes neuronales profundas, que se reducen a aplicaciones repetidas de operaciones matemáticas similares sobre grandes tablas de números, llamadas tensores. Hoy en día estas operaciones se ejecutan en chips electrónicos como las GPU, que están topando con límites en velocidad y consumo energético. Los autores recurren a la fotónica—el uso de la luz en diminutas estructuras integradas—para realizar esas mismas operaciones. Debido a que la luz puede viajar rápidamente y por muchos canales a la vez, un procesador fotónico puede, en principio, ejecutar muchos cálculos en paralelo con un retraso muy bajo y evitando algunas de las pérdidas energéticas que afectan a la electrónica convencional.

Construyendo un motor matemático alimentado por luz

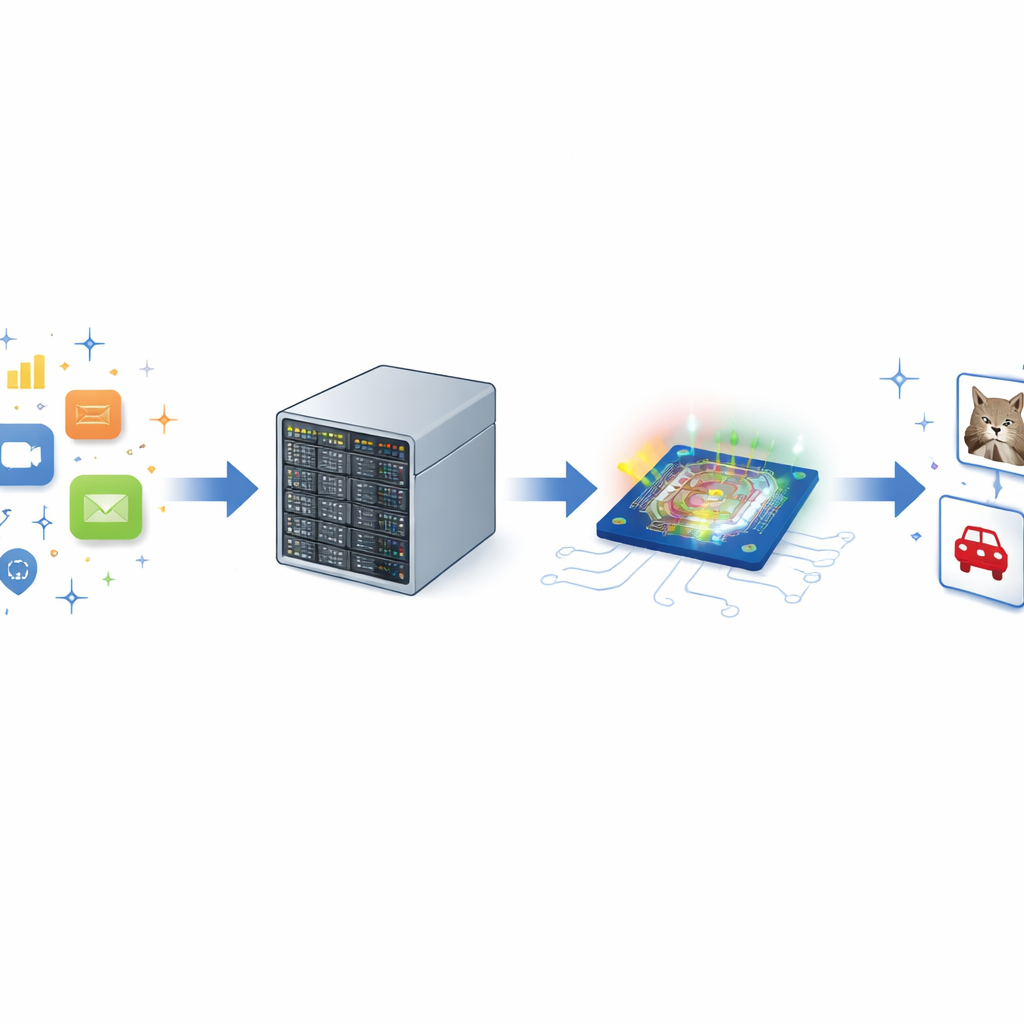

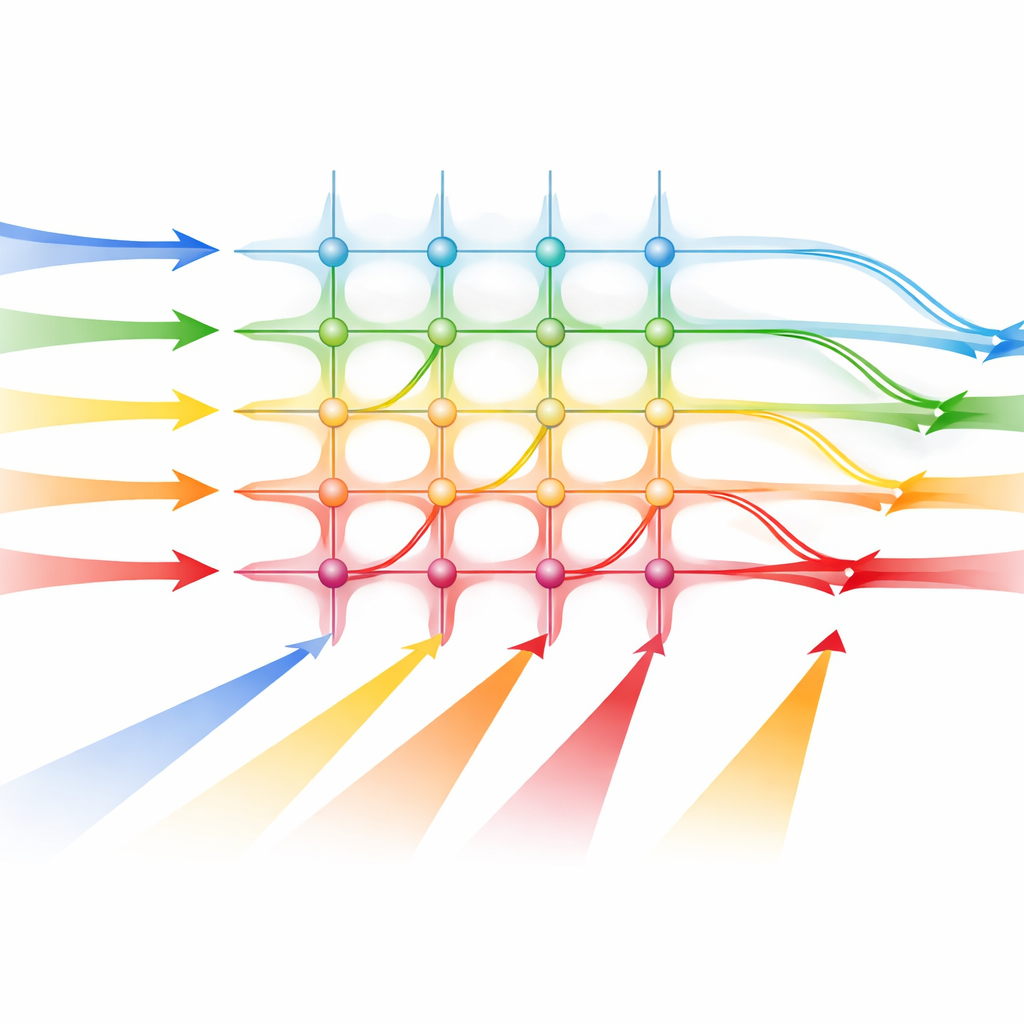

El equipo diseñó un procesador tensorial fotónico que encaja en un rack informático estándar de 19 pulgadas, lo que lo hace parecido a otro hardware de servidor. En su corazón hay un chip fotónico de silicio fabricado con un proceso industrial, lo que aumenta las probabilidades de que dispositivos así puedan producirse a escala. En este chip, las señales eléctricas entrantes que representan datos se convierten en patrones de luz mediante moduladores especiales. Estas señales ópticas viajan luego a través de una rejilla de diminutas guías de onda que actúan como una matriz de conexiones ajustables, donde cada cruce puede reforzar o atenuar la luz que pasa. Al final de cada columna, los sensores de luz integrados convierten la luminosidad combinada de nuevo en señales eléctricas que corresponden al resultado de una multiplicación matriz‑vector, la operación central en muchas capas de redes neuronales.

Mantener la luz estable y las matemáticas precisas

Para alimentar el chip, los investigadores usan una única fuente de luz avanzada llamada microcomb, que produce muchas longitudes de onda uniformemente espaciadas a la vez. Cada color sirve como un canal separado que transmite parte de los datos de entrada, permitiendo que múltiples cálculos procedan en paralelo. Sin embargo, trabajar con señales ópticas analógicas introduce ruido e imperfecciones. Los autores abordan esto con una calibración cuidadosa: miden cómo responde cada modulador y detector, y luego ajustan los voltajes de control y los niveles de potencia para que un peso matemático deseado corresponda a una configuración óptica específica. También compensan el diafonía entre canales y las distorsiones introducidas por el empaquetado óptico. Promediando mediciones repetidas cuando es necesario, pueden intercambiar un poco más de tiempo por mayor precisión.

Ejecutando tareas reales de IA con luz

Para demostrar que su sistema no es solo una curiosidad de laboratorio, el equipo conecta el procesador fotónico directamente a PyTorch, un marco de software de IA ampliamente usado. Entrenan dos redes neuronales de reconocimiento de imágenes de forma digital y luego las afinan modelando el tipo de ruido que el hardware introduciría. Una vez entrenadas, las mismas redes se ejecutan en el procesador fotónico sin necesidad de rediseñarlas para el chip. En el sencillo conjunto de dígitos manuscritos MNIST, el sistema óptico alcanza alrededor de un 98,1 % de precisión en un modo de mayor precisión y un 91 % en un modo de baja latencia, cerca de la referencia totalmente digital. En el más exigente conjunto de imágenes a color CIFAR‑10, alcanza un 72 % de precisión en modo de precisión—inferior a la versión digital, pero aún así demostrando un rendimiento práctico en una tarea más difícil.

Qué significa esto para el futuro del hardware de IA

Aunque el prototipo actual es menos eficiente energéticamente que los aceleradores electrónicos de última generación, la mayor parte de su consumo se gasta en la electrónica de soporte, no en el núcleo óptico en sí. Los resultados muestran que un procesador fotónico programable y montable en rack puede realizar casi todas las operaciones pesadas de álgebra lineal en redes neuronales reales, con un rendimiento estable a lo largo del tiempo y un equilibrio ajustable entre velocidad y precisión. A medida que la tecnología escale a núcleos ópticos más grandes, más longitudes de onda y mejores convertidores, dichos procesadores tensoriales basados en luz podrían ofrecer motores de IA ultrarrápidos y de baja latencia que complementen o, en algunos casos, descarguen trabajo de los chips convencionales, ayudando a que los sistemas futuros manejen cargas de trabajo de IA cada vez mayores con mayor eficiencia.

Cita: Meyer, L., Dijkstra, J., Tebeck, S. et al. Deep neural network inference on an integrated, reconfigurable photonic tensor processor. Nat Commun 17, 3396 (2026). https://doi.org/10.1038/s41467-026-71599-2

Palabras clave: computación fotónica, acelerador óptico de IA, redes neuronales profundas, fotónica de silicio, procesamiento tensorial