Clear Sky Science · fr

Inférence de réseaux neuronaux profonds sur un processeur tensoriel photonique intégré et reconfigurable

Pourquoi des machines pensantes plus rapides importent

Chaque fois que vous déverrouillez votre téléphone avec votre visage, que vous parlez à un assistant vocal ou que vous voyez un système d’IA détecter des objets dans une vidéo, d’énormes quantités de calculs ont lieu en coulisses. À mesure que ces modèles d’intelligence artificielle deviennent plus grands et plus puissants, ils réclament davantage d’énergie, de matériel et de temps. Cet article explore un nouveau type de « cerveau optique » qui utilise la lumière plutôt que exclusivement l’électricité pour effectuer ces calculs lourds, dans l’objectif de rendre l’IA future à la fois plus rapide et plus économe en énergie.

La lumière comme nouvelle façon de calculer

L’IA moderne repose sur des réseaux neuronaux profonds, qui se ramènent à des applications répétées d’opérations mathématiques similaires sur de grandes tables de nombres, appelées tenseurs. Aujourd’hui, ces opérations s’exécutent sur des puces électroniques comme les GPU, qui atteignent des limites en vitesse et en consommation d’énergie. Les auteurs se tournent vers la photonique — l’usage de la lumière dans de minuscules structures sur puce — pour réaliser ces mêmes opérations. Parce que la lumière peut se propager rapidement et sur de nombreux canaux simultanément, un processeur photonique peut, en principe, effectuer de nombreux calculs en parallèle avec un très faible délai tout en évitant certaines pertes d’énergie qui pénalisent l’électronique conventionnelle.

Construire un moteur mathématique alimenté par la lumière

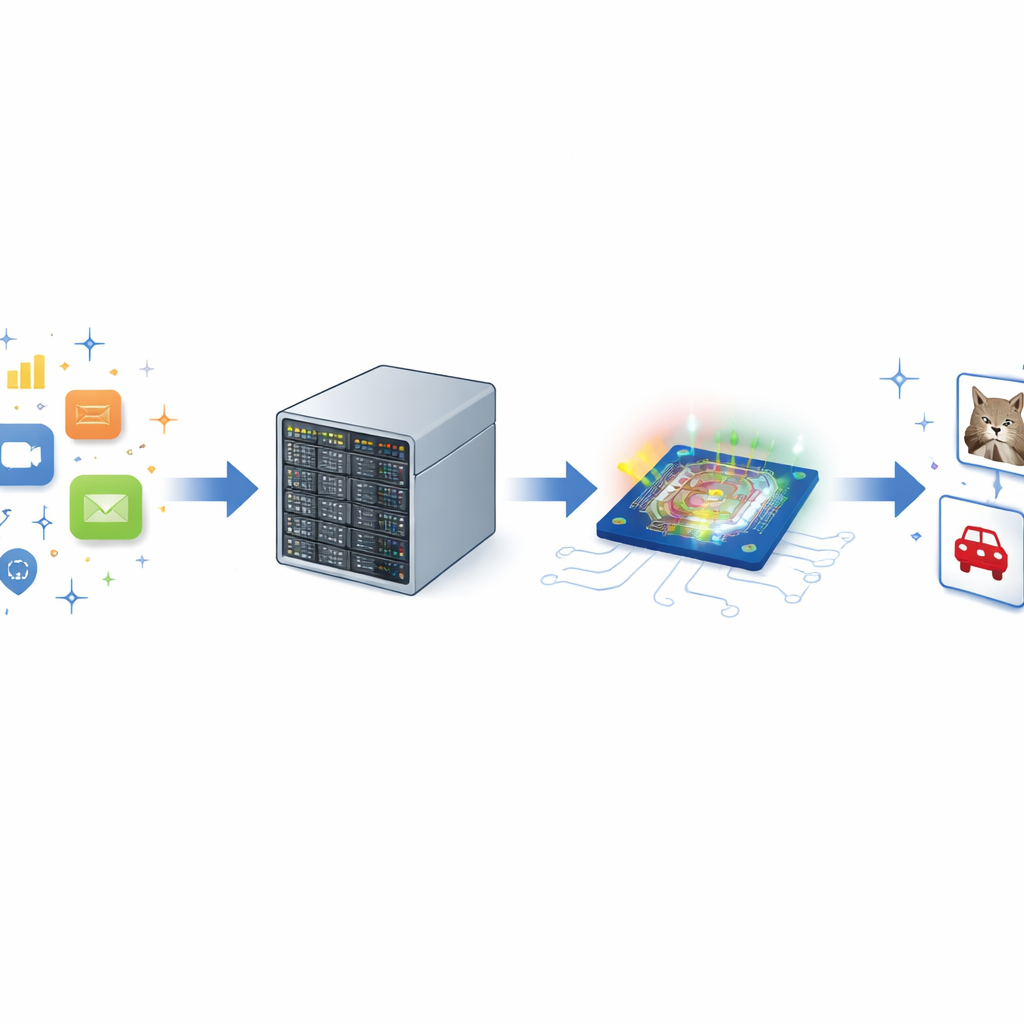

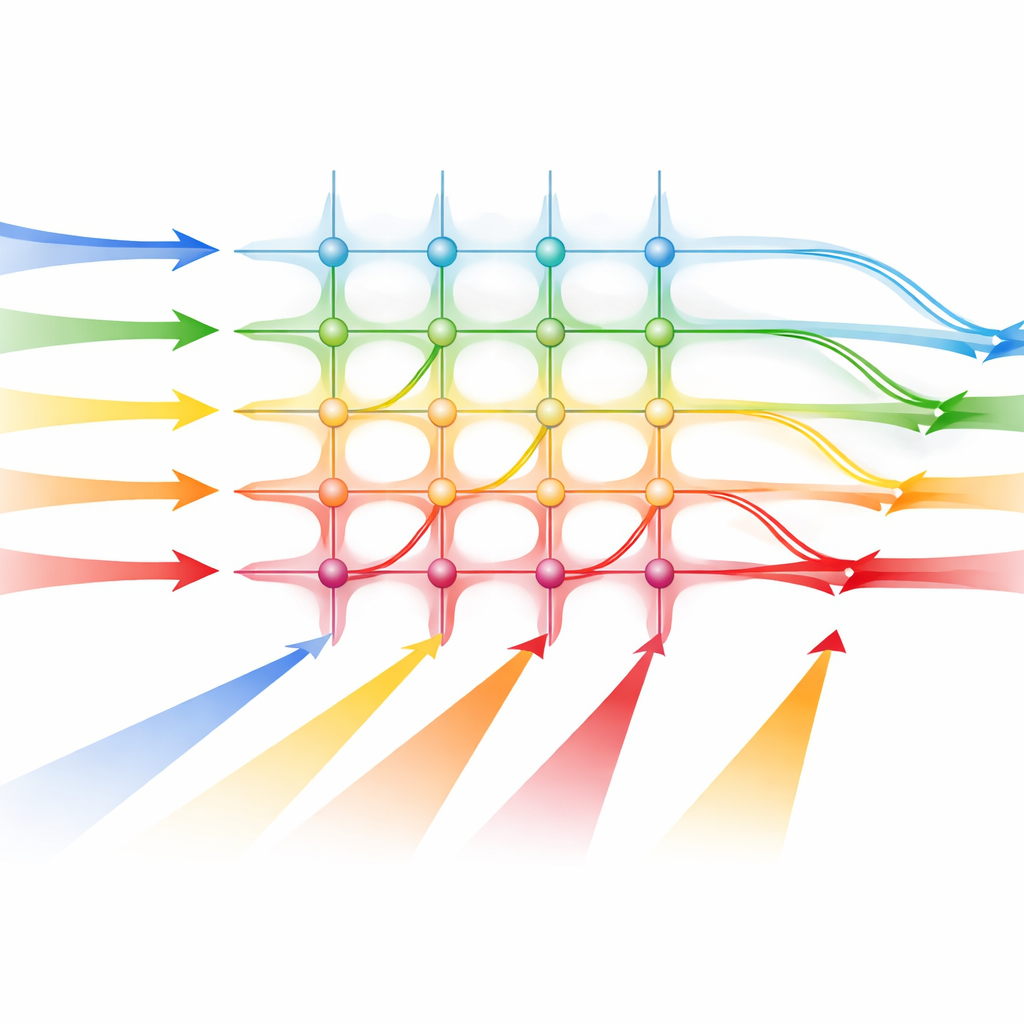

L’équipe a conçu un processeur tensoriel photonique qui tient dans une baie informatique standard de 19 pouces, lui donnant l’allure d’un équipement serveur classique. En son cœur se trouve une puce photonique sur silicium fabriquée par un procédé industriel, ce qui augmente la probabilité que de tels dispositifs puissent finalement être produits à grande échelle. Sur cette puce, des signaux électriques entrants représentant les données sont convertis en motifs lumineux au moyen de modulateurs spécialisés. Ces signaux lumineux circulent ensuite dans une grille de minuscules guide‑ondes qui fonctionnent comme une matrice de connexions ajustables, où chaque croisement peut renforcer ou atténuer la lumière qui le traverse. À la fin de chaque colonne, des détecteurs intégrés convertissent la luminosité combinée en signaux électriques correspondant au résultat d’une multiplication matrice‑vecteur, l’opération de base dans de nombreuses couches de réseaux neuronaux.

Stabiliser la lumière et garantir la précision des calculs

Pour alimenter la puce, les chercheurs utilisent une source lumineuse avancée unique appelée micropeigne, qui produit simultanément de nombreuses couleurs de lumière espacées de façon régulière. Chaque couleur sert de canal séparé transportant une partie des données d’entrée, permettant à plusieurs calculs de se dérouler en parallèle. Toutefois, travailler avec des signaux lumineux analogiques introduit du bruit et des imperfections. Les auteurs s’attaquent à ces problèmes par une calibration méticuleuse : ils mesurent la réponse de chaque modulateur et détecteur, puis ajustent les tensions de commande et les niveaux de puissance de sorte qu’un poids mathématique souhaité corresponde à un réglage optique précis. Ils compensent également les diaphonies entre canaux et les distorsions introduites par l’emballage optique. En moyennant des mesures répétées lorsque nécessaire, ils peuvent échanger un peu de temps supplémentaire contre une meilleure précision.

Exécuter de vraies tâches d’IA avec la lumière

Pour montrer que leur système n’est pas qu’une curiosité de laboratoire, l’équipe connecte le processeur photonique directement à PyTorch, un cadre logiciel d’IA largement utilisé. Ils entraînent numériquement deux réseaux de reconnaissance d’images puis les ajustent en tenant compte du type de bruit que le matériel introduira. Une fois entraînés, ces mêmes réseaux s’exécutent sur le processeur photonique sans nécessité de les repenser pour la puce. Sur l’ensemble de chiffres manuscrits MNIST, le système optique atteint environ 98,1 % de précision en mode haute précision et 91 % en mode faible latence, proches de la référence entièrement numérique. Sur l’ensemble d’images couleur plus exigeant CIFAR‑10, il atteint 72 % de précision en mode précision — inférieur à la version numérique mais démontrant néanmoins des performances pratiques sur une tâche plus difficile.

Ce que cela signifie pour l’avenir du matériel d’IA

Bien que le prototype actuel soit moins économe en énergie que les accélérateurs électroniques de pointe, la majeure partie de sa consommation est due à l’électronique de soutien, et non au cœur optique lui‑même. Les résultats montrent qu’un processeur photonique programmable et montable en rack peut exécuter presque toute l’algèbre linéaire lourde des réseaux neuronaux réels, avec des performances stables dans le temps et un compromis réglable entre vitesse et précision. À mesure que la technologie évoluera vers des cœurs optiques plus grands, davantage de longueurs d’onde et de meilleurs convertisseurs, de tels processeurs tensoriels basés sur la lumière pourraient offrir des moteurs d’IA ultra‑rapides et à faible latence qui complètent, ou dans certains cas déchargent, le travail des puces conventionnelles, aidant les systèmes futurs à gérer des charges de travail d’IA toujours croissantes de façon plus efficace.

Citation: Meyer, L., Dijkstra, J., Tebeck, S. et al. Deep neural network inference on an integrated, reconfigurable photonic tensor processor. Nat Commun 17, 3396 (2026). https://doi.org/10.1038/s41467-026-71599-2

Mots-clés: informatique photonique, accélérateur IA optique, réseaux neuronaux profonds, photonique sur silicium, traitement tensoriel