Clear Sky Science · de

Tiefes neuronales Netzwerk-Inferenz auf einem integrierten, rekonfigurierbaren photonischen Tensorprozessor

Warum schnellere Denkmaschinen wichtig sind

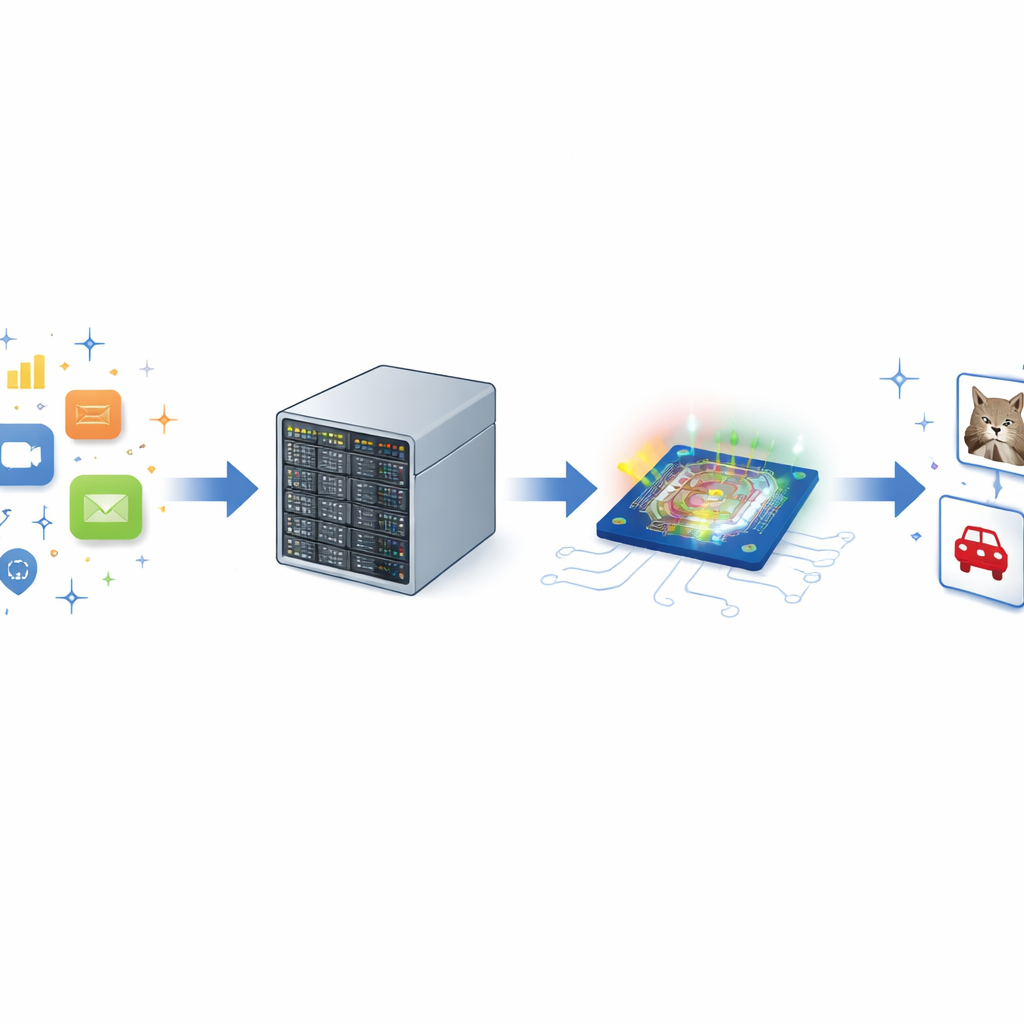

Jedes Mal, wenn Sie Ihr Telefon mit Ihrem Gesicht entsperren, mit einem Sprachassistenten sprechen oder ein KI‑System Objekte in einem Video erkennt, laufen im Hintergrund enorme Mengen an Rechenoperationen ab. Wenn diese künstlichen Intelligenzmodelle größer und leistungsfähiger werden, benötigen sie mehr Energie, mehr Hardware und mehr Zeit. Dieser Artikel untersucht eine neue Art von „optischem Gehirn“, das Licht statt nur Elektrizität zur Durchführung dieser schweren Berechnungen nutzt, mit dem Ziel, künftige KI sowohl schneller als auch energieeffizienter zu machen.

Licht als neue Rechenweise

Moderne KI wird von tiefen neuronalen Netzen angetrieben, die sich auf wiederholte Anwendungen ähnlicher mathematischer Operationen auf großen Zahlentabellen, sogenannten Tensoren, reduzieren lassen. Heute laufen diese Operationen auf elektronischen Chips wie GPUs, die an Grenzen bei Geschwindigkeit und Energieverbrauch stoßen. Die Autoren wenden sich der Photonik zu — der Nutzung von Licht in winzigen On‑Chip‑Strukturen — um dieselben Operationen durchzuführen. Da Licht schnell reisen und in vielen Kanälen gleichzeitig übertragen werden kann, kann ein photonischer Prozessor prinzipiell viele Berechnungen parallel mit sehr geringer Verzögerung ausführen und dabei einige der Energieverluste vermeiden, die konventionelle Elektronik belasten.

Aufbau einer lichtbetriebenen Rechenmaschine

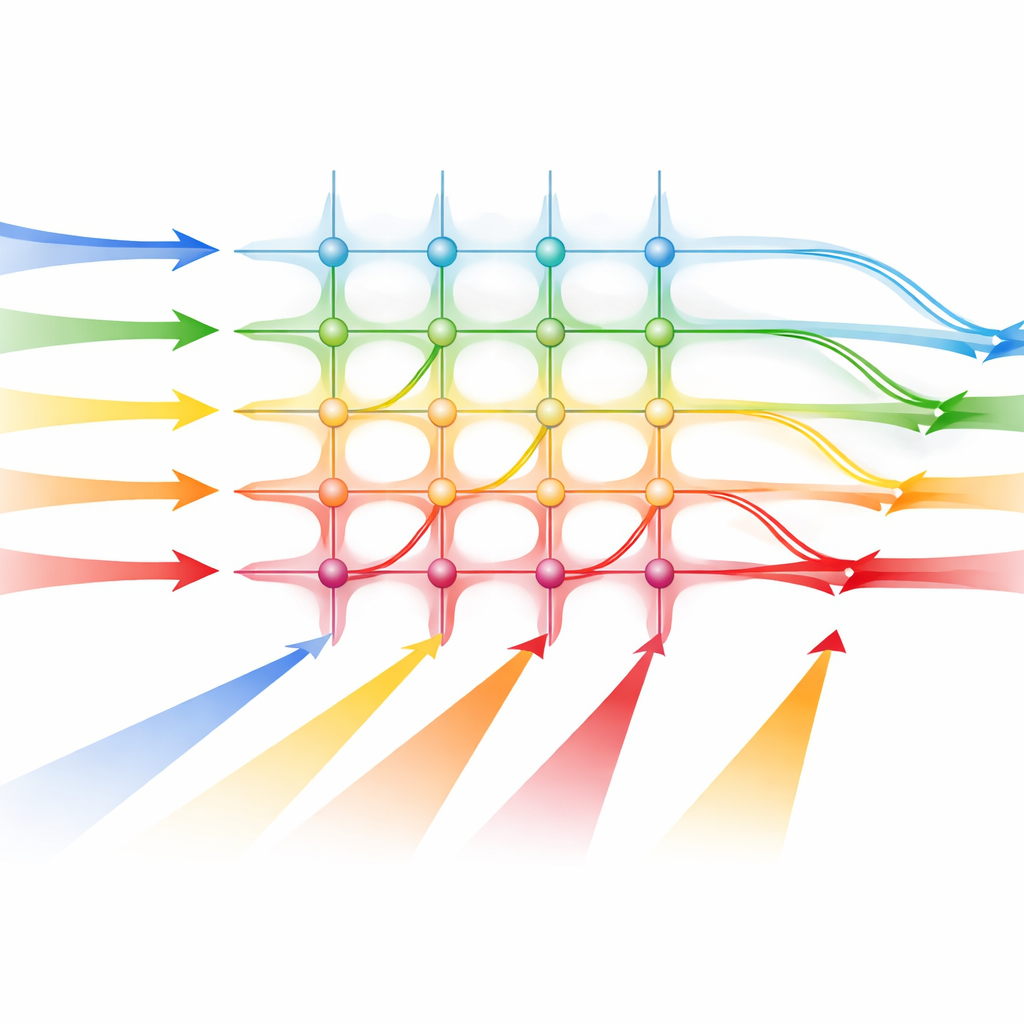

Das Team entwarf einen photonischen Tensorprozessor, der in einen standardmäßigen 19‑Zoll‑Computerrahmen passt und damit anderen Serverkomponenten ähnelt. Im Zentrum steht ein Silizium‑Photonikchip, hergestellt mit einem industriellen Fertigungsprozess, was die Chancen erhöht, dass solche Geräte schließlich in großem Maßstab produziert werden können. Auf diesem Chip werden eintreffende elektrische Signale, die Daten repräsentieren, mit speziellen Modulatoren in Lichtmuster umgewandelt. Diese Lichtsignale laufen dann durch ein Netz winziger Wellenleiter, das wie eine Matrix einstellbarer Verbindungen wirkt, wobei jede Kreuzung das durchgehende Licht verstärken oder abschwächen kann. Am Ende jeder Spalte wandeln eingebaute Lichtsensoren die kombinierte Helligkeit wieder in elektrische Signale um, die dem Ergebnis einer Matrix‑Vektor‑Multiplikation entsprechen — der Kernoperation vieler Schichten neuronaler Netze.

Das Licht stabil halten und die Mathematik genau machen

Um den Chip zu speisen, verwenden die Forscher eine einzelne fortschrittliche Lichtquelle, einen sogenannten Mikrocomber, der viele gleichmäßig verteilte Lichtfarben gleichzeitig erzeugt. Jede Farbe dient als separater Kanal, der einen Teil der Eingangsdaten trägt und mehrere parallele Berechnungen ermöglicht. Die Arbeit mit analogen Lichtsignalen bringt jedoch Rauschen und Unvollkommenheiten mit sich. Die Autoren begegnen dem mit sorgfältiger Kalibrierung: Sie messen, wie jeder Modulator und Detektor reagiert, und passen dann die Steuer‑spannungen und Leistungspegel so an, dass ein gewünschtes mathematisches Gewicht einer spezifischen optischen Einstellung entspricht. Sie kompensieren auch für Übersprechen zwischen Kanälen und für Verzerrungen, die durch die optische Verpackung eingeführt werden. Durch das Mittelwertbilden wiederholter Messungen, wenn nötig, können sie einen kleinen Zeitaufwand gegen höhere Genauigkeit eintauschen.

Echte KI‑Aufgaben mit Licht ausführen

Um zu zeigen, dass ihr System keine bloße Labor‑Kuriosität ist, koppelt das Team den photonischen Prozessor direkt an PyTorch, ein weit verbreitetes KI‑Software‑Framework. Sie trainieren zwei bilderkennungsbasierte neuronale Netze digital und verfeinern sie dann, während sie das vom Hardware‑Betrieb zu erwartende Rauschverhalten modellieren. Nach dem Training laufen dieselben Netze auf dem photonischen Prozessor, ohne dass sie für den Chip neu entworfen werden müssen. Auf dem einfachen Handschrift‑Ziffern‑Datensatz MNIST erzielt das optische System etwa 98,1 % Genauigkeit im Hochpräzisions‑Modus und 91 % im Niedriglatenz‑Modus, nahe am rein digitalen Referenzwert. Auf dem anspruchsvolleren Farb‑Bilddatensatz CIFAR‑10 erreicht es im Präzisionsmodus 72 % Genauigkeit — weniger als die digitale Version, aber dennoch praktisch leistungsfähig bei einer schwierigeren Aufgabe.

Was das für die Zukunft der KI‑Hardware bedeutet

Obwohl der aktuelle Prototyp weniger energieeffizient ist als hochmoderne elektronische Beschleuniger, wird sein Großteil der Energie in unterstützender Elektronik verbraucht, nicht im optischen Kern selbst. Die Ergebnisse zeigen, dass ein programmierbarer, im Rack montierbarer photonischer Prozessor nahezu die gesamte schwere lineare Algebra in realen neuronalen Netzen ausführen kann, mit stabiler Leistung über die Zeit und einer einstellbaren Balance zwischen Geschwindigkeit und Genauigkeit. Wenn die Technologie auf größere optische Kerne, mehr Wellenlängen und bessere Wandler skaliert, könnten solche lichtbasierten Tensorprozessoren extrem schnelle, latenzarme KI‑Engines bieten, die konventionelle Chips ergänzen oder in einigen Fällen Arbeit von ihnen übernehmen und künftigen Systemen helfen, immer größer werdende KI‑Workloads effizienter zu bewältigen.

Zitation: Meyer, L., Dijkstra, J., Tebeck, S. et al. Deep neural network inference on an integrated, reconfigurable photonic tensor processor. Nat Commun 17, 3396 (2026). https://doi.org/10.1038/s41467-026-71599-2

Schlüsselwörter: photonisches Rechnen, optischer KI-Beschleuniger, tiefe neuronale Netze, Siliziumphotonik, Tensorverarbeitung