Clear Sky Science · it

Inferenza di reti neurali profonde su un processore tensoriale fotonico integrato e riconfigurabile

Perché contano macchine che pensano più velocemente

Ogni volta che sblocchi il telefono con il volto, parli con un assistente vocale o vedi un sistema di IA rilevare oggetti in un video, dietro le quinte avvengono enormi quantità di calcoli. Man mano che questi modelli di intelligenza artificiale diventano più grandi e capaci, richiedono più energia, più hardware e più tempo. Questo articolo esplora una nuova specie di “cervello ottico” che usa la luce invece che soltanto l’elettricità per eseguire questi calcoli intensivi, con l’obiettivo di rendere l’IA futura sia più veloce sia più efficiente dal punto di vista energetico.

La luce come nuovo modo di calcolare

L’IA moderna è alimentata da reti neurali profonde, che si riducono a ripetute applicazioni di operazioni matematiche simili su grandi tabelle di numeri, chiamate tensori. Oggi queste operazioni girano su chip elettronici come le GPU, che si stanno avvicinando ai limiti in termini di velocità e consumo energetico. Gli autori si rivolgono alla fotonica — l’uso della luce in minuscole strutture on‑chip — per eseguire le stesse operazioni. Poiché la luce può viaggiare rapidamente e su molti canali contemporaneamente, un processore fotonico può, in linea di principio, svolgere numerosi calcoli in parallelo con ritardi molto ridotti, evitando alcuni delle perdite energetiche che affliggono l’elettronica convenzionale.

Costruire un motore matematico alimentato dalla luce

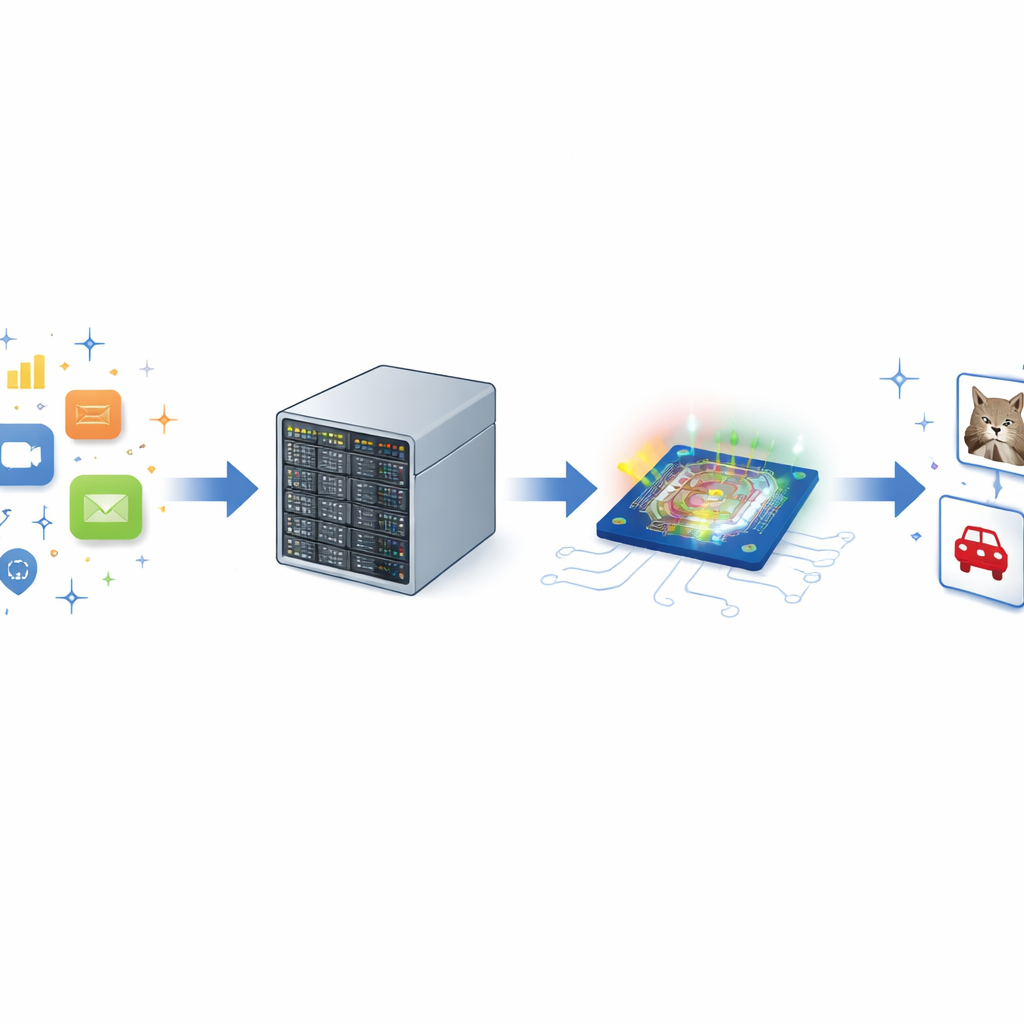

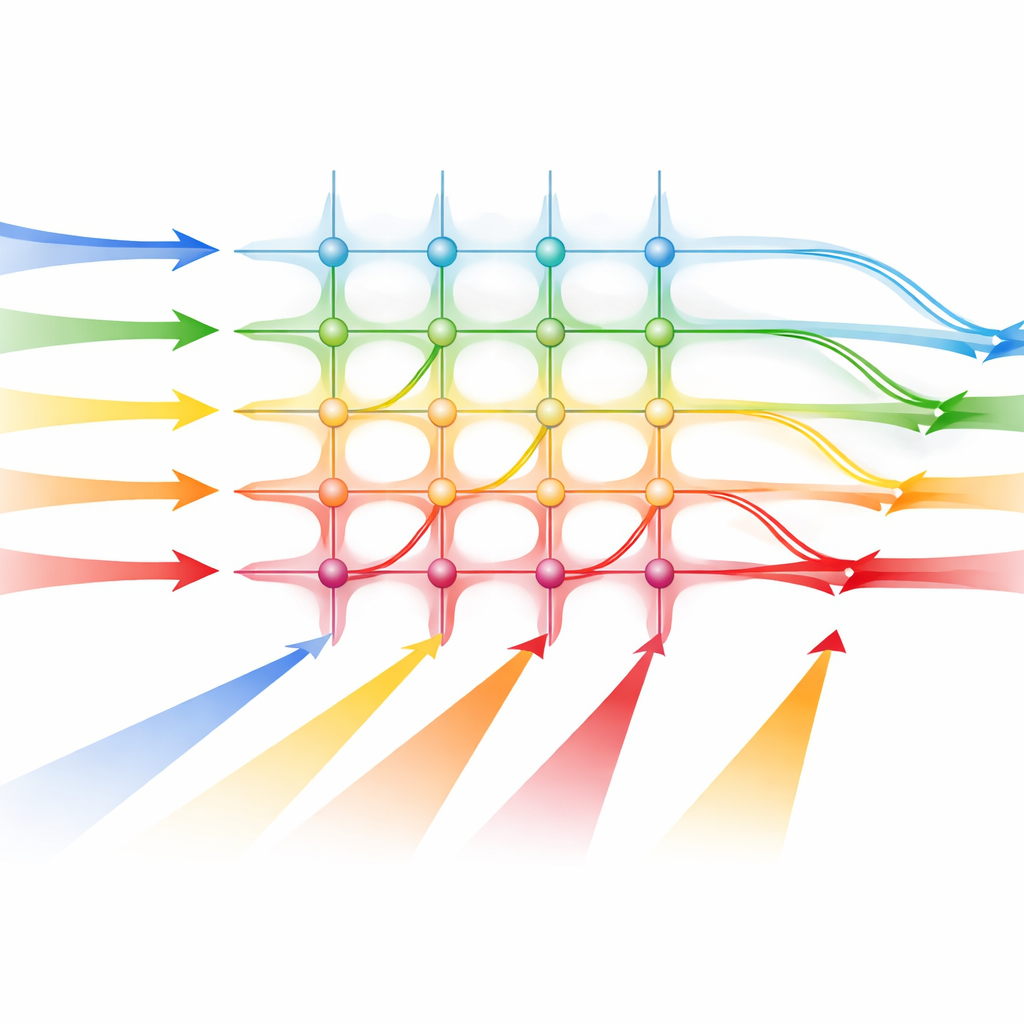

Il team ha progettato un processore tensoriale fotonico che entra in un normale rack informatico da 19 pollici, facendolo somigliare ad altri hardware per server. Al suo centro c’è un chip fotonico su silicio realizzato con un processo di produzione industriale, il che aumenta le probabilità che dispositivi del genere possano essere prodotti su scala. Su questo chip, i segnali elettrici in arrivo che rappresentano i dati vengono convertiti in pattern di luce mediante modulatori speciali. Questi segnali luminosi poi viaggiano attraverso una griglia di minuscole guide d’onda che agiscono come una matrice di connessioni regolabili, dove ogni incrocio può rafforzare o indebolire la luce in transito. Alla fine di ciascuna colonna, sensori ottici integrati convertono la luminosità combinata nuovamente in segnali elettrici che corrispondono al risultato di una moltiplicazione matrice‑vettore, l’operazione centrale in molti strati delle reti neurali.

Mantenere la luce stabile e la matematica accurata

Per alimentare il chip, i ricercatori usano una singola sorgente luminosa avanzata chiamata microcomb, che produce molte lunghezze d’onda uniformemente separate contemporaneamente. Ogni colore funge da canale separato che trasporta parte dei dati di input, permettendo a più calcoli di procedere in parallelo. Tuttavia, lavorare con segnali luminosi analogici introduce rumore e imperfezioni. Gli autori affrontano questo problema con una calibrazione accurata: misurano come rispondono ciascun modulatore e ciascun rivelatore, quindi aggiustano le tensioni di controllo e i livelli di potenza in modo che un peso matematico desiderato corrisponda a una specifica impostazione ottica. Compensano inoltre il diafonia tra i canali e le distorsioni introdotte dall’incapsulamento ottico. Mediando misure ripetute quando necessario, possono scambiare un po’ di tempo aggiuntivo per una maggiore accuratezza.

Eseguire compiti reali di IA con la luce

Per dimostrare che il loro sistema non è solo una curiosità di laboratorio, il team collega il processore fotonico direttamente a PyTorch, un diffuso framework software per l’IA. Allenano digitalmente due reti neurali di riconoscimento immagini e poi le affinano simulando il tipo di rumore che l’hardware introdurrà. Una volta addestrate, le stesse reti girano sul processore fotonico senza bisogno di riprogettazioni specifiche per il chip. Sul semplice dataset di cifre scritte a mano MNIST, il sistema ottico raggiunge circa il 98,1% di accuratezza in una modalità ad alta precisione e il 91% in una modalità a bassa latenza, vicino al riferimento completamente digitale. Sul più impegnativo dataset di immagini a colori CIFAR‑10, arriva al 72% di accuratezza in modalità precisione — inferiore alla versione digitale ma comunque dimostrando prestazioni pratiche su un compito più difficile.

Cosa significa questo per il futuro dell’hardware per l’IA

Anche se il prototipo attuale è meno efficiente dal punto di vista energetico rispetto agli acceleratori elettronici all’avanguardia, la maggior parte della sua potenza viene spesa nell’elettronica di supporto, non nel nucleo ottico stesso. I risultati mostrano che un processore fotonico programmabile e montabile in rack può eseguire quasi tutta l’algebra lineare pesante nelle reti neurali reali, con prestazioni stabili nel tempo e un equilibrio tarabile tra velocità e accuratezza. Con la scalabilità della tecnologia verso core ottici più grandi, più lunghezze d’onda e convertitori migliori, tali processori tensoriali basati sulla luce potrebbero offrire motori IA ultraveloci e a bassa latenza che integrano o, in alcuni casi, scaricano lavoro dai chip convenzionali, aiutando i sistemi futuri a gestire carichi di lavoro IA in continua crescita in modo più efficiente.

Citazione: Meyer, L., Dijkstra, J., Tebeck, S. et al. Deep neural network inference on an integrated, reconfigurable photonic tensor processor. Nat Commun 17, 3396 (2026). https://doi.org/10.1038/s41467-026-71599-2

Parole chiave: calcolo fotonico, acceleratore AI ottico, reti neurali profonde, fotonica su silicio, elaborazione tensoriale