Clear Sky Science · pt

Inferência de redes neurais profundas em um processador tensorial fotônico integrado e reconfigurável

Por que máquinas que pensam mais rápido importam

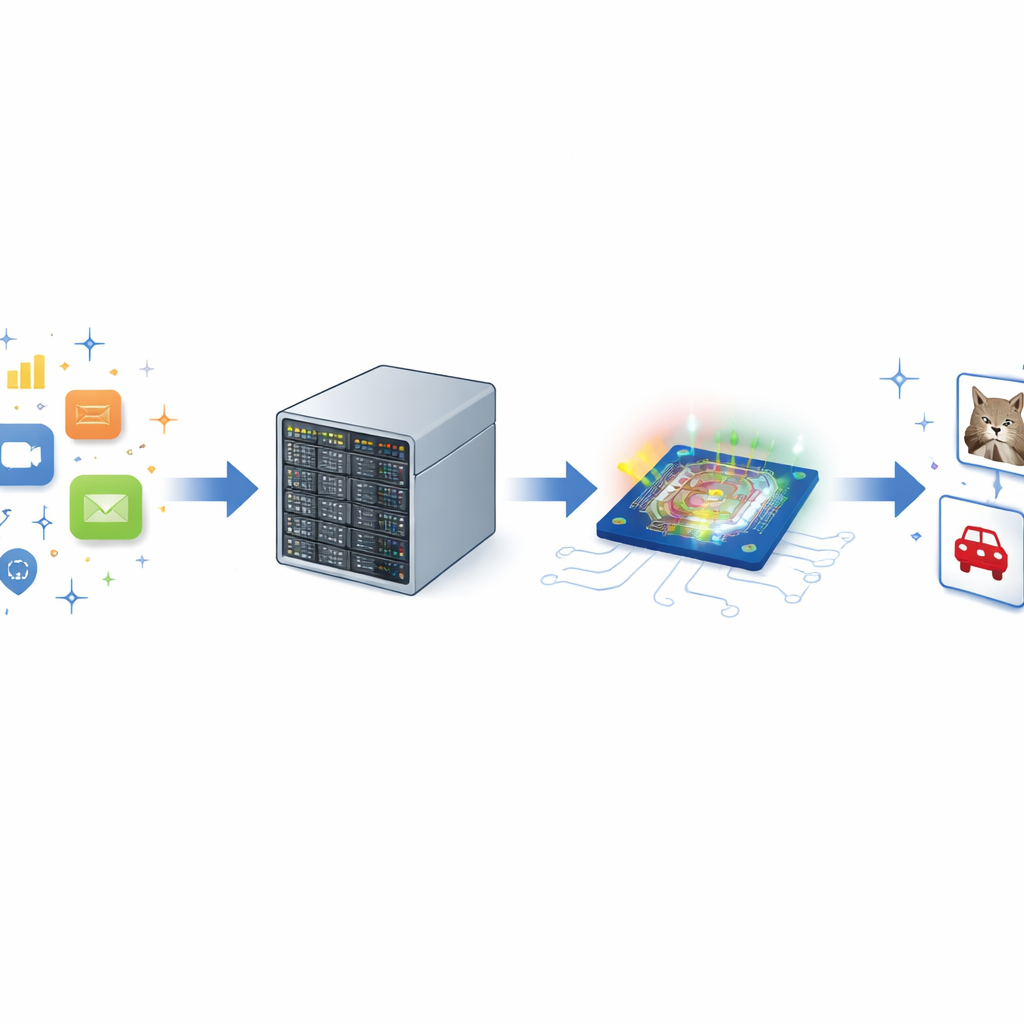

Cada vez que você desbloqueia o telefone com o rosto, fala com um assistente por voz ou vê um sistema de IA detectar objetos em um vídeo, enormes quantidades de cálculos acontecem nos bastidores. À medida que esses modelos de inteligência artificial crescem em tamanho e capacidade, exigem mais energia, mais hardware e mais tempo. Este artigo explora um novo tipo de “cérebro óptico” que usa luz em vez de apenas eletricidade para realizar esses cálculos pesados, com o objetivo de tornar a IA futura mais rápida e energeticamente eficiente.

Luz como uma nova forma de computar

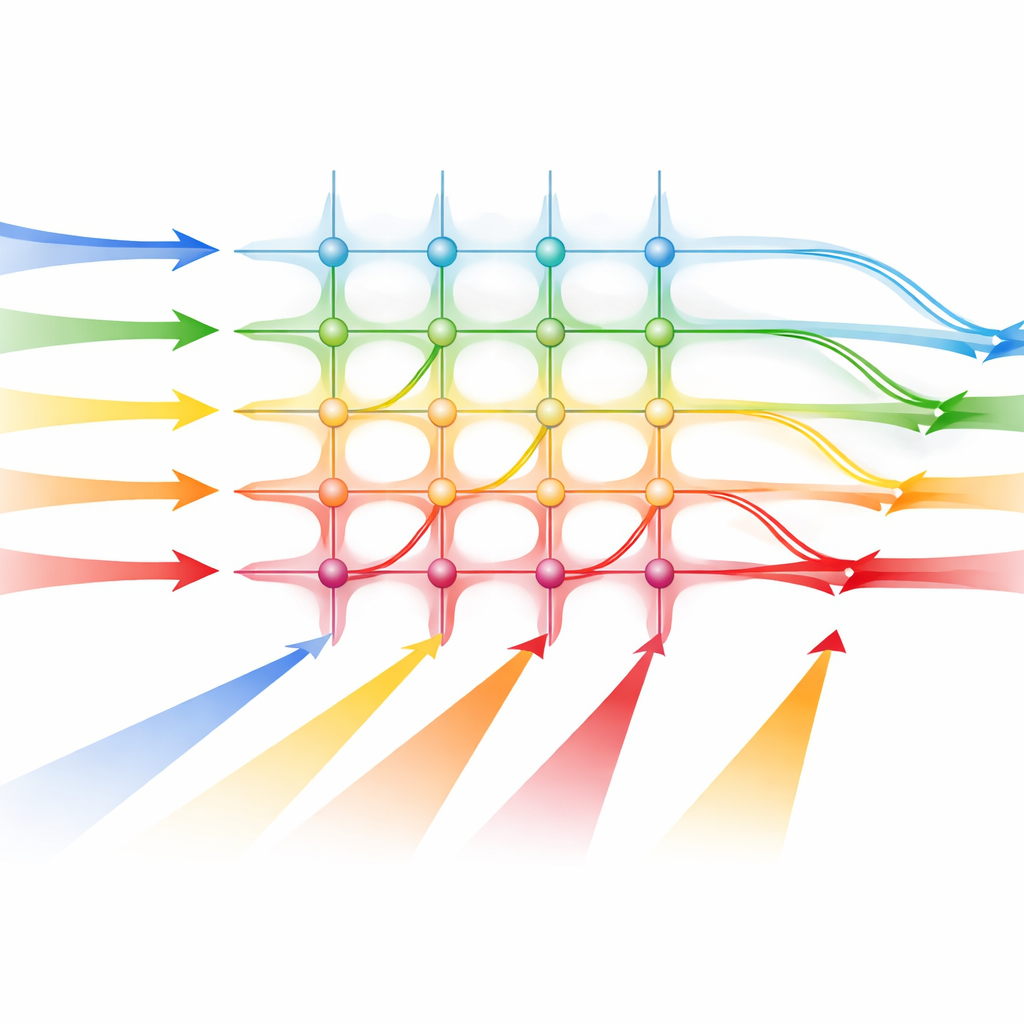

A IA moderna é movida por redes neurais profundas, que se resumem à aplicação repetida de operações matemáticas semelhantes em grandes tabelas de números, chamadas tensores. Hoje essas operações são executadas em chips eletrônicos como GPUs, que estão se aproximando de limites em velocidade e consumo de energia. Os autores recorrem à fotônica — o uso da luz em estruturas minúsculas on‑chip — para executar as mesmas operações. Porque a luz pode viajar rapidamente e em muitos canais ao mesmo tempo, um processador fotônico pode, em princípio, realizar muitos cálculos em paralelo com atraso muito baixo enquanto evita algumas das perdas de energia que afetam a eletrônica convencional.

Construindo um motor matemático movido a luz

A equipe projetou um processador tensorial fotônico que cabe em um rack de computador padrão de 19 polegadas, fazendo-o assemelhar‑se a outro hardware de servidor. No seu núcleo está um chip fotônico de silício fabricado por um processo industrial, o que aumenta as chances de que tais dispositivos possam, eventualmente, ser produzidos em escala. Nesse chip, sinais elétricos de entrada que representam dados são convertidos em padrões de luz usando moduladores especiais. Esses sinais ópticos então percorrem uma grade de guias de onda minúsculos que atuam como uma matriz de conexões ajustáveis, onde cada cruzamento pode reforçar ou atenuar a luz que passa. No final de cada coluna, sensores de luz incorporados convertem o brilho combinado de volta em sinais elétricos que correspondem ao resultado de uma multiplicação matriz‑vetor, a operação central em muitas camadas de redes neurais.

Mantendo a luz estável e a matemática precisa

Para alimentar o chip, os pesquisadores usam uma única fonte de luz avançada chamada microcomb, que produz muitas cores de luz com espaçamento uniforme ao mesmo tempo. Cada cor serve como um canal separado que carrega parte dos dados de entrada, permitindo que múltiplos cálculos prossigam em paralelo. No entanto, trabalhar com sinais ópticos analógicos introduz ruído e imperfeições. Os autores enfrentam isso com calibração cuidadosa: eles medem como cada modulador e detector responde e então ajustam as tensões de controle e os níveis de potência para que um peso matemático desejado corresponda a uma determinada configuração óptica. Eles também compensam o crosstalk entre canais e as distorções introduzidas pela embalagem óptica. Ao promover a média de medições repetidas quando necessário, eles podem trocar um pouco de tempo extra por maior precisão.

Executando tarefas reais de IA com luz

Para mostrar que seu sistema não é apenas uma curiosidade de laboratório, a equipe conecta o processador fotônico diretamente ao PyTorch, uma estrutura de software de IA amplamente usada. Eles treinam digitalmente duas redes neurais de reconhecimento de imagens e então as refinam enquanto modelam o tipo de ruído que o hardware introduzirá. Uma vez treinadas, as mesmas redes rodam no processador fotônico sem necessidade de redesenhá‑las para o chip. No conjunto de dados simples de dígitos manuscritos MNIST, o sistema óptico alcança cerca de 98,1% de acurácia em um modo de maior precisão e 91% em um modo de baixa latência, próximo ao ponto de referência totalmente digital. No mais exigente conjunto de imagens coloridas CIFAR‑10, atinge 72% de acurácia no modo de precisão — inferior à versão digital, mas ainda demonstrando desempenho prático em uma tarefa mais difícil.

O que isso significa para o futuro do hardware de IA

Embora o protótipo atual seja menos eficiente em energia do que aceleradores eletrônicos de ponta, a maior parte de sua energia é gasta na eletrônica de suporte, e não no núcleo óptico em si. Os resultados mostram que um processador fotônico programável e montado em rack pode executar quase toda a álgebra linear pesada em redes neurais reais, com desempenho estável ao longo do tempo e um equilíbrio ajustável entre velocidade e precisão. À medida que a tecnologia escala para núcleos ópticos maiores, mais comprimentos de onda e conversores melhores, esses processadores tensoriais baseados em luz podem oferecer motores de IA ultra‑rápidos e de baixa latência que complementam ou, em alguns casos, descarregam trabalho de chips convencionais, ajudando sistemas futuros a lidar com cargas de trabalho de IA cada vez maiores com mais eficiência.

Citação: Meyer, L., Dijkstra, J., Tebeck, S. et al. Deep neural network inference on an integrated, reconfigurable photonic tensor processor. Nat Commun 17, 3396 (2026). https://doi.org/10.1038/s41467-026-71599-2

Palavras-chave: computação fotônica, acelerador óptico de IA, redes neurais profundas, fotônica em silício, processamento tensorial