Clear Sky Science · nl

Diepe neurale netwerkinferentie op een geïntegreerde, herconfigureerbare fotonische tensorprocessor

Waarom snellere denkende machines ertoe doen

Elke keer dat u uw telefoon ontgrendelt met uw gezicht, met een spraakassistent praat of ziet hoe een AI‑systeem objecten in een video detecteert, vinden er achter de schermen enorme hoeveelheden rekenwerk plaats. Naarmate deze kunstmatige‑intelligentie‑modellen groter en capabeler worden, vragen ze meer energie, meer hardware en meer tijd. Dit artikel onderzoekt een nieuw soort "optisch brein" dat licht in plaats van alleen elektriciteit gebruikt om deze zware berekeningen uit te voeren, met als doel toekomstige AI zowel sneller als energiezuiniger te maken.

Licht als een nieuwe manier om te rekenen

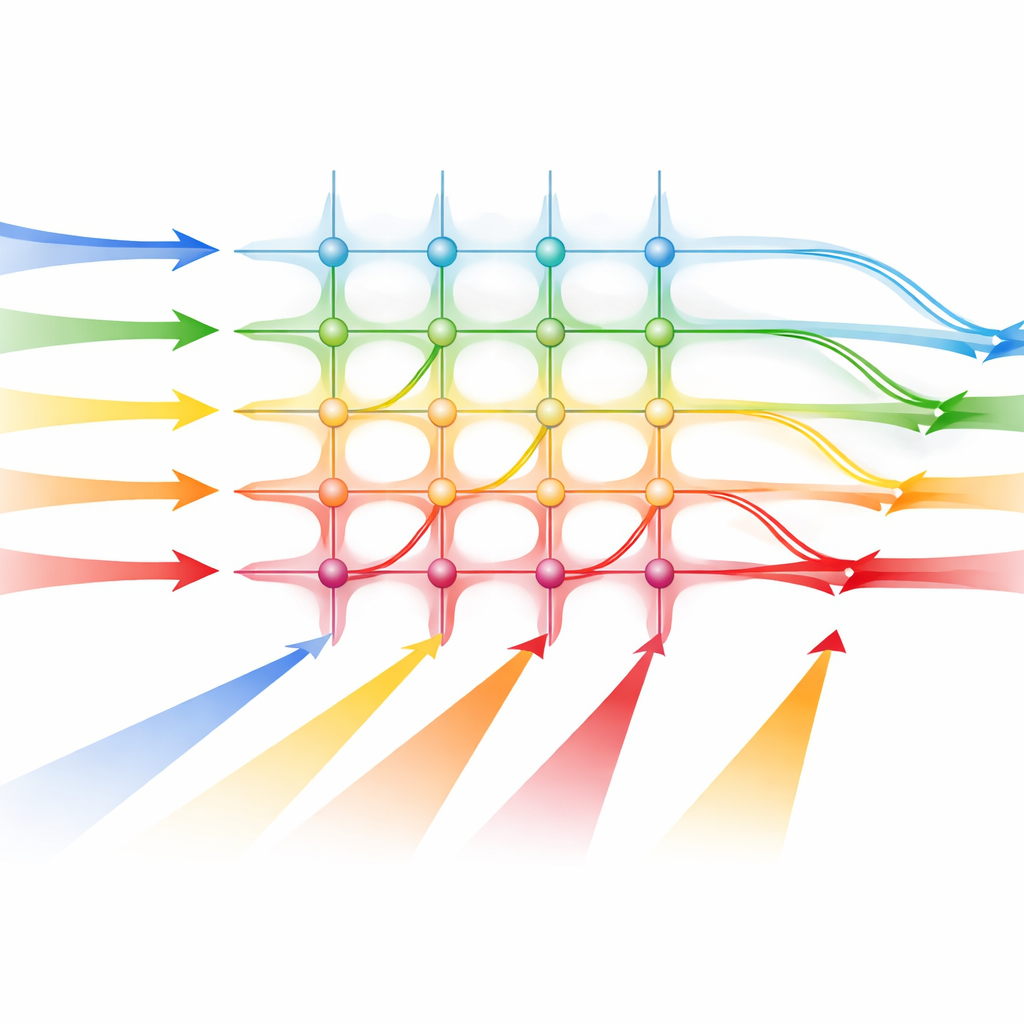

Moderne AI wordt aangedreven door diepe neurale netwerken, die neerkomen op herhaalde toepassing van vergelijkbare wiskundige bewerkingen op grote tabellen met getallen, tensoren genoemd. Tegenwoordig draaien deze bewerkingen op elektronische chips zoals GPU's, die de grenzen van snelheid en energieverbruik naderen. De auteurs wenden zich tot fotonica—het gebruik van licht in kleine on‑chip structuren—om dezezelfde bewerkingen uit te voeren. Omdat licht snel kan reizen en in veel kanalen tegelijk benut kan worden, kan een fotonische processor in principe veel berekeningen parallel uitvoeren met zeer weinig vertraging, terwijl sommige energieverliezen die conventionele elektronica plagen worden vermeden.

Het bouwen van een door licht aangedreven rekenmotor

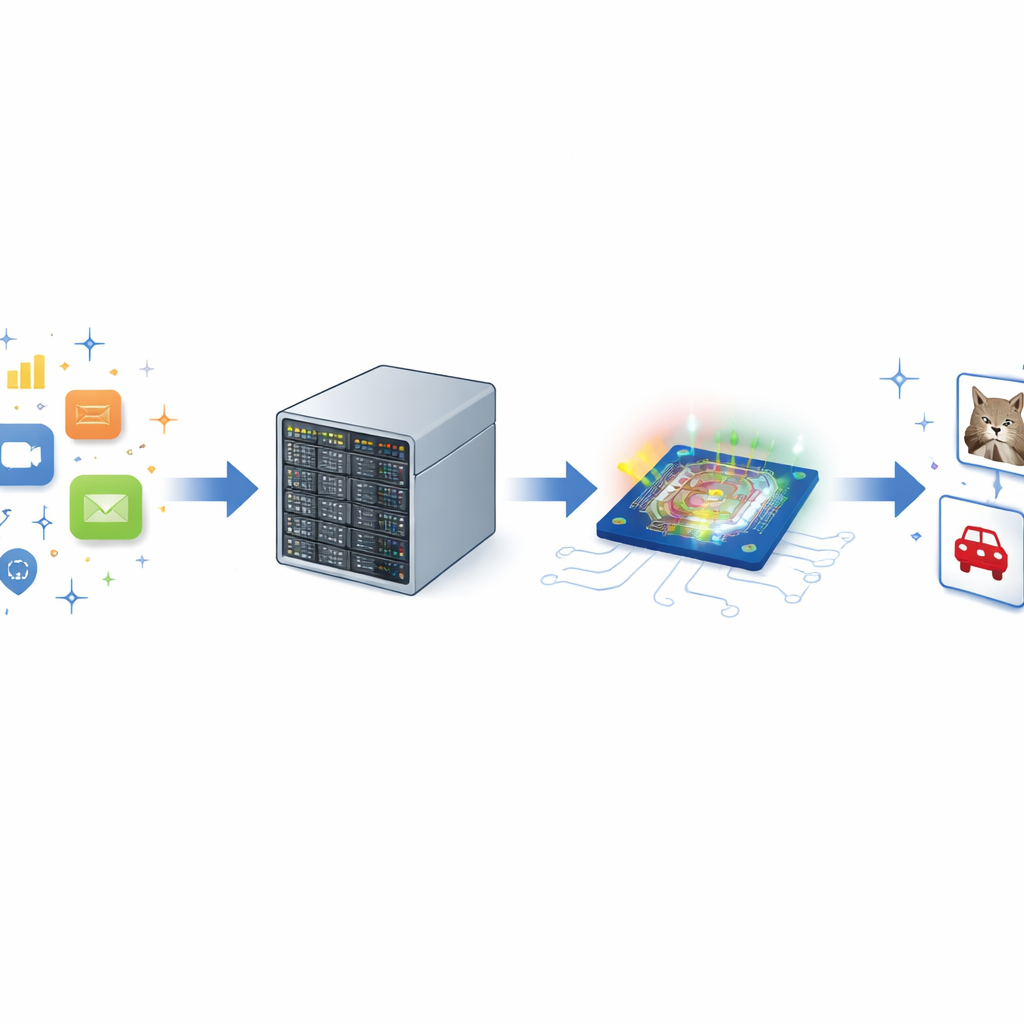

Het team ontwierp een fotonische tensorprocessor die in een standaard 19‑inch computerrack past, waardoor hij lijkt op andere serverhardware. In het hart zit een siliciumfotonische chip vervaardigd met een industriëel productieproces, wat de kans vergroot dat zulke apparaten uiteindelijk op schaal geproduceerd kunnen worden. Op deze chip worden binnenkomende elektrische signalen die data representeren omgezet in lichtpatronen met behulp van speciale modulatoren. Deze lichtsignalen reizen vervolgens door een raster van kleine golfgeleiders dat functioneert als een matrix van verstelbare verbindingen, waarbij elk kruispunt het passerende licht kan versterken of verzwakken. Aan het eind van elke kolom zetten ingebouwde lichtsensoren de gecombineerde helderheid weer om in elektrische signalen die overeenkomen met het resultaat van een matrix‑vectorvermenigvuldiging, de kernbewerking in veel lagen van neurale netwerken.

Het licht stabiel houden en de wiskunde nauwkeurig

Om de chip te voeden gebruiken de onderzoekers één geavanceerde lichtbron genaamd een microcomb, die tegelijk veel gelijkmatig verdeelde lichtkleuren produceert. Elke kleur dient als een afzonderlijk kanaal dat een deel van de invoerdata draagt, waardoor meerdere berekeningen parallel kunnen verlopen. Het werken met analoge lichtsignalen introduceert echter ruis en onvolkomenheden. De auteurs pakken dit aan met zorgvuldige kalibratie: ze meten hoe elke modulator en detector reageert en stellen vervolgens de stuurspanningen en vermogensniveaus af zodat een gewenste wiskundige gewicht samenvalt met een specifieke optische instelling. Ze compenseren ook voor crosstalk tussen kanalen en voor vervormingen geïntroduceerd door de optische behuizing. Door waar nodig herhaalde metingen te middelen, kunnen ze wat extra tijd inruilen voor hogere nauwkeurigheid.

Reële AI‑taken uitvoeren met licht

Om te laten zien dat hun systeem geen loutere labcuriositeit is, sluit het team de fotonische processor direct aan op PyTorch, een veelgebruikt AI‑softwareframework. Ze trainen twee beeldherkenningsnetwerken digitaal en verfijnen ze vervolgens door het soort ruis dat de hardware zal inbrengen te modelleren. Zodra ze getraind zijn, draaien dezelfde netwerken op de fotonische processor zonder dat ze voor de chip opnieuw ontworpen hoeven te worden. Op de eenvoudige handschriftcijferset MNIST bereikt het optische systeem ongeveer 98,1% nauwkeurigheid in een hogere‑precisie modus en 91% in een lage‑latentie modus, dicht bij de volledig digitale referentie. Op de zwaardere CIFAR‑10 dataset met kleurbeelden behaalt het 72% nauwkeurigheid in de precisie‑modus—lager dan de digitale versie maar nog steeds praktische prestaties op een moeilijkere taak demonstrerend.

Wat dit betekent voor de toekomst van AI‑hardware

Hoewel de huidige prototype minder energie‑efficiënt is dan de meest geavanceerde elektronische versnellers, wordt het grootste deel van het vermogen besteed aan ondersteunende elektronica, niet aan de optische kern zelf. De resultaten laten zien dat een programmeerbare, rack‑montabele fotonische processor bijna al het zware lineaire algebra‑werk in echte neurale netwerken kan uitvoeren, met stabiele prestaties in de tijd en een instelbare balans tussen snelheid en nauwkeurigheid. Naarmate de technologie opschaalt naar grotere optische kernen, meer golflengten en betere omzetters, zouden dergelijke op licht gebaseerde tensorprocessors extreem snelle, lage‑latentie AI‑motoren kunnen bieden die conventionele chips aanvullen of in sommige gevallen werk kunnen uitbesteden, en zo toekomstige systemen helpen om steeds groeiende AI‑werklasten efficiënter aan te kunnen.

Bronvermelding: Meyer, L., Dijkstra, J., Tebeck, S. et al. Deep neural network inference on an integrated, reconfigurable photonic tensor processor. Nat Commun 17, 3396 (2026). https://doi.org/10.1038/s41467-026-71599-2

Trefwoorden: fotonisch rekenen, optische AI‑versneller, diepe neurale netwerken, siliciumfotonica, tensorverwerking