Clear Sky Science · pl

Wnioskowanie głębokiej sieci neuronowej na zintegrowanym, rekonfigurowalnym fotonicznym procesorze tensorowym

Dlaczego szybsze maszyny myślące mają znaczenie

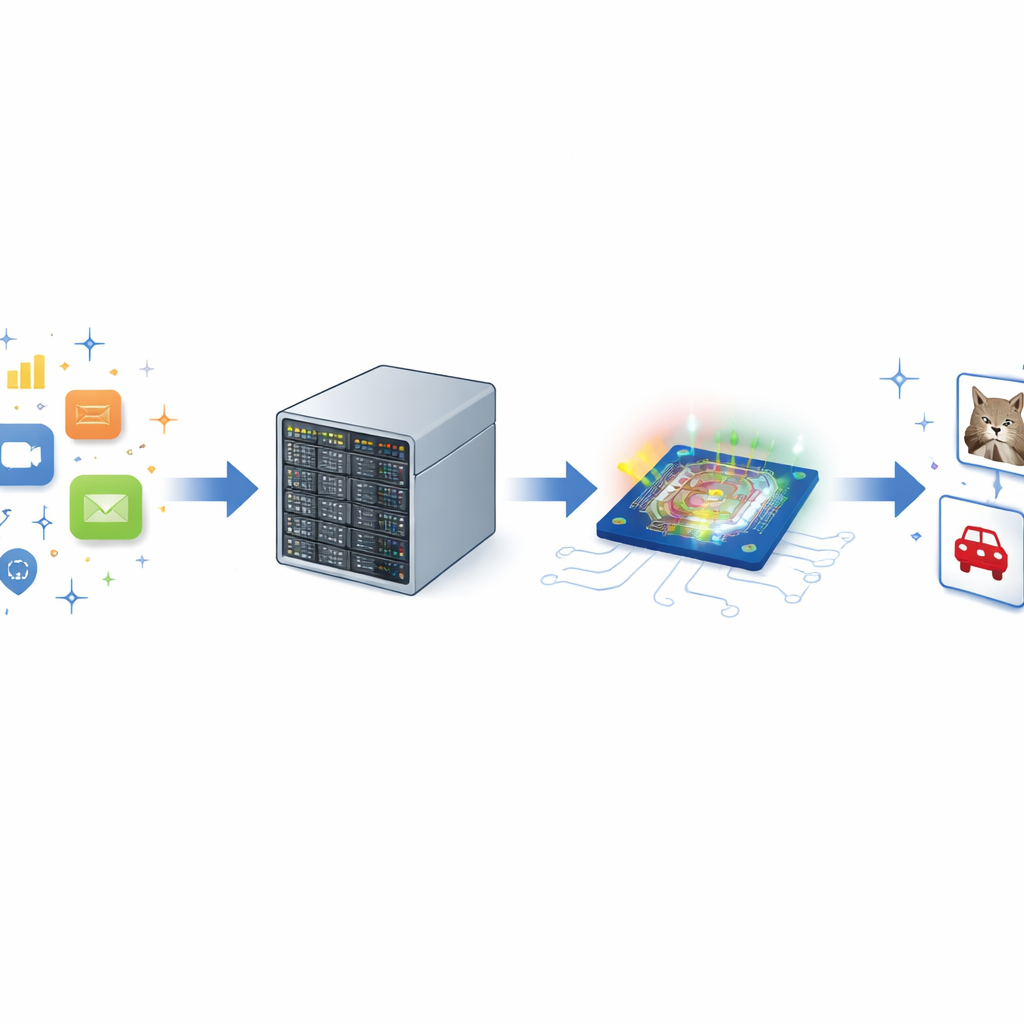

Za każdym razem, gdy odblokowujesz telefon twarzą, rozmawiasz z asystentem głosowym lub widzisz system AI wykrywający obiekty na wideo, w tle zachodzi ogromna ilość obliczeń. W miarę jak te modele sztucznej inteligencji rosną i stają się bardziej zaawansowane, wymagają więcej energii, więcej sprzętu i więcej czasu. Ten artykuł przedstawia nowy rodzaj „optycznego mózgu”, który wykorzystuje światło zamiast wyłącznie elektryczności do wykonywania ciężkich obliczeń, dążąc do tego, by przyszłe systemy AI były jednocześnie szybsze i bardziej energooszczędne.

Światło jako nowy sposób obliczania

Nowoczesne AI opiera się na głębokich sieciach neuronowych, które sprowadzają się do wielokrotnego stosowania podobnych operacji matematycznych na dużych tablicach liczb, zwanych tensorami. Dziś operacje te wykonują układy elektroniczne, takie jak GPU, które napotykają ograniczenia prędkości i zużycia energii. Autorzy zwracają się ku fotonice — wykorzystaniu światła w maleńkich strukturach na chipie — aby wykonywać te same operacje. Ponieważ światło może poruszać się bardzo szybko i w wielu kanałach jednocześnie, procesor fotoniczny może w zasadzie przeprowadzać wiele obliczeń równolegle z bardzo niskim opóźnieniem, unikając niektórych strat energii charakterystycznych dla konwencjonalnej elektroniki.

Budowanie silnika matematycznego napędzanego światłem

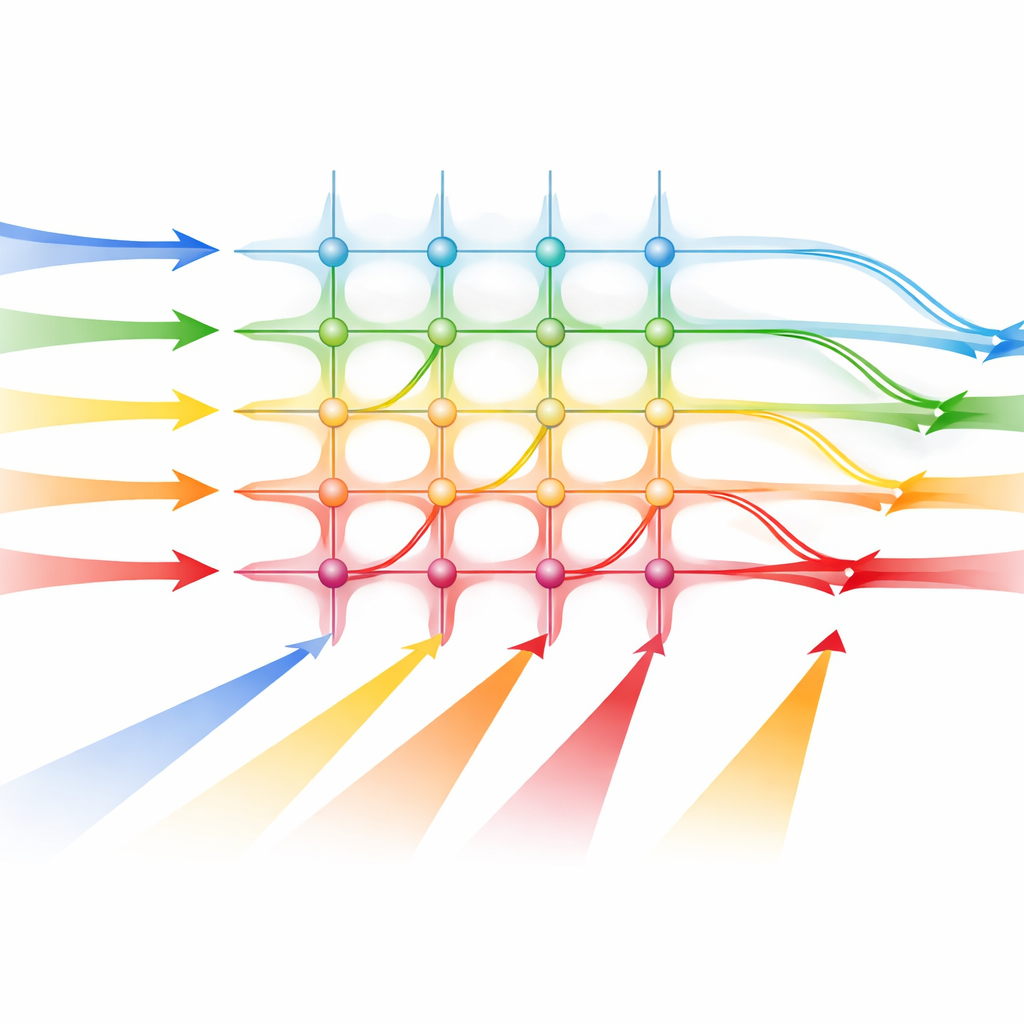

Zespół zaprojektował fotoniczny procesor tensorowy mieszczący się w standardowej szafie serwerowej 19 cali, dzięki czemu przypomina inne urządzenia serwerowe. W jego sercu znajduje się krzemowy układ fotoniczny wyprodukowany przemysłowym procesem wytwarzania, co zwiększa szanse na późniejszą produkcję na skalę przemysłową. Na tym układzie przychodzące sygnały elektryczne reprezentujące dane są przekształcane w wzory światła za pomocą specjalnych modulatorów. Te sygnały świetlne przemieszczają się następnie przez siatkę drobnych falowodów działających jak macierz regulowanych połączeń, gdzie każde skrzyżowanie może wzmocnić lub osłabić przechodzące światło. Na końcu każdej kolumny wbudowane detektory światła przekształcają zsumowaną jasność z powrotem w sygnały elektryczne odpowiadające wynikowi mnożenia macierzy przez wektor — podstawowej operacji w wielu warstwach sieci neuronowych.

Utrzymanie stabilności światła i dokładności obliczeń

Aby zasilić chip, badacze używają pojedynczego zaawansowanego źródła światła zwanego mikrogrzebieniem (microcomb), które generuje wiele równomiernie rozstawionych kolorów światła jednocześnie. Każdy kolor służy jako oddzielny kanał przenoszący część danych wejściowych, co pozwala na równoległe wykonywanie wielu obliczeń. Jednak praca z analogowymi sygnałami świetlnymi wprowadza szumy i niedoskonałości. Autorzy radzą sobie z tym poprzez staranną kalibrację: mierzą, jak reaguje każdy modulator i detektor, a następnie dostosowują napięcia sterujące i poziomy mocy, tak by pożądana waga matematyczna odpowiadała konkretnej nastawie optycznej. Kompensują też przesłuchy między kanałami i zniekształcenia wprowadzone przez opakowanie optyczne. Uśredniając powtarzane pomiary w razie potrzeby, mogą poświęcić trochę czasu na rzecz wyższej dokładności.

Uruchamianie prawdziwych zadań AI za pomocą światła

Aby pokazać, że ich system nie jest tylko ciekawostką laboratoryjną, zespół podłączył procesor fotoniczny bezpośrednio do PyTorch, powszechnie używanego frameworka AI. Trenują cyfrowo dwie sieci rozpoznające obrazy, a następnie dostrajają je, modelując rodzaj szumów, jakie wprowadzi sprzęt. Po treningu te same sieci działają na procesorze fotonicznym bez konieczności przeprojektowywania ich pod chip. Na prostym zbiorze cyfr ręcznie pisanych MNIST system optyczny osiąga około 98,1% dokładności w trybie wyższej precyzji oraz 91% w trybie niskiego opóźnienia, zbliżając się do cyfrowego punktu odniesienia. Na bardziej wymagającym zbiorze kolorowych obrazów CIFAR-10 osiąga 72% dokładności w trybie precyzyjnym — mniej niż wersja cyfrowa, ale nadal wykazując praktyczną wydajność w trudniejszym zadaniu.

Co to oznacza dla przyszłości sprzętu AI

Chociaż obecny prototyp jest mniej energooszczędny niż najnowocześniejsze elektroniczne akceleratory, większość jego poboru mocy idzie na elektronikę pomocniczą, a nie na sam rdzeń optyczny. Wyniki pokazują, że programowalny, montowany w szafie procesor fotoniczny może wykonać niemal całą ciężką algebrę liniową w rzeczywistych sieciach neuronowych, zapewniając stabilne działanie w czasie i regulowany kompromis między szybkością a dokładnością. W miarę jak technologia będzie się skalować do większych rdzeni optycznych, większej liczby długości fal i lepszych konwerterów, takie procesory tensorowe oparte na świetle mogą zaoferować ultrajasne, niskoopóźnieniowe silniki AI, które będą uzupełnieniem lub w niektórych przypadkach odciążeniem konwencjonalnych chipów, pomagając przyszłym systemom bardziej efektywnie obsługiwać rosnące obciążenia związane z AI.

Cytowanie: Meyer, L., Dijkstra, J., Tebeck, S. et al. Deep neural network inference on an integrated, reconfigurable photonic tensor processor. Nat Commun 17, 3396 (2026). https://doi.org/10.1038/s41467-026-71599-2

Słowa kluczowe: obliczenia fotoniczne, optyczny akcelerator AI, głębokie sieci neuronowe, fotonyka krzemowa, przetwarzanie tensorów