Clear Sky Science · pt

Aquecimento inspirado no cérebro com ruído aleatório para calibração de incerteza

Por que IAs mais inteligentes precisam saber quando podem estar erradas

Os sistemas modernos de inteligência artificial conseguem reconhecer imagens, dirigir veículos e conversar em linguagem natural com habilidade impressionante. Ainda assim, frequentemente têm uma falha perigosa: podem estar completamente errados enquanto demonstram extrema certeza. Esse descompasso entre confiança e correção pode levar a decisões médicas equivocadas, comportamento inseguro em veículos autônomos ou chatbots que inventam fatos de forma convincente. O artigo "Brain-inspired warm-up training with random noise for uncertainty calibration" explora uma maneira surpreendentemente simples e inspirada na biologia para ensinar aos modelos de IA um hábito crucial, parecido com o humano: expressar incerteza quando realmente não sabem.

Quando confiança e realidade se separam

Os autores começam examinando como as redes neurais atuais reportam confiança. Um classificador treinado em imagens naturais não apenas prevê o que vê, mas também fornece uma probabilidade de que sua resposta esteja correta. Idealmente, se um modelo diz estar 80% confiante, deveria estar certo cerca de 80% das vezes. Na prática, os pesquisadores mostram que, à medida que as redes ficam mais profundas e são treinadas com dados limitados, sua confiança fica inflada: frequentemente atribuem altíssima certeza a respostas erradas. Esse problema piora ainda mais quando o modelo encontra imagens que nunca viu durante o treinamento — uma situação conhecida como dados fora-da-distribuição — nas quais ele continua excessivamente seguro em vez de admitir incerteza.

Um aquecimento emprestado do cérebro em desenvolvimento

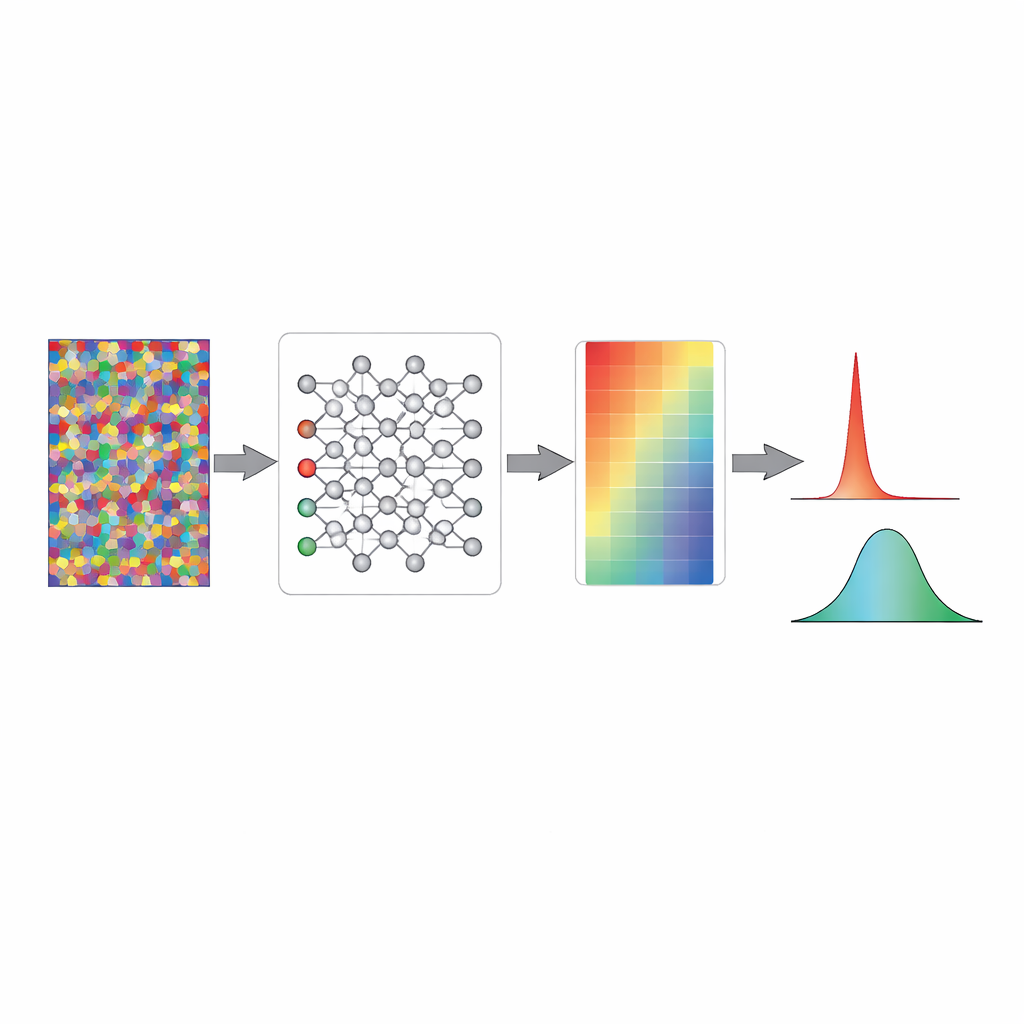

Para enfrentar isso, o estudo se volta para a biologia. Antes do nascimento, cérebros de animais já estão ativos, disparando padrões espontâneos de atividade elétrica muito antes de chegarem estímulos visuais e sonoros significativos. Neurocientistas acreditam que esse "ruído" inicial ajuda a conectar os circuitos de modo que fiquem prontos para a experiência sensorial real. Inspirados por isso, os autores propõem uma fase de aquecimento para redes artificiais: antes de ver quaisquer imagens ou rótulos reais, o modelo é brevemente treinado com padrões de entrada completamente aleatórios emparelhados a rótulos aleatórios e sem sentido. À primeira vista, isso parece inútil — a rede não pode aprender algo útil a partir de puro ruído. Ainda assim, durante essa curta fase, suas respostas internas se estabilizam em um estado em que as probabilidades de saída se distribuem de maneira uniforme, correspondendo ao acaso em vez de à excesso de confiança.

Como o ruído aleatório torna a confiança honesta

Usando modelos simplificados e classificadores de imagem completos, os pesquisadores mostram o que esse aquecimento faz nos bastidores. Em uma rede padrão inicializada aleatoriamente, os sinais matemáticos imediatamente antes da camada de decisão final frequentemente apresentam grandes oscilações, que a função softmax converte em probabilidades extremas próximas de zero ou um. Isso significa que um modelo não treinado já se comporta como se tivesse muita certeza, mesmo sem conhecimento. O treinamento com ruído aleatório reescala suavemente esses sinais internos, trazendo-os para uma faixa em que as probabilidades de saída se agrupam próximas ao nível do acaso. Os pesos em si mudam muito pouco; em vez disso, o padrão geral de atividade é "pré-calibrado" de modo que, antes do início do aprendizado real, o modelo naturalmente expressa incerteza máxima sobre entradas desconhecidas.

Melhor comportamento em dados reais e desconhecidos

Uma vez concluído esse aquecimento inspirado no cérebro, as mesmas redes são treinadas em conjuntos de imagens reais usando métodos padrão. Em diversas arquiteturas — desde redes feed-forward simples até modelos populares como ResNet, DenseNet e transformers de visão — as redes treinadas com ruído mantêm uma correspondência mais próxima entre confiança e acurácia real ao longo do aprendizado. Elas têm desempenho tão bom quanto ou ligeiramente melhor que redes inicializadas de forma convencional em conjuntos de teste padrão, mas suas pontuações de confiança são muito mais confiáveis. Crucialmente, quando expostas a imagens verdadeiramente desconhecidas, esses modelos pré-calibrados atribuem baixa confiança que paira perto do acaso, em vez de rotulá-las com segurança equivocada. Essa propriedade simples melhora dramaticamente sua capacidade de detectar quando uma entrada é "desconhecida" — um requisito chave para implantação segura em ambientes reais.

Fundamentos para uma IA mais confiável

Em termos simples, o estudo mostra que um aquecimento muito curto e barato com ruído aleatório pode ensinar às redes neurais uma espécie de humildade desde o início. Em vez de começar a vida como adivinhos excessivamente confiantes, os modelos partem de um estado cauteloso em que admitem não saber, e só aumentam a confiança à medida que acumulam evidências reais. Essa abordagem evita etapas extras de pós-processamento, funciona em muitos tipos de modelos e tamanhos de dados, e ecoa como cérebros biológicos parecem se preparar antes do nascimento. Se amplamente adotado, esse treinamento de aquecimento inspirado no cérebro poderia ajudar os sistemas de IA a se tornarem não apenas precisos, mas também adequadamente conscientes de seus próprios limites — um passo essencial para torná-los parceiros mais seguros e confiáveis nas decisões do dia a dia.

Citação: Cheon, J., Paik, SB. Brain-inspired warm-up training with random noise for uncertainty calibration. Nat Mach Intell 8, 602–613 (2026). https://doi.org/10.1038/s42256-026-01215-x

Palavras-chave: calibração de incerteza, redes neurais, aquecimento com ruído aleatório, detecção fora-da-distribuição, IA inspirada no cérebro