Clear Sky Science · nl

Hersengeïnspireerde warming-uptraining met willekeurige ruis voor onzekerheidskalibratie

Waarom slimmere AI moet weten wanneer het mogelijk fout zit

Moderne kunstmatige intelligencesystemen kunnen beelden herkennen, auto’s besturen en op indrukwekkende wijze in natuurlijke taal converseren. Toch hebben ze vaak een gevaarlijke blinde vlek: ze kunnen er volledig naast zitten terwijl ze extreem zeker overkomen. Deze discrepantie tussen vertrouwen en correctheid kan leiden tot slechte medische beslissingen, onveilig gedrag van autonome voertuigen of chatbots die overtuigend feiten verzinnen. Het artikel "Brain-inspired warm-up training with random noise for uncertainty calibration" onderzoekt een verrassend eenvoudige, biologisch geïnspireerde manier om AI-modellen een cruciale, mensachtige gewoonte bij te brengen: onzekerheid uiten wanneer ze het echt niet weten.

Wanneer vertrouwen en realiteit uit elkaar drijven

De auteurs beginnen met het bekijken van hoe hedendaagse neurale netwerken vertrouwen rapporteren. Een classifier die op natuurlijke beelden is getraind voorspelt niet alleen wat hij ziet, maar ook een waarschijnlijkheid dat zijn antwoord correct is. Ideaal gezien geldt: als een model aangeeft 80% zeker te zijn, zou het in ongeveer 80% van de gevallen gelijk moeten hebben. In de praktijk tonen de onderzoekers aan dat naarmate netwerken dieper worden en op beperkte data worden getraind, hun vertrouwen opgeblazen raakt: ze wijzen vaak zeer hoge zekerheid toe aan foutieve antwoorden. Dit probleem wordt nog groter wanneer het model beelden tegenkomt die het nooit tijdens de training heeft gezien — een situatie die bekendstaat als out-of-distribution data — waarbij het nog steeds overdreven zeker doet in plaats van onzekerheid toe te geven.

Een warming-up ontleend aan het zich ontwikkelende brein

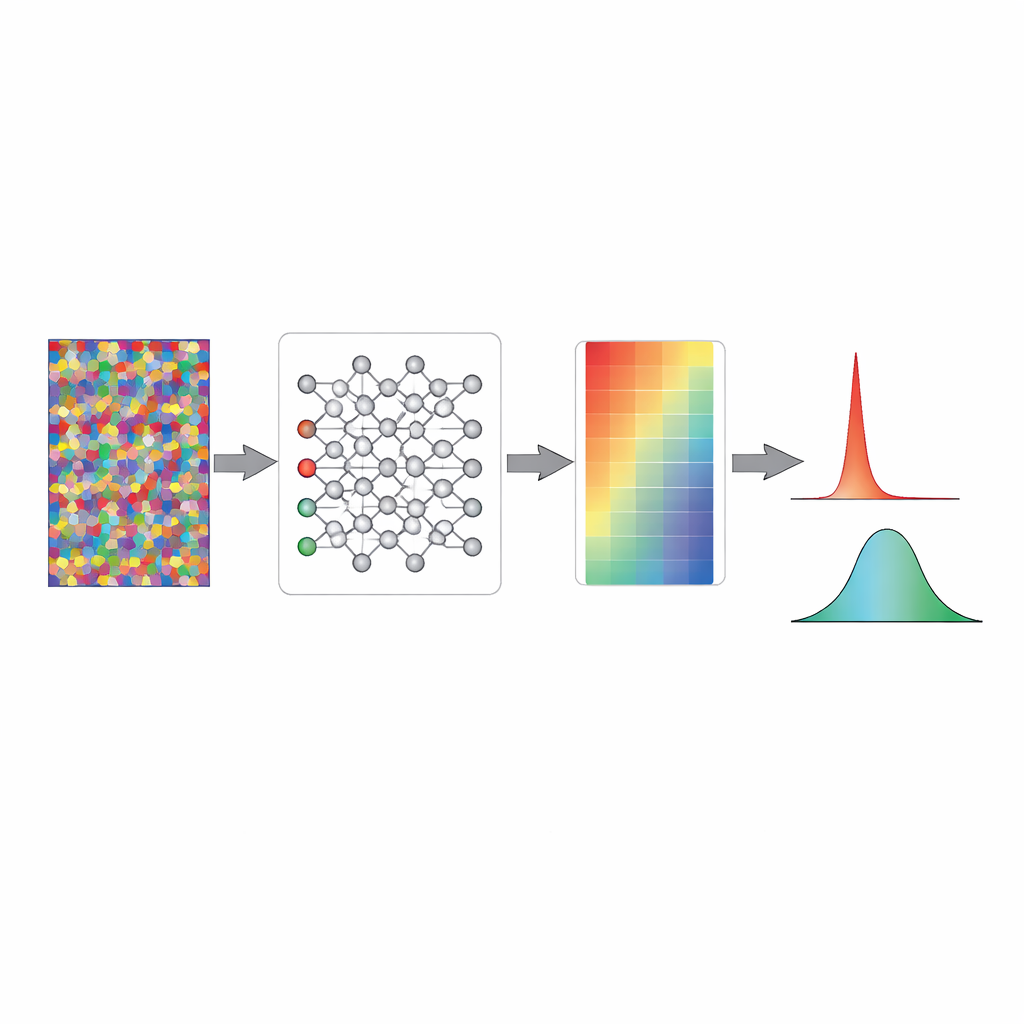

Om dit aan te pakken kijkt de studie naar de biologie. Al voor de geboorte zijn dierenhersenen actief en vuren ze spontane patronen van elektrische activiteit, lang voordat betekenisvolle beelden en geluiden binnenkomen. Neurowetenschappers denken dat deze vroege "ruis" helpt bij het aanschakelen van circuitconnecties zodat ze klaar zijn voor echte sensorische ervaring. Geïnspireerd door dit idee stellen de auteurs een warming-upfase voor kunstmatige netwerken voor: voordat ze echte beelden of labels zien, wordt het model kort getraind op volledig willekeurige inputpatronen gekoppeld aan willekeurige, betekenisloze labels. Op het eerste gezicht lijkt dit zinloos — het netwerk kan niets bruikbaars leren van pure ruis. Toch laten ze zien dat tijdens deze korte fase de interne responsen zich stabiliseren naar een toestand waarin de uitvoerprobabiliteiten gelijkmatig verdeeld zijn, overeenkomend met puur toeval in plaats van overmatig vertrouwen.

Hoe willekeurige ruis vertrouwen eerlijk maakt

Aan de hand van vereenvoudigde toyscenario’s en volledige beeldclassifiers tonen de onderzoekers wat deze warming-up onder de motorkap doet. In een standaard willekeurig geïnitialiseerd netwerk hebben de wiskundige signalen net vóór de laatste beslissingslaag vaak grote schommelingen, die de softmax-functie omzet in extreme kansen dicht bij nul of één. Dit betekent dat een ongetraind model al gedraagt alsof het erg zeker is, ondanks dat het niets weet. Training op willekeurige ruis schaalt die interne signalen zachtjes terug en trekt ze naar een bereik waarin de uitvoerprobabiliteiten zich clusteren rond het kansniveau. De gewichten zelf veranderen nauwelijks; in plaats daarvan wordt het algemene activiteits patroon "voorgekalibreerd" zodat het model, voordat echte training begint, van nature maximale onzekerheid uitdrukt over onbekende inputs.

Betere prestaties op echte en onbekende data

Nadat deze hersengeïnspireerde warming-up is voltooid, worden dezelfde netwerken met standaardmethoden op echte afbeeldingsdatasets getraind. Over veel architecturen heen — van eenvoudige feedforward-netwerken tot populaire ResNet-, DenseNet- en vision-transformer-modellen — behouden de op ruis getrainde netwerken een nauwere overeenstemming tussen vertrouwen en werkelijke nauwkeurigheid tijdens het leren. Ze presteren even goed als of iets beter dan conventioneel geïnitialiseerde netwerken op standaard testsets, maar hun betrouwbaarheidscores zijn veel vertrouwder. Cruciaal is dat wanneer ze echt onbekende beelden te zien krijgen, deze voorgekalibreerde modellen lage vertrouwenstoewijzingen geven die dicht bij toeval zweven, in plaats van ze vol vertrouwen foutief te labelen. Deze eenvoudige eigenschap verbetert drastisch hun vermogen om te detecteren wanneer een input "onbekend" is — een sleutelvereiste voor veilige inzet in de praktijk.

Fundament voor betrouwbaardere AI

In eenvoudige bewoordingen laat de studie zien dat een zeer korte, goedkope warming-up met willekeurige ruis neurale netwerken vanaf het begin een soort bescheidenheid kan aanleren. In plaats van het leven te beginnen als overmoedige gokkers, starten modellen in een voorzichtige toestand en geven ze toe dat ze het niet weten, waarna ze hun vertrouwen alleen opbouwen naarmate ze echte bewijzen verzamelen. Deze aanpak vermijdt extra naverwerkingsstappen, werkt over veel modeltypen en datagroottes heen, en weerspiegelt hoe biologische hersenen zich lijken voor te bereiden vóór de geboorte. Als deze methode breed wordt toegepast, zou zo’n hersengeïnspireerde warming-uptraining AI-systemen kunnen helpen niet alleen nauwkeuriger te worden, maar ook passend bewust van hun eigen beperkingen — een essentiële stap om ze veiliger en betrouwbaarder te maken als partners in alledaagse besluitvorming.

Bronvermelding: Cheon, J., Paik, SB. Brain-inspired warm-up training with random noise for uncertainty calibration. Nat Mach Intell 8, 602–613 (2026). https://doi.org/10.1038/s42256-026-01215-x

Trefwoorden: onzekerheidskalibratie, neurale netwerken, willekeurige ruis warming-up, detectie van out-of-distribution, hersengeïnspireerde AI