Clear Sky Science · fr

Entraînement d'échauffement inspiré du cerveau avec bruit aléatoire pour la calibration de l'incertitude

Pourquoi une IA plus intelligente doit savoir quand elle peut se tromper

Les systèmes d'intelligence artificielle modernes peuvent reconnaître des images, conduire des voitures et converser en langage naturel avec une habileté impressionnante. Pourtant, ils présentent souvent un angle mort dangereux : ils peuvent avoir complètement tort tout en étant extrêmement sûrs d'eux. Ce décalage entre confiance et exactitude peut entraîner de mauvaises décisions médicales, des comportements dangereux pour la conduite autonome ou des chatbots inventant des faits de manière convaincante. L'article « Brain-inspired warm-up training with random noise for uncertainty calibration » explore une méthode étonnamment simple, inspirée biologiquement, pour enseigner aux modèles d'IA une habitude humaine cruciale : exprimer de l'incertitude lorsqu'ils ne savent réellement pas.

Quand confiance et réalité divergent

Les auteurs commencent par examiner comment les réseaux neuronaux actuels rendent compte de leur confiance. Un classificateur entraîné sur des images naturelles prédit non seulement ce qu'il voit, mais donne aussi une probabilité que sa réponse soit correcte. Idéalement, si un modèle dit être sûr à 80 %, il devrait avoir raison environ 80 % du temps. En pratique, les chercheurs montrent que lorsque les réseaux deviennent plus profonds et sont entraînés sur des données limitées, leur confiance devient exagérée : ils attribuent fréquemment une très grande certitude à des réponses erronées. Ce problème s'aggrave encore lorsque le modèle rencontre des images qu'il n'a jamais vues pendant l'entraînement — une situation connue sous le nom de données hors distribution — où il reste excessivement sûr au lieu d'admettre son incertitude.

Un échauffement emprunté au cerveau en développement

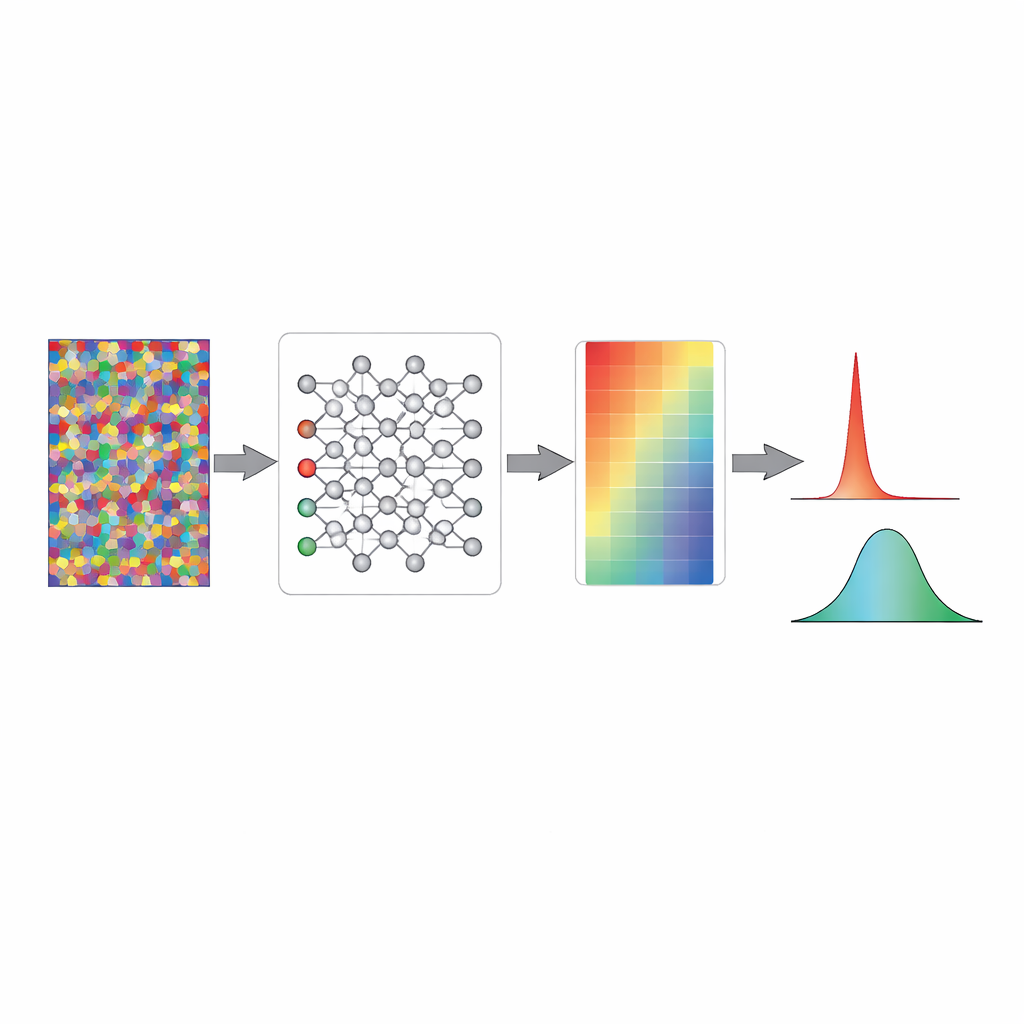

Pour y remédier, l'étude s'inspire de la biologie. Avant la naissance, les cerveaux d'animaux sont déjà actifs, générant des motifs spontanés d'activité électrique bien avant l'arrivée de sons et d'images significatifs. Les neuroscientifiques pensent que ce « bruit » précoce aide à câbler les circuits pour qu'ils soient prêts à l'expérience sensorielle réelle. Inspirés par cela, les auteurs proposent une phase d'échauffement pour les réseaux artificiels : avant de voir de vraies images ou étiquettes, le modèle est brièvement entraîné sur des motifs d'entrée complètement aléatoires associés à des étiquettes aléatoires et dépourvues de sens. À première vue, cela paraît inutile — le réseau ne peut rien apprendre d'utile à partir du bruit pur. Pourtant, durant cette courte phase, ses réponses internes se stabilisent dans un état où ses probabilités de sortie sont réparties de manière égale, correspondant au pur hasard plutôt qu'à une confiance excessive.

Comment le bruit aléatoire rend la confiance honnête

En utilisant des modèles jouets simplifiés et des classificateurs d'images complets, les chercheurs montrent ce que fait cet échauffement sous le capot. Dans un réseau standard initialisé aléatoirement, les signaux mathématiques juste avant la couche de décision finale présentent souvent de fortes variations, que la fonction softmax convertit en probabilités extrêmes proches de zéro ou de un. Cela signifie qu'un modèle non entraîné se comporte déjà comme s'il était très sûr, bien qu'il ne sache rien. L'entraînement sur du bruit aléatoire redimensionne doucement ces signaux internes, les ramenant dans une plage où les probabilités de sortie se regroupent autour du niveau de hasard. Les poids eux-mêmes changent à peine ; c'est plutôt le motif global d'activité qui est « pré-calibré » de sorte que, avant le véritable apprentissage, le modèle exprime naturellement une incertitude maximale face à des entrées inconnues.

Meilleur comportement sur données connues et inconnues

Une fois cet échauffement inspiré du cerveau achevé, les mêmes réseaux sont entraînés sur des jeux d'images réels selon des méthodes standard. Sur de nombreuses architectures — des réseaux feed-forward simples aux modèles populaires ResNet, DenseNet et vision transformer —, les réseaux entraînés au bruit conservent une correspondance plus étroite entre confiance et précision réelle tout au long de l'apprentissage. Ils performent aussi bien ou légèrement mieux que des réseaux initialisés de façon conventionnelle sur les jeux de test standard, mais leurs scores de confiance sont bien plus fiables. De manière cruciale, lorsqu'on leur montre des images véritablement inconnues, ces modèles pré-calibrés attribuent une faible confiance qui flotte près du niveau du hasard, au lieu de les étiqueter avec assurance. Cette propriété simple améliore de façon spectaculaire leur capacité à détecter lorsqu'une entrée est « inconnue » — une exigence clé pour un déploiement sûr sur le terrain.

Fondations pour une IA plus digne de confiance

En termes simples, l'étude montre qu'un très court échauffement peu coûteux sur du bruit aléatoire peut enseigner aux réseaux neuronaux une forme d'humilité dès le départ. Plutôt que de commencer leur existence en tant que devineurs trop confiants, les modèles débutent dans un état prudent où ils admettent ne pas savoir, puis ajustent leur confiance vers le haut uniquement à mesure qu'ils accumulent de réelles preuves. Cette approche évite des étapes de post-traitement supplémentaires, fonctionne sur de nombreux types de modèles et tailles de données, et fait écho à la façon dont les cerveaux biologiques semblent se préparer avant la naissance. Si elle était largement adoptée, une telle formation d'échauffement inspirée du cerveau pourrait aider les systèmes d'IA à devenir non seulement précis, mais aussi conscients de leurs propres limites — une étape essentielle pour en faire des partenaires plus sûrs et plus fiables dans la prise de décision quotidienne.

Citation: Cheon, J., Paik, SB. Brain-inspired warm-up training with random noise for uncertainty calibration. Nat Mach Intell 8, 602–613 (2026). https://doi.org/10.1038/s42256-026-01215-x

Mots-clés: calibration de l'incertitude, réseaux neuronaux, échauffement par bruit aléatoire, détection hors distribution, IA inspirée du cerveau