Clear Sky Science · de

Gehirn‑inspiriertes Aufwärmtraining mit zufälligem Rauschen zur Kalibrierung von Unsicherheit

Warum klügere KI wissen muss, wann sie sich irren könnte

Moderne künstliche Intelligenzsysteme können Bilder erkennen, Autos steuern und in natürlicher Sprache beeindruckend kommunizieren. Dennoch haben sie oft eine gefährliche Schwachstelle: Sie können völlig falsch liegen und dabei extrem sicher auftreten. Diese Diskrepanz zwischen Selbstsicherheit und Richtigkeit kann zu schlechten medizinischen Entscheidungen, unsicherem Verhalten autonomer Fahrzeuge oder zu Chatbots führen, die überzeugend Fakten erfinden. Die Studie „Gehirn‑inspiriertes Aufwärmtraining mit zufälligem Rauschen zur Kalibrierung von Unsicherheit“ untersucht eine überraschend einfache, biologisch inspirierte Methode, um KI‑Modelle eine wesentliche, menschliche Gewohnheit beizubringen: Unsicherheit auszudrücken, wenn sie es wirklich nicht wissen.

Wenn Vertrauen und Realität auseinanderdriften

Die Autoren beginnen damit, zu betrachten, wie heutige neuronale Netze Vertrauen melden. Ein auf natürlichen Bildern trainierter Klassifikator sagt nicht nur voraus, was er sieht, sondern auch mit welcher Wahrscheinlichkeit seine Antwort korrekt ist. Idealerweise sollte ein Modell, das 80 % Sicherheit angibt, in etwa 80 % der Fälle richtig liegen. In der Praxis zeigen die Forscher jedoch, dass mit zunehmender Tiefe der Netze und begrenzten Trainingsdaten die Sicherheit aufgebläht wird: Sie ordnen falschen Antworten häufig sehr hohe Gewissheit zu. Dieses Problem verschärft sich, wenn das Modell auf Bilder trifft, die es während des Trainings nie gesehen hat — eine Situation, die als Aus‑der‑Verteilung‑Daten (out‑of‑distribution) bekannt ist — wobei es weiterhin übermäßig sicher auftritt, anstatt Unsicherheit zu zeigen.

Ein Aufwärmen aus der Entwicklung des Gehirns entliehen

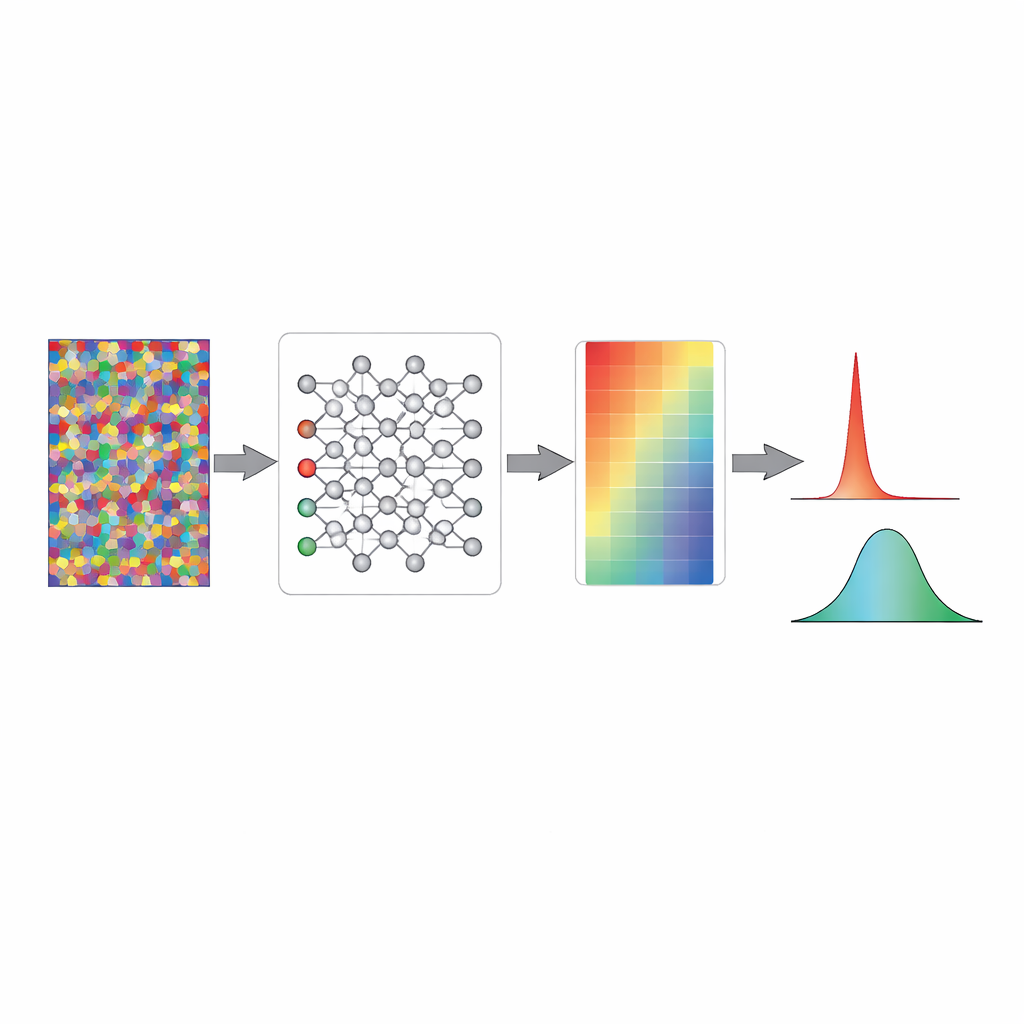

Um dem zu begegnen, richtet die Studie den Blick auf die Biologie. Schon vor der Geburt sind tierische Gehirne aktiv und erzeugen spontane Muster elektrischer Aktivität, lange bevor bedeutungsvolle Seherlebnisse und Geräusche eintreffen. Neurowissenschaftler vermuten, dass dieses frühe „Rauschen“ dabei hilft, Schaltkreise so zu verdrahten, dass sie für echte Sinneserfahrungen bereit sind. Davon inspiriert schlagen die Autoren eine Aufwärmphase für künstliche Netze vor: Bevor sie reale Bilder oder Labels sehen, wird das Modell kurz mit vollkommen zufälligen Eingabemustern gepaart mit zufälligen, bedeutungslosen Labels trainiert. Auf den ersten Blick erscheint das sinnlos — das Netzwerk kann aus reinem Rauschen nichts Nützliches lernen. Doch während dieser kurzen Phase beruhigen sich seine internen Reaktionen in einen Zustand, in dem die Ausgabewahrscheinlichkeiten gleichmäßig verteilt sind und eher Zufallsniveau als Überzeugtheit widerspiegeln.

Wie zufälliges Rauschen Vertrauen ehrlich macht

Anhand vereinfachter Toy‑Modelle und vollständiger Bildklassifikatoren zeigen die Forscher, was dieses Aufwärmen unter der Haube bewirkt. In einem standardmäßig zufällig initialisierten Netzwerk schwanken die mathematischen Signale direkt vor der letzten Entscheidungsschicht oft stark, was die Softmax‑Funktion in extreme Wahrscheinlichkeiten nahe Null oder Eins umwandelt. Das bedeutet, dass ein untrainiertes Modell sich bereits so verhält, als sei es sehr sicher, obwohl es nichts weiß. Das Training mit zufälligem Rauschen skaliert diese internen Signale sanft zurück und zieht sie in einen Bereich, in dem die Ausgabewahrscheinlichkeiten nahe dem Zufallsniveau gruppiert sind. Die Gewichte ändern sich dabei nur wenig; stattdessen wird das Gesamtmuster der Aktivität „vorkalibriert“, sodass das Modell vor dem eigentlichen Lernen von sich aus maximale Unsicherheit gegenüber unbekannten Eingaben ausdrückt.

Besseres Verhalten bei bekannten und unbekannten Daten

Nachdem dieses gehirn‑inspiriertes Aufwärmen abgeschlossen ist, werden dieselben Netze mit Standardmethoden an realen Bilddatensätzen trainiert. Über viele Architekturen hinweg — von einfachen Feed‑Forward‑Netzen bis zu verbreiteten ResNet-, DenseNet‑ und Vision‑Transformer‑Modellen — behalten die mit Rauschen trainierten Netze während des Lernens eine engere Übereinstimmung zwischen Vertrauen und tatsächlicher Genauigkeit bei. Sie erzielen auf herkömmlichen Testsets gleichwertige oder leicht bessere Leistungen als konventionell initialisierte Netze, doch ihre Vertrauenswerte sind deutlich verlässlicher. Entscheidend ist, dass diese vorkalibrierten Modelle bei wirklich unbekannten Bildern geringe Konfidenzwerte nahe dem Zufallsniveau zuweisen, anstatt sie selbstsicher falsch zu etikettieren. Diese einfache Eigenschaft verbessert ihre Fähigkeit erheblich, zu erkennen, wann eine Eingabe „unbekannt“ ist — ein Schlüsselmerkmal für den sicheren Einsatz in der Praxis.

Grundlagen für vertrauenswürdigere KI

Einfach ausgedrückt zeigt die Studie, dass ein sehr kurzes, kostengünstiges Aufwärmen mit zufälligem Rauschen neuronalen Netzen von Anfang an eine Art Bescheidenheit beibringen kann. Anstatt als übermäßig selbstsichere Rater zu starten, beginnen Modelle in einem vorsichtigen Zustand, in dem sie zugeben, dass sie nichts wissen, und ihr Vertrauen erst erhöhen, wenn sie echte Evidenz sammeln. Dieser Ansatz vermeidet zusätzliche Nachbearbeitungsschritte, funktioniert über viele Modelltypen und Datengrößen hinweg und spiegelt wider, wie biologische Gehirne sich offenbar vor der Geburt vorbereiten. Bei breiter Anwendung könnte ein solches gehirn‑inspiriertes Aufwärmtraining dazu beitragen, dass KI‑Systeme nicht nur genau, sondern auch angemessen bewusst ihrer eigenen Grenzen werden — ein wesentlicher Schritt, um sie zu sichereren und zuverlässigeren Partnern in alltäglichen Entscheidungsprozessen zu machen.

Zitation: Cheon, J., Paik, SB. Brain-inspired warm-up training with random noise for uncertainty calibration. Nat Mach Intell 8, 602–613 (2026). https://doi.org/10.1038/s42256-026-01215-x

Schlüsselwörter: Unsicherheitskalibrierung, Neuronale Netze, Aufwärmen mit zufälligem Rauschen, Erkennung von Aus-der-Verteilung-Daten, Gehirn‑inspiriertes KI