Clear Sky Science · es

Entrenamiento de calentamiento inspirado en el cerebro con ruido aleatorio para la calibración de la incertidumbre

Por qué una IA más inteligente necesita saber cuándo puede estar equivocada

Los sistemas de inteligencia artificial modernos pueden reconocer imágenes, conducir coches y conversar en lenguaje natural con habilidad impresionante. Sin embargo, a menudo presentan una zona ciega peligrosa: pueden estar completamente equivocados mientras se muestran extremadamente seguros. Esta discrepancia entre confianza y corrección puede provocar malas decisiones médicas, comportamientos inseguros en vehículos autónomos o chatbots que inventan hechos de forma convincente. El artículo "Entrenamiento de calentamiento inspirado en el cerebro con ruido aleatorio para la calibración de la incertidumbre" explora una forma sorprendentemente simple e inspirada en la biología de enseñar a los modelos de IA un hábito crucial parecido al humano: expresar incertidumbre cuando realmente no saben.

Cuando la confianza y la realidad se separan

Los autores comienzan examinando cómo informan hoy las redes neuronales sobre su confianza. Un clasificador entrenado con imágenes naturales no solo predice lo que ve, sino también una probabilidad de que su respuesta sea correcta. Idealmente, si un modelo dice que tiene un 80 % de confianza, debería acertar aproximadamente el 80 % de las veces. En la práctica, los investigadores muestran que a medida que las redes se hacen más profundas y se entrenan con datos limitados, su confianza se infla: con frecuencia asignan una certidumbre muy alta a respuestas equivocadas. Este problema empeora aún más cuando el modelo encuentra imágenes que nunca vio durante el entrenamiento —una situación conocida como datos fuera de distribución—, donde sigue comportándose con exceso de seguridad en lugar de admitir incertidumbre.

Un calentamiento tomado del cerebro en desarrollo

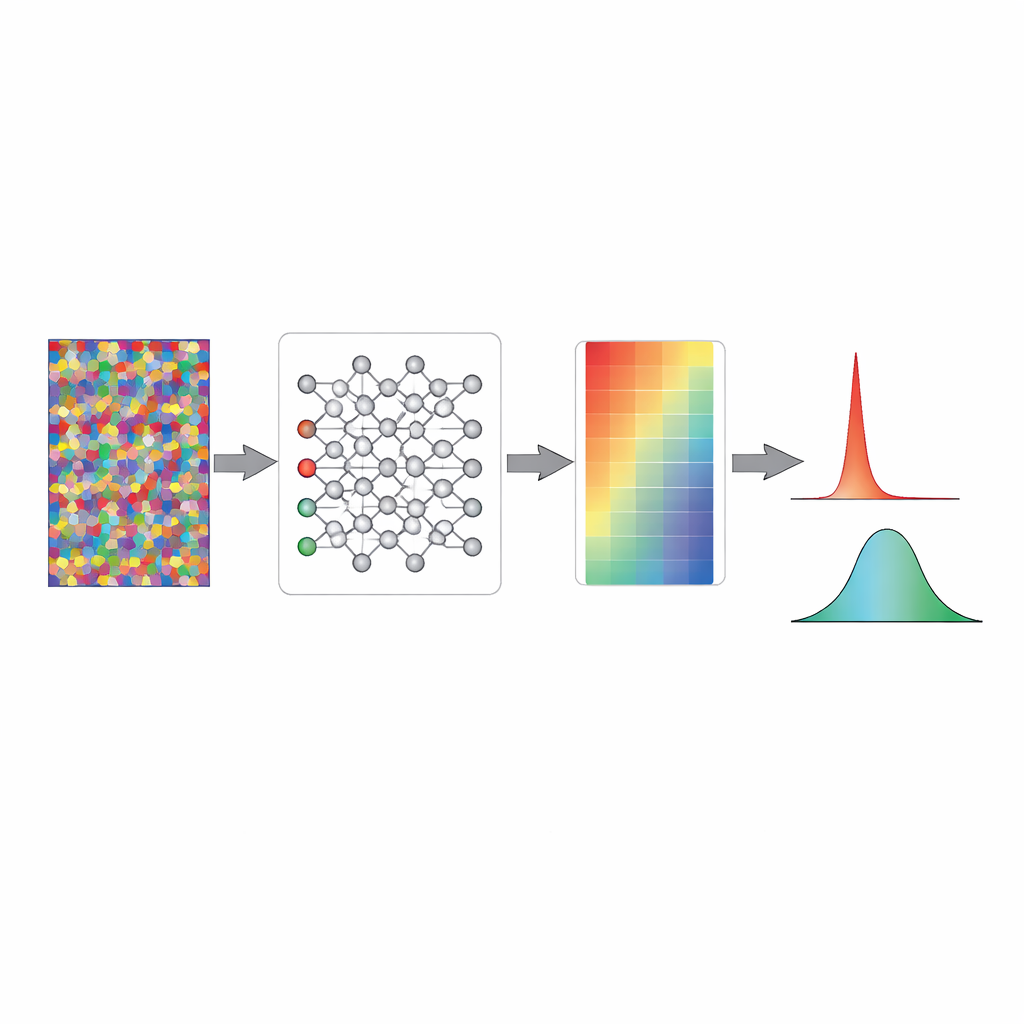

Para abordar esto, el estudio recurre a la biología. Antes del nacimiento, los cerebros de los animales ya están activos, generando patrones espontáneos de actividad eléctrica mucho antes de que lleguen estímulos sensoriales significativos. Los neurocientíficos creen que este "ruido" temprano ayuda a cablear los circuitos para que estén listos para la experiencia sensorial real. Inspirados por ello, los autores proponen una fase de calentamiento para redes artificiales: antes de ver imágenes o etiquetas reales, el modelo se entrena brevemente con patrones de entrada completamente aleatorios emparejados con etiquetas aleatorias y sin sentido. A primera vista, esto parece inútil —la red no puede aprender nada útil a partir de puro ruido—. Sin embargo, durante esta breve fase, sus respuestas internas se estabilizan en un estado donde sus probabilidades de salida se distribuyen de forma pareja, correspondiendo al azar en lugar de a la sobreconfianza.

Cómo el ruido aleatorio hace honesta la confianza

Usando modelos de juguete simplificados y clasificadores de imágenes completos, los investigadores muestran qué hace este calentamiento bajo el capó. En una red estándar con inicialización aleatoria, las señales matemáticas justo antes de la capa de decisión final a menudo presentan grandes oscilaciones, que la función softmax convierte en probabilidades extremas próximas a cero o uno. Esto significa que un modelo sin entrenar ya se comporta como si estuviera muy seguro, aunque no sepa nada. Entrenar con ruido aleatorio redimensiona suavemente esas señales internas, llevándolas a un rango donde las probabilidades de salida se agrupan cerca del nivel de azar. Los pesos apenas cambian; en lugar de eso, el patrón global de actividad queda "precalibrado" de modo que, antes de que comience el aprendizaje real, el modelo expresa de forma natural la máxima incertidumbre sobre entradas desconocidas.

Mejor comportamiento con datos reales y desconocidos

Una vez completado este calentamiento inspirado en el cerebro, las mismas redes se entrenan con conjuntos de imágenes reales usando métodos estándar. A lo largo de muchas arquitecturas —desde redes feed-forward sencillas hasta modelos populares como ResNet, DenseNet y transformers de visión—, las redes entrenadas con ruido mantienen una correspondencia más estrecha entre confianza y precisión real durante el aprendizaje. Rinden igual o ligeramente mejor que las redes inicializadas de manera convencional en conjuntos de prueba estándar, pero sus puntuaciones de confianza son mucho más fiables. De forma crucial, al mostrarles imágenes verdaderamente desconocidas, estos modelos precalibrados asignan baja confianza cercana al azar, en lugar de etiquetarlas con seguridad equivocada. Esta propiedad sencilla mejora de forma notable su capacidad para detectar cuándo una entrada es "desconocida", un requisito clave para un despliegue seguro en entornos reales.

Fundamentos para una IA más confiable

En términos sencillos, el estudio demuestra que un calentamiento muy breve y de bajo coste con ruido aleatorio puede enseñar a las redes neuronales una especie de humildad desde el inicio. En lugar de empezar siendo adivinadores excesivamente confiados, los modelos comienzan en un estado cauteloso en el que admiten no saber, y solo elevan su confianza a medida que acumulan pruebas reales. Este enfoque evita pasos adicionales de posprocesado, funciona con muchos tipos de modelos y tamaños de datos, y refleja cómo los cerebros biológicos parecen prepararse antes del nacimiento. Si se adoptara ampliamente, dicho entrenamiento de calentamiento inspirado en el cerebro podría ayudar a que los sistemas de IA sean no solo precisos, sino también conscientes apropiadamente de sus propios límites —un paso esencial para convertirlos en socios más seguros y fiables en la toma de decisiones cotidiana.

Cita: Cheon, J., Paik, SB. Brain-inspired warm-up training with random noise for uncertainty calibration. Nat Mach Intell 8, 602–613 (2026). https://doi.org/10.1038/s42256-026-01215-x

Palabras clave: calibración de la incertidumbre, redes neuronales, calentamiento con ruido aleatorio, detección fuera de distribución, IA inspirada en el cerebro