Clear Sky Science · pt

DRLO-VANET: uma estrutura de offloading baseada em deep reinforcement learning para execução de tarefas com baixa latência e eficiência energética em VANETs

Por que a computação mais inteligente nos carros importa

Carros modernos, especialmente os autônomos, estão se tornando computadores sobre rodas. Eles interpretam continuamente imagens de câmeras, radar, mapas e informações de tráfego para manter os passageiros seguros e o fluxo viário. Mas todo esse processamento consome tempo e energia. Hoje, os veículos podem processar os dados a bordo ou enviá‑los para computadores próximos instalados à beira da via. Escolher errado pode significar atrasos, tarefas descartadas ou desperdício de bateria. Este artigo explora uma nova forma de tomar essas decisões automaticamente e de modo inteligente, usando algoritmos de aprendizado que se adaptam em tempo real às condições de tráfego e de rede.

Carros, estradas e ajudantes próximos

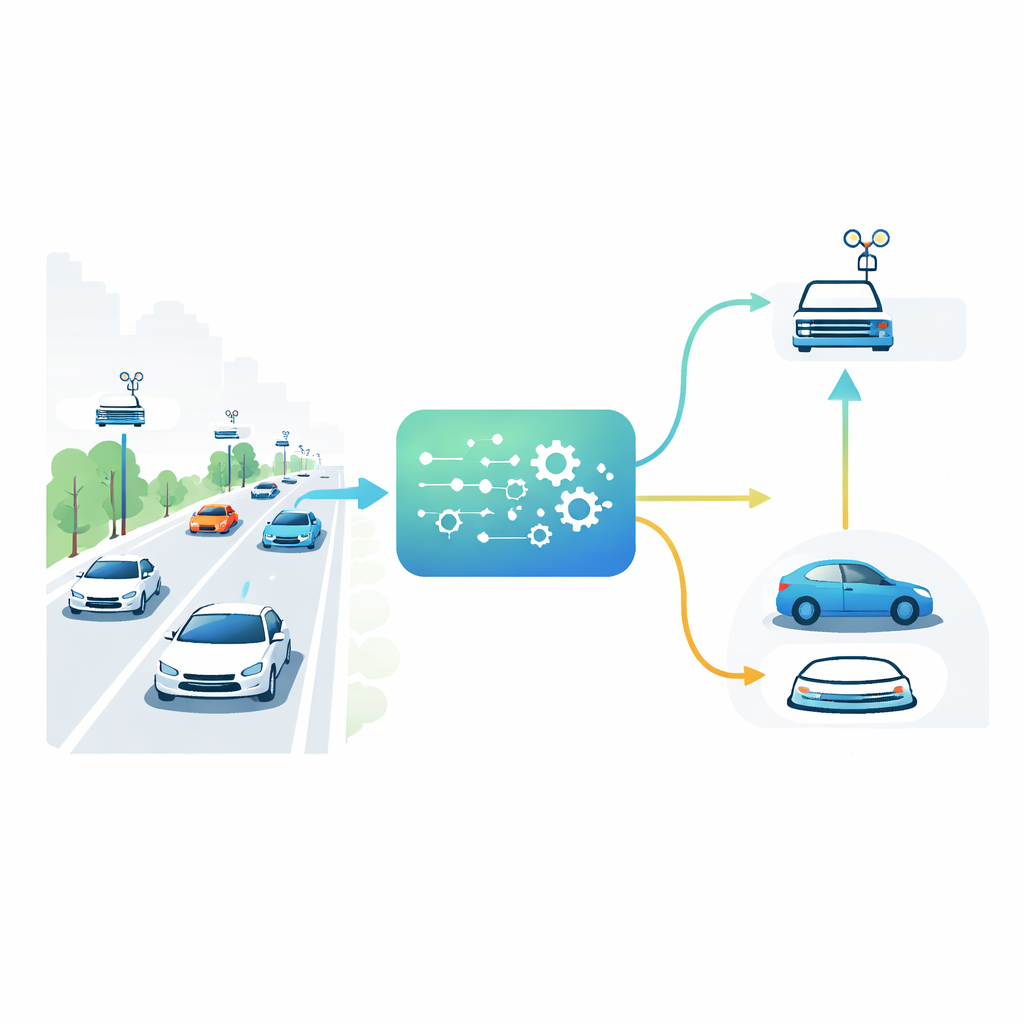

Em cidades futuras, os veículos não apenas se comunicarão entre si, mas também com pequenos computadores embutidos em unidades à beira da via. Essas unidades atuam como mini‑datacenters locais, muito mais próximos que servidores em nuvem distantes. Um carro se aproximando de um cruzamento pode ter de executar uma tarefa exigente, como combinar dados de câmeras e sensores para detectar pedestres ocultos. Ele pode processar a tarefa em seu processador limitado ou descarregá‑la para uma das unidades de beira de via. A melhor escolha depende de quão congestionada está a via, do quão ocupada está cada unidade, da qualidade do sinal sem fio e da urgência da tarefa. Como todas essas condições mudam segundo a segundo, regras estáticas — por exemplo, usar sempre a unidade mais próxima — falham no tráfego real.

Deixar o sistema aprender por conta própria

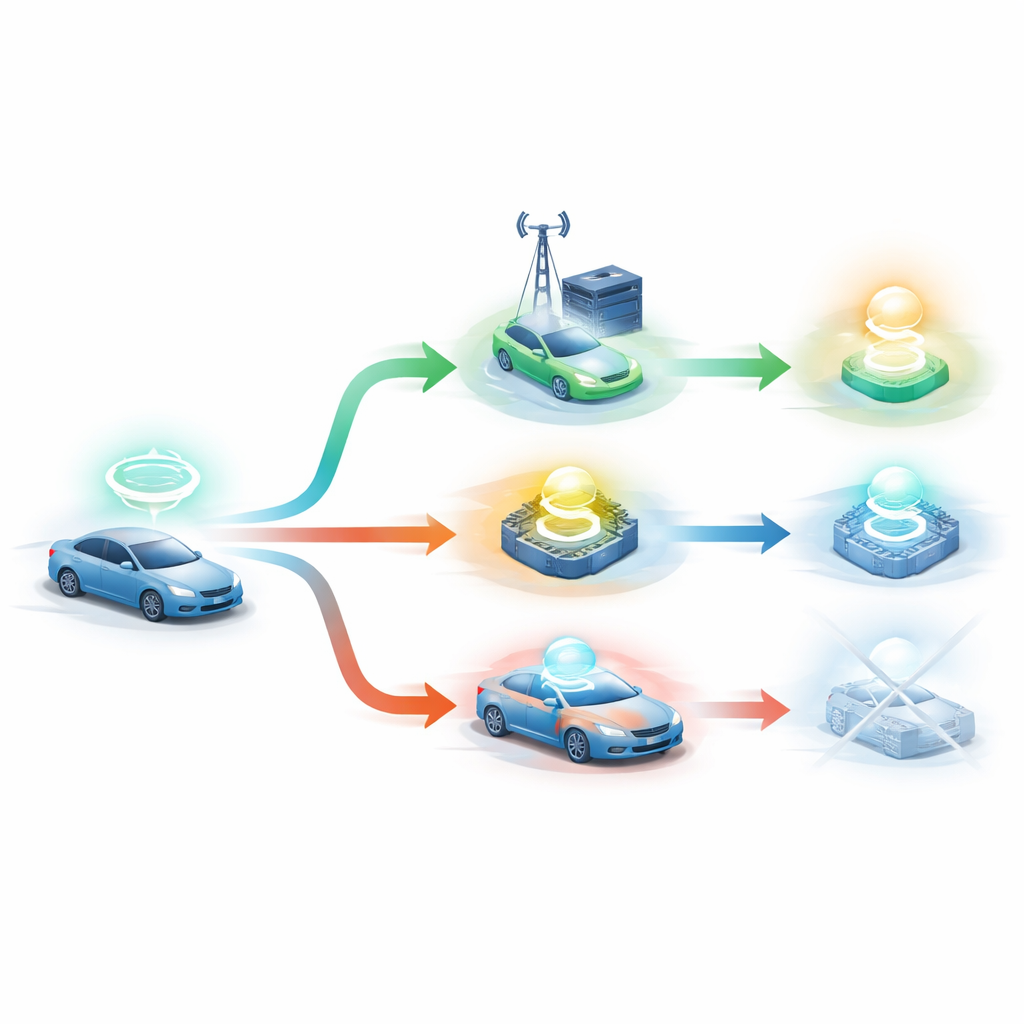

Os autores propõem o DRLO‑VANET, uma estrutura que permite ao sistema aprender boas decisões por tentativa e erro em vez de depender de regras definidas manualmente. No arranjo deles, cada veículo é tratado como um tomador de decisão que observa o ambiente — densidade de veículos, qualidade do sinal, nível de bateria, tamanho e prazo de cada tarefa e carga nas unidades de beira de via. Um agente de aprendizado então escolhe entre várias opções: processar localmente, enviar a tarefa para uma das unidades de beira de via ou até dividir o trabalho entre o carro e a unidade. Após cada decisão, o sistema mede quanto tempo a tarefa levou, quanta energia consumiu, se foi concluída antes do prazo, quão balanceado foi o uso das unidades e quantas vezes o carro precisou trocar de unidade enquanto se movia. Esses resultados são combinados em uma única pontuação de feedback que direciona o agente de aprendizado a escolhas melhores ao longo do tempo.

Construindo um ambiente de teste realista

Para avaliar se a estratégia aprendida funcionaria na prática, os pesquisadores construíram uma simulação detalhada usando o simulador de rede ns‑3 vinculado a uma ferramenta de reinforcement learning. A cidade virtual inclui cruzamentos, veículos em movimento com velocidades variadas e unidades de beira de via posicionadas em grade para que as áreas de cobertura se sobreponham, como numa implantação real. Os enlaces sem fio seguem modelos realistas para rodovias abertas e “canyons” urbanos densos, onde prédios causam reflexões e perda de sinal. Tarefas de diferentes tamanhos e prazos chegam a cada veículo, e os computadores de beira de via são modelados com filas e capacidade de processamento limitada, de modo que podem ficar congestionados quando muitos carros descarregam simultaneamente. Dois métodos populares de aprendizado, Deep Q‑Networks e Soft Actor‑Critic, são usados para treinar políticas de decisão ao longo de muitas simulações de tráfego e condições de canal.

Desempenho da abordagem de aprendizado

A equipe comparou o DRLO‑VANET com três alternativas comuns: processar sempre a bordo, sempre descarregar para a unidade de beira de via mais próxima e uma estratégia “gananciosa” que busca a menor latência imediata sem planejar à frente. Em tráfego leve, todos os métodos têm desempenho razoável, mas à medida que mais carros entram na rede as fraquezas das regras simples aparecem. O offloading para a unidade mais próxima sobrecarrega algumas unidades, causando filas longas. A estratégia gananciosa minimiza o atraso inicialmente, mas força os veículos a trocarem repetidamente entre unidades, adicionando overhead e instabilidade. Em contraste, a política aprendida do DRLO‑VANET distribui a carga de forma mais uniforme, evita enlaces sem fio claramente ruins e limita trocas desnecessárias. Nas simulações, ela reduz o atraso das tarefas em até cerca de 40%, diminui o consumo de energia em 30–35%, mantém mais de 90% das tarefas dentro do prazo em tráfego médio e reduz aproximadamente pela metade os eventos de handover comparado ao método ganancioso.

O que isso significa para motoristas no dia a dia

Para não especialistas, a conclusão principal é que carros e infraestrutura rodoviária podem cooperar de maneira muito mais inteligente do que hoje. Em vez de regras rígidas, um controlador baseado em aprendizado pode observar quão ocupados estão a via e a rede e escolher discretamente onde cada tarefa digital deve rodar para que as respostas permaneçam rápidas, as baterias durem mais e os equipamentos de beira de via não fiquem sobrecarregados. Embora este estudo se baseie em simulação e não em carros reais, ele aponta para um futuro em que o “pensamento” necessário ao condução autônoma seja automaticamente dividido entre veículos e infraestrutura próxima, tornando serviços avançados de segurança e navegação mais confiáveis mesmo em tráfego lotado e em rápida mudança.

Citação: Neelima, S., Sree, S.R. & Ramakrishnaiah, N. DRLO-VANET: a deep reinforcement learning-based offloading framework for low-latency and energy-efficient task execution in VANETs. Sci Rep 16, 10582 (2026). https://doi.org/10.1038/s41598-026-46336-w

Palavras-chave: veículos autônomos, edge computing, redes veiculares, reinforcement learning, offloading de tarefas