Clear Sky Science · fr

DRLO-VANET : un cadre d’externalisation basé sur l’apprentissage par renforcement profond pour l’exécution des tâches à faible latence et économe en énergie dans les VANET

Pourquoi un calcul embarqué plus intelligent est important

Les voitures modernes, et en particulier les véhicules autonomes, deviennent de véritables ordinateurs roulants. Elles interprètent en permanence les flux vidéo, le radar, les cartes et les informations de trafic pour assurer la sécurité des passagers et la fluidité de la circulation. Mais tout ce traitement demande du temps et de l’énergie. Aujourd’hui, les voitures peuvent soit effectuer les calculs à bord, soit les envoyer à des ordinateurs implantés le long de la route. Faire le mauvais choix peut entraîner des délais, des tâches abandonnées ou une consommation de batterie inutile. Cet article explore une nouvelle manière d’automatiser ces choix de façon intelligente, en utilisant des algorithmes d’apprentissage qui s’adaptent en temps réel aux conditions de trafic et de réseau.

Véhicules, routes et aides de proximité

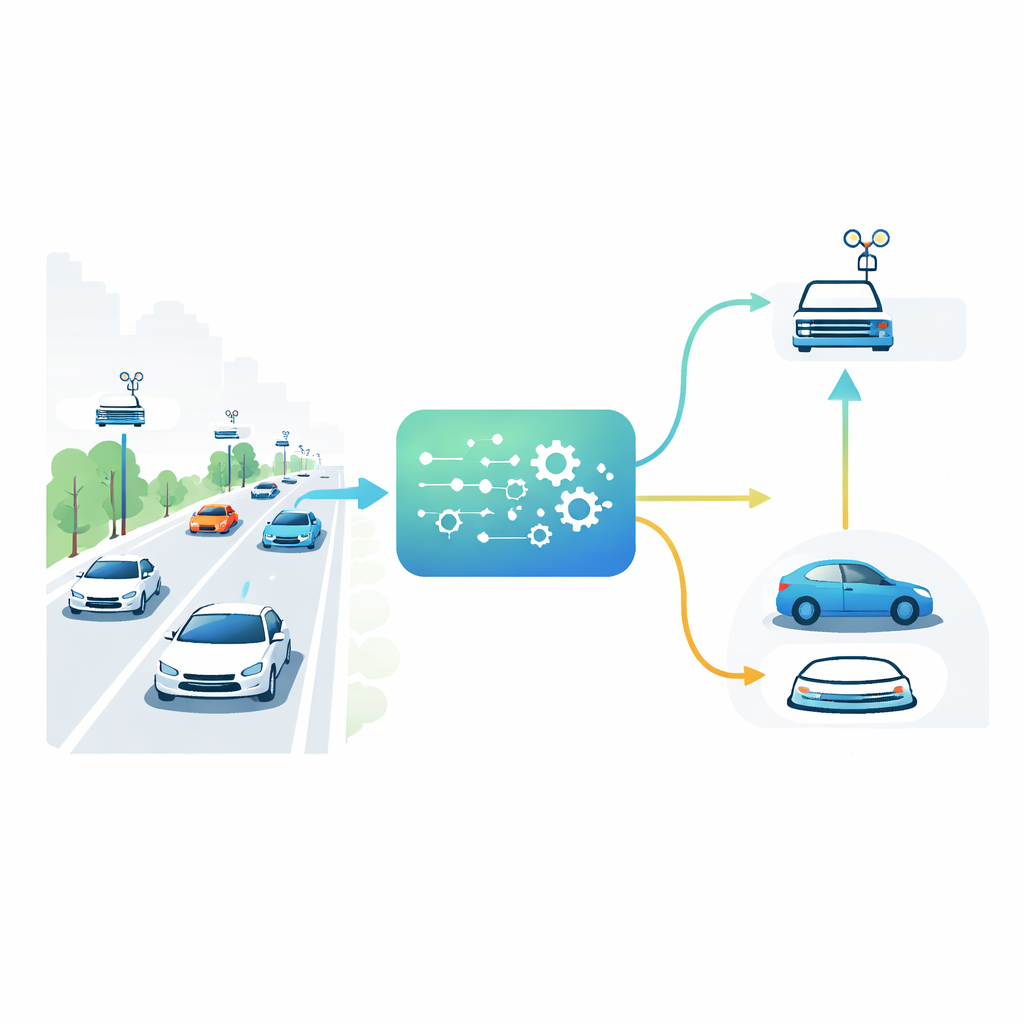

Dans les villes du futur, les véhicules ne se contenteront pas de communiquer entre eux, ils échangeront aussi avec de petits ordinateurs intégrés aux unités au bord de la route. Ces unités jouent le rôle de mini-centres de données locaux, bien plus proches que des serveurs cloud distants. Un véhicule approchant d’une intersection peut devoir exécuter une tâche exigeante, par exemple combiner images et données capteurs pour détecter des piétons cachés. Il peut soit traiter cette tâche sur son processeur limité, soit la déléguer à une des unités au bord de la route. Le meilleur choix dépend de la densité du trafic, de la charge des unités, de la qualité du signal sans fil et de l’urgence de la tâche. Comme toutes ces conditions évoluent seconde par seconde, des règles statiques — comme utiliser systématiquement l’unité la plus proche — montrent leurs limites en situation réelle.

Laisser le système apprendre par lui-même

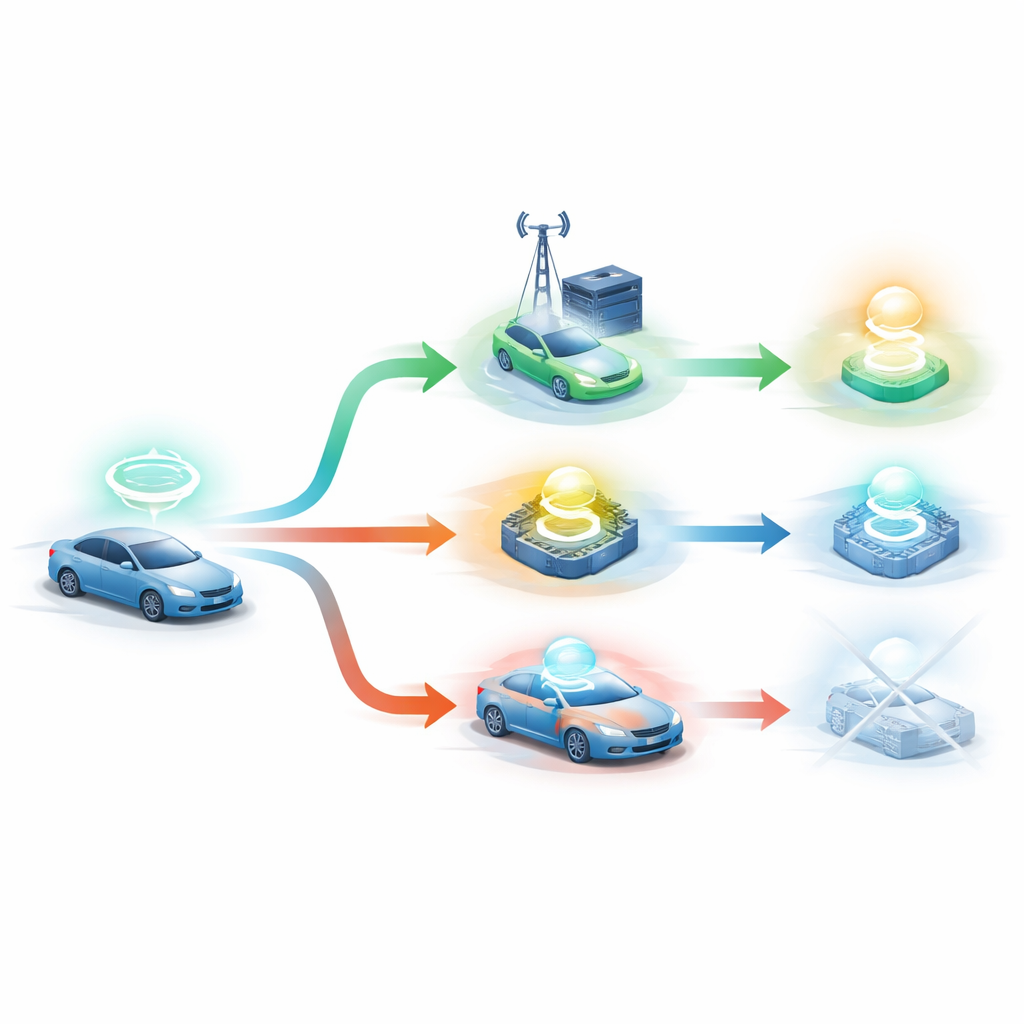

Les auteurs proposent DRLO-VANET, un cadre qui permet au système d’apprendre de bonnes décisions par essais et erreurs plutôt que de reposer sur des règles manuelles. Dans leur configuration, chaque véhicule est considéré comme un décideur qui observe son environnement — densité de véhicules, qualité du signal, niveau de batterie, taille et délai de chaque tâche, et charge des unités au bord de la route. Un agent d’apprentissage choisit ensuite parmi plusieurs options : traiter localement, envoyer la tâche à l’une des unités au bord de la route, ou même répartir le travail entre la voiture et la route. Après chaque décision, le système mesure le temps d’exécution de la tâche, l’énergie consommée, le respect du délai, l’équilibre d’utilisation des unités et le nombre de fois où la voiture a dû changer d’unité en se déplaçant. Ces résultats sont combinés en un score de rétroaction unique qui oriente l’agent d’apprentissage vers de meilleures décisions au fil du temps.

Construire un terrain d’essai réaliste

Pour évaluer si la stratégie apprise fonctionnerait en pratique, les chercheurs ont construit une simulation informatique détaillée en utilisant le simulateur réseau ns-3 connecté à une boîte à outils d’apprentissage par renforcement. Leur ville virtuelle comprend des carrefours, des véhicules en mouvement à différentes vitesses et des unités au bord de la route disposées en grille de sorte que les zones de couverture se chevauchent comme dans un déploiement réel. Les liaisons sans fil suivent des modèles réalistes pour les autoroutes dégagées et les « canyons » urbains denses, où les bâtiments provoquent des réflexions et des pertes de signal. Des tâches de tailles et de délais variés arrivent sur chaque véhicule, et les ordinateurs routiers sont modélisés avec des files d’attente et une puissance de traitement limitée, de sorte qu’ils peuvent se congestionner quand de nombreuses voitures externalisent simultanément. Deux méthodes d’apprentissage populaires, Deep Q-Networks et Soft Actor-Critic, servent à entraîner des politiques de décision sur de nombreux trajets simulés et conditions de canal.

Performance de l’approche par apprentissage

L’équipe a comparé DRLO-VANET à trois alternatives courantes : toujours traiter à bord, toujours externaliser vers l’unité la plus proche et une stratégie « gourmande » qui poursuit le délai immédiat le plus faible sans anticiper. Lorsque le trafic est léger, toutes les méthodes sont raisonnables, mais à mesure que le nombre de véhicules augmente, les faiblesses des règles simples apparaissent. L’externalisation vers l’unité la plus proche surcharge quelques unités, provoquant de longues files d’attente. La stratégie gourmande minimise d’abord le délai mais oblige les véhicules à basculer fréquemment entre unités, ajoutant des surcoûts et de l’instabilité. En revanche, la politique apprise par DRLO-VANET répartit la charge de façon plus homogène, évite les liaisons sans fil manifestement mauvaises et limite les changements d’unité inutiles. En simulation, elle réduit le délai des tâches jusqu’à environ 40 %, diminue la consommation d’énergie de 30 à 35 %, maintient plus de 90 % des tâches dans les délais en trafic moyen et divise à peu près par deux les événements de handover comparé à la méthode gourmande.

Ce que cela signifie pour les automobilistes

Pour un public non spécialiste, la conclusion principale est que voitures et infrastructures routières peuvent coopérer beaucoup plus intelligemment qu’aujourd’hui. Plutôt que d’appliquer des règles rigides, un contrôleur basé sur l’apprentissage peut observer la charge du réseau et de la route et choisir discrètement où exécuter chaque tâche numérique pour que les réponses restent rapides, que les batteries durent plus longtemps et que les équipements routiers ne soient pas saturés. Bien que cette étude repose sur des simulations et non sur des véhicules réels, elle ouvre la voie à un futur où le « raisonnement » nécessaire à la conduite autonome est automatiquement partagé entre véhicules et infrastructures proches, rendant les services avancés de sécurité et de navigation plus fiables même dans un trafic dense et en évolution rapide.

Citation: Neelima, S., Sree, S.R. & Ramakrishnaiah, N. DRLO-VANET: a deep reinforcement learning-based offloading framework for low-latency and energy-efficient task execution in VANETs. Sci Rep 16, 10582 (2026). https://doi.org/10.1038/s41598-026-46336-w

Mots-clés: véhicules autonomes, edge computing, réseaux véhiculaires, apprentissage par renforcement, externalisation de tâches