Clear Sky Science · pl

DRLO-VANET: ramy offloadingu oparte na głębokim uczeniu ze wzmocnieniem dla niskich opóźnień i energooszczędnego wykonywania zadań w VANET

Dlaczego inteligentniejsze przetwarzanie w samochodach ma znaczenie

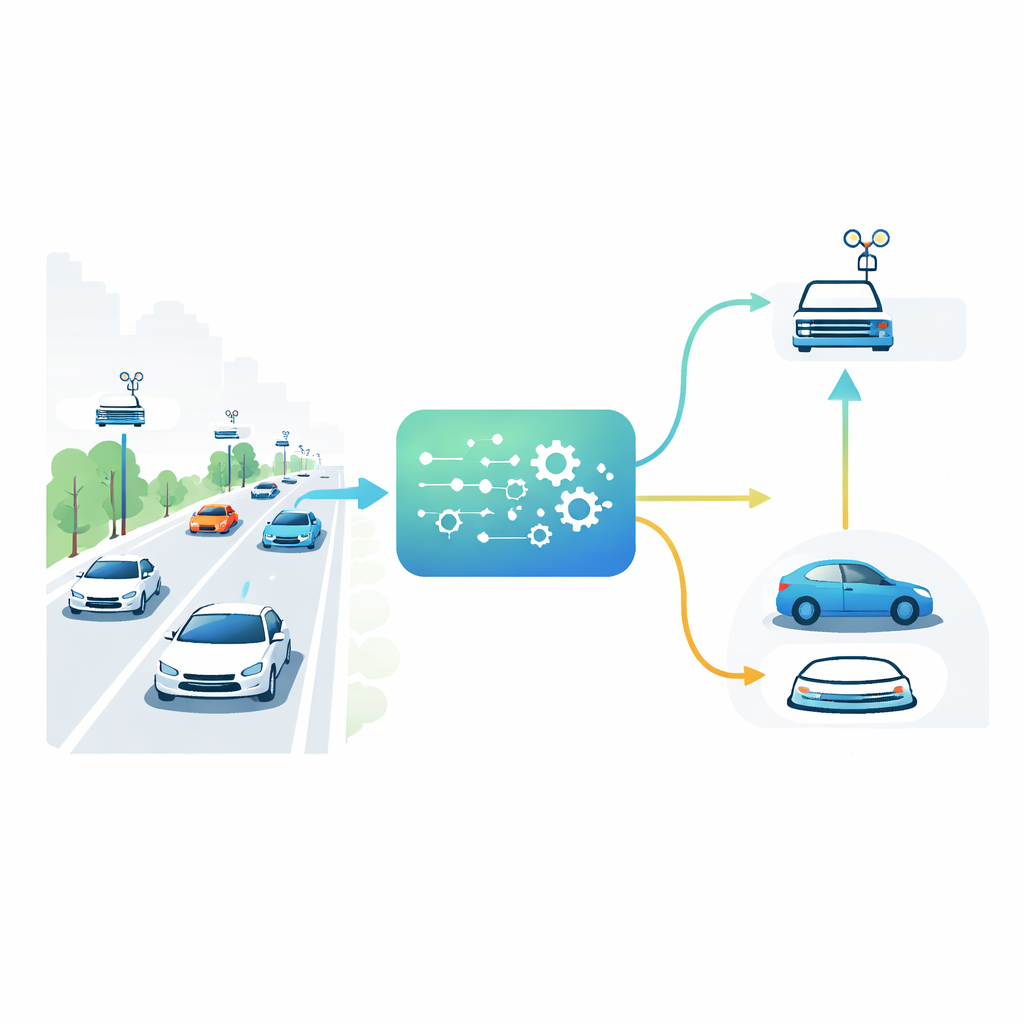

Współczesne samochody, zwłaszcza autonomiczne, stają się mobilnymi komputerami. Nieustannie analizują strumienie z kamer, radaru, mapy i informacji o ruchu, by chronić pasażerów i utrzymywać płynność ruchu. To przetwarzanie wymaga jednak czasu i energii. Obecnie samochód może albo wykonywać obliczenia lokalnie, albo wysłać je do pobliskich komputerów przydrożnych. Zła decyzja może oznaczać opóźnienia, porzucone zadania lub zmarnowaną energię baterii. W artykule zaprezentowano nowy sposób automatycznego i inteligentnego podejmowania takich decyzji, wykorzystujący algorytmy uczące się, które dostosowują się w czasie rzeczywistym do warunków ruchu i sieci.

Samochody, drogi i pobliscy pomocnicy

W przyszłych miastach pojazdy będą komunikować się nie tylko między sobą, lecz także z małymi komputerami zamontowanymi w jednostkach przydrożnych wzdłuż ulic. Jednostki te działają jak lokalne mini–centra danych, znacznie bliżej niż odległe serwery w chmurze. Samochód zbliżający się do skrzyżowania może potrzebować wykonać wymagające zadanie, np. połączyć dane z kamer i czujników, by wykryć ukrytych pieszych. Może to przetworzyć na własnym, ograniczonym procesorze albo przesłać do jednej z jednostek przydrożnych. Najlepszy wybór zależy od zatłoczenia drogi, obciążenia każdego z komputerów przydrożnych, siły sygnału bezprzewodowego oraz pilności zadania. Ponieważ wszystkie te warunki zmieniają się sekundę po sekundzie, reguły statyczne — na przykład zawsze korzystać z najbliższej jednostki — zawodzą w rzeczywistym ruchu.

Pozwolić systemowi uczyć się samodzielnie

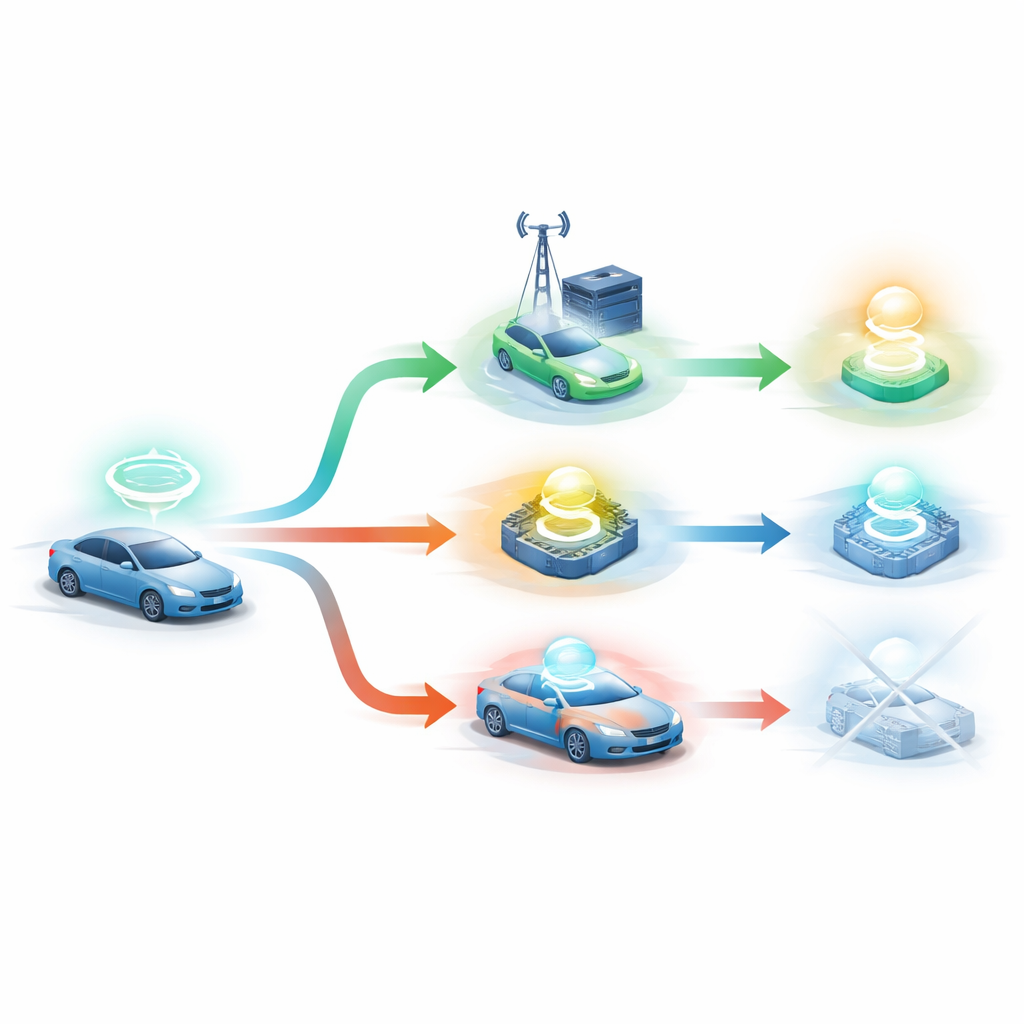

Autorzy proponują DRLO-VANET — ramy, które pozwalają systemowi uczyć się dobrych decyzji metodą prób i błędów zamiast opierać się na ręcznie zaprojektowanych regułach. W ich ustawieniu każdy pojazd traktowany jest jak podmiot podejmujący decyzje, który obserwuje otoczenie — gęstość pojazdów, jakość sygnału, poziom naładowania baterii, rozmiar i termin wykonania zadania oraz obciążenie jednostek przydrożnych. Agent uczący wybiera wówczas spośród kilku opcji: przetwarzać lokalnie, wysłać zadanie do jednej z jednostek przydrożnych albo nawet podzielić pracę między samochód a jednostkę przydrożną. Po każdej decyzji system mierzy czas wykonania zadania, zużytą energię, czy zakończono je przed terminem, stopień zrównoważenia obciążenia jednostek przydrożnych oraz liczbę przełączeń pojazdu między jednostkami przydrożnymi w czasie ruchu. Te wyniki są łączone w pojedynczy wynik zwrotny, który z biegiem czasu kieruje agenta ku lepszym decyzjom.

Budowa realistycznego pola testowego

Aby ocenić, czy wyuczona strategia sprawdzi się w praktyce, badacze zbudowali szczegółową symulację komputerową, łącząc symulator sieci ns-3 z zestawem narzędzi do uczenia ze wzmocnieniem. Ich wirtualne miasto obejmuje przecinające się drogi, poruszające się pojazdy o różnych prędkościach oraz jednostki przydrożne rozmieszczone w siatce tak, że obszary pokrycia nakładają się, jak w rzeczywistym wdrożeniu. Łącza bezprzewodowe bazują na realistycznych modelach dla otwartych autostrad i gęstych miejskich „kanionów”, gdzie budynki powodują odbicia i tłumienie sygnału. Na każdy pojazd napływają zadania o różnych rozmiarach i terminach, a komputery przydrożne modelowane są z kolejkami i ograniczoną mocą obliczeniową, więc mogą się zatorować, gdy wiele samochodów jednocześnie zleca im zadania. Do trenowania polityk decyzyjnych w wielu symulowanych przebiegach i warunkach kanału użyto dwóch popularnych metod: Deep Q-Networks i Soft Actor-Critic.

Jak dobrze działa podejście uczące się

Zespół porównał DRLO-VANET z trzema powszechnymi alternatywami: zawsze przetwarzać na pokładzie, zawsze wysyłać do najbliższej jednostki przydrożnej oraz z „chciwą” strategią, która goni najniższe natychmiastowe opóźnienie bez planowania naprzód. Przy małym natężeniu ruchu wszystkie metody radzą sobie przyzwoicie, ale wraz ze wzrostem liczby pojazdów w sieci ujawniają się słabości prostych reguł. Offloading do najbliższej jednostki przeciąża kilka jednostek przydrożnych, powodując długie kolejki. Strategia chciwa początkowo minimalizuje opóźnienie, lecz zmusza pojazdy do częstych przełączeń między jednostkami przydrożnymi, co dodaje narzut i niestabilność. Natomiast wyuczona polityka DRLO-VANET równomierniej rozkłada obciążenie, unika wyraźnie złych łączy bezprzewodowych i ogranicza niepotrzebne handovery. W symulacjach skraca opóźnienie zadań nawet o około 40 procent, obniża zużycie energii o 30–35 procent, utrzymuje ponad 90 procent zadań w terminie przy umiarkowanym ruchu i w przybliżeniu zmniejsza o połowę liczbę przełączeń w porównaniu ze strategią chciwą.

Co to oznacza dla codziennych kierowców

Dla czytelników niebędących specjalistami kluczowy wniosek jest taki, że samochody i infrastruktura drogowa mogą współpracować znacznie inteligentniej niż dziś. Zamiast sztywnych reguł, sterownik oparty na uczeniu może obserwować, jak obciążone są drogi i sieć, i dyskretnie wybierać, gdzie ma być wykonywane każde zadanie cyfrowe, tak aby odpowiedzi były szybkie, bateria dłużej wystarczała, a sprzęt przydrożny nie był przeciążony. Choć badanie opiera się na symulacji, a nie na rzeczywistych samochodach, wskazuje drogę ku przyszłości, w której „myślenie” potrzebne do autonomicznej jazdy jest automatycznie dzielone między pojazdy a pobliską infrastrukturę, czyniąc zaawansowane usługi bezpieczeństwa i nawigacji bardziej niezawodnymi nawet w zatłoczonym, szybko zmieniającym się ruchu.

Cytowanie: Neelima, S., Sree, S.R. & Ramakrishnaiah, N. DRLO-VANET: a deep reinforcement learning-based offloading framework for low-latency and energy-efficient task execution in VANETs. Sci Rep 16, 10582 (2026). https://doi.org/10.1038/s41598-026-46336-w

Słowa kluczowe: pojazdy autonomiczne, edge computing, sieci samochodowe, uczenie ze wzmocnieniem, offloading zadań