Clear Sky Science · nl

DRLO-VANET: een op deep reinforcement learning gebaseerd offloading-kader voor latentiearme en energiezuinige taakuitvoering in VANETs

Waarom slimmer rekenwerk in auto’s ertoe doet

Moderne auto’s, vooral zelfrijdende, worden rijdende computers. Ze interpreteren continu camerabeelden, radar, kaarten en verkeersinformatie om passagiers veilig te houden en het verkeer te laten doorstromen. Al dat rekenen kost echter tijd en energie. Auto’s van vandaag kunnen berekeningen lokaal uitvoeren of ze verzenden naar nabijgelegen wegkantcomputers. Een verkeerde keuze kan vertragingen, mislukte taken of verspilde batterijcapaciteit betekenen. Dit artikel onderzoekt een nieuwe manier om die keuzes automatisch en intelligent te maken, met leeralgoritmen die zich in real time aanpassen aan verkeers- en netwerkcondities.

Auto’s, wegen en nabijgelegen helpers

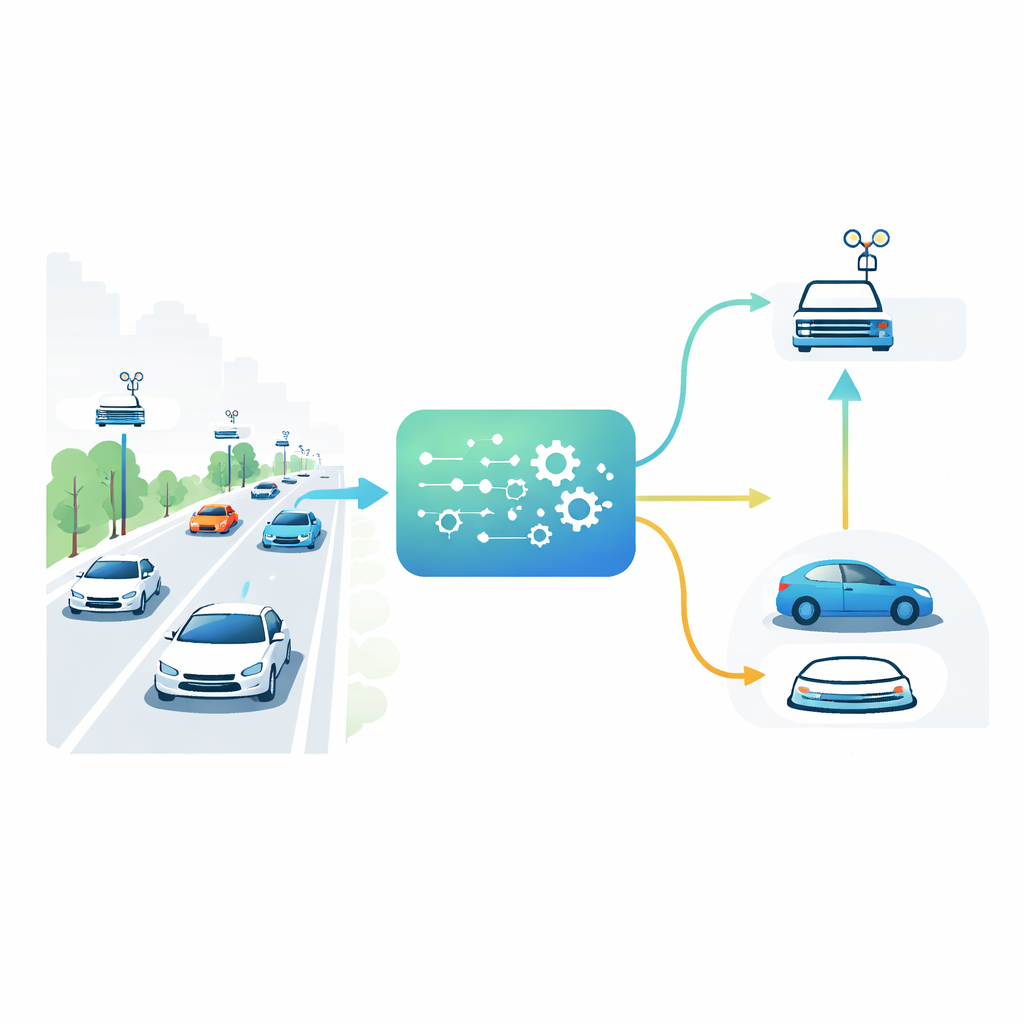

In toekomstige steden zullen voertuigen niet alleen met elkaar communiceren, maar ook met kleine computers ingebouwd in wegkantenunits langs de straten. Deze wegkantenunits fungeren als lokale mini-datacenters, veel dichterbij dan verre cloudservers. Een auto die een kruising nadert kan een veeleisende taak moeten uitvoeren, bijvoorbeeld het combineren van camera- en sensorgegevens om verborgen voetgangers te detecteren. De taak kan op de beperkte processor van de auto zelf worden uitgevoerd of worden offloaded naar één van de wegkantenunits. De beste keuze hangt af van hoe druk de weg is, hoe bezet elke wegkantencomputer is, hoe sterk het draadloze signaal is en hoe urgent de taak is. Omdat al deze omstandigheden per seconde veranderen, werken statische regels—zoals altijd de dichtstbijzijnde wegkantenunit gebruiken—in de praktijk niet goed.

Het systeem zichzelf laten leren

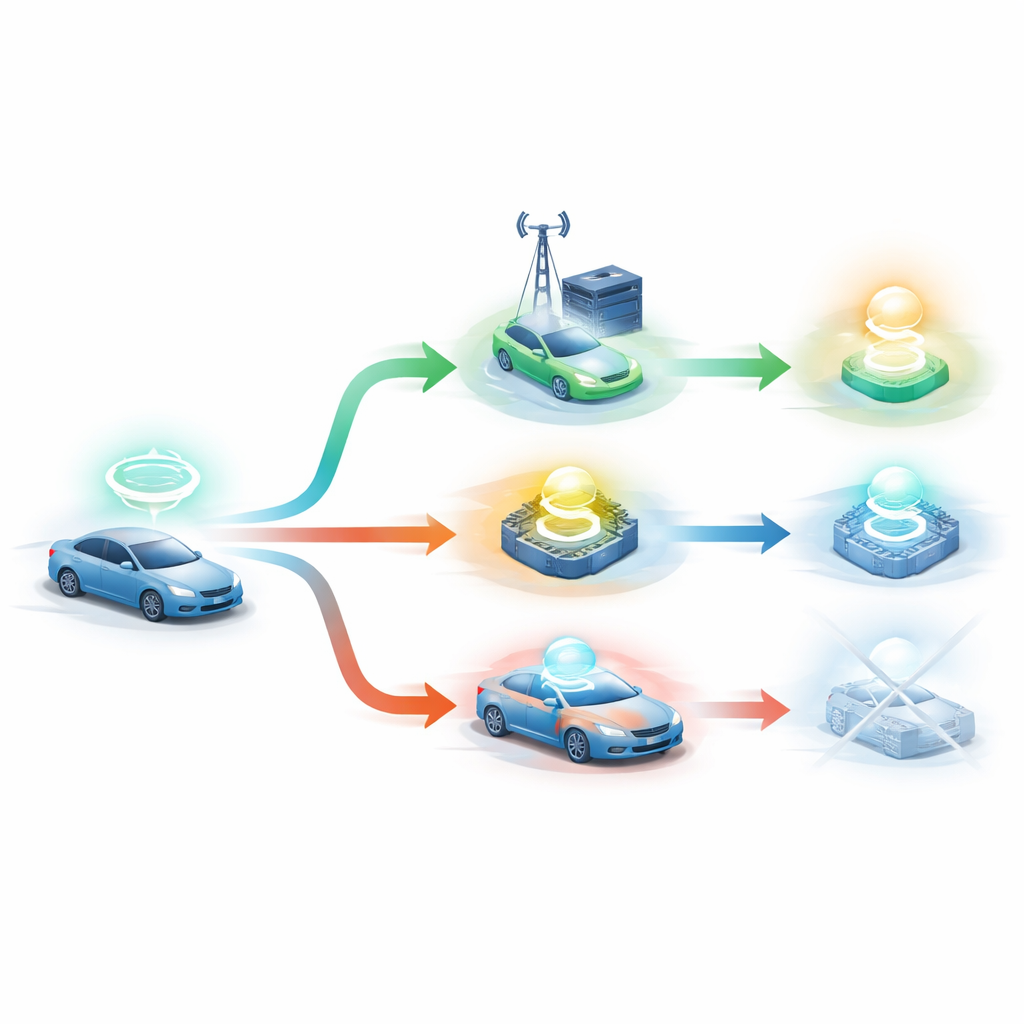

De auteurs stellen DRLO-VANET voor, een kader dat het systeem goede beslissingen laat leren door proefondervindelijkheid in plaats van te vertrouwen op handgemaakte regels. In hun opzet wordt elk voertuig als beslisser behandeld dat zijn omgeving observeert—voertuigdichtheid, signaalkwaliteit, eigen batterijniveau, de grootte en deadline van elke taak en hoe belast de wegkantenunits zijn. Een leeragent kiest vervolgens uit meerdere opties: lokaal verwerken, de taak naar een van meerdere wegkantenunits sturen, of zelfs het werk splitsen tussen auto en wegkant. Na elke beslissing meet het systeem hoe lang de taak duurde, hoeveel energie hij verbruikte, of hij voor de deadline klaar was, hoe evenwichtig het gebruik van wegkantenunits was en hoe vaak de auto moest wisselen tussen wegkantenunits tijdens het bewegen. Deze uitkomsten worden samengevoegd in een enkele feedbackscore die de leeragent geleidelijk aanspoort naar betere keuzes.

Een realistisch testlandschap bouwen

Om te beoordelen of de aangeleerde strategie in de praktijk zou werken, bouwden de onderzoekers een gedetailleerde computersimulatie met de ns-3-netwerksimulator gekoppeld aan een reinforcement learning-toolkit. Hun virtuele stad bevat kruisingen, bewegende voertuigen met verschillende snelheden en wegkantenunits die in een raster zijn geplaatst zodat de dekkingsgebieden overlappen zoals bij een echte uitrol. De draadloze koppelingen volgen realistische modellen voor open snelwegen en dichte stedelijke “kloven”, waar gebouwen reflecties en signaalverliezen veroorzaken. Taken van verschillende omvang en met uiteenlopende deadlines arriveren bij elk voertuig, en de wegkantencomputers worden gemodelleerd met wachtrijen en beperkte verwerkingscapaciteit, zodat zij congestie kunnen krijgen wanneer veel auto’s tegelijkertijd offloaden. Twee populaire leermethoden, Deep Q-Networks en Soft Actor-Critic, worden gebruikt om beslisbeleid te trainen over vele gesimuleerde ritten en kanaalcondities.

Hoe goed de leeraanpak presteert

Het team vergeleek DRLO-VANET met drie gangbare alternatieven: altijd lokaal verwerken, altijd offloaden naar de dichtstbijzijnde wegkantenunit en een “gulzige” strategie die alleen de laagste directe vertraging nastreeft zonder vooruit te denken. Bij licht verkeer presteren alle methoden redelijk, maar naarmate meer auto’s het netwerk betreden komen de zwaktes van de eenvoudige regels aan het licht. Offloaden naar de dichtstbijzijnde unit overbelast een paar wegkantencomputers, wat lange wachtrijen veroorzaakt. De gulzige strategie minimaliseert aanvankelijk de vertraging maar dwingt voertuigen ertoe herhaaldelijk te wisselen tussen wegkantenunits, wat overhead en instabiliteit toevoegt. Daarentegen spreidt het geleerde DRLO-VANET-beleid de belasting gelijkmatiger, vermijdt duidelijk slechte draadloze verbindingen en beperkt onnodige handovers. In simulaties verlaagt het de taakvertraging tot ongeveer 40 procent, vermindert het energieverbruik met 30–35 procent, houdt het meer dan 90 procent van de taken op tijd bij middenverkeer en halveren de handover-gebeurtenissen ruwweg vergeleken met de gulzige methode.

Wat dit betekent voor alledaagse bestuurders

Voor niet-specialisten is de belangrijkste conclusie dat auto’s en wegen veel intelligenter kunnen samenwerken dan nu het geval is. In plaats van starre regels kan een op leren gebaseerd controller observeren hoe druk de weg en het netwerk zijn en stilletjes kiezen waar elke digitale taak moet worden uitgevoerd, zodat reacties snel blijven, batterijen langer meegaan en wegkantenapparatuur niet overbelast raakt. Hoewel deze studie is gebaseerd op simulatie en niet op echte auto’s, wijst het op een toekomst waarin het ‘denken’ dat nodig is voor autonoom rijden automatisch wordt verdeeld tussen voertuigen en nabijgelegen infrastructuur, waardoor geavanceerde veiligheids- en navigatiediensten betrouwbaarder worden, zelfs in druk en snel veranderend verkeer.

Bronvermelding: Neelima, S., Sree, S.R. & Ramakrishnaiah, N. DRLO-VANET: a deep reinforcement learning-based offloading framework for low-latency and energy-efficient task execution in VANETs. Sci Rep 16, 10582 (2026). https://doi.org/10.1038/s41598-026-46336-w

Trefwoorden: autonome voertuigen, edge computing, voertuignetwerken, reinforcement learning, taakuitbesteding