Clear Sky Science · pt

Sign4all: um conjunto de dados de Língua de Sinais Espanhola

Mãos que falam com máquinas

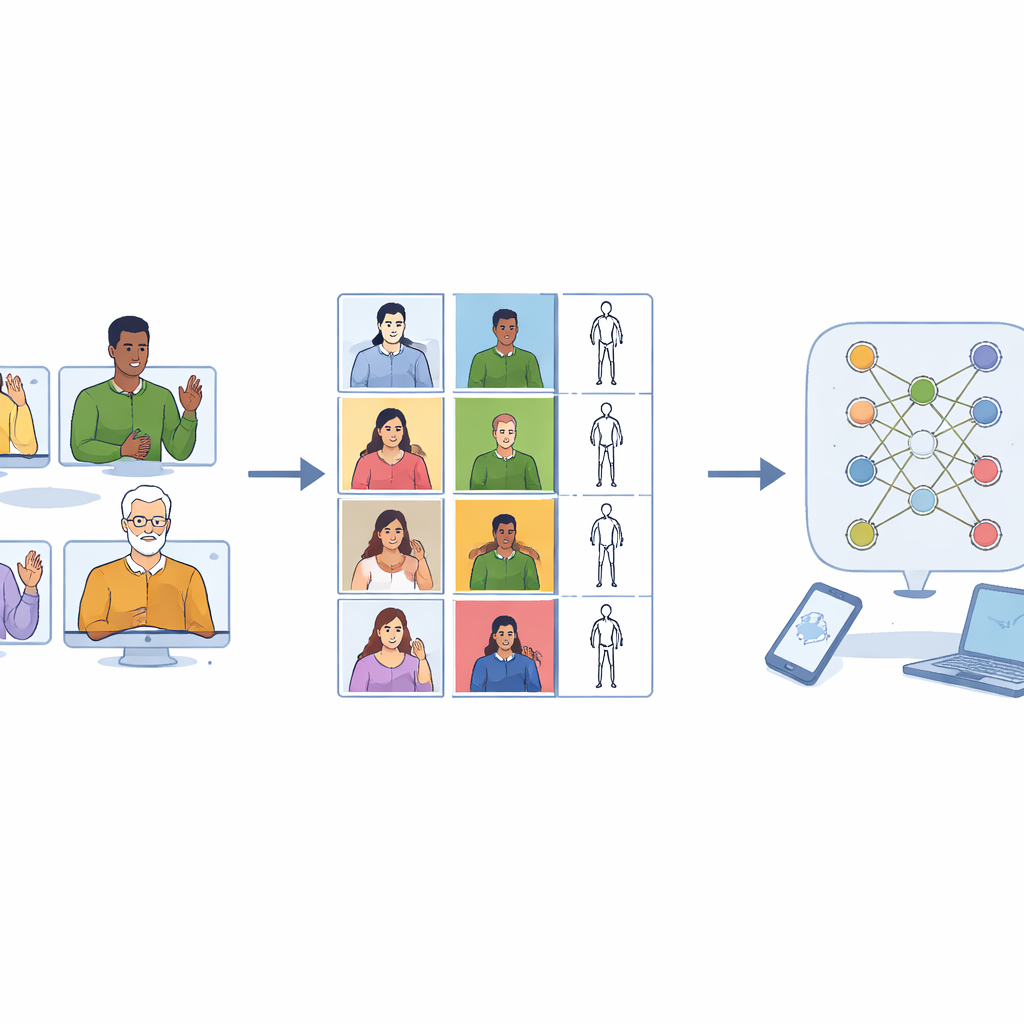

Milhões de pessoas ao redor do mundo dependem de línguas de sinais como sua principal forma de comunicação, mas a maioria dos aplicativos e aparelhos hoje em dia ainda “ouve” apenas palavras faladas. Para reduzir essa lacuna, os computadores precisam de grandes coleções de vídeos de língua de sinais, cuidadosamente projetadas, para aprender. Este artigo apresenta o Sign4all, um novo conjunto de dados de Língua de Sinais Espanhola criado para ajudar futuros telefones, laptops e dispositivos públicos a entender sinais cotidianos de forma mais justa e precisa.

Por que são necessários novos dados para língua de sinais

Assistentes de voz melhoraram rapidamente porque foram treinados com vastas coleções de áudio. As línguas de sinais não tiveram o mesmo progresso. Conjuntos de dados existentes frequentemente tentam cobrir milhares de palavras diferentes, mas mostram cada uma apenas algumas vezes. Isso dificulta o aprendizado por parte do computador de como o mesmo sinal pode parecer ligeiramente diferente entre pessoas, roupas, velocidade ou ângulo de câmera. Muitas coleções também gravam apenas pessoas que sinalizam com a mão direita, embora uma parcela considerável da população use a mão esquerda ou ambas. Como resultado, sistemas treinados com esses dados podem falhar quando encontram pessoas canhotas ou variações sutis no movimento.

Um vocabulário focado na vida cotidiana

Em vez de visar apenas amplitude, o Sign4all adota uma abordagem de “pequeno, mas profundo”. Os autores gravaram 24 sinais comuns da Língua de Sinais Espanhola relacionados a comer fora e refeições diárias: pronomes como “eu” e “você”, alimentos como carne, peixe e sopa, utensílios como colher e garfo, e palavras interrogativas incluindo “o que”, “onde” e “quando”. Para cada sinal há, em média, mais de 300 clipes de vídeo em alta resolução, oferecendo aos algoritmos de aprendizado muitos exemplos de como cada gesto pode variar. O vocabulário também foi escolhido para que os sinais possam ser combinados em frases curtas, como “Eu não gosto de carne” ou “Eu como carne e ovos no café da manhã”, permitindo que pesquisadores explorem reconhecimento de frases simples no futuro.

Construindo equilíbrio entre esquerda e direita

Uma escolha de projeto importante foi tratar a sinalização com a mão esquerda e com a mão direita como igualmente relevante. Oito voluntários (quatro mulheres e quatro homens) foram gravados em laboratório usando uma câmera de alta qualidade. Cada um deles realizou cada sinal unimanual ou sinais assimétricos de duas mãos tanto com a mão dominante quanto com a não dominante. Sinais simétricos de duas mãos foram gravados com repetições extras para que cada classe de sinal terminasse com aproximadamente o mesmo número de clipes. Após um corte manual cuidadoso, a coleção final inclui 7.756 vídeos, quase perfeitamente divididos entre performances com a mão esquerda e com a mão direita. Esse equilíbrio permite que futuros sistemas de reconhecimento aprendam a ignorar qual mão lidera o movimento e se concentrem no padrão em si.

Transformando vídeos ricos em dados de movimento limpos

As gravações foram processadas para torná‑las o mais úteis possível para aprendizado de máquina. Cada vídeo foi aparado para conter apenas o sinal efetivo, não o movimento de entrar ou sair da posição. Todos os clipes foram padronizados para 48 quadros — tempo suficiente para capturar um gesto típico — de modo que modelos não possam trapacear simplesmente usando a duração do clipe para adivinhar a palavra. As imagens foram recortadas ao redor do sinalizador para remover teto e chão, preservando a forma corporal natural e evitando distorções que apareceriam se filmagens retangulares brutas fossem redimensionadas aleatoriamente. Além dos vídeos coloridos, a equipe usou uma ferramenta de rastreamento de pose para extrair as posições das articulações-chave do tronco superior e dos dedos, construindo uma descrição compacta em “figura de pau” quadro a quadro. Esses esqueletos são armazenados em formatos científicos amplamente usados para que possam ser conectados diretamente a softwares modernos de aprendizado profundo.

Ensinando computadores com variação, não perfeição

Ambientes do mundo real são confusos: pessoas usam roupas diferentes, a iluminação muda ao longo do dia e as câmeras tremem ligeiramente. Para ajudar os sistemas a lidar com essa variação, os autores criaram versões extras pré-processadas do conjunto de dados. Alguns clipes são espelhados esquerda‑para‑direita para simular a mão oposta; outros são alterados com pequenas mudanças de brilho, cor, desfoque ou rotação, sem prejudicar o significado do sinal. Isso elevou o número total de amostras para mais de 60.000. Testes com um modelo Transformer baseado em vídeo — um tipo moderno de rede neural — mostraram que treinar com esses dados enriquecidos melhorou drasticamente o desempenho do reconhecimento. Um modelo mais simples treinado apenas com os dados de movimento esquelético também alcançou alta acurácia, comprovando que o conjunto de dados captura a informação essencial necessária para distinguir sinais semelhantes.

O que isso significa para tecnologia inclusiva

Para um leigo, a mensagem do Sign4all é direta: quanto melhor e mais justo for o material de treinamento que damos às nossas máquinas, melhor elas serão em entender quem usa sinais. Ao oferecer milhares de exemplos equilibrados e de alta qualidade de sinais espanhóis do dia a dia — junto com descrições de movimento prontas para uso e divisões de treinamento padrão — este conjunto de dados estabelece a base para sistemas de reconhecimento de língua de sinais mais confiáveis. Com o tempo, essas ferramentas podem suportar legendagem em tempo real, serviços públicos mais acessíveis e uma comunicação mais fluida entre comunidades surdas e ouvintes, ajudando a garantir que a tecnologia digital ouça as mãos tanto quanto as vozes.

Citação: Morillas-Espejo, F., Martinez-Martin, E. Sign4all: a Spanish Sign Language dataset. Sci Data 13, 502 (2026). https://doi.org/10.1038/s41597-026-06872-6

Palavras-chave: reconhecimento de língua de sinais, Língua de Sinais Espanhola, conjuntos de dados de gestos, tecnologia assistiva, aprendizado de máquina