Clear Sky Science · de

Ein verbessertes Verfahren zur Erkennung der diabetischen Retinopathie mithilfe optimierter Deep‑Learning‑Techniken

Warum frühes Erkennen von Augenschäden wichtig ist

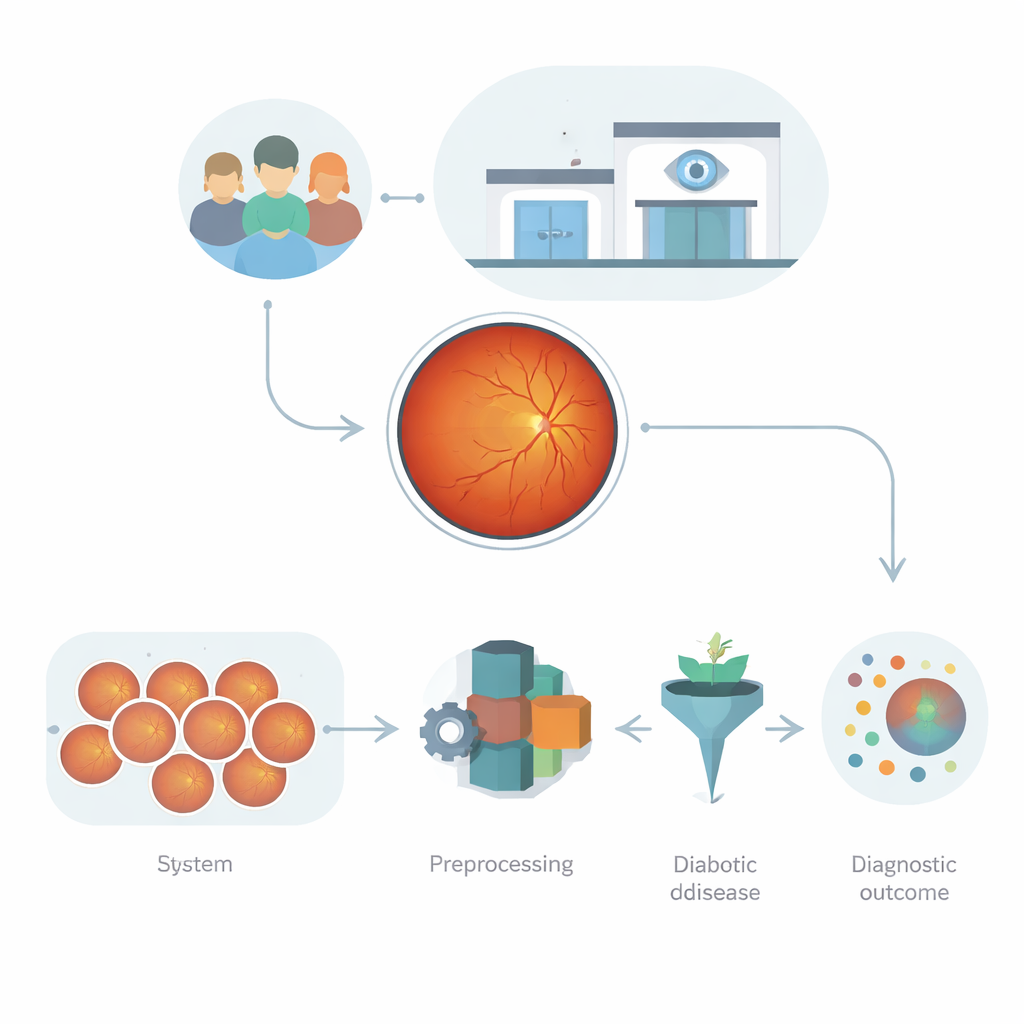

Diabetes kann heimlich die winzigen Blutgefäße im hinteren Teil des Auges schädigen und schließlich zu verschwommenem Sehen oder sogar Blindheit führen. Augenärzte können diesen Zustand — diabetische Retinopathie genannt — durch die Untersuchung detaillierter Aufnahmen der Netzhaut feststellen. Bei Millionen gefährdeter Personen und zu wenigen Spezialisten werden jedoch viele Patientinnen und Patienten nicht rechtzeitig untersucht. Diese Studie untersucht, wie ein sorgfältig entwickeltes System der künstlichen Intelligenz Netzhautfotos genauer und verlässlicher lesen kann, um Probleme frühzeitig zu erkennen und somit das Sehvermögen zu retten.

Augenaufnahmen als Datenschatz

Netzhautaufnahmen, sogenannte Fundusbilder, sind weit mehr als einfache Fotos. Sie zeigen, wie Licht von den Schichten des Auges absorbiert, reflektiert und gestreut wird und offenbaren Gefäße, kleine Lecks und Narben. Diese Muster enthalten viele Hinweise auf diabetische Schäden, sind aber auch komplex: Bilder unterscheiden sich in Helligkeit, Schärfe, Kameratyp und Patientenhintergrund. Frühere Computerprogramme stützten sich entweder auf handgefertigte Messgrößen, die subtile Veränderungen übersehen, oder auf Deep‑Learning‑Netze, die zwar mächtig, aber anfällig für Overfitting sind — besonders wenn sich Bildqualität oder klinische Rahmenbedingungen ändern. Die Herausforderung besteht darin, ein automatisiertes System zu bauen, das aus diesen unordentlichen, hochdimensionalen Daten lernen kann, ohne spröde oder unvorhersehbar zu werden.

Ein neuronales Netz beibringen, wichtige Warnzeichen zu sehen

Die Autoren verwenden zunächst ein modernes Deep‑Learning‑Modell, EfficientNet‑B0, als leistungsfähigen „Feature‑Extractor“ für jedes Netzhautbild. Statt dass Ärztinnen und Ärzte jede Blutung oder Fettablagerung manuell markieren, lernt das Netz abstrakte visuelle Muster, die bei kranken gegenüber gesunden Augen konsistent auftreten. Um das System robuster zu machen, werden alle Bilder bereinigt und standardisiert: Sie werden skaliert, in Graustufen konvertiert, um die Struktur statt der Farbe zu betonen, und verstärkt, um winzige Flecken und Gefäßdetails zu schärfen. Die Graustufenbilder werden dann in ein Format umgewandelt, das das vortrainierte Netzwerk verarbeiten kann, und die letzten Schichten des Netzes werden behutsam feinabgestimmt, sodass seine internen Filter stärker auf netzhautspezifische Strukturen reagieren statt auf Alltagsobjekte.

Eine virtuelle Schwarmintelligenz wählt die aussagekräftigsten Hinweise

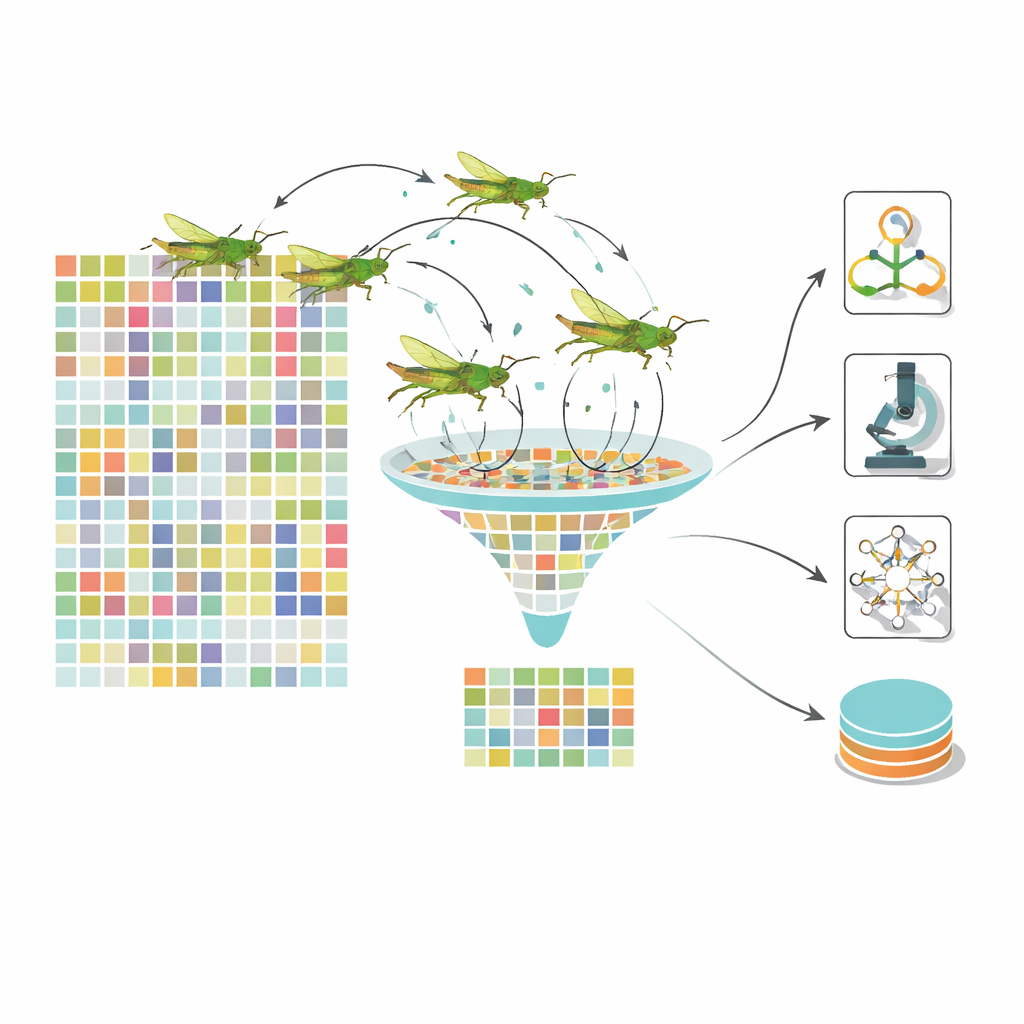

Auch nach Deep Learning wird jedes Bild durch mehr als tausend numerische Merkmale beschrieben, von denen viele redundant sind. Alle diese Merkmale in einen Klassifikator zu speisen verlangsamt das Lernen und kann die Trennung zwischen Krankheitsstadien verwischen. Zur Lösung greift das Team auf einen naturinspirierten Optimierer zurück, modelliert nach der Bewegung von Heuschrecken. In ihrem dynamischen Heuschrecken‑Optimierungsalgorithmus steht jede „Heuschrecke“ für eine andere Merkmalsuntermenge. Über viele Iterationen erkundet der Schwarm Kombinationen, gesteuert durch ein Gleichgewicht aus weiträumigem Erkunden und dem Zulaufen auf vielversprechende Bereiche. Entscheidend ändern sich die Kontrollparameter im Zeitverlauf, sodass der Schwarm nicht zu früh stecken bleibt. Das Ergebnis ist eine deutlich kleinere Menge hochinformativer Merkmale — etwa hundert statt 1.280 — die dennoch wichtige Zeichen wie Cluster von Mikroaneurysmen, Flecken von Exsudaten oder Muster von Gefäßverdickungen kodieren.

Viele einfache Stimmen ergeben eine stärkere Diagnose

Statt einem einzelnen Modell zu vertrauen, verwendet das System ein gestapeltes Ensemble mehrerer verschiedener Klassifikatoren. Eine Support‑Vector‑Machine, ein Bayes‑Netzwerk und ein Entscheidungsbaum erhalten jeweils die optimierte Merkmalsmenge und geben ihre eigene Wahrscheinlichkeit aus, dass ein Auge zu einem bestimmten Krankheitsstadium gehört. Diese „Meinungen“ werden dann von einer schnellen Gradient‑Boosting‑Methode namens LightGBM kombiniert, die lernt, wie sie die Basis‑Modelle situationsabhängig gewichten soll. Dieses geschichtete Design reduziert die Wahrscheinlichkeit, dass die blinden Flecken eines einzelnen Modells dominieren. Die Autoren testen ihr Framework an großen öffentlichen Datensätzen von Netzhautbildern, darunter die häufig verwendeten EyePACS‑ und APTOS‑Sammlungen, und vergleichen es mit führenden Deep‑Learning‑Pipelines und anderen bioinspirierten Optimierern.

Wie gut das System in praxisnahen Tests abschneidet

Über die Experimente hinweg übertrifft das dynamische Heuschrecken‑Ensemble‑Framework konsistent konkurrierende Methoden. Auf wichtigen Benchmarks erreicht es etwa 94–95 % Genauigkeit, einen hohen F1‑Score (der verpasste Fälle und Fehlalarme ausgleicht) und eine Fläche unter der ROC‑Kurve von 0,96, was auf eine starke Trennung zwischen gesunden und erkrankten Augen hinweist. Es generalisiert zudem gut über verschiedene Trainings‑Test‑Aufteilungen und zusätzliche Datensätze und behält den Großteil seiner Leistung, wenn Bilder künstlich verrauschter oder verzerrter gemacht werden — Bedingungen, die die Variabilität in der realen Klinik nachahmen sollen. Im Gegensatz dazu neigen frühere Schwarmalgorithmen mit festen Einstellungen dazu, zu früh zu konvergieren, mehr redundante Merkmale beizubehalten und geringere Sensitivität und Spezifität zu liefern, insbesondere bei herausfordernden oder unausgewogenen Daten.

Was das für Patientinnen, Patienten und Kliniken bedeutet

Einfach gesagt zeigt die Studie, dass die Kombination eines modernen Bildanalyse‑Netzes mit einem intelligenten merkmalsauswählenden Schwarm und einem Team einfacher Klassifikatoren ein schnelles, genaues und vergleichsweise robustes „zweites Auge“ für diabetische Augenerkrankungen liefern kann. Ein solches Werkzeug wird Augenärztinnen und -ärzte nicht ersetzen, kann aber helfen, gefährdete Patientinnen und Patienten früher zu kennzeichnen — besonders in stark ausgelasteten oder unterversorgten Kliniken, in denen Spezialisten knapp sind. Die Autoren weisen darauf hin, dass weitere Validierung an lokalen Krankenhausdaten und Arbeit zur Reduzierung der Rechenkosten noch erforderlich sind, aber ihr physikbewusster, optimierungsgetriebener Ansatz rückt das automatisierte Screening näher an eine vertrauenswürdige, reale Anwendung.

Zitation: Darwish, S.M., Milad, K.G. & Ibrahim, R.E.ED. An enhanced diabetic retinopathy detection approach using optimized deep learning technique. Sci Rep 16, 9825 (2026). https://doi.org/10.1038/s41598-026-41998-y

Schlüsselwörter: diabetische Retinopathie, Netzhautbildgebung, Deep Learning, Merkmalsauswahl, medizinische KI