Clear Sky Science · zh

用于无线传感器网络能效故障恢复与拓扑稳定性的进化强化学习框架

智能传感网络为何重要

从精准农业到灾害预警系统,无线传感器网络在背后默默监视我们的世界。分布在城市、工厂、森林和医院的微型电池供电设备采集数据并回传以供分析。但由于这些传感器成本低、位置偏远且难以维护,它们经常故障且电量消耗快。本文探讨了一种新方法,旨在通过一种称为 EvoGenRL 的智能学习框架,让此类网络运行更久、更可靠,并减少人工干预。

电量耗尽与故障传感器的挑战

无线传感器网络需要同时平衡多项需求。每个节点的电池和计算能力都非常有限。天气、物理损伤或干扰可能导致节点或链路失效,破坏通信路径。随着网络规模和复杂度增长,流量负载和周边环境持续变化。传统方法通常只解决单一方面,如节能或改善路由,而且通常为固定、可预测的情形设计。因此,当故障累积或条件改变时,网络可能出现数据丢失、延迟增加和寿命缩短等问题。

为传感网络打造的学习大脑

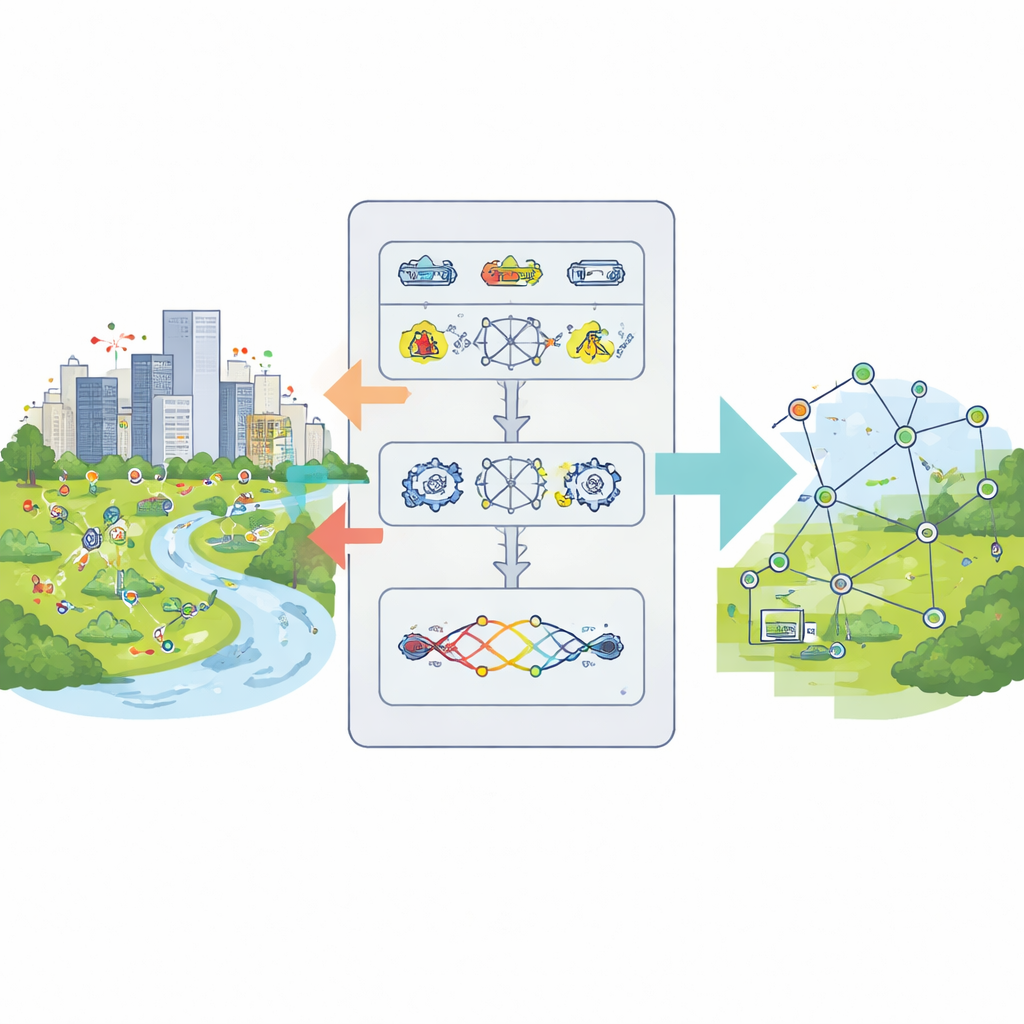

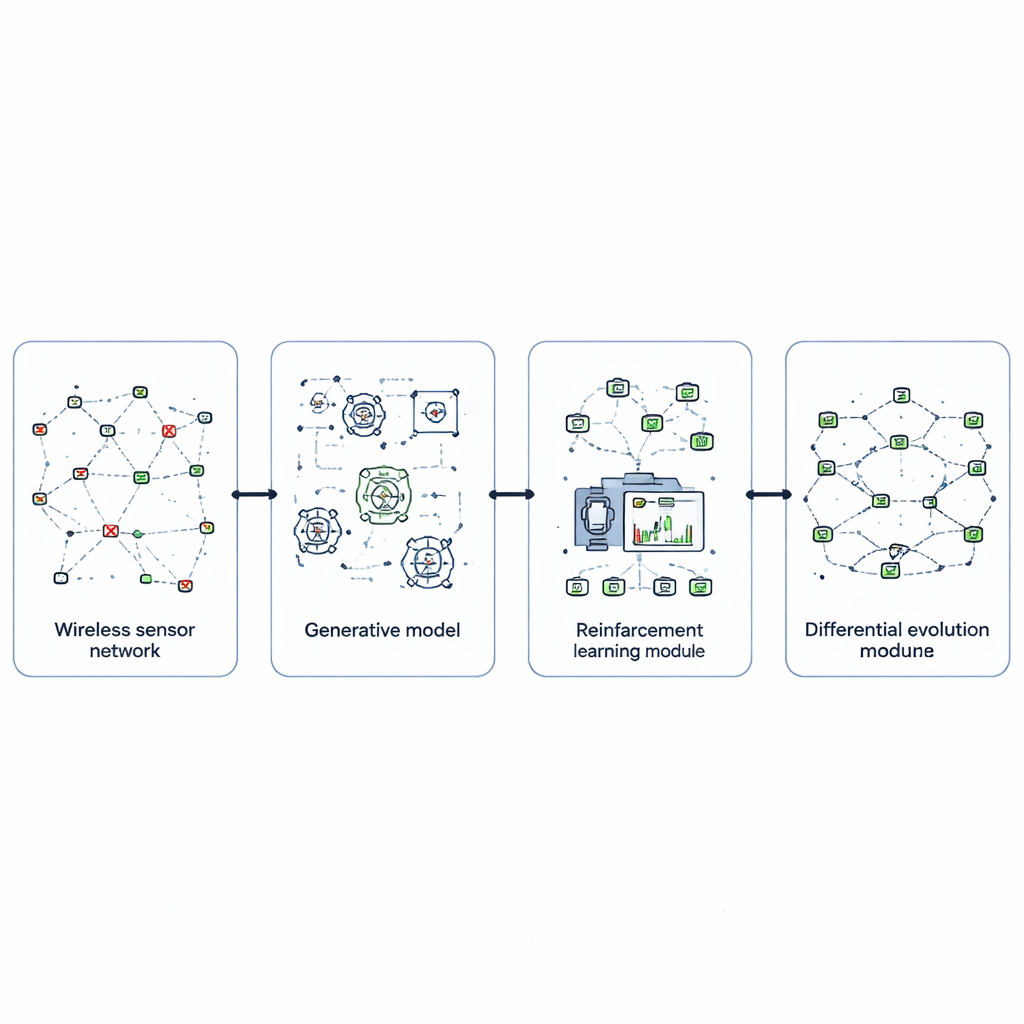

为了解决这些问题,作者设计了 EvoGenRL,这是一个将网络视为可从经验中学习的系统的综合学习框架。其核心是强化学习——一种试错方法,智能体观察网络状态(如电池电量、传输成功率和近期故障),并选择诸如改变路由、让部分节点休眠或重传数据等动作。那些能够节能、提高数据包交付率并更快从故障中恢复的动作会获得更高的奖励,从而引导智能体形成更好的长期行为。这将网络控制从固定规则转变为可适应的新策略,随着遇到新情形而不断改进。

在问题发生前先行想象

任何学习系统的一大难点是如何在足够真实的情形下训练它,尤其是那些罕见但破坏性强的故障。EvoGenRL 采用生成对抗网络来应对这一问题,这类模型能够创造出模仿真实样本的新数据。在这里,生成器网络构造出可信的传感器故障模式——例如故障节点簇或干扰突发——而判别器网络则判断这些模式是否像真实记录的事件。通过彼此竞争,生成器产生了大量可信的故障情景。这些合成情形与真实数据混合后输入强化学习智能体,使其在网络真正遭遇问题之前,能够练习应对多种故障。

通过进化微调行为

即便是聪明的学习智能体,其表现也强烈依赖内部设置,例如学习速率、对未来奖励的重视程度和探索新动作的频率。作者并没有手工挑选这些参数,而是使用一种称为差分进化的进化搜索方法。他们将每组可能的设置视为种群中的个体,并根据相应智能体在仿真中控制网络的表现进行“竞争”。通过反复变异、组合和选择最佳候选,方法会收敛到使学习更快、更稳定并更适应变化网络条件的超参数。这个进化层包裹在学习智能体之外,不断提高其性能。

将框架付诸检验

研究人员使用公开的无线传感活动数据集和详细的网络仿真评估了 EvoGenRL,并将其与若干近期文献中的既有路由和优化方案进行了比较。跨越多次重复运行以及不同网络规模和故障率,该新框架在能耗、节点存活时间和连接稳定性方面均表现更佳。具体数据上,EvoGenRL 将每节点能耗降至约 2.2 焦耳,将网络寿命延长到 1700 个周期,并将成功交付的数据包比例提高到 99.7%。它还将数据在网络中传输的时延降至几毫秒,并提升整体数据速率,意味着网络在节能的同时仍能保持响应性。

这对日常技术意味着什么

简而言之,EvoGenRL 教会传感网络自我照护。通过模拟多种故障情形、学习哪种应对最有效并持续微调自身行为,该系统可以延长电池寿命并在故障与变化条件下保持数据流通。这使其在医疗监测、工业控制和环境监测等关键任务场景中具有吸引力——这些场合维护成本高昂或危险,且无法容忍停机。尽管该方法在训练阶段仍需显著计算资源,但它为未来更智能、更稳健且更节能的自管理网络提供了有前景的蓝图。

引用: Lakshmi, S., Aswath, S., Swaminathan, A. et al. Evolutionary reinforcement learning framework for energy-efficient fault resilience and topological stability in WSNs. Sci Rep 16, 11769 (2026). https://doi.org/10.1038/s41598-026-38518-3

关键词: 无线传感器网络, 节能网络, 容错系统, 强化学习, 生成模型