Clear Sky Science · it

Framework di apprendimento per rinforzo evolutivo per la resilienza ai guasti a basso consumo e la stabilità topologica nelle WSN

Perché le reti di sensori intelligenti sono importanti

Dalla agricoltura di precisione ai sistemi di allerta per disastri, le reti di sensori wireless sorvegliano il nostro mondo in modo discreto. Piccoli dispositivi alimentati a batteria, dispersi tra città, fabbriche, boschi e ospedali, raccolgono dati e li inviano per l’analisi. Poiché questi sensori sono economici, remoti e difficili da mantenere, guastano spesso e consumano rapidamente l’energia. Questo articolo esplora un nuovo modo per mantenere tali reti operative più a lungo, in modo più affidabile e con meno interventi umani, sfruttando un framework di apprendimento intelligente chiamato EvoGenRL.

La sfida dei sensori stanchi e in avaria

Le reti di sensori wireless devono bilanciare più esigenze contemporaneamente. Ogni nodo dispone di energia di batteria e capacità di calcolo molto limitate. Meteo, danni fisici o interferenze possono far fallire nodi o collegamenti, interrompendo i percorsi di comunicazione. Con la crescita e la complessità delle reti, i carichi di traffico e le condizioni ambientali cambiano continuamente. I metodi tradizionali affrontano solitamente un solo aspetto, come il risparmio energetico o il miglioramento del routing, e sono spesso progettati per scenari fissi e prevedibili. Di conseguenza, quando i guasti si accumulano o le condizioni variano, queste reti possono subire perdita di dati, ritardi maggiori e vite operative più corte.

Un cervello che impara per le reti di sensori

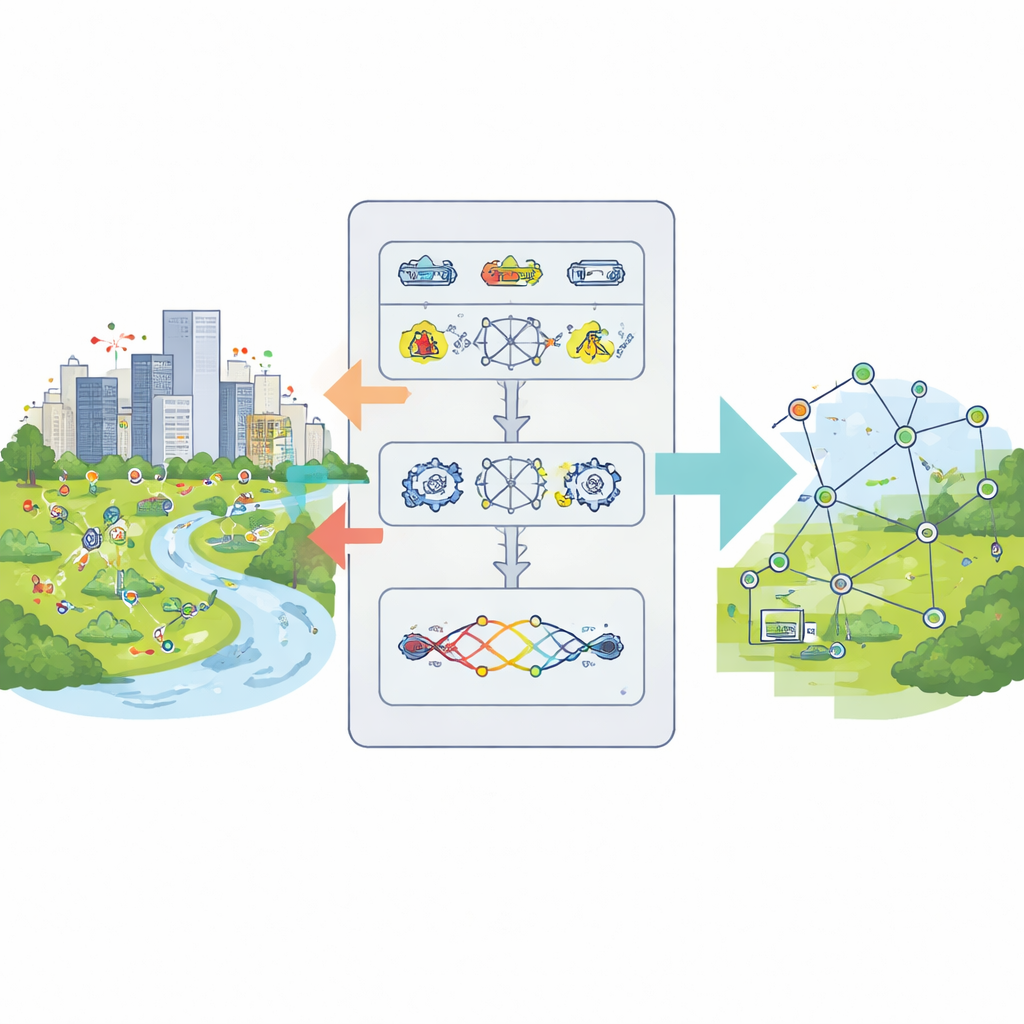

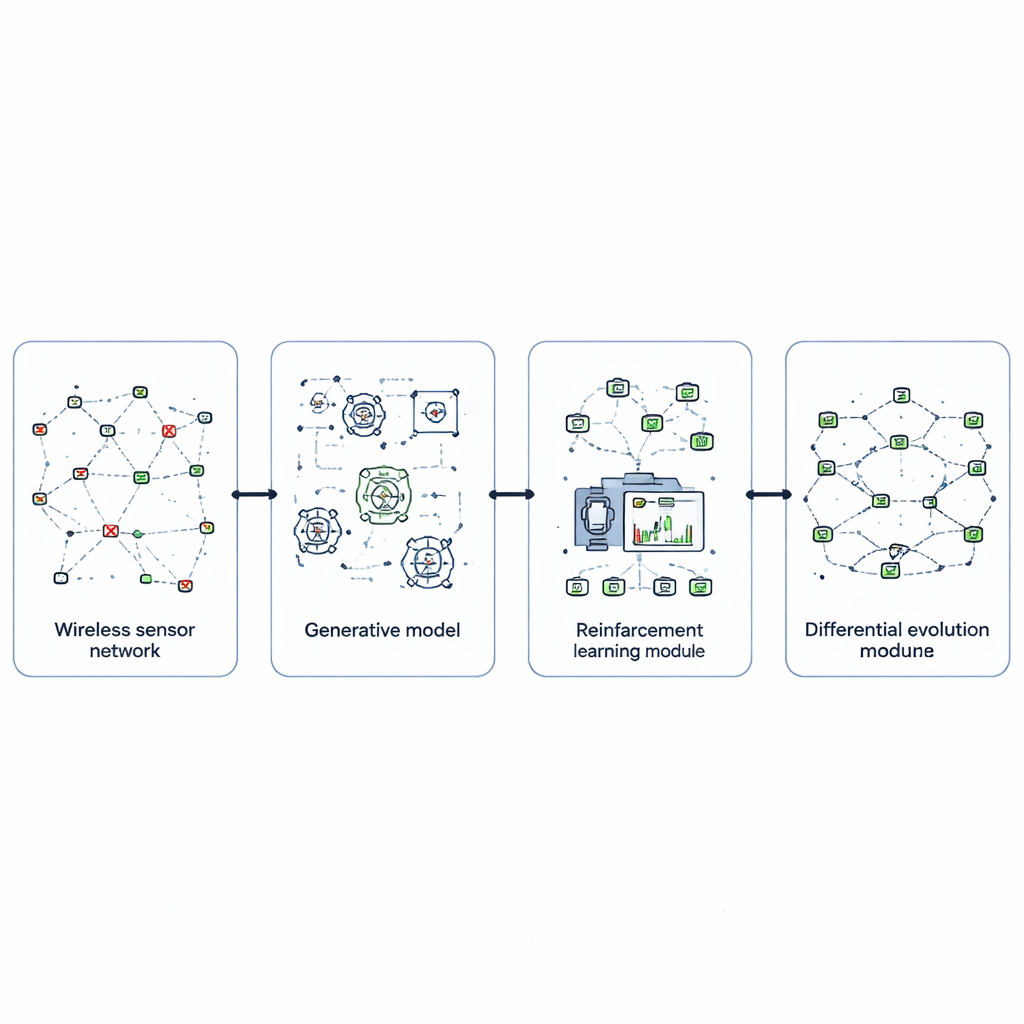

Per rispondere a queste sfide, gli autori progettano EvoGenRL, un framework di apprendimento integrato che considera la rete come un sistema in grado di apprendere dall’esperienza. Al suo centro c’è l’apprendimento per rinforzo, un metodo per tentativi ed errori in cui un agente intelligente osserva lo stato della rete — come livelli di batteria, successo delle consegne e guasti recenti — e sceglie azioni come cambiare i percorsi, mettere alcuni nodi in sleep o ritrasmettere dati. Le azioni che risparmiano energia, aumentano le consegne di pacchetti e recuperano più rapidamente dai guasti ottengono ricompense maggiori, spingendo l’agente verso comportamenti migliori a lungo termine. Questo trasforma il controllo della rete da regole fisse a una politica adattativa che migliora incontrando nuove situazioni.

Immaginare i problemi prima che accadano

Una difficoltà chiave per qualsiasi sistema di apprendimento è addestrarlo su abbastanza situazioni realistiche, specialmente guasti rari ma dannosi. EvoGenRL affronta questo problema usando le generative adversarial networks, una classe di modelli che possono inventare nuovi dati che imitano esempi reali. Qui, una rete generatrice fabbrica pattern plausibili di guasti dei sensori — come cluster di nodi in avaria o raffiche di interferenza — mentre una rete discriminatrice valuta se questi pattern assomigliano a eventi registrati realmente. Attraverso la loro competizione, il generatore produce una ricca varietà di scenari di guasto credibili. Queste situazioni sintetiche vengono miste ai dati reali e fornite all’agente di apprendimento per rinforzo, così che possa esercitarsi a gestire molti tipi di problemi prima che la rete li incontri sul campo.

Affinare il comportamento tramite l’evoluzione

Anche un agente di apprendimento intelligente dipende fortemente dalle impostazioni interne, come la velocità di apprendimento, il valore attribuito alle ricompense future e la frequenza con cui esplorare nuove azioni. Invece di scegliere questi parametri manualmente, gli autori usano un metodo di ricerca evolutiva chiamato differential evolution. Trattano ogni possibile configurazione come un individuo in una popolazione e li fanno “competere” in base a quanto bene l’agente risultante controlla la rete in simulazione. Mutando, combinando e selezionando ripetutamente i migliori candidati, il metodo converge verso iperparametri che rendono l’apprendimento più veloce, più stabile e meglio adattato a condizioni di rete variabili. Questo strato evolutivo avvolge l’agente di apprendimento, affilando progressivamente le sue prestazioni.

Mettere alla prova il framework

I ricercatori valutano EvoGenRL utilizzando un dataset pubblico di attività di sensori wireless e simulazioni di rete dettagliate. Lo confrontano con diversi schemi consolidati di routing e ottimizzazione tratti dalla letteratura recente. In esperimenti ripetuti e variando dimensioni di rete e tassi di guasto, il nuovo framework usa costantemente meno energia, mantiene più nodi attivi più a lungo e conserva connessioni più stabili. In termini numerici, EvoGenRL riduce il consumo energetico a circa 2,2 joule per nodo, estende la vita della rete a 1700 cicli e aumenta la quota di pacchetti dati consegnati con successo al 99,7 percento. Riduce anche il tempo di attraversamento dei dati nella rete a pochi millisecondi e aumenta il bit rate complessivo, il che significa che la rete rimane reattiva pur risparmiando energia.

Cosa significa per la tecnologia di tutti i giorni

In termini semplici, EvoGenRL insegna a una rete di sensori a prendersi cura di sé. Simulando molti tipi di guasti, imparando quali risposte funzionano meglio e perfezionando continuamente il proprio comportamento, il sistema può prolungare la vita delle batterie e mantenere il flusso di dati nonostante guasti e condizioni variabili. Questo lo rende interessante per applicazioni critiche, come il monitoraggio medico, il controllo industriale e la sorveglianza ambientale, dove le visite di manutenzione sono costose o pericolose e i tempi di inattività sono inaccettabili. Pur richiedendo ancora risorse di calcolo significative durante l’addestramento, offre un progetto promettente per future reti autogestite più intelligenti, più robuste e più attente al loro limitato budget energetico.

Citazione: Lakshmi, S., Aswath, S., Swaminathan, A. et al. Evolutionary reinforcement learning framework for energy-efficient fault resilience and topological stability in WSNs. Sci Rep 16, 11769 (2026). https://doi.org/10.1038/s41598-026-38518-3

Parole chiave: reti di sensori wireless, networking a basso consumo energetico, sistemi tolleranti ai guasti, apprendimento per rinforzo, modelli generativi