Clear Sky Science · sv

Evolutionsbaserat förstärkningsinlärningsramverk för energieffektiv felförtjänst och topologisk stabilitet i WSN

Varför intelligenta sensornät är viktiga

Från precisionsjordbruk till katastrofvarningssystem övervakar trådlösa sensornät diskret vår omgivning. Små batteridrivna enheter utspridda i städer, fabriker, skogar och sjukhus samlar in data och skickar dem vidare för analys. Eftersom dessa sensorer är billiga, ofta svårservade och ligger i avlägsna miljöer, går de ofta sönder och dränerar batterier snabbt. Denna artikel undersöker ett nytt sätt att hålla sådana nätverk igång längre, pålitligare och med färre mänskliga ingripanden, genom ett intelligent inlärningsramverk som kallas EvoGenRL.

Problemet med utmattade och felande sensorer

Trådlösa sensornät måste balansera flera krav samtidigt. Varje nod har mycket begränsad batterikapacitet och beräkningskraft. Väder, fysisk skada eller störningar kan få noder eller länkar att sluta fungera och bryta kommunikationsvägar. När nätverk växer i storlek och komplexitet förändras trafiken och omgivningsförhållandena ständigt. Traditionella metoder tar vanligtvis bara itu med en aspekt—till exempel energibesparing eller förbättrad routing—och de är ofta utformade för fasta, förutsägbara situationer. Som en följd kan nätverk få bortfall av data, ökade fördröjningar och förkortad livslängd när fel ackumuleras eller förhållanden skiftar.

En lärande hjärna för sensornät

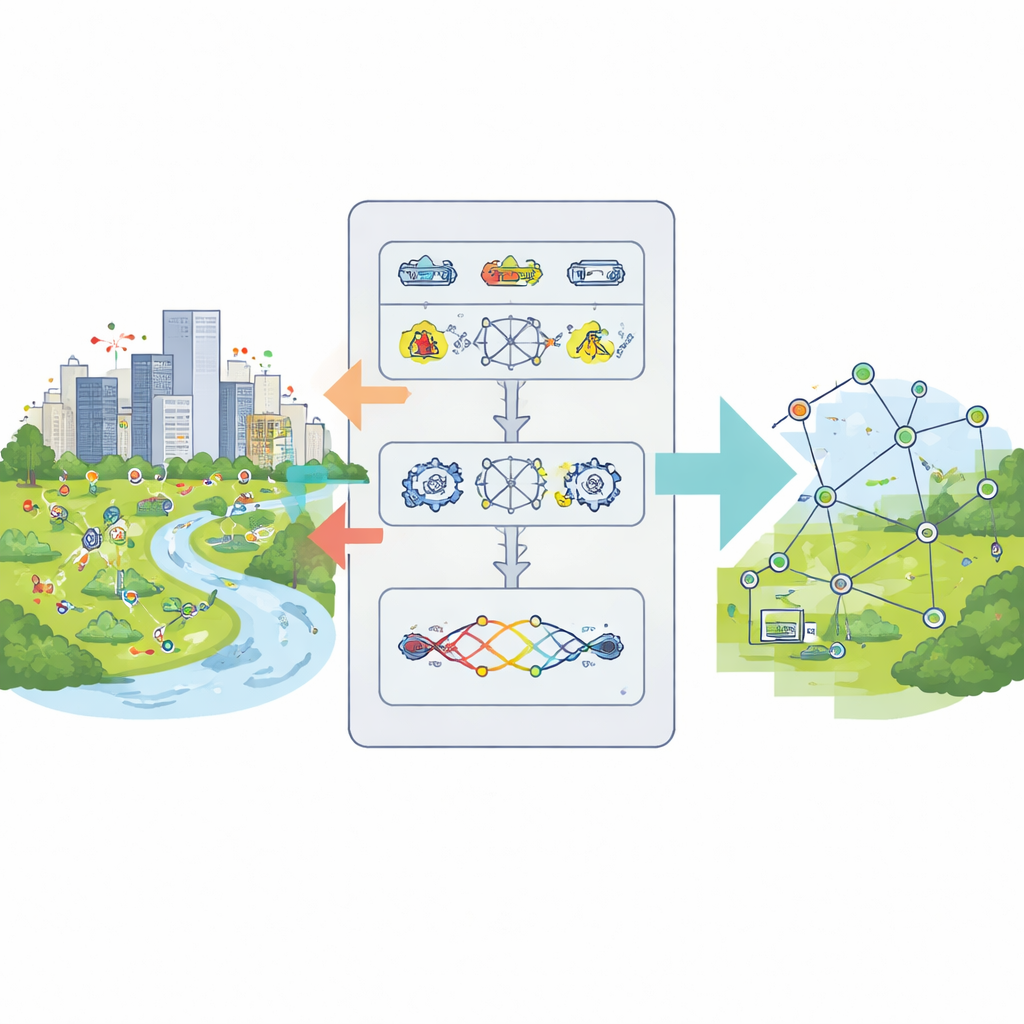

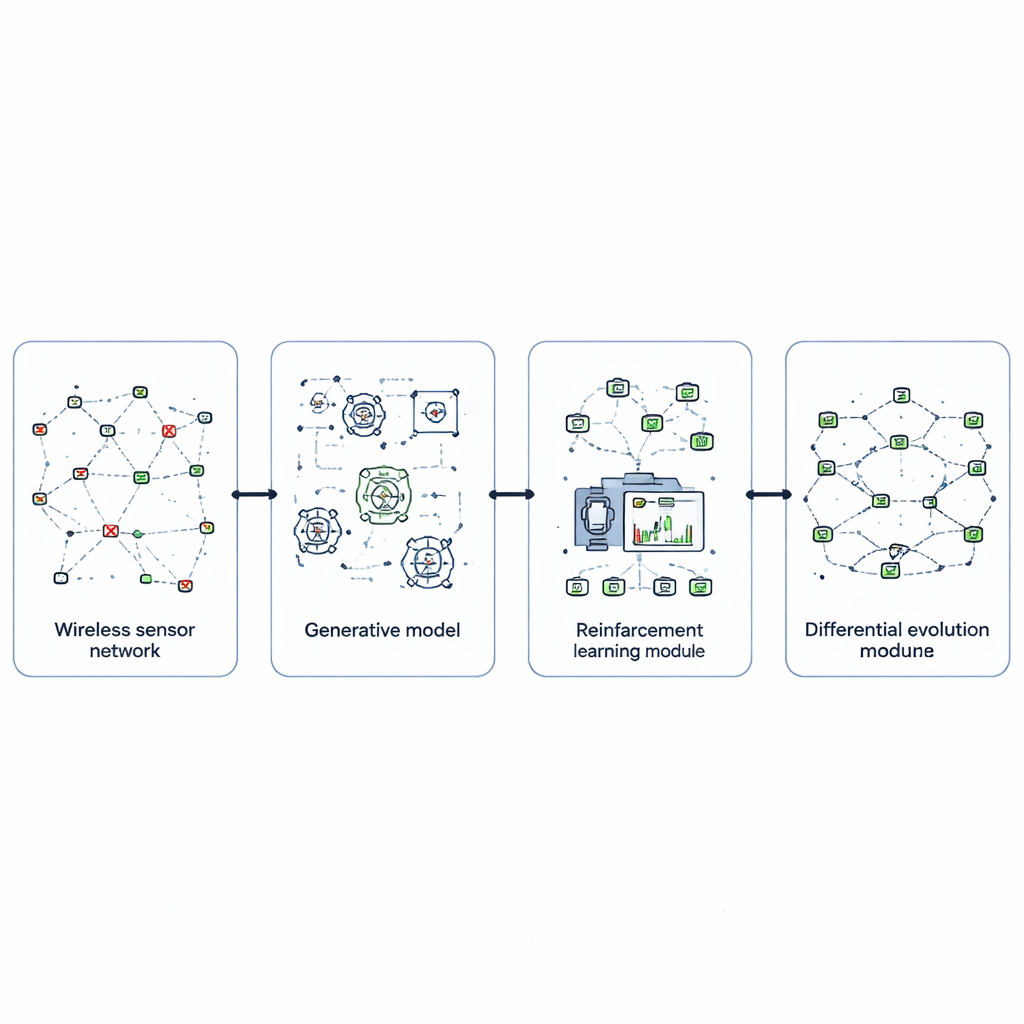

För att tackla detta utformar författarna EvoGenRL, ett sammansatt inlärningsramverk som behandlar nätverket som ett system som kan lära av erfarenhet. I kärnan finns förstärkningsinlärning, en prövning‑och‑fel‑metod där en intelligent agent observerar nätverkets tillstånd—såsom batterinivåer, leveransframgång och nyligen inträffade fel—och väljer åtgärder som att ändra rutter, låta vissa noder gå i viloläge eller sända om data. Åtgärder som spar energi, levererar fler paket och återhämtar sig snabbare från fel belönas högre, vilket styr agenten mot bättre långsiktigt beteende. Detta omvandlar nätverksstyrning från fasta regler till en adaptiv policy som förbättras när den möter nya situationer.

Föreställa sig problem innan de händer

En central svårighet med alla inlärningssystem är att träna dem på tillräckligt realistiska situationer, särskilt sällsynta men skadliga fel. EvoGenRL hanterar detta med generativa adversariella nätverk, en klass modeller som kan skapa ny data som efterliknar verkliga exempel. Här fabricerar en generatornätverk trovärdiga mönster av sensorfel—som kluster av felande noder eller plötsliga störningsutbrott—medan ett diskriminatornätverk bedömer om dessa mönster liknar verkligt inspelade händelser. Genom deras konkurrens producerar generatorn en rik variation av trovärdiga felscenarier. Dessa syntetiska situationer blandas med verkliga data och matas till förstärkningsinlärningsagenten, så att den kan öva på att hantera många typer av problem innan nätverket ställs inför dem i fält.

Fintuning av beteendet genom evolution

Även en skicklig inlärningsagent är starkt beroende av sina interna inställningar, såsom hur snabbt den lär sig, hur mycket den värderar framtida belöningar och hur ofta den bör utforska nya åtgärder. Istället för att välja dessa vred för hand använder författarna en evolutionär sökmetod kallad differential evolution. De behandlar varje möjlig inställning som en individ i en population och låter dem "tävla" baserat på hur väl den resulterande agenten styr nätverket i simulering. Genom att upprepade gånger mutera, kombinera och välja de bästa kandidaterna konvergerar metoden mot hyperparametrar som gör inlärningen snabbare, mer stabil och bättre lämpad för föränderliga nätverksförhållanden. Detta evolutionära lager omsluter inlärningsagenten och slipar successivt dess prestanda.

Sätta ramverket på prov

Forskarna utvärderar EvoGenRL med en öppet tillgänglig dataset över trådlös sensoraktivitet och detaljerade nätverkssimuleringar. De jämför det med flera etablerade routing‑ och optimeringsscheman hämtade från nyare litteratur. Över upprepade körningar och varierande nätverksstorlekar och felgrader använder det nya ramverket konsekvent mindre energi, håller fler noder vid liv längre och bibehåller mer stabila förbindelser. I siffror reducerar EvoGenRL energiförbrukningen till cirka 2,2 joule per nod, förlänger nätverkets livslängd till 1700 cykler och höjer andelen framgångsrikt levererade datapaket till 99,7 procent. Det minskar också tiden för data att färdas genom nätverket till några millisekunder och ökar den totala datahastigheten, vilket innebär att nätverket kan förbli responsivt samtidigt som det sparar energi.

Vad detta betyder för vardagsteknik

Enkelt uttryckt lär EvoGenRL ett sensornät att ta hand om sig självt. Genom att simulera många typer av fel, lära sig vilka svar som fungerar bäst och kontinuerligt finjustera sitt beteende kan systemet förlänga batteritiden och hålla dataflödet igång trots fel och skiftande förhållanden. Detta gör det attraktivt för uppdragkritiska tillämpningar, såsom medicinsk övervakning, industriell styrning och miljöövervakning, där underhållsbesök är kostsamma eller farliga och driftstopp är oacceptabla. Även om metoden fortfarande kräver betydande beräkningsresurser under träning erbjuder den en lovande mall för framtida självförvaltande nätverk som är smartare, mer robusta och snällare mot sina begränsade energiresurser.

Citering: Lakshmi, S., Aswath, S., Swaminathan, A. et al. Evolutionary reinforcement learning framework for energy-efficient fault resilience and topological stability in WSNs. Sci Rep 16, 11769 (2026). https://doi.org/10.1038/s41598-026-38518-3

Nyckelord: trådlösa sensornätverk, energieffektiva nätverk, felsäkra system, förstärkningsinlärning, generativa modeller