Clear Sky Science · es

Marco de aprendizaje por refuerzo evolutivo para la resiliencia ante fallos eficiente en energía y la estabilidad topológica en RSIs

Por qué importan las redes de sensores inteligentes

Desde la agricultura de precisión hasta los sistemas de alerta ante desastres, las redes de sensores inalámbricos vigilan discretamente nuestro entorno. Pequeños dispositivos alimentados por batería, dispersos por ciudades, fábricas, bosques y hospitales, recogen datos y los envían para su análisis. Pero como estos sensores son económicos, están en lugares remotos y son difíciles de mantener, suelen fallar con frecuencia y agotar su energía rápidamente. Este artículo explora una nueva forma de mantener esas redes funcionando más tiempo, con mayor fiabilidad y con menos intervenciones humanas, usando un marco de aprendizaje inteligente llamado EvoGenRL.

El reto de los sensores cansados y con fallos

Las redes de sensores inalámbricos deben equilibrar varias necesidades a la vez. Cada nodo dispone de energía de batería y capacidad de cómputo muy limitadas. El clima, daños físicos o interferencias pueden provocar fallos en nodos o enlaces, interrumpiendo las rutas de comunicación. A medida que las redes crecen en tamaño y complejidad, las cargas de tráfico y las condiciones circundantes cambian constantemente. Los métodos tradicionales suelen abordar solo un aspecto, como ahorrar energía o mejorar el enrutamiento, y a menudo se diseñan para situaciones fijas y previsibles. Como resultado, cuando los fallos se acumulan o cambian las condiciones, estas redes pueden sufrir pérdida de datos, mayores retrasos y una vida útil reducida.

Un cerebro que aprende para las redes de sensores

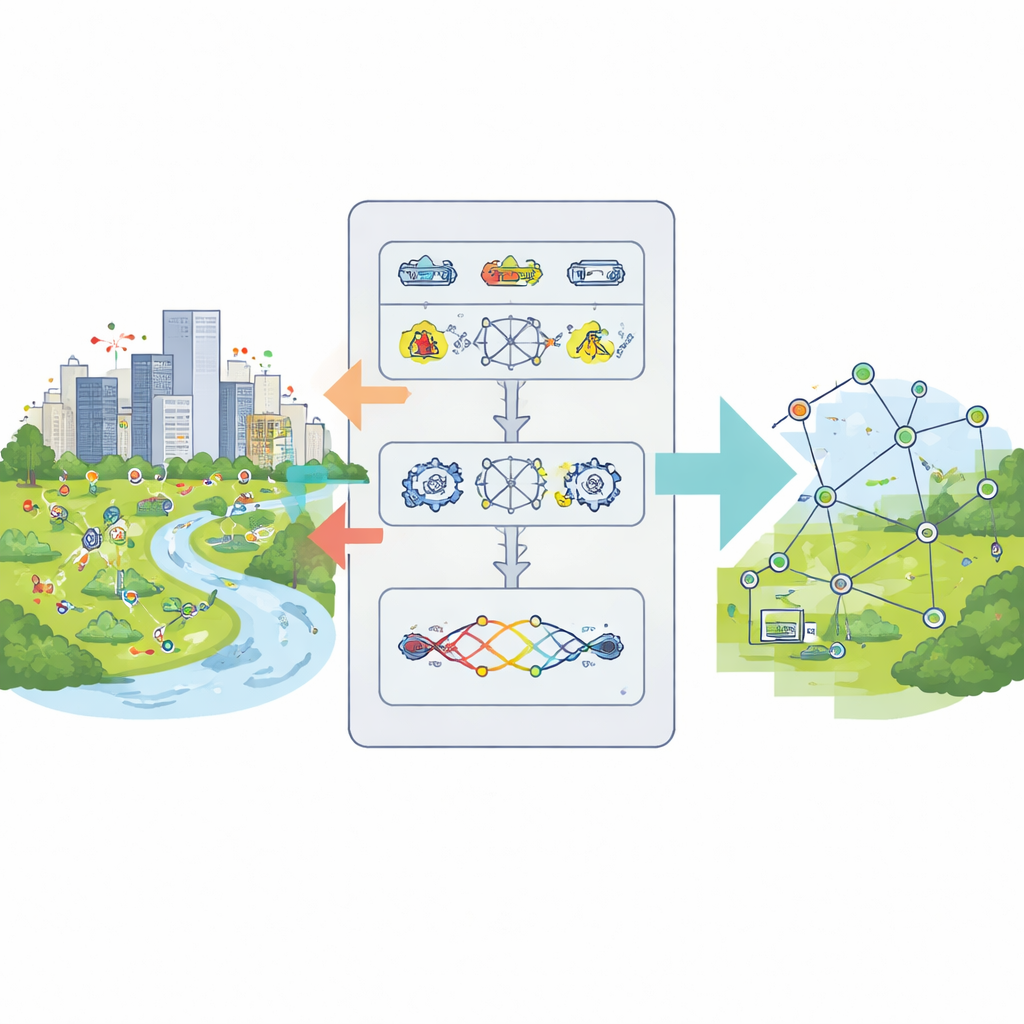

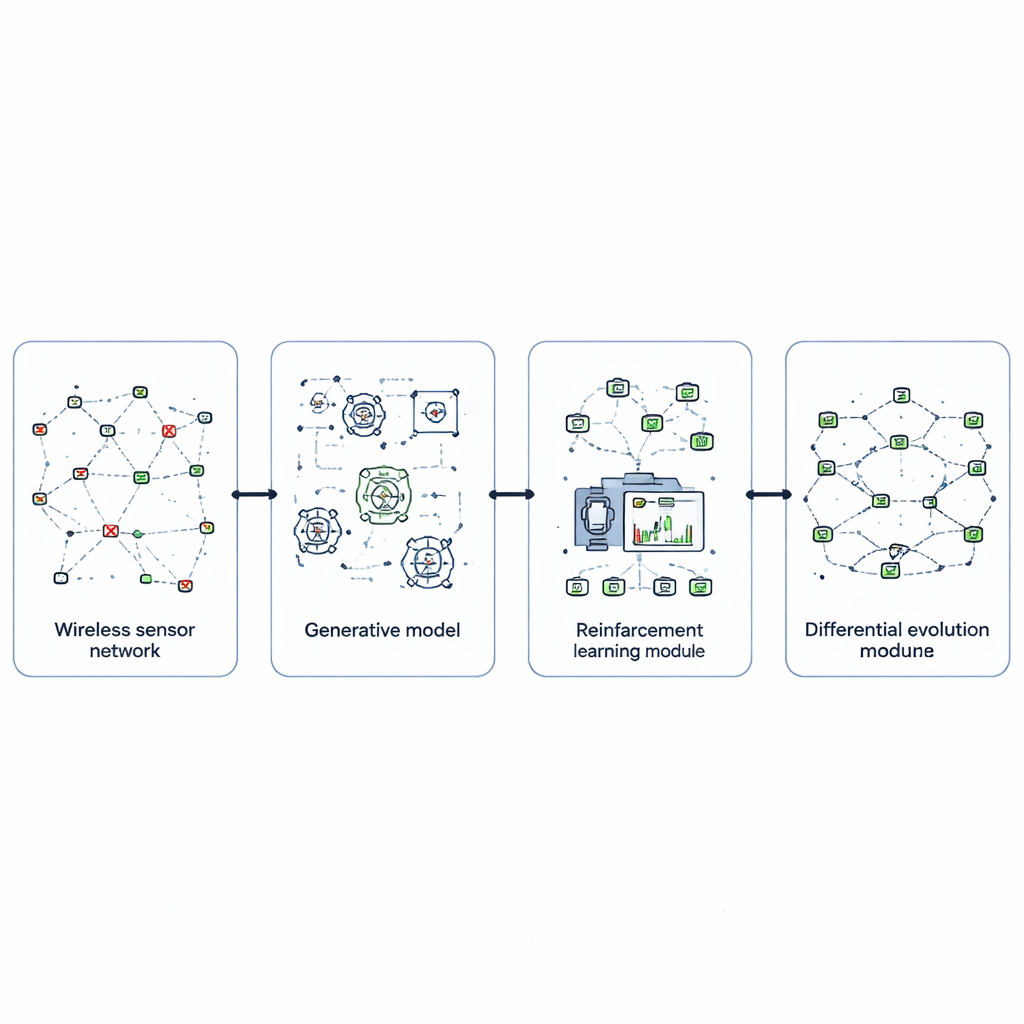

Para afrontar esto, los autores diseñan EvoGenRL, un marco de aprendizaje combinado que trata la red como un sistema capaz de aprender de la experiencia. En su núcleo está el aprendizaje por refuerzo, un método de prueba y error en el que un agente inteligente observa el estado de la red —como niveles de batería, éxito en la entrega y fallos recientes— y elige acciones como cambiar rutas, poner algunos nodos en reposo o retransmitir datos. Las acciones que ahorran energía, entregan más paquetes y se recuperan más rápido de fallos obtienen recompensas más altas, orientando al agente hacia un comportamiento mejor a largo plazo. Esto transforma el control de la red de reglas fijas a una política adaptativa que mejora al enfrentarse a nuevas situaciones.

Imaginar problemas antes de que ocurran

Una dificultad clave de cualquier sistema de aprendizaje es entrenarlo con suficientes situaciones realistas, especialmente fallos raros pero dañinos. EvoGenRL aborda esto usando redes generativas adversarias, una clase de modelos capaces de inventar nuevos datos que imitan ejemplos reales. Aquí, una red generadora fabrica patrones plausibles de fallos en sensores —como conglomerados de nodos que fallan o ráfagas de interferencia— mientras una red discriminadora juzga si esos patrones se parecen a eventos registrados auténticos. A través de su competencia, el generador produce una rica variedad de escenarios de fallo creíbles. Estas situaciones sintéticas se mezclan con datos reales y se alimentan al agente de aprendizaje por refuerzo, para que pueda practicar cómo lidiar con muchos tipos de problemas antes de que la red los enfrente en el campo.

Afinar el comportamiento mediante evolución

Incluso un agente de aprendizaje ingenioso depende en gran medida de sus ajustes internos, como la rapidez con la que aprende, cuánto valora las recompensas futuras y con qué frecuencia debe explorar nuevas acciones. En lugar de escoger estos parámetros a mano, los autores emplean un método de búsqueda evolutiva llamado evolución diferencial. Tratan cada posible ajuste como un individuo en una población y les permiten “competir” según qué tan bien el agente resultante controla la red en simulación. Al mutar, combinar y seleccionar repetidamente los mejores candidatos, el método converge hacia hiperparámetros que hacen el aprendizaje más rápido, más estable y mejor adaptado a condiciones de red cambiantes. Esta capa evolutiva envuelve al agente de aprendizaje, afinando de forma continua su rendimiento.

Poner el marco a prueba

Los investigadores evalúan EvoGenRL utilizando un conjunto de datos públicos de actividad de sensores inalámbricos y simulaciones de red detalladas. Lo comparan con varios esquemas de enrutamiento y optimización consolidados extraídos de la literatura reciente. A lo largo de ejecuciones repetidas y variando tamaños de red y tasas de fallo, el nuevo marco usa sistemáticamente menos energía, mantiene más nodos activos por más tiempo y conserva conexiones más estables. En cifras, EvoGenRL reduce el consumo energético hasta unos 2,2 julios por nodo, alarga la vida de la red hasta 1700 ciclos y eleva la proporción de paquetes de datos entregados con éxito al 99,7 por ciento. También reduce el tiempo que tarda la información en atravesar la red a unos pocos milisegundos y aumenta la tasa de datos general, lo que significa que la red puede mantenerse receptiva incluso mientras ahorra energía.

Qué significa esto para la tecnología cotidiana

En términos sencillos, EvoGenRL enseña a una red de sensores a cuidarse a sí misma. Al simular muchos tipos de fallos, aprender qué respuestas funcionan mejor y afinar continuamente su propio comportamiento, el sistema puede prolongar la vida de las baterías y mantener el flujo de datos pese a fallos y condiciones cambiantes. Esto lo hace atractivo para usos críticos, como monitorización médica, control industrial y vigilancia ambiental, donde las visitas de mantenimiento son costosas o peligrosas y el tiempo de inactividad es inaceptable. Aunque el enfoque aún exige una potencia de cálculo significativa durante el entrenamiento, ofrece un plano prometedor para futuras redes autogestionadas que sean más inteligentes, más robustas y más respetuosas con sus limitados recursos energéticos.

Cita: Lakshmi, S., Aswath, S., Swaminathan, A. et al. Evolutionary reinforcement learning framework for energy-efficient fault resilience and topological stability in WSNs. Sci Rep 16, 11769 (2026). https://doi.org/10.1038/s41598-026-38518-3

Palabras clave: redes de sensores inalámbricos, redes eficientes en energía, sistemas tolerantes a fallos, aprendizaje por refuerzo, modelos generativos