Clear Sky Science · sv

Bildkomprimering med djupinlärning för trådlös kommunikation: effekter på robusthet, genomströmning och latens

Varför smart leverans av bilder över luften är viktig

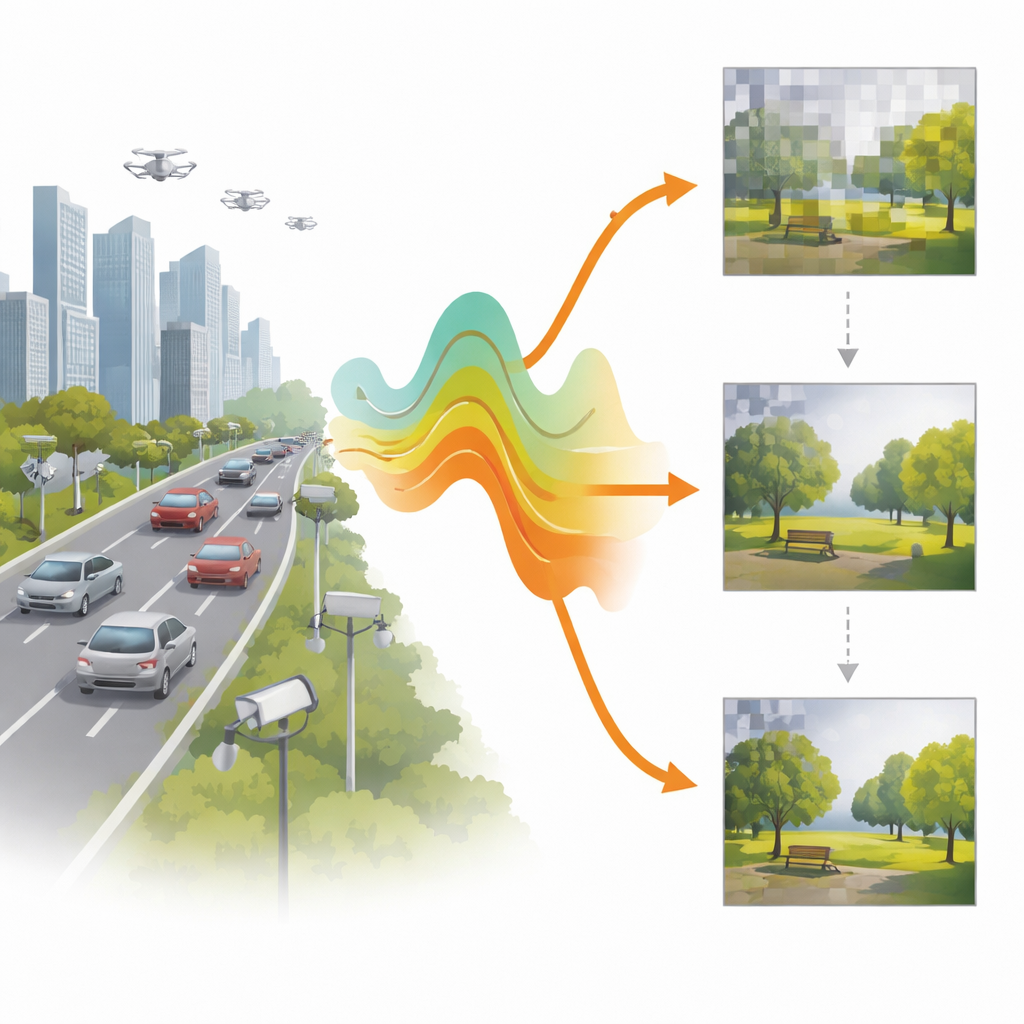

Varje dag fångar telefoner, bilar, drönare och små sensorer bilder som måste skickas trådlöst—ibland från trånga stadsgator, ibland från avlägsna eller hårda miljöer. När radiolänken är svag eller brusig kan dagens bildformat fastna, bli suddiga eller helt misslyckas, vilket är farligt för uppgifter som autonom körning eller fjärrövervakning. Denna artikel undersöker hur modern djupinlärning kan omforma bildkomprimering så att bilder anländer snabbare och mer tillförlitligt, även när den trådlösa kanalen är högst oförutsägbar.

Den trådlösa flaskhalsen för bilder

Traditionella format som JPEG, WebP och videostandarder som HEVC byggdes för stabila, trådbundna eller högkvalitativa länkar. De pressar bilder till färre bitar, men är bräckliga: några felvända bitar i den komprimerade strömmen kan förstöra hela bilden, vilket kräver tung felkorrigering och omöverföringar. I verkliga trådlösa kanaler, särskilt de med stark fadning och låg signal‑till‑brus‑kvot (SNR), översätts den bräckligheten till långa väntetider innan någon användbar bild dyker upp. Många moderna tillämpningar—från IoT‑kameror till självkörande bilar—behöver dock först en snabb, om än grov, vy av scenen och först därefter förbättringar i takt med att länken tillåter.

Progressiva bilder som anpassar sig till luften

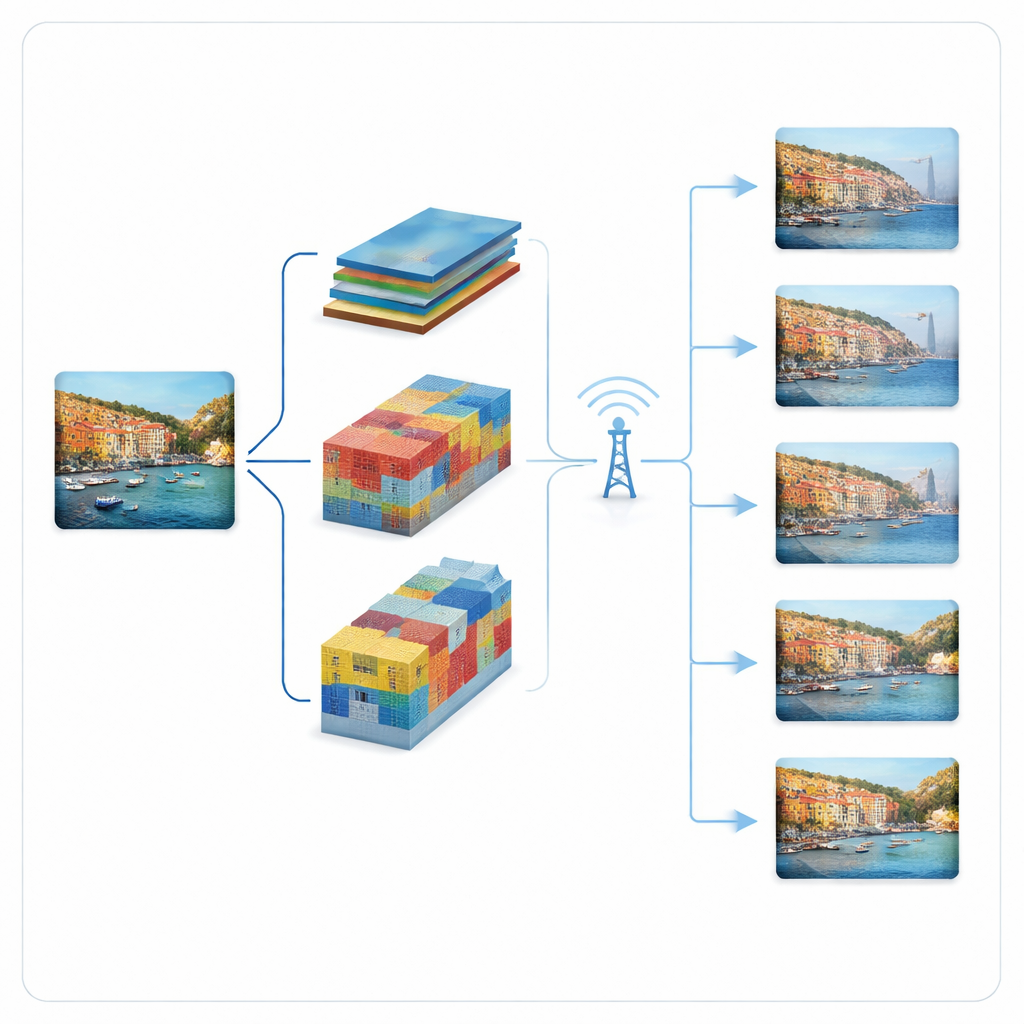

Författarna bygger en adaptiv, progressiv transmissionskedja runt två ledande djupinlärningskompressorer: en "hyperprior"‑modell och en VQGAN‑modell. Istället för att skicka en enda rigid bitström per bild delar dessa system upp den komprimerade representationen i ordnade delar. De viktigaste delarna går först och möjliggör redan en grov återgivning; senare delar tillför detalj när kanalen förbättras eller mer bandbredd blir tillgänglig. Hyperprior‑modellen representerar bilden som kompakta feature‑kartor vars bidrag till kvaliteten är rangordnat efter betydelse. VQGAN‑modellen representerar bilden med hjälp av kodboksinmatningar; den skickar grova kodord först och sedan residualförfiningar i steg. I båda fallen konsulterar sändaren det aktuella kanalstatuset och väljer hur många bitar den säkert kan skicka i den tidsluckan.

Testning i hårda trådlösa förhållanden

För att utvärdera dessa idéer simulerar studien bildöverföring över en Rayleigh‑fadig kanal, en standardmodell där signalstyrkan stiger och faller oförutsägbart. Med Kodak‑uppsättningen av högkvalitativa testbilder jämför författarna sina progressiva hyperprior och progressiva VQGAN med en adaptiv WebP‑baseline som också justerar sin komprimeringsnivå efter kanalen. Avgörande är att de mäter inte bara bildkvalitet utan också genomströmning (hur många pixlar per sekund som levereras) och väntetid—fördröjningen tills en bild tagits emot framgångsrikt. Denna väntetid förbises ofta i djupinlärningsforskning om kommunikation, men den dominerar användarupplevelsen i tillämpningar känsliga för fördröjning.

Hastighet kontra robusthet: vad vinner var

Resultaten visar att i mycket brusiga förhållanden ger den standardmässiga adaptiva WebP i praktiken upp: kanalen kan inte stödja ens dess lägsta kvalitetsinställning, så ingen komplett bild levereras. I kontrast ger båda de progressiva inlärda modellerna fortfarande visningsbara bilder, eftersom de kan falla tillbaka på att endast skicka ett minimalt baslager. Av dessa uppnår den progressiva hyperprior‑modellen lägst latens och högst genomströmning i de flesta låg‑SNR‑scenarier, tack vare sina mycket kompakta, fint ordnade feature‑kartor. Det gör den särskilt attraktiv när snabb respons är avgörande, såsom för interaktiva visionsystem. Den progressiva VQGAN, medan något mindre effektiv, erbjuder högre visuell kvalitet i de mest extrema förhållandena och kan tolerera bitfel utan att förlita sig på separata felkorrigeringskoder, vilket minskar beräkningsbelastning och systemkomplexitet.

Vad detta innebär för framtidens trådlösa bildhantering

Enkelt uttryckt visar artikeln att genom att lära neurala kompressorer att skicka bilder i smarta, små bitar förändras hur bilder färdas över opålitliga trådlösa länkar. En design (hyperprior) är optimerad för att få upp "tillräckligt bra" bilder på skärmen med minimal fördröjning, medan den andra (VQGAN) är inställd på att hålla bilder skarpa även när kanalen är mycket dålig och extra skyddskoder är opraktiska. Tillsammans visar de att progressiv, inlärd komprimering kan hålla kameror och visionsystem igång smidigt där dagens codec misslyckas, och pekar mot framtida nätverk där kvalitet, hastighet och robusthet i bildleverans kan balanseras flexibelt i realtid.

Citering: Naseri, M., Ashtari, P., Seif, M. et al. Deep learning-based image compression for wireless communications: impacts on robustness, throughput, and latency. npj Wirel. Technol. 2, 14 (2026). https://doi.org/10.1038/s44459-025-00019-6

Nyckelord: trådlös bildöverföring, djupinlärningskomprimering, progressiv kodning, kommunikation med låg latens, robusta codec