Clear Sky Science · pl

Komresja obrazów oparta na uczeniu głębokim dla łączności bezprzewodowej: wpływ na odporność, przepustowość i opóźnienia

Dlaczego inteligentna dostawa obrazów „w eterze” ma znaczenie

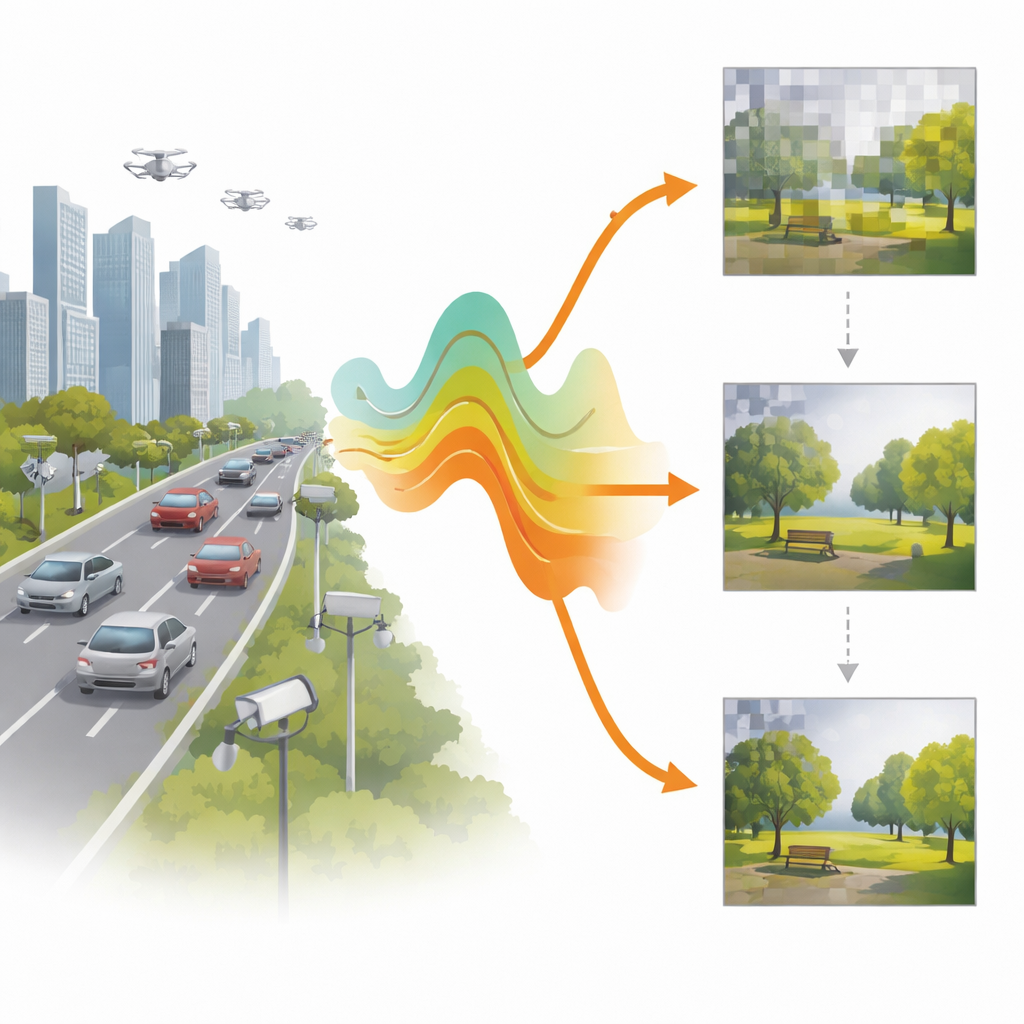

Codziennie telefony, samochody, drony i drobne czujniki rejestrują obrazy, które muszą zostać przesłane bezprzewodowo — czasem z zatłoczonych ulic miast, innym razem z odległych lub surowych środowisk. Gdy łącze radiowe jest słabe lub zaszumione, dzisiejsze formaty obrazów mogą się zaciąć, rozmazać lub całkowicie zawieść, co jest niebezpieczne w zadaniach takich jak autonomiczna jazda czy zdalny monitoring. Niniejszy artykuł bada, jak współczesne techniki uczenia głębokiego mogą przeprojektować kompresję obrazów, tak aby zdjęcia docierały szybciej i bardziej niezawodnie, nawet gdy kanał bezprzewodowy jest silnie nieprzewidywalny.

Bezprzewodowe wąskie gardło dla obrazów

Tradycyjne formaty, takie jak JPEG, WebP czy standardy wideo typu HEVC, zostały zaprojektowane pod kątem stabilnych, przewodowych lub wysokiej jakości łączy. Ściskają obrazy do mniejszej liczby bitów, ale są kruche: kilka odwróconych bitów w strumieniu skompresowanym potrafi zepsuć cały obraz, wymuszając silne korekcje błędów i retransmisje. W rzeczywistych kanałach bezprzewodowych, zwłaszcza z silnym zanikiem i niskim stosunkiem sygnału do szumu (SNR), ta kruchość przekłada się na długie czasy oczekiwania, zanim pojawi się jakikolwiek użyteczny obraz. Tymczasem wiele nowoczesnych zastosowań — od kamer IoT po samochody autonomiczne — potrzebuje najpierw szybkiego, nawet surowego, widoku sceny, a dopiero później dopracowań, gdy łącze na to pozwoli.

Progresywne obrazy dopasowujące się do warunków radiowych

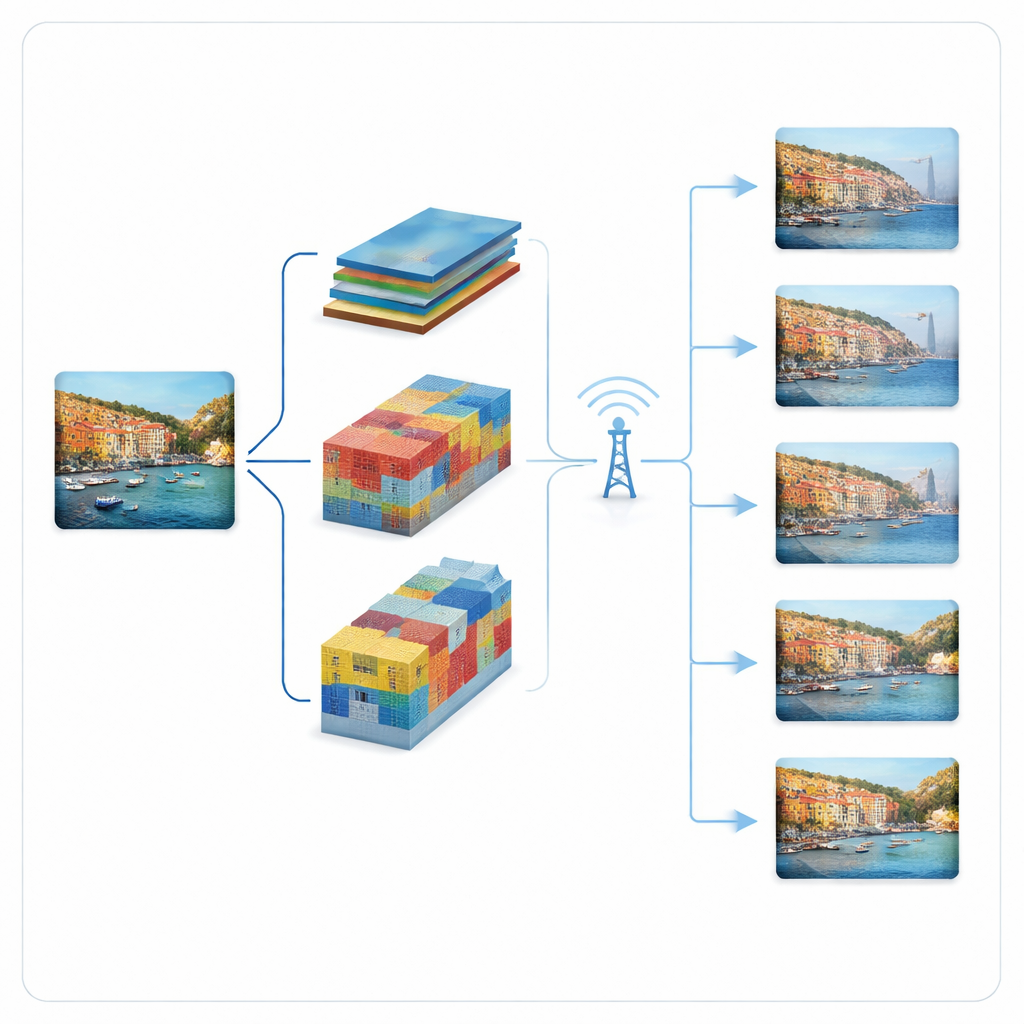

Autorzy konstruują adaptacyjny, progresywny pipeline transmisji wokół dwóch wiodących kompresorów obrazów opartych na uczeniu głębokim: modelu „hyperprior” oraz modelu VQGAN. Zamiast wysyłać jeden sztywny strumień bitów na obraz, systemy te dzielą reprezentację skompresowaną na uporządkowane fragmenty. Najważniejsze części wysyłane są pierwsze i już pozwalają na przybliżone odtworzenie; kolejne fragmenty dodają szczegóły, gdy kanał się poprawia lub dostępne jest więcej pasma. Model hyperprior przedstawia obraz jako zwarte mapy cech, których wkład w jakość jest uszeregowany według ważności. Model VQGAN reprezentuje obraz za pomocą wpisów w słowniku kodów; wysyła najpierw zgrubne słowa kodowe, a następnie w etapach poprawki resztkowe. W obu przypadkach nadajnik konsultuje aktualny stan kanału i wybiera, ile fragmentów może bezpiecznie wysłać w danej szczelinie czasowej.

Testy w trudnych warunkach bezprzewodowych

Aby ocenić te pomysły, badanie symuluje transmisję obrazów przez kanał z zanikiem Rayleigha, standardowy model, w którym siła sygnału rośnie i słabnie w sposób nieprzewidywalny. Używając zestawu testowych wysokiej jakości obrazów Kodak, autorzy porównują swoje progresywne hyperprior i progresywne VQGAN z adaptacyjną bazą WebP, która także dostosowuje poziom kompresji do stanu kanału. Kluczowe jest to, że mierzą nie tylko jakość obrazu, lecz także przepustowość (ile pikseli na sekundę jest dostarczanych) oraz czas oczekiwania — opóźnienie aż do momentu, gdy obraz zostanie pomyślnie odebrany. Ten czas oczekiwania bywa często pomijany w pracach nad komunikacją z użyciem uczenia głębokiego, tymczasem dominuje on odbiór użytkownika w zastosowaniach wrażliwych na opóźnienia.

Szybkość kontra odporność: co wygrywa gdzie

Wyniki pokazują, że w bardzo zaszumionych warunkach standardowy adaptacyjny WebP w praktyce się poddaje: kanał nie jest w stanie obsłużyć nawet jego najniższego ustawienia jakości, więc nie jest dostarczany kompletny obraz. Dla kontrastu oba progresywne modele uczone wciąż dostarczają oglądalne obrazy, ponieważ mogą zawrócić do wysyłania jedynie minimalnej warstwy bazowej. Spośród nich model progresywny hyperprior uzyskuje najniższą latencję i najwyższą przepustowość w większości ustawień o niskim SNR dzięki swoim bardzo zwartym, drobiazgowo uporządkowanym mapom cech. Czyni to go szczególnie atrakcyjnym tam, gdzie szybka reakcja jest kluczowa, na przykład w interaktywnych systemach wzrokowych. Progresywny VQGAN, choć nieco mniej wydajny, oferuje wyższą jakość wizualną w najtrudniejszych warunkach i potrafi tolerować błędy bitowe bez polegania na oddzielnych kodach korekcji błędów, co zmniejsza obciążenie obliczeniowe i złożoność systemu.

Co to oznacza dla przyszłego obrazowania bezprzewodowego

Mówiąc prosto, artykuł pokazuje, że nauczenie sieci neuronowych wysyłania obrazów w inteligentnych, łatwo przyswajalnych kawałkach przekształca sposób, w jaki zdjęcia podróżują po zawodnych łączach bezprzewodowych. Jeden projekt (hyperprior) jest zoptymalizowany pod kątem jak najszybszego uzyskania obrazu „wystarczająco dobrego” na ekranie przy minimalnym opóźnieniu, podczas gdy drugi (VQGAN) jest dostrojony do utrzymania ostrości obrazu nawet przy bardzo złym kanale i gdy dodatkowe kody ochronne są niepraktyczne. Razem demonstrują, że progresywna, uczona kompresja może utrzymać kamery i systemy wizji w działaniu tam, gdzie dzisiejsze kodeki zawodzą, wskazując drogę ku przyszłym sieciom, w których jakość, szybkość i odporność dostarczania obrazów będą mogły być elastycznie balansowane w czasie rzeczywistym.

Cytowanie: Naseri, M., Ashtari, P., Seif, M. et al. Deep learning-based image compression for wireless communications: impacts on robustness, throughput, and latency. npj Wirel. Technol. 2, 14 (2026). https://doi.org/10.1038/s44459-025-00019-6

Słowa kluczowe: bezprzewodowa transmisja obrazów, kompresja oparta na uczeniu głębokim, kodowanie progresywne, komunikacja o niskich opóźnieniach, odporne kodeki