Clear Sky Science · nl

Beeldcompressie op basis van deep learning voor draadloze communicatie: effecten op robuustheid, doorvoer en latentie

Waarom slimme beeldlevering via de lucht belangrijk is

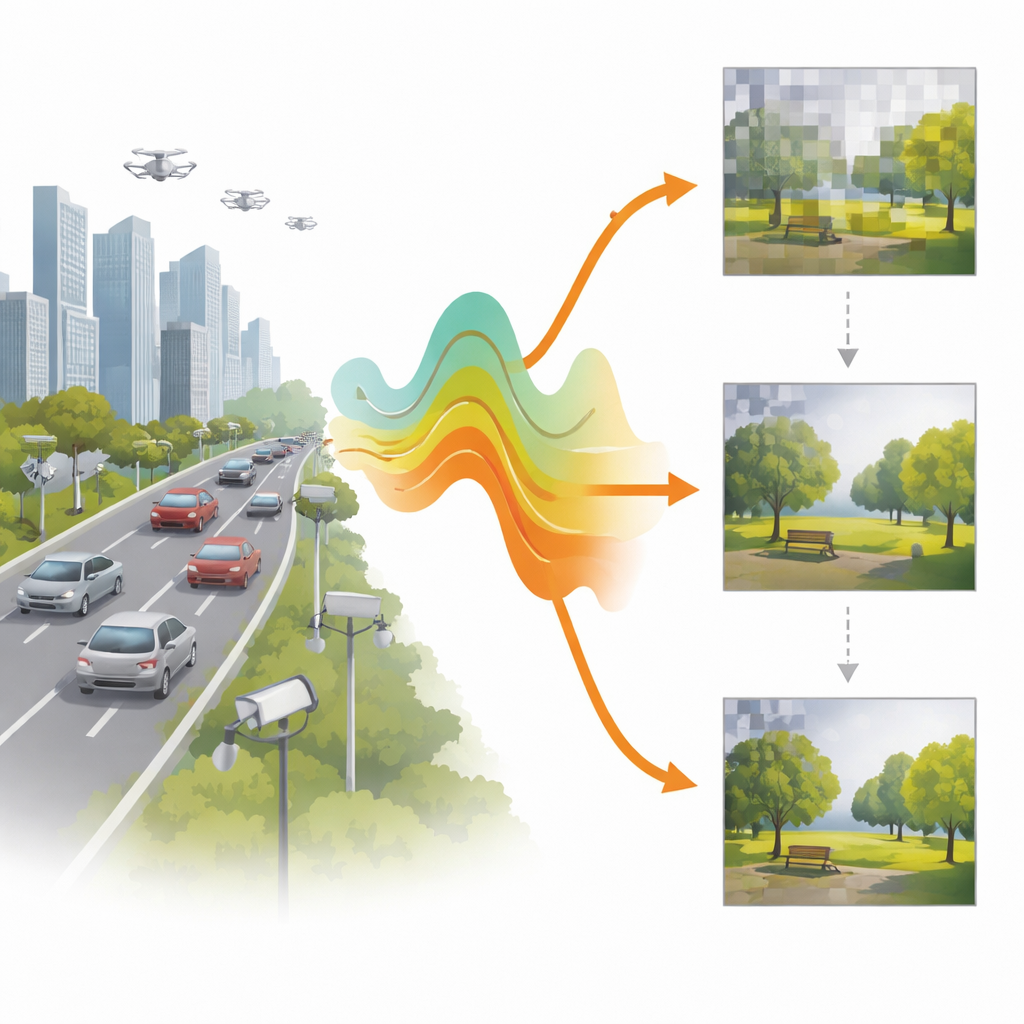

Dagelijks leggen telefoons, auto’s, drones en kleine sensoren beelden vast die draadloos moeten worden verzonden—soms vanaf drukke stadsstraten, soms vanuit afgelegen of ruwe omgevingen. Wanneer de radiolink zwak of ruisgevoelig is, kunnen huidige beeldformaten vastlopen, vervagen of helemaal falen, wat gevaarlijk is voor taken zoals autonoom rijden of afstandsmonitoring. Dit artikel onderzoekt hoe moderne deep learning beeldcompressie kan herontwerpen zodat beelden sneller en betrouwbaarder aankomen, zelfs wanneer het draadloze kanaal zeer onvoorspelbaar is.

De draadloze knelpunten voor afbeeldingen

Traditionele formaten zoals JPEG, WebP en videostandaarden zoals HEVC zijn ontwikkeld voor stabiele, bekabelde of hoogwaardige verbindingen. Ze persen beelden in minder bits, maar zijn kwetsbaar: een paar omgekeerde bits in de gecomprimeerde stroom kunnen het hele beeld vernietigen, wat zware foutcorrectie en hertransmissies noodzakelijk maakt. In echte draadloze kanalen, vooral die met sterke fading en een lage signaal‑ruisverhouding (SNR), vertaalt die kwetsbaarheid zich in lange wachttijden voordat er een bruikbaar beeld verschijnt. Veel moderne toepassingen—van IoT‑camera’s tot zelfrijdende auto’s—hebben echter eerst snel een ruwe blik op de scène nodig, en pas daarna verfijningen als de verbinding het toelaat.

Progressieve beelden die zich aan de lucht aanpassen

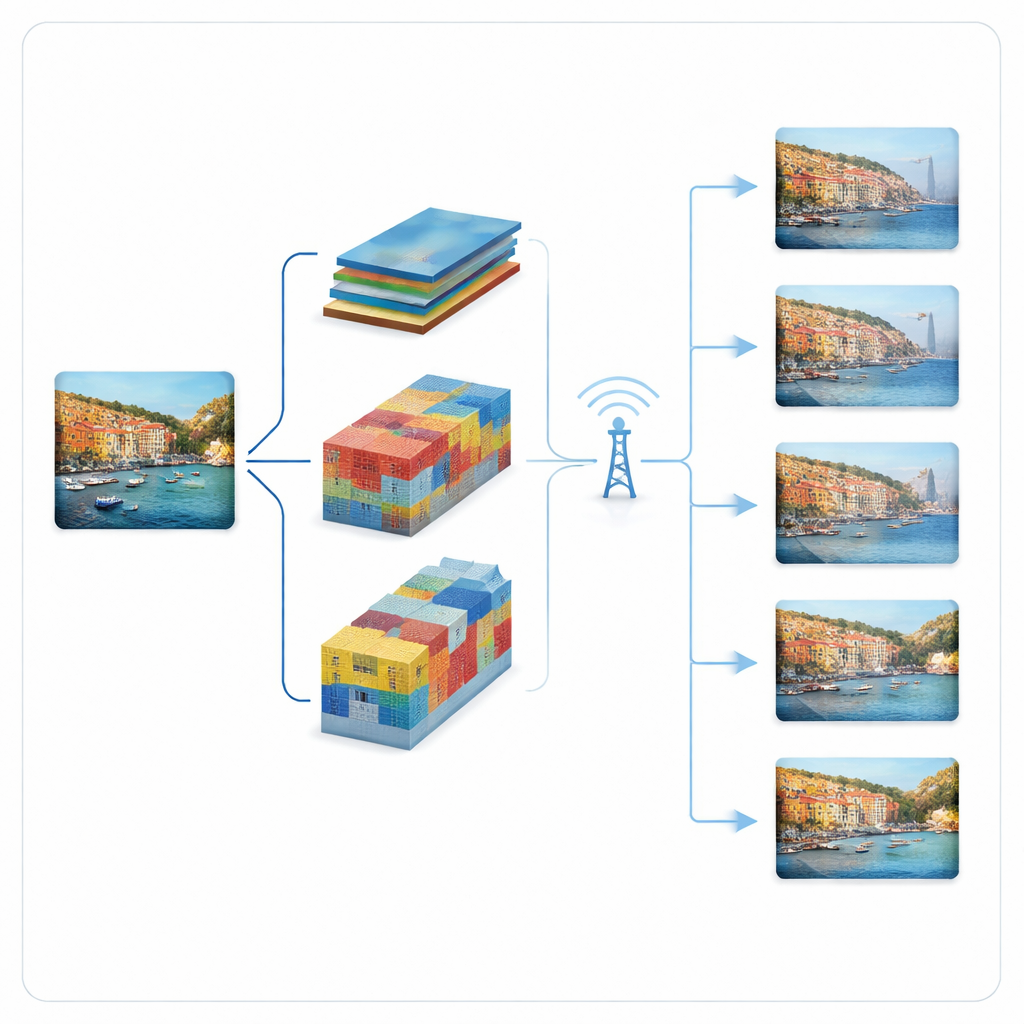

De auteurs bouwen een adaptieve, progressieve transmissiepijplijn rondom twee toonaangevende deep learning‑beeldcompressors: een “hyperprior” model en een VQGAN‑model. In plaats van één rigide bitstream per afbeelding te sturen, breken deze systemen de gecomprimeerde representatie op in geordende stukken. De belangrijkste stukken gaan eerst en maken al een grove reconstructie mogelijk; latere stukken voegen details toe wanneer het kanaal verbetert of meer bandbreedte beschikbaar komt. Het hyperprior‑model vertegenwoordigt de afbeelding als compacte feature‑maps waarvan de bijdrage aan kwaliteit op belangrijkheid is gerangschikt. Het VQGAN‑model beschrijft de afbeelding met codeboek‑elementen; het stuurt eerst grove codewoorden en daarna residuele verfijningen in stappen. In beide gevallen raadpleegt de zender de huidige kanaalstaat en kiest hoeveel stukken veilig binnen die tijdslot kunnen worden verzonden.

Testen onder zware draadloze omstandigheden

Om deze ideeën te evalueren, simuleert de studie beeldtransmissie over een Rayleigh‑fading kanaal, een standaardmodel waarbij het signaalniveau onvoorspelbaar stijgt en daalt. Met de Kodak‑set van hoogwaardige testafbeeldingen vergelijken de auteurs hun progressieve hyperprior en progressieve VQGAN met een adaptieve WebP‑baseline die eveneens zijn compressieniveau aanpast aan het kanaal. Cruciaal is dat ze niet alleen beeldkwaliteit meten, maar ook doorvoer (hoeveel pixels per seconde worden geleverd) en wachttijd—de vertraging totdat een afbeelding succesvol is ontvangen. Deze wachttijd wordt in deep‑learning communicatieonderzoek vaak genegeerd, maar bepaalt de gebruikerservaring in toepassingen die gevoelig zijn voor vertraging.

Snelheid versus robuustheid: wat waar wint

De resultaten laten zien dat in zeer lawaaierige omstandigheden de standaard adaptieve WebP in feite opgeeft: het kanaal kan zelfs de laagste kwaliteitsinstelling niet ondersteunen, waardoor er geen compleet beeld wordt geleverd. Daarentegen leveren beide progressieve geleerde modellen nog steeds waarneembare beelden, omdat ze kunnen terugvallen op het alleen verzenden van een minimale baselaag. Hiervan behaalt het progressieve hyperprior‑model de laagste latentie en de hoogste doorvoer in de meeste lage‑SNR‑scenario’s, dankzij zijn zeer compacte, fijn geordende feature‑maps. Dat maakt het bijzonder aantrekkelijk wanneer een snelle reactie cruciaal is, zoals bij interactieve visiesystemen. De progressieve VQGAN, hoewel iets minder efficiënt, biedt in de zwaarste omstandigheden een hogere visuele kwaliteit en kan bitfouten verdragen zonder te vertrouwen op afzonderlijke foutcorrectiecodes, wat de rekenbelasting en systeemcomplexiteit vermindert.

Wat dit betekent voor toekomstige draadloze beeldvorming

In eenvoudige bewoordingen toont het artikel aan dat het neural compressors leren om beelden in slimme, hapklare stukjes te verzenden, verandert hoe afbeeldingen over onbetrouwbare draadloze verbindingen reizen. Het ene ontwerp (hyperprior) is geoptimaliseerd om met minimale vertraging “goed genoeg” beelden op het scherm te krijgen, terwijl het andere (VQGAN) is afgestemd op het scherp houden van beelden zelfs wanneer het kanaal zeer slecht is en extra beschermingscodes onpraktisch zijn. Samen tonen ze aan dat progressieve, geleerde compressie camera’s en visiesystemen soepel kan laten werken waar de codecs van vandaag struikelen, en wijzen ze op toekomstige netwerken waarin kwaliteit, snelheid en robuustheid van beeldlevering real‑time flexibel kunnen worden afgewogen.

Bronvermelding: Naseri, M., Ashtari, P., Seif, M. et al. Deep learning-based image compression for wireless communications: impacts on robustness, throughput, and latency. npj Wirel. Technol. 2, 14 (2026). https://doi.org/10.1038/s44459-025-00019-6

Trefwoorden: draadloze beeldoverdracht, deep learning-compressie, progressieve codering, communicatie met lage latentie, robuuste codecs