Clear Sky Science · sv

Multimodala modeller för klassificering av hudcancer med klinisk fritext och dermatoskopiska bilder

Varför smartare hudkontroller är viktiga

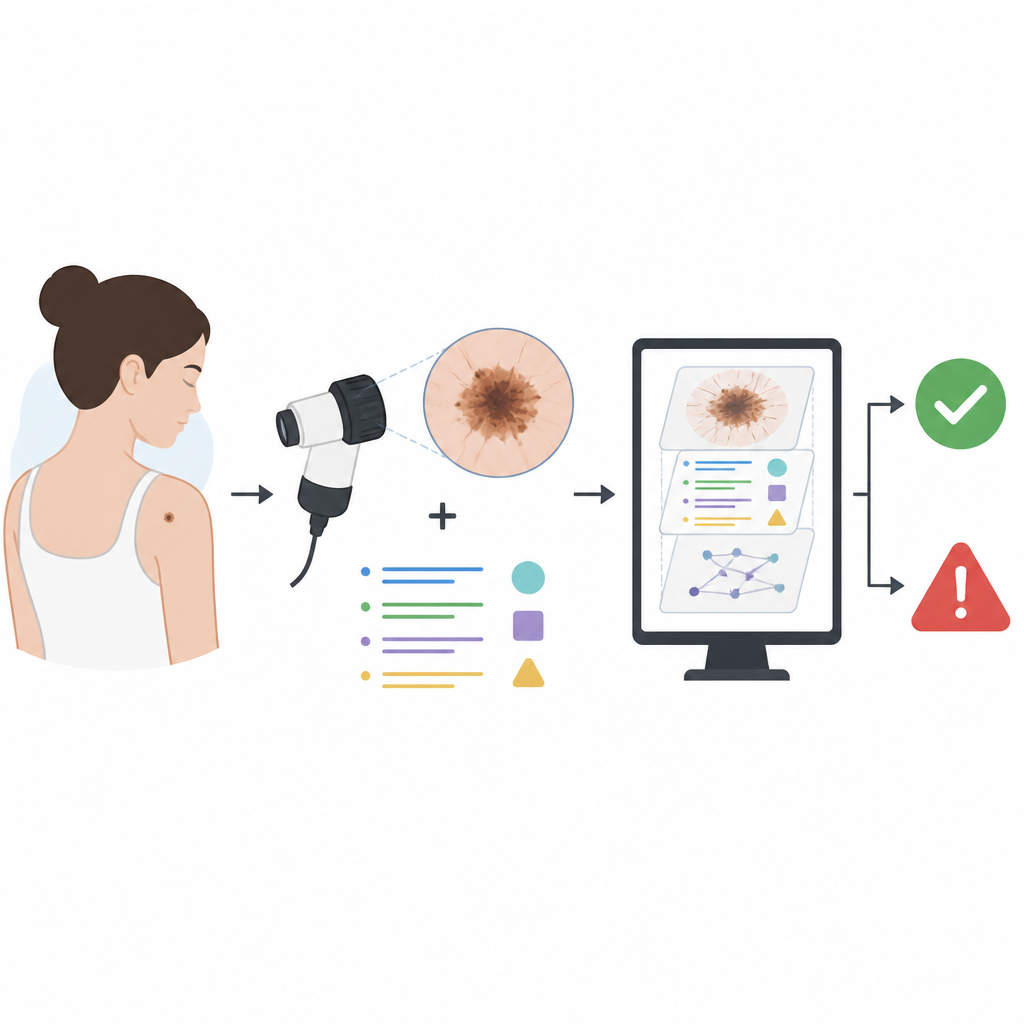

Hudcancer är vanlig, men när den upptäcks tidigt har människor vanligtvis mycket goda prognoser. Läkare använder redan närbilder av födelsemärken för att avgöra vilka som ser oroande ut. Denna studie ställer en enkel fråga med stora konsekvenser: om datorer också kunde läsa läkarens anteckningar om varje födelsemärke, inte bara bilderna, skulle de då kunna upptäcka hudcancer mer exakt och rättvist?

Bilder plus ord berättar en mer fullständig historia

Forskarna byggde en stor datamängd från vanliga dermatologkliniker i Storbritannien. Den innehöll 5481 närbilder från dermatoskopi från 4538 vuxna, tillsammans med grundläggande patientuppgifter såsom ålder och hudtyp, och fyra typer av kliniska anteckningar. Dessa anteckningar täckte hur lesionen såg ut och ändrats över tid, om hudcancer fanns i familjen, hur mycket solexponering personen haft, och vad kirurgen tänkte och planerade att göra. Varje fall märktes som antingen godartat eller elakartat, där elakartade fall bekräftades med biopsi när det var möjligt.

Dolda ledtrådar i kliniska anteckningar

Till skillnad från enkla kryssrutor tillåter fritext att läkare beskriver subtila kännetecken: ett födelsemärke som blivit mörkare, en fläck som blöder, eller en patient som arbetat utomhus i många år. Sådana detaljer kan vara mycket informativa, men de kan också avslöja svaret. Många anteckningar innehåller vad författarna kallar ledande språk: fraser som uttalar eller starkt antyder diagnosen eller behandlingen, såsom ”basalcellscancer, remiss för biopsi” eller ”ingen behandling nödvändig.” Om en maskininlärningsmodell enkelt snöar in på dessa genvägar kan den verka mycket korrekt på historiska data utan att lära sig hur man verkligen känner igen cancer utifrån bilderna eller patientbeskrivningar.

Att lära datorer att ignorera genvägar

För att ta itu med detta problem utformade teamet flera nivåer av textstädning. Enkla regler avlägsnade först de explicita namnen på hudsjukdomar och orden godartad och elakartad. De använde sedan en stor språkmodell för att utföra mer subtil filtrering. I en inställning ersattes nyckelord för diagnos och behandlingsplaner med neutrala taggar så att författarna kunde mäta hur mycket varje typ av uttalande förbättrade prestandan. I den striktaste inställningen behölls endast faktabaserad information som en patient rimligen skulle kunna ange, såsom hur länge ett födelsemärke funnits eller tidigare solvanor. Detta tillvägagångssätt syftade till att föra texten närmare det en patientinriktad tjänst skulle se snarare än att förlita sig på interna ledtrådar från specialister.

Vad modellerna faktiskt lärde sig

När datorn förlitade sig på enbart bilder presterade den väl, men att addera ofiltrerade anteckningar gjorde den avsevärt bättre. Huvudmåttet för noggrannhet, arean under mottagarens operatörskaraktäristik (AUROC), ökade från 0,909 med endast bilder till 0,970 med bilder plus råa anteckningar. Även när allt uppenbart diagnostiskt språk togs bort nådde kombinationen av bilder och noggrant filtrerad text fortfarande en AUROC på cirka 0,948, högre än någon källa för sig. Experiment med taggade fraser visade att enkla meddelanden som ”remiss till sjukhus” förmedlade nästan lika mycket information som en direkt canceretikett, vilket bekräftar att många anteckningar bär på stark inbyggd bias. Författarna undersökte också prestanda över åldersgrupper och hudtonskategorier och fann relativt låga nivåer av orättvisa, både för bildendast-modellen och för den fullt multimodala modellen.

Vad detta betyder för framtida hudkontroller

För icke-experter är huvudpoängen att läkarens anteckningar innehåller verkliga, användbara ledtrådar som kan hjälpa datorer att stödja beslut om hudcancer, men de måste hanteras varsamt. Om modeller tillåts läsa ofiltrerade anteckningar kan de lära sig att efterlikna läkares formuleringar snarare än att känna igen riskfyllda födelsemärken själva. Denna studie visar att genom att genomtänkt rengöra texten och blanda den med bilder och grundläggande patientdata är det möjligt att öka noggrannheten samtidigt som dold bias minskas. Med tiden skulle sådana multimodala verktyg kunna hjälpa primärvårdsläkare att göra bättre remisser och förkorta väntetider till specialistvård, samtidigt som de banar väg för säkra, textmedvetna system som en dag kan assistera patienter direkt.

Citering: Watson, M., Winterbottom, T., Hudson, T. et al. Multimodal models for skin cancer classification using clinical freetext and dermatoscopic images. Commun Med 6, 277 (2026). https://doi.org/10.1038/s43856-026-01456-2

Nyckelord: hudcancer, maskininlärning, dermatologi, kliniska anteckningar, medicinsk bildbehandling