Clear Sky Science · pt

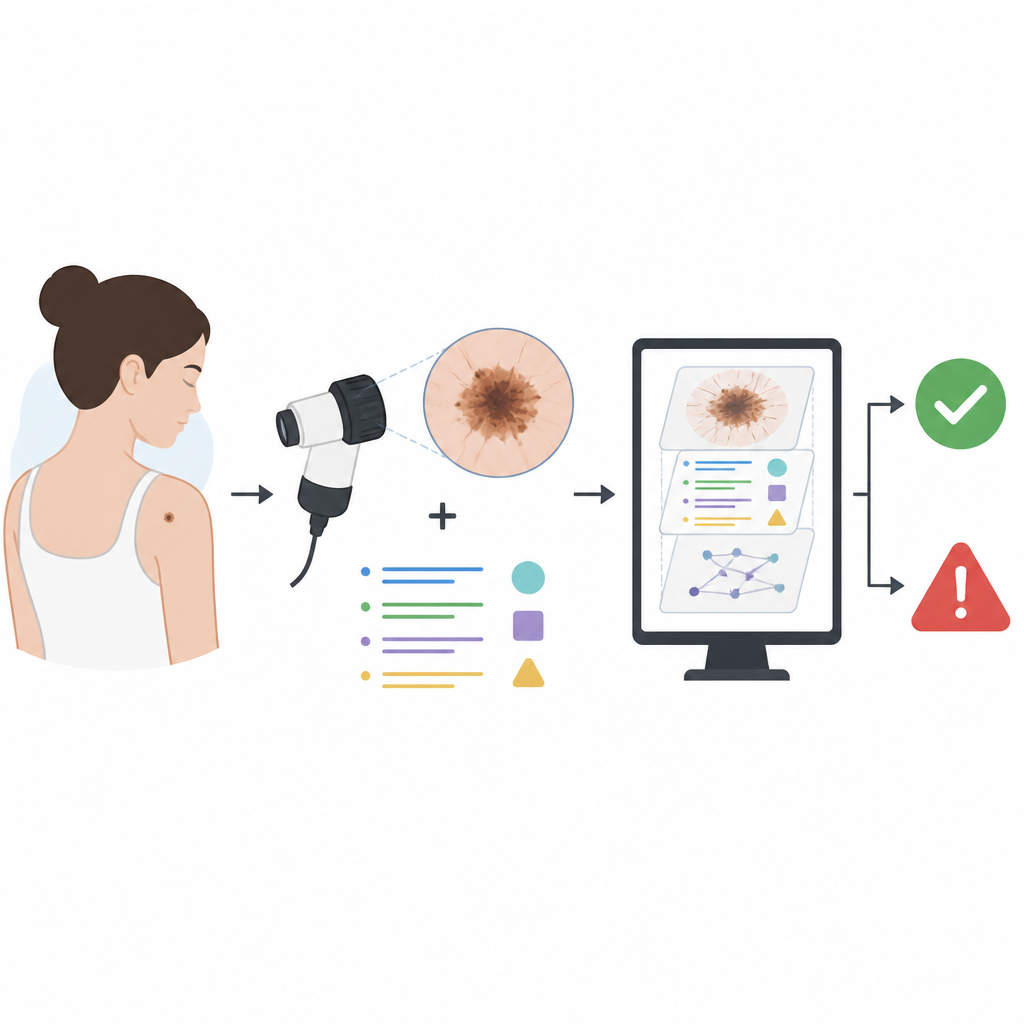

Modelos multimodais para classificação de câncer de pele usando texto clínico livre e imagens dermatoscópicas

Por que exames de pele mais inteligentes importam

O câncer de pele é comum, mas quando é detectado cedo, as perspectivas geralmente são muito boas. Os médicos já usam fotografias em close de pintas para decidir quais parecem preocupantes. Este estudo faz uma pergunta simples com grandes implicações: se os computadores também pudessem ler as anotações do médico sobre cada pinta, não apenas as imagens, eles conseguiriam detectar cânceres de pele com mais precisão e justiça?

Imagens mais palavras contam uma história mais completa

Os pesquisadores construíram um grande conjunto de dados a partir de clínicas de dermatologia de rotina no Reino Unido. Incluiu 5.481 imagens dermatoscópicas em close de 4.538 adultos, junto com dados básicos do paciente, como idade e tipo de pele, e quatro tipos de anotações clínicas. Essas notas cobriam como a lesão parecia e mudou ao longo do tempo, se havia histórico familiar de câncer de pele, a quantidade de exposição solar do paciente e o que o cirurgião pensava e planejava fazer. Cada caso foi rotulado como benigno ou maligno, com casos malignos confirmados por biópsia sempre que possível.

Pistas ocultas dentro das anotações clínicas

Diferente de dados simples de marcação, o texto livre permite que médicos descrevam características sutis: uma pinta que escureceu, uma mancha que sangra ou um paciente que trabalhou ao ar livre por anos. Tais detalhes podem ser altamente informativos, mas também podem entregar a resposta. Muitas notas contêm o que os autores chamam de linguagem indutora: frases que afirmam ou sugerem fortemente o diagnóstico ou o tratamento, como “carcinoma basocelular, referir para biópsia” ou “nenhum tratamento necessário”. Se um modelo de aprendizado de máquina simplesmente se apoiar nesses atalhos, ele pode parecer muito preciso em dados passados enquanto aprende pouco sobre como realmente reconhecer câncer a partir das imagens ou das descrições relatadas pelo paciente.

Ensinar computadores a ignorar atalhos

Para enfrentar esse problema, a equipe projetou vários níveis de limpeza do texto. Regras simples primeiro removeram nomes explícitos de doenças de pele e as palavras benigno e maligno. Em seguida, usaram um grande modelo de linguagem para realizar filtragem mais sutil. Em uma configuração, frases diagnósticas-chave e planos de tratamento foram substituídos por marcadores neutros para que os autores pudessem medir quanto cada tipo de declaração aumentava o desempenho. Na configuração mais rigorosa, apenas informações factuais que um paciente poderia razoavelmente fornecer, como há quanto tempo uma pinta estava presente ou hábitos solares passados, foram mantidas. Essa abordagem visou aproximar o texto do que um sistema voltado ao paciente poderia ver, em vez de depender de pistas internas de especialistas.

O que os modelos realmente aprenderam

Quando o modelo computacional se baseou apenas nas imagens, apresentou bom desempenho, mas adicionar notas não filtradas o tornou significativamente melhor. A principal medida de acurácia, a área sob a curva ROC (AUROC), aumentou de 0,909 com apenas imagens para 0,970 com imagens mais notas brutas. Mesmo quando toda linguagem diagnóstica óbvia foi removida, combinar imagens com texto cuidadosamente filtrado ainda alcançou uma AUROC de cerca de 0,948, superior a qualquer uma das fontes isoladas. Experimentos com frases marcadas mostraram que ações simples como “encaminhar ao hospital” transmitiam quase tanta informação quanto um rótulo explícito de câncer, confirmando que muitas notas carregam forte viés embutido. Os autores também examinaram o desempenho por faixas etárias e categorias de tom de pele e encontraram níveis relativamente baixos de injustiça, tanto para o modelo apenas com imagens quanto para os modelos multimodais completos.

O que isso significa para futuros exames de pele

Para não especialistas, a principal conclusão é que as anotações médicas contêm pistas reais e úteis que podem ajudar computadores a apoiar decisões sobre câncer de pele, mas devem ser tratadas com cuidado. Se os modelos puderem ler notas não filtradas, podem aprender a imitar a redação dos médicos em vez de reconhecer por si mesmos pintas de risco. Este estudo mostra que, ao limpar o texto de forma ponderada e combiná-lo com imagens e dados básicos do paciente, é possível aumentar a precisão ao mesmo tempo reduzir vieses ocultos. Com o tempo, tais ferramentas multimodais poderiam ajudar clínicos de atenção primária a fazer melhores encaminhamentos e reduzir esperas por especialistas, além de preparar o terreno para sistemas seguros, sensíveis ao texto, que um dia possam assistir pacientes diretamente.

Citação: Watson, M., Winterbottom, T., Hudson, T. et al. Multimodal models for skin cancer classification using clinical freetext and dermatoscopic images. Commun Med 6, 277 (2026). https://doi.org/10.1038/s43856-026-01456-2

Palavras-chave: câncer de pele, aprendizado de máquina, dermatologia, anotações clínicas, imagens médicas