Clear Sky Science · de

Multimodale Modelle zur Klassifikation von Hautkrebs mittels klinischem Freitext und dermatoskopischen Bildern

Warum klügere Hautuntersuchungen wichtig sind

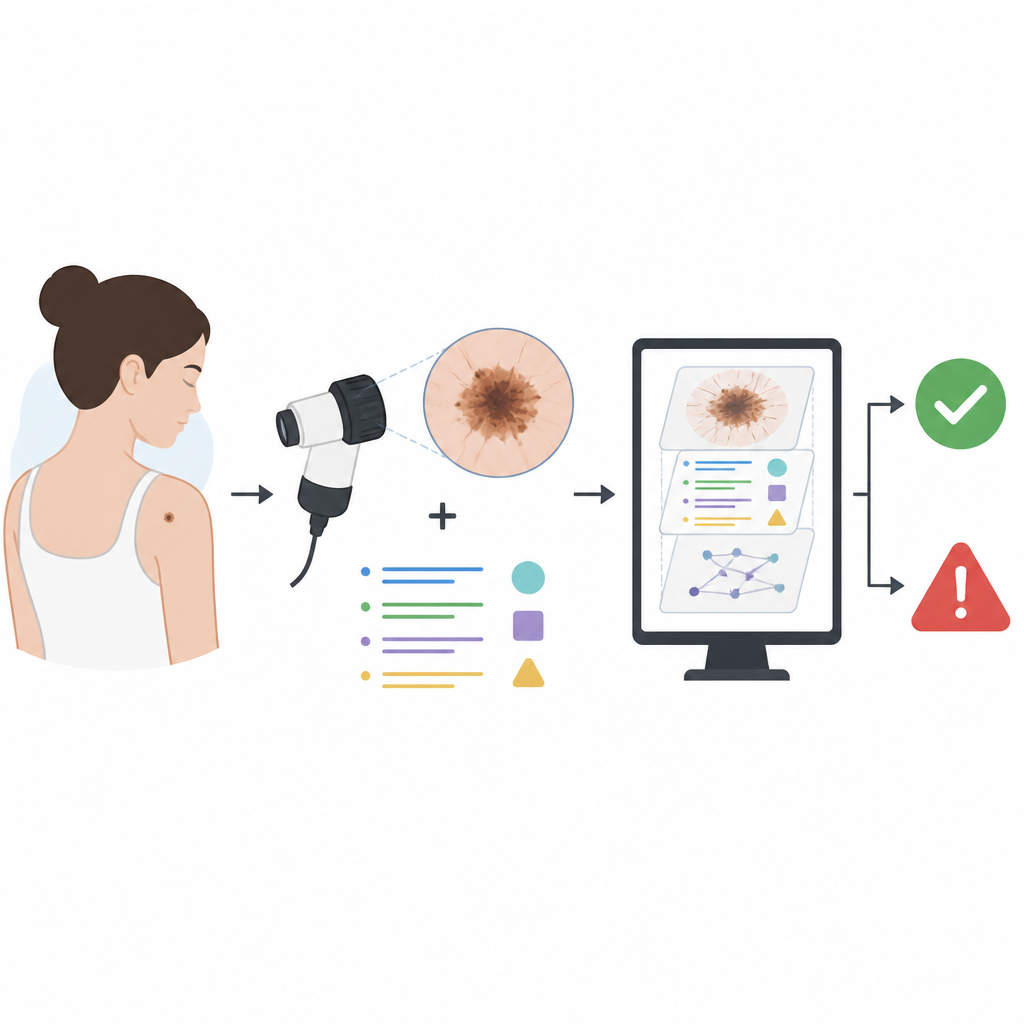

Hautkrebs ist weit verbreitet, aber wenn er früh entdeckt wird, kommen die Betroffenen meist gut davon. Ärzte verwenden bereits Nahaufnahmen von Leberflecken, um zu entscheiden, welche auffällig sind. Diese Studie stellt eine einfache Frage mit großen Folgen: Könnten Computer, die nicht nur die Bilder, sondern auch die ärztlichen Notizen zu jedem Leberfleck lesen, Hautkrebs genauer und gerechter erkennen?

Bilder plus Worte erzählen eine umfassendere Geschichte

Die Forschenden erstellten einen großen Datensatz aus routinemäßigen dermatologischen Kliniken im Vereinigten Königreich. Er umfasste 5481 dermatoskopische Nahaufnahmen von 4538 Erwachsenen sowie grundlegende Patientendaten wie Alter und Hauttyp und vier Arten von klinischen Notizen. Diese Notizen beschrieben, wie der Befund aussah und sich veränderte, ob Hautkrebs in der Familie vorkam, wie viel Sonnenexposition die Person hatte und was der Chirurg dachte und zu tun plante. Jeder Fall wurde als gutartig oder bösartig gelabelt; bösartige Fälle wurden wann immer möglich durch Biopsie bestätigt.

Verborgene Hinweise in klinischen Notizen

Im Gegensatz zu einfachen Checkbox-Daten erlaubt Freitext den Ärzten, subtile Merkmale zu beschreiben: ein Leberfleck, der dunkler geworden ist, eine Stelle, die blutet, oder ein Patient, der jahrelang im Freien gearbeitet hat. Solche Details können sehr informativ sein, sie können aber auch die Antwort verraten. Viele Notizen enthalten, wie die Autorinnen und Autoren schreiben, suggestive Formulierungen: Phrasen, die die Diagnose oder Behandlung direkt aussagen oder stark andeuten, etwa „basalzellkarzinom, Überweisung zur Biopsie“ oder „keine Behandlung erforderlich“. Wenn ein maschinelles Lernmodell sich auf diese Abkürzungen stützt, kann es in historischen Daten sehr genau erscheinen, ohne wirklich gelernt zu haben, Krebs anhand der Bilder oder der patientenberichteten Beschreibungen zu erkennen.

Computern beibringen, Abkürzungen zu ignorieren

Um dieses Problem anzugehen, entwarf das Team mehrere Stufen der Textbereinigung. Zunächst entfernten einfache Regeln explizit die Namen von Hauterkrankungen sowie die Worte „gutartig“ und „bösartig“. Anschließend setzten sie ein großes Sprachmodell ein, um subtilere Filterungen vorzunehmen. In einer Einstellung wurden zentrale diagnostische Formulierungen und Behandlungspläne durch neutrale Tags ersetzt, sodass die Autorinnen und Autoren messen konnten, wie stark jede Art von Aussage die Leistung steigerte. In der strengsten Einstellung blieb nur faktische Information erhalten, die ein Patient vernünftigerweise liefern könnte, etwa wie lange ein Leberfleck vorhanden war oder frühere Sonnengewohnheiten. Dieser Ansatz zielte darauf ab, den Text näher an das zu bringen, was ein patientenorientiertes System sehen würde, statt sich auf interne Hinweise von Spezialisten zu stützen.

Was die Modelle tatsächlich lernten

Wenn das Computermodell nur auf Bildern beruhte, erzielte es gute Ergebnisse; das Hinzufügen unstrukturierter Notizen verbesserte die Leistung jedoch deutlich. Das wichtigste Genauigkeitsmaß, die Fläche unter der Empfänger-Betriebskennlinie (AUROC), stieg von 0,909 bei nur Bildern auf 0,970 bei Bildern plus unbereinigten Notizen. Selbst nachdem alle offensichtlichen diagnostischen Formulierungen entfernt waren, erreichte die Kombination aus Bildern und sorgfältig gefiltertem Text noch eine AUROC von etwa 0,948, mehr als jede einzelne Quelle für sich. Experimente mit getaggten Phrasen zeigten, dass einfache Hinweise wie „Überweisung ins Krankenhaus“ fast ebenso viel Information transportierten wie ein explizites Krebs-Label, was bestätigt, dass viele Notizen starke eingebaute Verzerrungen tragen. Die Autorinnen und Autoren untersuchten außerdem die Leistung über Altersgruppen und Hauttönungskategorien und fanden relativ geringe Ungerechtigkeiten, sowohl für das nur auf Bildern basierende als auch für das vollständig multimodale Modell.

Was das für künftige Hautchecks bedeutet

Für Nicht-Expertinnen und -Experten lautet die zentrale Erkenntnis: Arztnotizen enthalten echte, nützliche Hinweise, die Computern bei Hautkrebsentscheidungen helfen können, sie müssen jedoch sorgfältig behandelt werden. Wenn Modelle unbereinigte Notizen lesen dürfen, lernen sie möglicherweise, die Formulierungen der Ärzte zu imitieren, statt riskante Leberflecken selbst zu erkennen. Diese Studie zeigt, dass durch durchdachte Textbereinigung und die Kombination mit Bildern und grundlegenden Patientendaten die Genauigkeit gesteigert und versteckte Verzerrungen verringert werden können. Mit der Zeit könnten solche multimodalen Werkzeuge Hausärztinnen und -ärzten bei besseren Überweisungen helfen und Wartezeiten für Spezialisten verkürzen, während sie zugleich die Grundlage für sichere, textbewusste Systeme legen, die eines Tages Patienten direkt unterstützen könnten.

Zitation: Watson, M., Winterbottom, T., Hudson, T. et al. Multimodal models for skin cancer classification using clinical freetext and dermatoscopic images. Commun Med 6, 277 (2026). https://doi.org/10.1038/s43856-026-01456-2

Schlüsselwörter: Hautkrebs, maschinelles Lernen, Dermatologie, klinische Notizen, medizinische Bildgebung