Clear Sky Science · sv

CSWin-MDKDNet: korsformigt fönsternätverk med multidimensionell fusion och kunskapsdestillering för medicinsk bildsegmentering

Skarpare vyer inuti kroppen

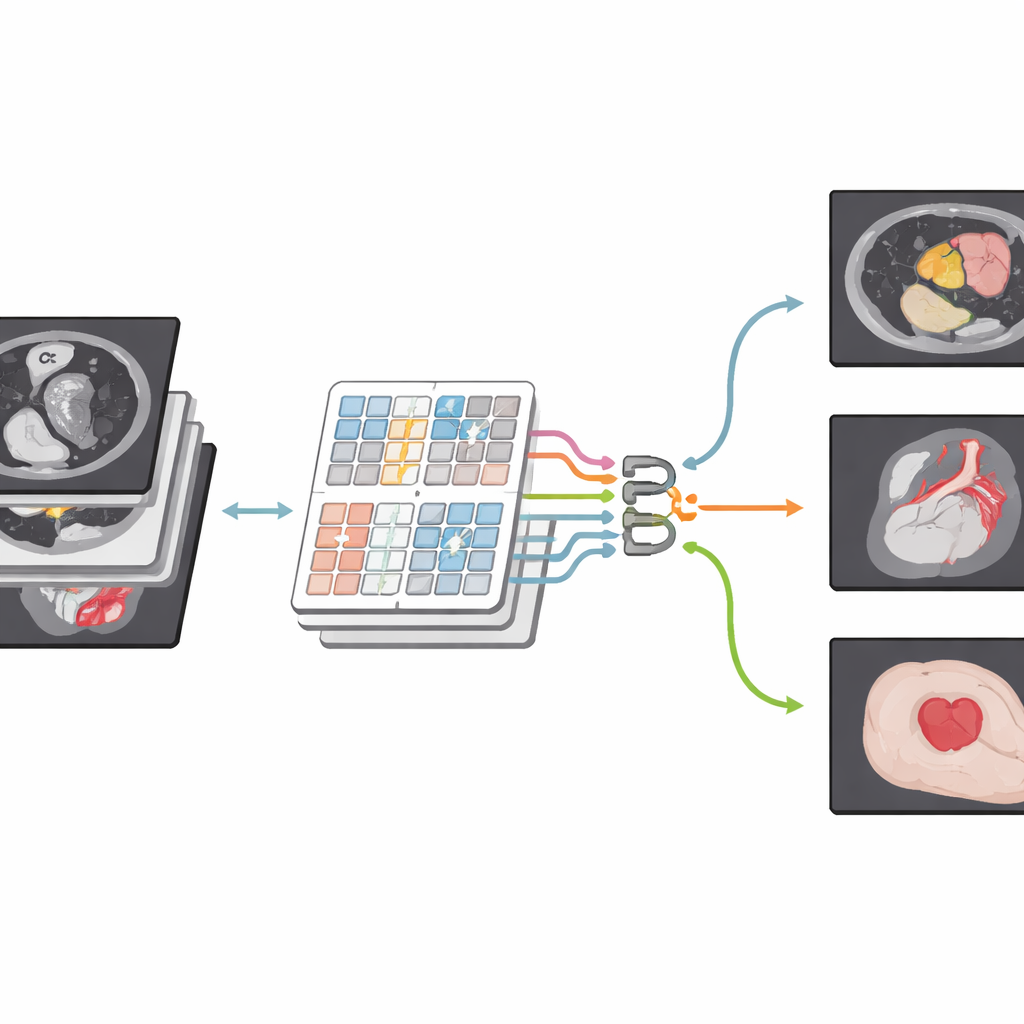

Modern medicin förlitar sig i hög grad på bilder—CT-skanningar, MR-undersökningar och hudfoton—för att upptäcka organ, tumörer och andra strukturer. Men innan läkare eller datorer kan mäta eller följa en sjukdom behöver de ofta "färglägga" varje organ eller lesion exakt, en uppgift som kallas segmentering. Denna artikel presenterar ett nytt artificiellt intelligenssystem, CSWin-MDKDNet, som gör detta avgränsningssteg mer precist och effektivt över flera typer av medicinska bilder, vilket potentiellt förbättrar diagnostik, planering av behandlingar och uppföljning för många patienter.

Varför gränserna är viktiga

När radiologer planerar operationer, mäter hjärtats pumpkraft eller uppskattar storleken på en hudlesion är de beroende av tydliga gränser i sina bilder. Traditionellt ritar mänskliga experter dessa konturer för hand, vilket är långsamt, tröttande och kan variera mellan olika personer. Tidigare datormetoder baserade på konvolutionsneuronätverk lärde sig att känna igen lokala mönster som kanter och texturer och förändrade analysen av medicinska bilder. Men dessa system hade fortfarande svårt att se helheten—hur avlägsna delar av en bild förhåller sig till varandra—samtidigt som de behöll fina detaljer längs organskanter. Denna avvägning mellan global kontext och lokal precision har begränsat tillförlitligheten hos automatiserade verktyg i krävande kliniska miljöer.

Ett nytt sätt att betrakta medicinska bilder

Författarna bygger vidare på en nyare familj av modeller kända som Transformers, ursprungligen utvecklade för språk men nu allmänt använda inom datorseende. Deras nätverk, CSWin-MDKDNet, börjar med att dela upp en medicinsk bild i patchar och föra dem genom en Transformer-modul som betraktar bilden i korsformade ränder, horisontellt och vertikalt. Denna utformning låter systemet koppla samman avlägsna regioner—som toppen och botten av levern—utan att beräkningskostnaden exploderar. Runt denna kärna använder modellen en U-formad encoder–decoder-arkitektur som blivit standard inom medicinsk bildbehandling: en bana krymper gradvis bilden för att fånga högre nivåstrukturer, medan en annan bana expanderar den tillbaka till full storlek och producerar en detaljerad segmenteringskarta som överensstämmer med den ursprungliga skanningen.

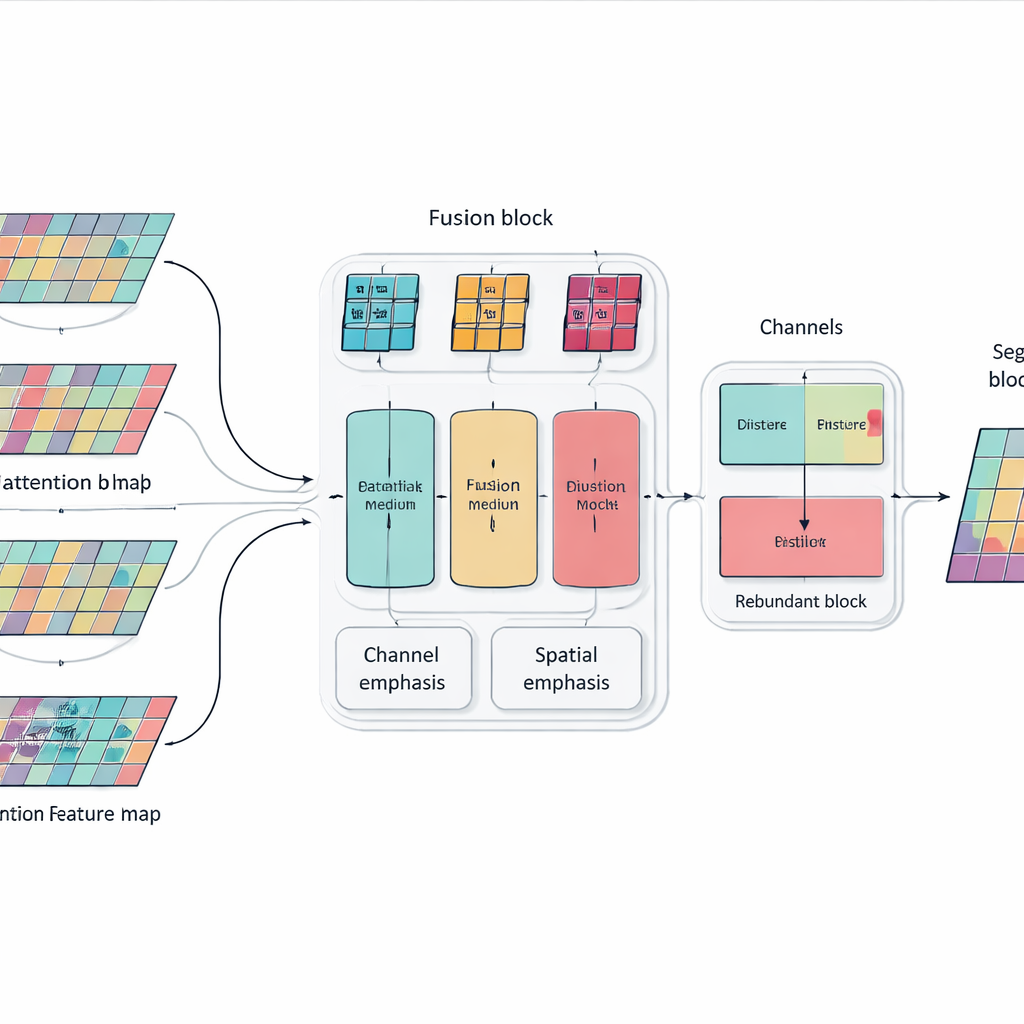

Att blanda detaljer från många riktningar

Att bara stapla fler lager och attention-block kan göra en modell kraftfull men också uppsvälld och spretig. För att åtgärda detta introducerar författarna en Multi-dimensional Selective Fusion-modul som fungerar som en smart mixer för bildfunktioner. Den betraktar information över tre aspekter på en gång: de olika "kanalerna" som kodar olika visuella signaler, det spatiala läget som fångar var kanter och texturer uppträder, och flera skalor som sträcker sig från fina detaljer till bred kontext. Genom att använda riktad viktning istället för att behandla alla funktioner lika stärker denna modul information som verkligen hjälper till att skilja ett organ från ett annat—till exempel den subtila, oregelbundna konturen hos bukspottkörteln—samt dämpar distraktioner från brus och bakgrundsvävnad.

Att lära nätverket att inte upprepa sig självt

Ett annat problem med mycket djupa nätverk är redundans: senare lager kan komma att upprepa mönster som redan lärts tidigare, vilket slösar kapacitet och ibland förvirrar beslutsprocessen. Istället för att lägga till ytterligare pruningsmoduler introducerar forskarna en enkel träningsregel inspirerad av kunskapsdestillering. Inom varje block av nätverket uppmuntrar de djupare kanaler att ta upp den mest användbara informationen från grundare kanaler samtidigt som onödig duplicering undviks. Denna interna "lärare–elev"-relation knuffar modellen mot kompakta, konsekventa representationer, vilket hjälper den att generalisera bättre till nya patienter och olika skannrar utan att öka kostnaden för att köra systemet.

Bevisade vinster över organ och modaliteter

För att testa sitt angreppssätt utvärderade teamet CSWin-MDKDNet på tre krävande benchmarks. På mångorganiga buk-CT-skanningar uppnådde systemet den högsta genomsnittliga överlappningen mellan sina prediktioner och experternas etiketter, med särskilda förbättringar för svåravgränsade organ som bukspottkörteln. På hjärt-MR gav det mer precisa konturer av hjärtats kammare och muskel, vilket är avgörande för att mäta hjärtfunktionen. På en stor samling hudlesionsfoton producerade det renare gränser än flera starka konkurrerande modeller. Anmärkningsvärt är att dessa förbättringar kom med färre parametrar och lägre beräkningskostnad än klassiska Transformer-baserade konstruktioner, vilket innebär att metoden är bättre lämpad för praktisk användning i kliniker och sjukhus.

Tydligare konturer för bättre vård

I vardagliga termer visar detta arbete hur smartare mjukvara kan rita organens och lesionernas former i medicinska bilder mer exakt, samtidigt som datorresurser används mer effektivt. Genom att kombinera en bred överblick av bilden med noggrant avvägd uppmärksamhet på viktiga detaljer, och genom att motverka slösaktig upprepning inuti nätverket, levererar CSWin-MDKDNet mer tillförlitliga digitala konturer som läkare kan lita på. Sådana förbättringar kanske inte syns direkt för patienter, men de kan stödja mer precis operationsplanering, mer konsekvent uppföljning av sjukdom över tid och i slutändan mer självsäkra beslut vid sängkanten.

Citering: Cui, G., Lin, H., Sun, L. et al. CSWin-MDKDNet: cross-shaped window network with multi-dimensional fusion and knowledge distillation for medical image segmentation. Sci Rep 16, 11532 (2026). https://doi.org/10.1038/s41598-026-40690-5

Nyckelord: medicinsk bildsegmentering, deep learning, transformatornätverk, organ- och lesionsanalys, datorstödd diagnostik