Clear Sky Science · fr

CSWin-MDKDNet : réseau à fenêtres en croix avec fusion multidimensionnelle et distillation de connaissances pour la segmentation d'images médicales

Des vues plus nettes à l’intérieur du corps

La médecine moderne repose largement sur les images — scanners, IRM et photographies de la peau — pour repérer organes, tumeurs et autres structures. Mais avant que les médecins ou les algorithmes ne puissent mesurer ou suivre une maladie, il faut souvent « colorier » chaque organe ou lésion avec précision, une tâche appelée segmentation. Cet article présente un nouveau système d’intelligence artificielle, CSWin-MDKDNet, qui rend cette étape de délimitation plus précise et plus efficace sur plusieurs types d’images médicales, améliorant potentiellement le diagnostic, la planification thérapeutique et le suivi pour de nombreux patients.

Pourquoi tracer des frontières est important

Lorsque les radiologues planifient une opération, évaluent la capacité de pompage du cœur ou estiment la taille d’une lésion cutanée, ils dépendent de limites nettes dans leurs images. Traditionnellement, des experts dessinent ces contours à la main, ce qui est lent, fatigant et variable d’une personne à l’autre. Les méthodes informatiques antérieures basées sur les réseaux de neurones convolutionnels ont appris à reconnaître des motifs locaux comme les bords et textures et ont transformé l’analyse d’images médicales. Pourtant, ces systèmes peinaient encore à saisir la « vue d’ensemble » — comment des régions éloignées de l’image se relient entre elles — tout en conservant les détails fins le long des bords des organes. Ce compromis entre contexte global et précision locale a limité la fiabilité des outils automatisés dans des environnements cliniques exigeants.

Une nouvelle façon de regarder les images médicales

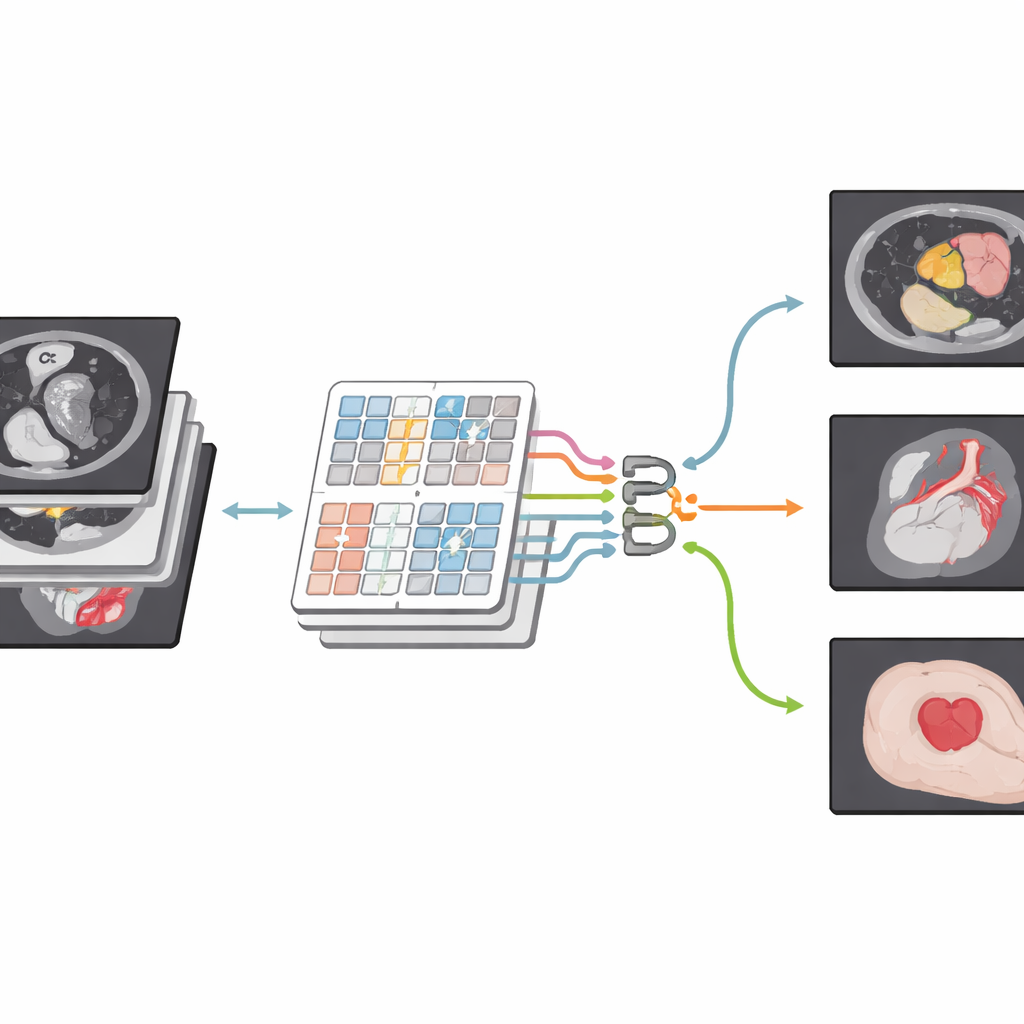

Les auteurs s’appuient sur une famille de modèles plus récente, les Transformers, initialement développés pour le langage mais désormais largement utilisés en vision par ordinateur. Leur réseau, CSWin-MDKDNet, commence par découper l’image médicale en patchs puis les passe dans un module Transformer qui observe l’image en bandes en forme de croix, horizontalement et verticalement. Cette conception permet au système de relier des régions éloignées — par exemple le haut et le bas du foie — sans explosion des coûts de calcul. Autour de ce noyau, le modèle adopte une architecture encodeur–décodeur en U devenue standard en imagerie médicale : un chemin réduit progressivement l’image pour capter la structure de haut niveau, tandis qu’un autre la rétablit à taille pleine pour produire une carte de segmentation détaillée alignée sur le scan d’origine.

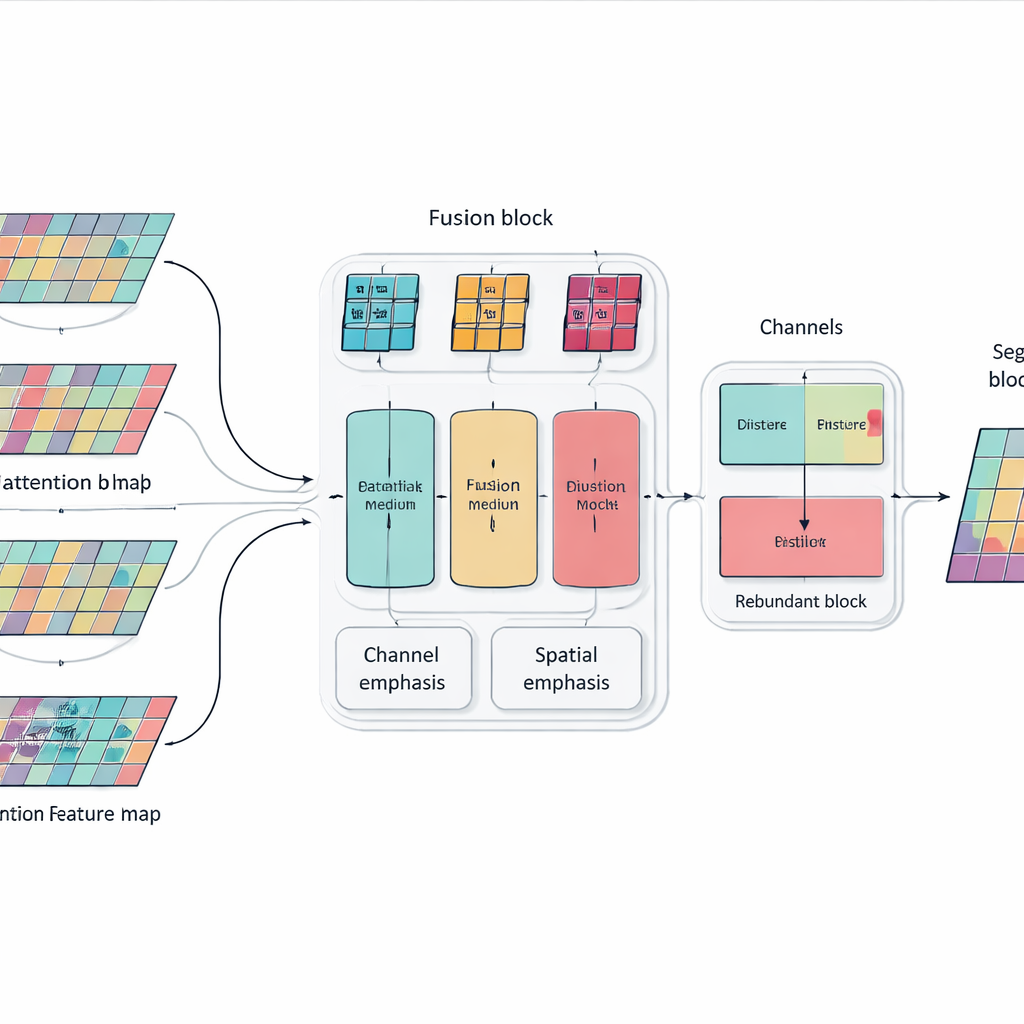

Mêler les détails dans de multiples directions

Empiler davantage de couches et de blocs d’attention peut rendre un modèle puissant mais aussi encombrant et dispersé. Pour remédier à cela, les auteurs introduisent un module de Fusion Sélective Multidimensionnelle qui agit comme un mélangeur intelligent de caractéristiques d’image. Il considère l’information selon trois aspects simultanément : les différentes « canaux » qui codent divers indices visuels, la disposition spatiale qui capture où se situent bords et textures, et plusieurs échelles allant des détails fins au contexte large. En utilisant un pondération ciblée plutôt que de traiter toutes les caractéristiques de façon égale, ce module renforce les informations réellement utiles pour distinguer un organe d’un autre — comme le contour subtil et irrégulier du pancréas — tout en atténuant les distractions dues au bruit et aux tissus de fond.

Apprendre au réseau à ne pas se répéter

Un autre problème des réseaux très profonds est la redondance : les couches ultérieures peuvent finir par répéter des motifs déjà appris en amont, gaspillant de la capacité et parfois brouillant le processus de décision. Plutôt que d’ajouter des modules d’élagage supplémentaires, les chercheurs proposent une règle d’entraînement simple inspirée de la distillation de connaissances. Dans chaque bloc du réseau, ils encouragent les canaux plus profonds à absorber l’information la plus utile des couches superficielles tout en évitant les duplications inutiles. Cette relation interne « professeur–élève » oriente le modèle vers des représentations compactes et cohérentes, ce qui l’aide à mieux généraliser à de nouveaux patients et à différents scanners sans augmenter le coût d’exécution du système.

Gains démontrés sur plusieurs organes et modalités

Pour évaluer leur approche, l’équipe a testé CSWin-MDKDNet sur trois bancs d’essai exigeants. Sur des scanners abdominaux CT multi-organes, le système a obtenu le recouvrement moyen le plus élevé entre ses prédictions et les annotations d’experts, améliorant en particulier les performances sur des organes difficiles à délimiter comme le pancréas. Sur l’IRM cardiaque, il a fourni des contours plus précis des cavités et du muscle cardiaque, essentiels pour mesurer la fonction cardiaque. Sur une grande collection de photos de lésions cutanées, il a produit des limites plus nettes que plusieurs modèles concurrents performants. Fait notable, ces améliorations s’accompagnent de moins de paramètres et d’une moindre charge de calcul par rapport aux architectures Transformer classiques, ce qui rend la méthode mieux adaptée à un déploiement pratique en clinique et à l’hôpital.

Des contours plus clairs pour de meilleurs soins

Concrètement, ce travail montre comment un logiciel plus intelligent peut tracer les formes des organes et des lésions dans les images médicales de façon plus précise, tout en utilisant les ressources informatiques plus efficacement. En combinant une vue large de l’image avec une attention finement réglée sur les détails importants, et en décourageant les répétitions inutiles à l’intérieur du réseau, CSWin-MDKDNet produit des contours numériques plus fiables sur lesquels les médecins peuvent se reposer. Ces améliorations ne sont pas forcément visibles directement pour les patients, mais elles peuvent soutenir une planification chirurgicale plus précise, un suivi de la maladie plus constant dans le temps et, en fin de compte, des décisions cliniques plus sûres au chevet.

Citation: Cui, G., Lin, H., Sun, L. et al. CSWin-MDKDNet: cross-shaped window network with multi-dimensional fusion and knowledge distillation for medical image segmentation. Sci Rep 16, 11532 (2026). https://doi.org/10.1038/s41598-026-40690-5

Mots-clés: segmentation d'images médicales, apprentissage profond, réseaux Transformer, analyse d'organes et de lésions, diagnostic assisté par ordinateur