Clear Sky Science · pt

CSWin-MDKDNet: rede com janela em forma de cruz com fusão multidimensional e destilação de conhecimento para segmentação de imagens médicas

Visões Mais Nítidas do Interior do Corpo

A medicina moderna depende fortemente de imagens — tomografias, ressonâncias magnéticas e fotos de pele — para identificar órgãos, tumores e outras estruturas. Mas antes que médicos ou computadores possam medir ou acompanhar uma doença, frequentemente é necessário “colorir” cada órgão ou lesão com precisão, uma tarefa chamada segmentação. Este artigo apresenta um novo sistema de inteligência artificial, o CSWin-MDKDNet, que torna essa etapa de contorno mais precisa e eficiente em vários tipos de imagens médicas, potencialmente melhorando diagnóstico, planejamento de tratamento e acompanhamento de muitos pacientes.

Por que Desenhar Limites Importa

Quando radiologistas planejam uma cirurgia, medem a força de bombeamento do coração ou estimam o tamanho de uma lesão cutânea, dependem de limites claros nas imagens. Tradicionalmente, especialistas humanos desenham esses contornos manualmente, o que é lento, cansativo e sujeito a variação entre avaliadores. Métodos computacionais anteriores baseados em redes neurais convolucionais aprenderam a reconhecer padrões locais como bordas e texturas, transformando a análise de imagens médicas. Ainda assim, esses sistemas tinham dificuldade em capturar a “visão de conjunto” — como partes distantes da imagem se relacionam — ao mesmo tempo em que mantinham detalhes finos ao longo das bordas dos órgãos. Esse trade-off entre contexto global e precisão local limitou a confiabilidade das ferramentas automatizadas em cenários clínicos exigentes.

Uma Nova Forma de Olhar para Imagens Médicas

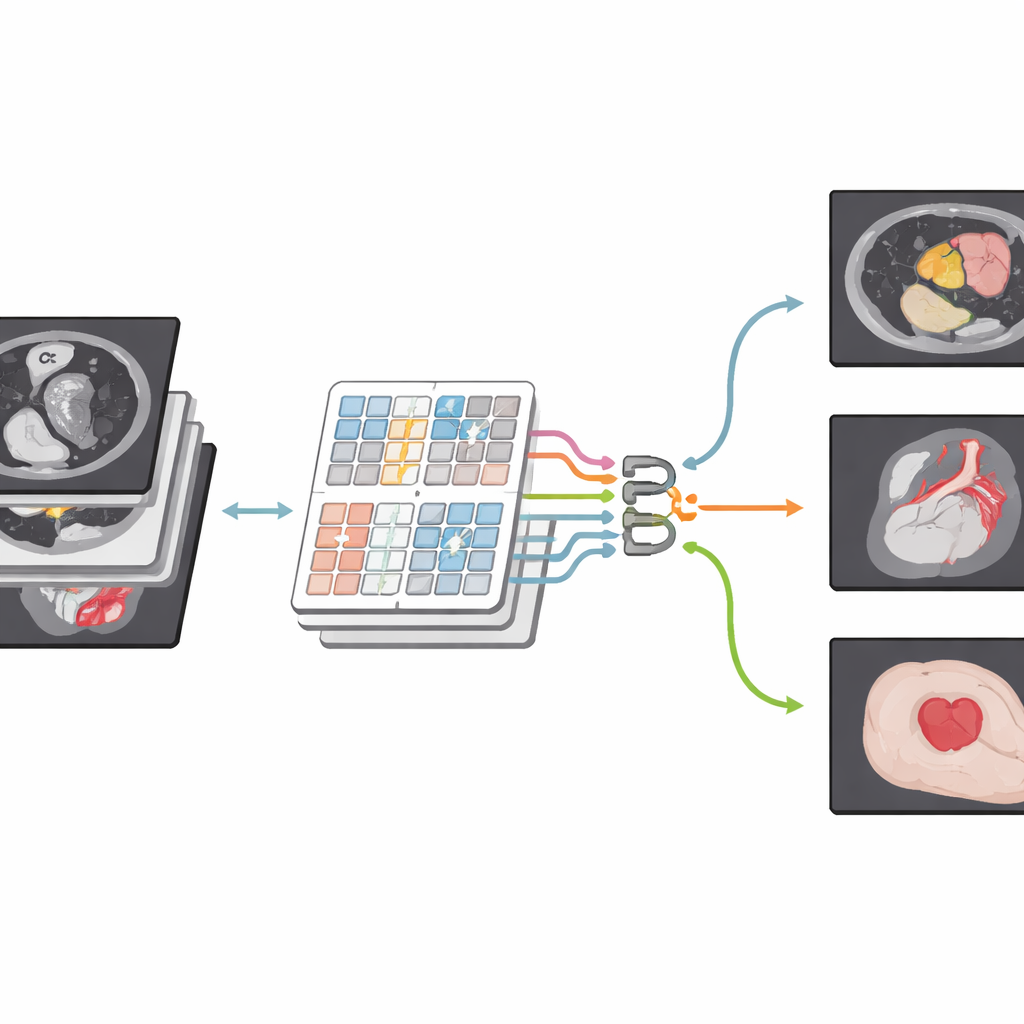

Os autores partem de uma família mais recente de modelos conhecidos como Transformers, desenvolvidos originalmente para linguagem e agora amplamente usados em visão computacional. Sua rede, CSWin-MDKDNet, começa fragmentando a imagem médica em patches e passando-os por um módulo Transformer que visualiza a imagem em faixas em forma de cruz, horizontal e verticalmente. Esse desenho permite que o sistema conecte regiões distantes — como a parte superior e inferior do fígado — sem uma explosão no custo computacional. Em torno desse núcleo, o modelo adota uma arquitetura em forma de U com codificador–decodificador, que se tornou padrão em imagiologia médica: um caminho reduz gradualmente a imagem para capturar estrutura de alto nível, enquanto outro a expande de volta ao tamanho original, produzindo um mapa de segmentação detalhado que se alinha ao exame original.

Mesclando Detalhes de Várias Direções

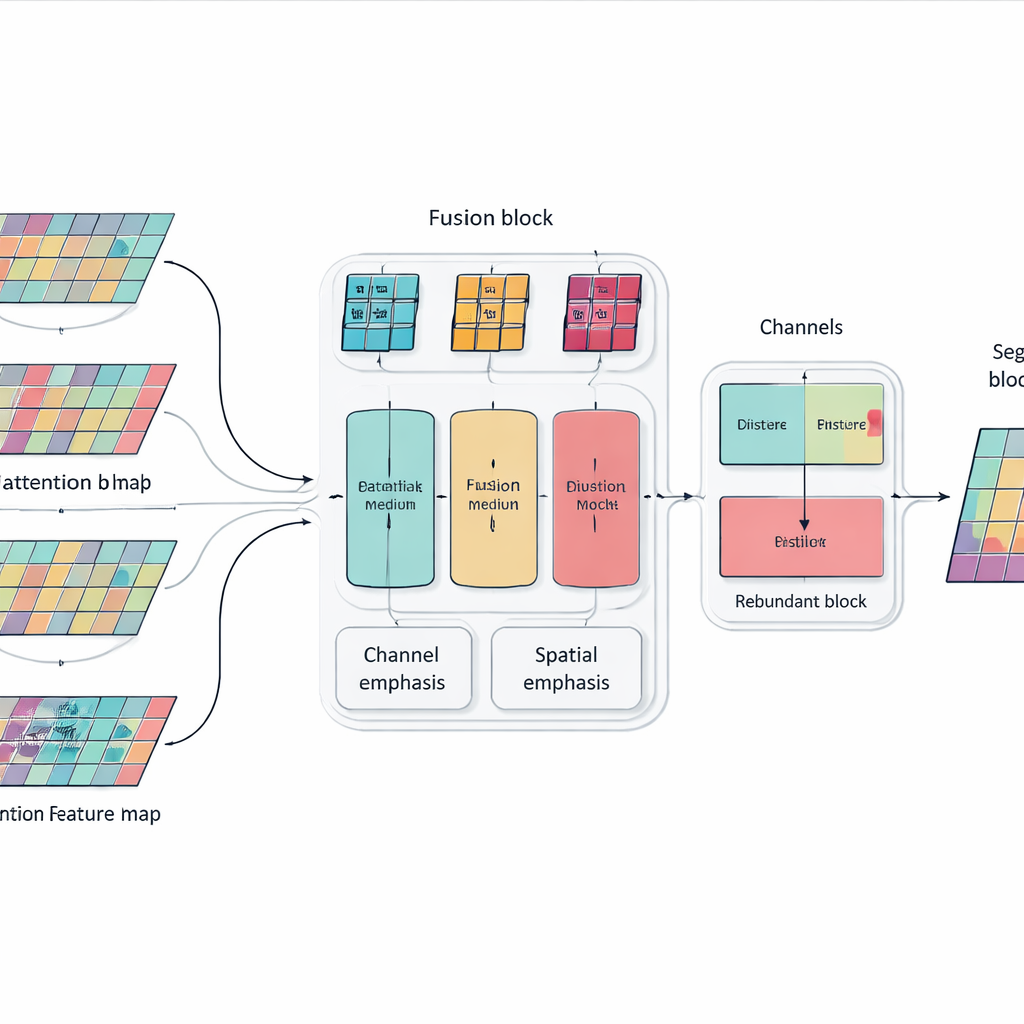

Empilhar mais camadas e blocos de atenção pode tornar um modelo poderoso, mas também inchado e sem foco. Para enfrentar isso, os autores introduzem um módulo de Fusão Seletiva Multidimensional que funciona como um misturador inteligente de características da imagem. Ele examina informações em três aspectos simultaneamente: os diferentes “canais” que codificam pistas visuais variadas, a disposição espacial que captura onde bordas e texturas ocorrem, e várias escalas que vão de detalhes finos a contexto amplo. Ao usar ponderação direcionada em vez de tratar todas as características igualmente, esse módulo eleva informações que realmente ajudam a distinguir um órgão do outro — como o contorno sutil e irregular do pâncreas — enquanto atenua distrações vindas de ruído e tecido de fundo.

Ensinando a Rede a Não se Repetir

Outro problema em redes muito profundas é a redundância: camadas posteriores podem acabar repetindo padrões já aprendidos anteriormente, desperdiçando capacidade e às vezes confundindo o processo de decisão. Em vez de adicionar módulos de poda extras, os pesquisadores introduzem uma regra de treinamento simples inspirada na destilação de conhecimento. Dentro de cada bloco da rede, eles incentivam canais mais profundos a absorverem a informação mais útil dos canais rasos enquanto evitam duplicações desnecessárias. Essa relação interna de “professor–aluno” empurra o modelo para representações compactas e consistentes, o que o ajuda a generalizar melhor para novos pacientes e diferentes aparelhos sem aumentar o custo de execução do sistema.

Ganho Comprovado em Órgãos e Modalidades

Para testar sua abordagem, a equipe avaliou o CSWin-MDKDNet em três benchmarks desafiadores. Em tomografias abdominais multi-órgão, o sistema alcançou a maior sobreposição média entre suas previsões e rótulos de especialistas, melhorando particularmente em órgãos difíceis de contornar como o pâncreas. Em ressonância magnética cardíaca, ofereceu contornos mais precisos das câmaras e do músculo do coração, críticos para medir a função cardíaca. Em uma grande coleção de fotos de lesões de pele, produziu limites mais limpos do que vários modelos concorrentes de alto desempenho. Notavelmente, esses ganhos vieram com menos parâmetros e menor custo computacional que desenhos clássicos baseados em Transformer, o que torna o método mais adequado para implantação prática em clínicas e hospitais.

Contornos Mais Claros para um Cuidado Melhor

Em termos cotidianos, este trabalho mostra como software mais inteligente pode traçar as formas de órgãos e lesões em imagens médicas com mais precisão, usando recursos computacionais de forma mais eficiente. Ao combinar uma visão ampla da imagem com atenção cuidadosamente ajustada aos detalhes importantes, e ao desencorajar repetições desperdiçadoras dentro da rede, o CSWin-MDKDNet fornece contornos digitais mais confiáveis nos quais médicos podem confiar. Essas melhorias podem não ser visíveis diretamente aos pacientes, mas podem apoiar um planejamento cirúrgico mais preciso, um acompanhamento mais consistente da doença ao longo do tempo e, em última instância, decisões mais seguras à beira do leito.

Citação: Cui, G., Lin, H., Sun, L. et al. CSWin-MDKDNet: cross-shaped window network with multi-dimensional fusion and knowledge distillation for medical image segmentation. Sci Rep 16, 11532 (2026). https://doi.org/10.1038/s41598-026-40690-5

Palavras-chave: segmentação de imagens médicas, aprendizado profundo, redes transformer, análise de órgãos e lesões, diagnóstico assistido por computador