Clear Sky Science · it

CSWin-MDKDNet: rete a finestre incrociate con fusione multidimensionale e distillazione della conoscenza per la segmentazione di immagini mediche

Visioni più nitide all'interno del corpo

La medicina moderna si basa fortemente sulle immagini—TC, risonanze magnetiche e fotografie della pelle—per individuare organi, tumori e altre strutture. Ma prima che medici o algoritmi possano misurare o monitorare una malattia, spesso è necessario «colorare» ogni organo o lesione in modo preciso, un compito chiamato segmentazione. Questo articolo presenta un nuovo sistema di intelligenza artificiale, CSWin-MDKDNet, che rende questo passaggio di delineazione più accurato ed efficiente su diversi tipi di immagini mediche, migliorando potenzialmente la diagnosi, la pianificazione del trattamento e il follow-up per molti pazienti.

Perché tracciare i contorni è importante

Quando i radiologi pianificano un intervento, misurano la capacità di pompa del cuore o stimano la dimensione di una lesione cutanea, si affidano a contorni netti nelle immagini. Tradizionalmente, gli esperti disegnano questi profili a mano, un processo lento, faticoso e soggetto a variabilità tra operatori. I metodi informatici precedenti basati su reti convoluzionali hanno imparato a riconoscere pattern locali come bordi e texture e hanno trasformato l'analisi delle immagini mediche. Tuttavia, questi sistemi faticavano ancora a cogliere il «quadro generale»—come regioni distanti dell'immagine siano correlate—mantenendo allo stesso tempo i dettagli fini lungo i margini degli organi. Questo compromesso tra contesto globale e precisione locale ha limitato l'affidabilità degli strumenti automatici in contesti clinici esigenti.

Un nuovo modo di guardare le immagini mediche

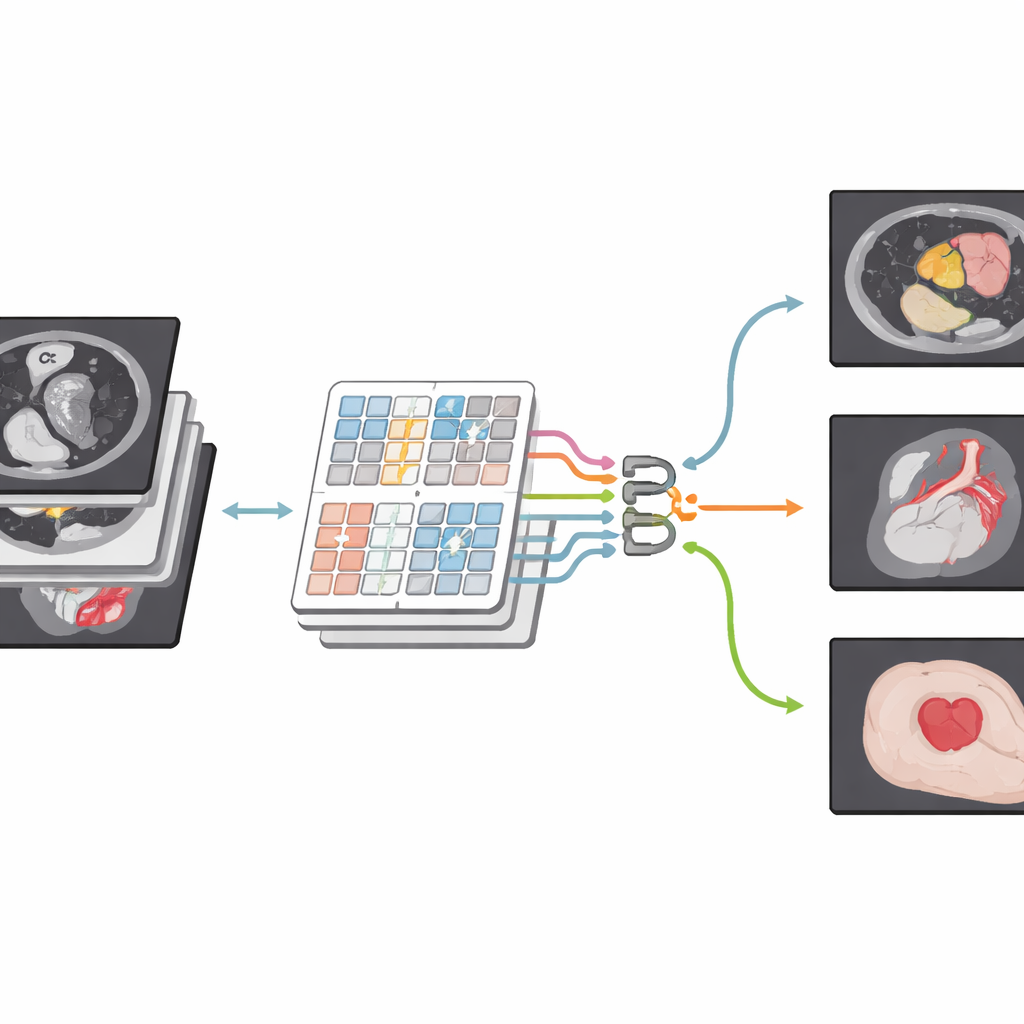

Gli autori si basano su una famiglia più recente di modelli noti come Transformer, sviluppati originariamente per il linguaggio ma ora ampiamente impiegati nella visione artificiale. La loro rete, CSWin-MDKDNet, inizia suddividendo un'immagine medica in patch e trasferendole attraverso un modulo Transformer che osserva l'immagine a strisce a forma di croce, orizzontalmente e verticalmente. Questa progettazione consente al sistema di collegare regioni distanti—come la parte superiore e inferiore del fegato—senza un'esplosione dei costi computazionali. Attorno a questo nucleo, il modello adotta una struttura a U con encoder–decoder, ormai standard in imaging medico: un percorso riduce gradualmente l'immagine per catturare la struttura ad alto livello, mentre l'altro la ricostruisce fino alle dimensioni originali, producendo una mappa di segmentazione dettagliata che si sovrappone alla scansione di partenza.

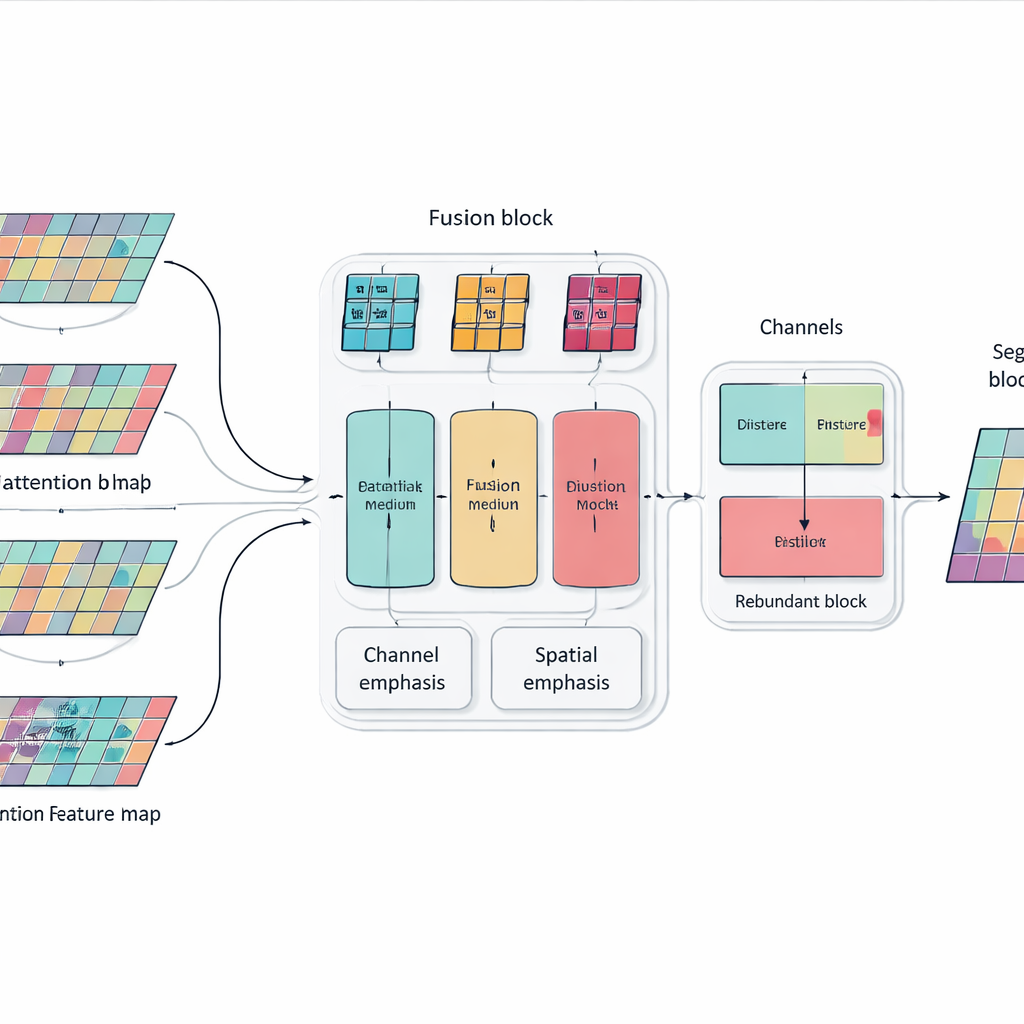

Fondere dettagli da molte direzioni

Semplicemente impilare più livelli e blocchi di attenzione può rendere un modello potente ma anche ingombrante e poco focalizzato. Per ovviare a questo, gli autori introducono un modulo di Fusione Selettiva Multidimensionale che funziona come un miscelatore intelligente per le feature dell'immagine. Esamina le informazioni su tre aspetti contemporaneamente: i diversi «canali» che codificano vari indizi visivi, la disposizione spaziale che cattura dove si trovano bordi e texture, e varie scale che vanno dai dettagli fini al contesto ampissimo. Utilizzando pesature mirate invece di trattare tutte le feature allo stesso modo, questo modulo potenzia le informazioni che aiutano davvero a distinguere un organo dall'altro—come il contorno sottile e irregolare del pancreas—attenuando al contempo le distrazioni dovute a rumore e tessuto di sfondo.

Insegnare alla rete a non ripetersi

Un altro problema delle reti molto profonde è la ridondanza: gli strati successivi possono ritrovare pattern già appresi in precedenza, sprecando capacità e talvolta confondendo il processo decisionale. Invece di aggiungere moduli di potatura extra, i ricercatori introducono una semplice regola di addestramento ispirata alla distillazione della conoscenza. All'interno di ciascun blocco della rete, incoraggiano i canali più profondi ad assorbire le informazioni più utili da quelli più superficiali evitando duplicazioni non necessarie. Questa relazione interna «insegnante–studente» spinge il modello verso rappresentazioni compatte e coerenti, migliorandone la generalizzazione a nuovi pazienti e diversi scanner senza aumentare il costo operativo del sistema.

Progressi dimostrati su organi e modalità diverse

Per testare l'approccio, il team ha valutato CSWin-MDKDNet su tre benchmark impegnativi. Nelle TC addominali multi-organo, il sistema ha ottenuto la massima sovrapposizione media tra le sue predizioni e le etichette degli esperti, migliorando in particolare su organi difficili da delimitare come il pancreas. Nelle risonanze cardiache, ha fornito contorni più precisi delle cavità e del muscolo cardiaco, fondamentali per misurare la funzione cardiaca. In una vasta raccolta di fotografie di lesioni cutanee, ha prodotto contorni più puliti rispetto a diversi modelli concorrenti di alto livello. È rilevante che questi miglioramenti siano stati ottenuti con meno parametri e minore computazione rispetto ai design Transformer classici, rendendo il metodo più adatto a un impiego pratico in cliniche e ospedali.

Contorni più chiari per cure migliori

In termini semplici, questo lavoro mostra come software più intelligente possa tracciare le sagome di organi e lesioni nelle immagini mediche in modo più accurato, usando al contempo le risorse computazionali in modo più efficiente. Combinando una visione ampia dell'immagine con un'attenzione calibrata ai dettagli importanti e scoraggiando ripetizioni inutili all'interno della rete, CSWin-MDKDNet fornisce contorni digitali più affidabili di cui i medici possono fidarsi. Tali miglioramenti potrebbero non essere visibili direttamente ai pazienti, ma possono supportare una pianificazione chirurgica più precisa, un monitoraggio più coerente della malattia nel tempo e, in ultima analisi, decisioni cliniche più sicure al letto del paziente.

Citazione: Cui, G., Lin, H., Sun, L. et al. CSWin-MDKDNet: cross-shaped window network with multi-dimensional fusion and knowledge distillation for medical image segmentation. Sci Rep 16, 11532 (2026). https://doi.org/10.1038/s41598-026-40690-5

Parole chiave: segmentazione di immagini mediche, apprendimento profondo, reti Transformer, analisi di organi e lesioni, diagnosi assistita dal computer