Clear Sky Science · nl

CSWin-MDKDNet: cross-shaped window netwerk met multidimensionale fusie en kennisdistillatie voor medische beeldsegmentatie

Scherpere inkijk in het lichaam

De moderne geneeskunde is sterk afhankelijk van beelden—CT-scans, MRI’s en huidsfoto’s—om organen, tumoren en andere structuren te herkennen. Voordat artsen of computers een ziekte kunnen meten of volgen, moeten ze vaak elk orgaan of elke laesie nauwkeurig "inkleuren", een taak die segmentatie heet. Dit artikel introduceert een nieuw kunstmatig-intelligentiesysteem, CSWin-MDKDNet, dat dit afbakenen nauwkeuriger en efficiënter maakt voor verschillende typen medische beelden, wat de diagnose, behandelingsplanning en nazorg van veel patiënten kan verbeteren.

Waarom grenzen trekken belangrijk is

Wanneer radiologen een operatie plannen, de pompfunctie van het hart meten of de grootte van een huidlaesie schatten, zijn ze afhankelijk van duidelijke grenzen in hun beelden. Traditioneel tekenen menselijke experts deze contouren met de hand, wat traag, vermoeiend en variabel tussen personen is. Vroegere computermethoden gebaseerd op convolutionele neurale netwerken leerden lokale patronen zoals randen en texturen herkennen en transformeerden de analyse van medische beelden. Toch hadden deze systemen moeite met het zien van het "grote geheel"—hoe verre delen van een afbeelding zich tot elkaar verhouden—terwijl ze tegelijkertijd fijne details langs orgaanranden intact hielden. Deze afweging tussen globaal contextbegrip en lokale precisie heeft de betrouwbaarheid van geautomatiseerde hulpmiddelen in veeleisende klinische situaties beperkt.

Een nieuwe manier om medische beelden te bekijken

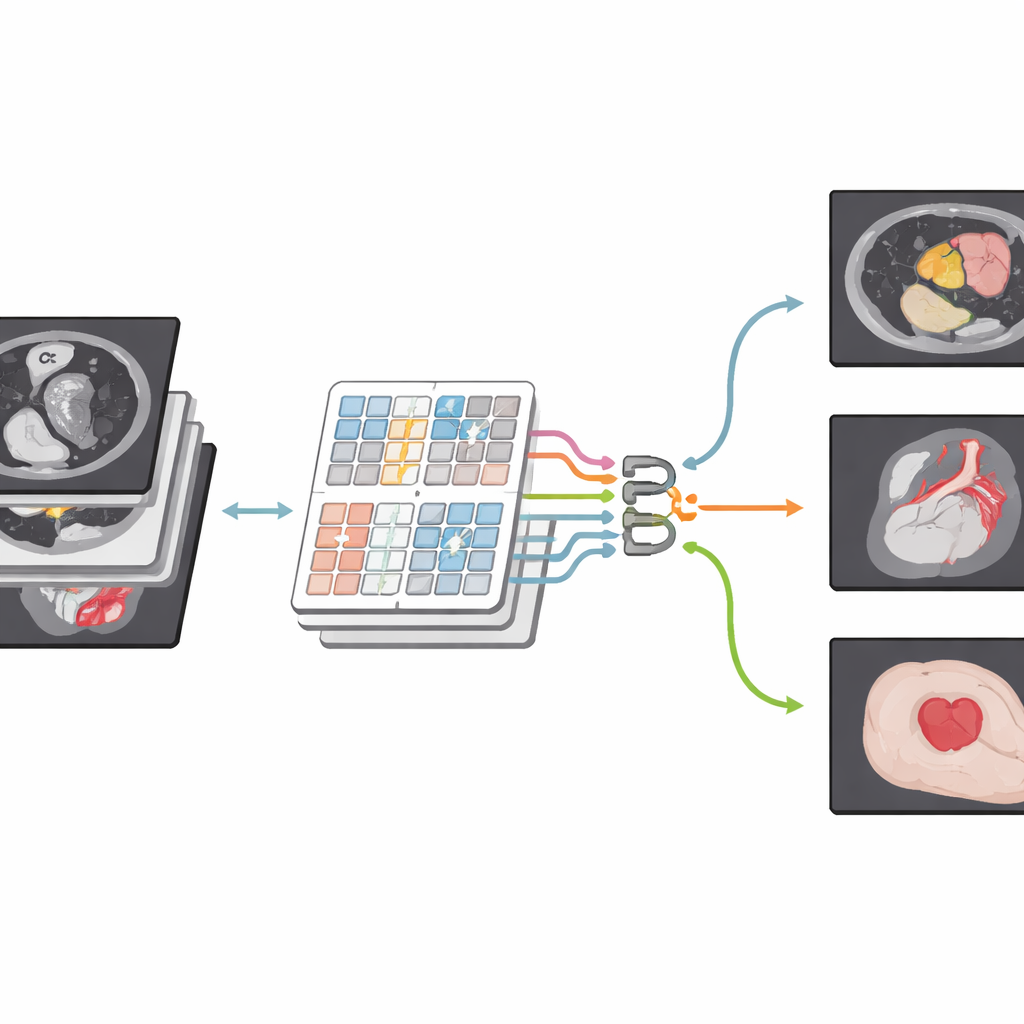

De auteurs bouwen voort op een nieuwere modelklasse die bekendstaat als Transformers, oorspronkelijk ontwikkeld voor taal maar inmiddels veel toegepast in computer vision. Hun netwerk, CSWin-MDKDNet, begint met het opdelen van een medische afbeelding in patches en voert deze vervolgens door een Transformer-module die het beeld bekijkt in kruisvormige strepen, horizontaal en verticaal. Dit ontwerp stelt het systeem in staat om ver uit elkaar liggende regio’s—zoals de boven- en onderkant van de lever—met elkaar te verbinden zonder een enorme toename van de rekenkosten. Rond deze kern hanteert het model een U-vormige encoder–decoderopzet die standaard is geworden in medische beeldvorming: het ene pad verkleint de afbeelding geleidelijk om hoog-niveau structuur vast te leggen, terwijl het andere pad deze weer terugvergroeit naar volledige grootte en een gedetailleerde segmentatiekaart produceert die overeenkomt met de oorspronkelijke scan.

Details mengen uit vele richtingen

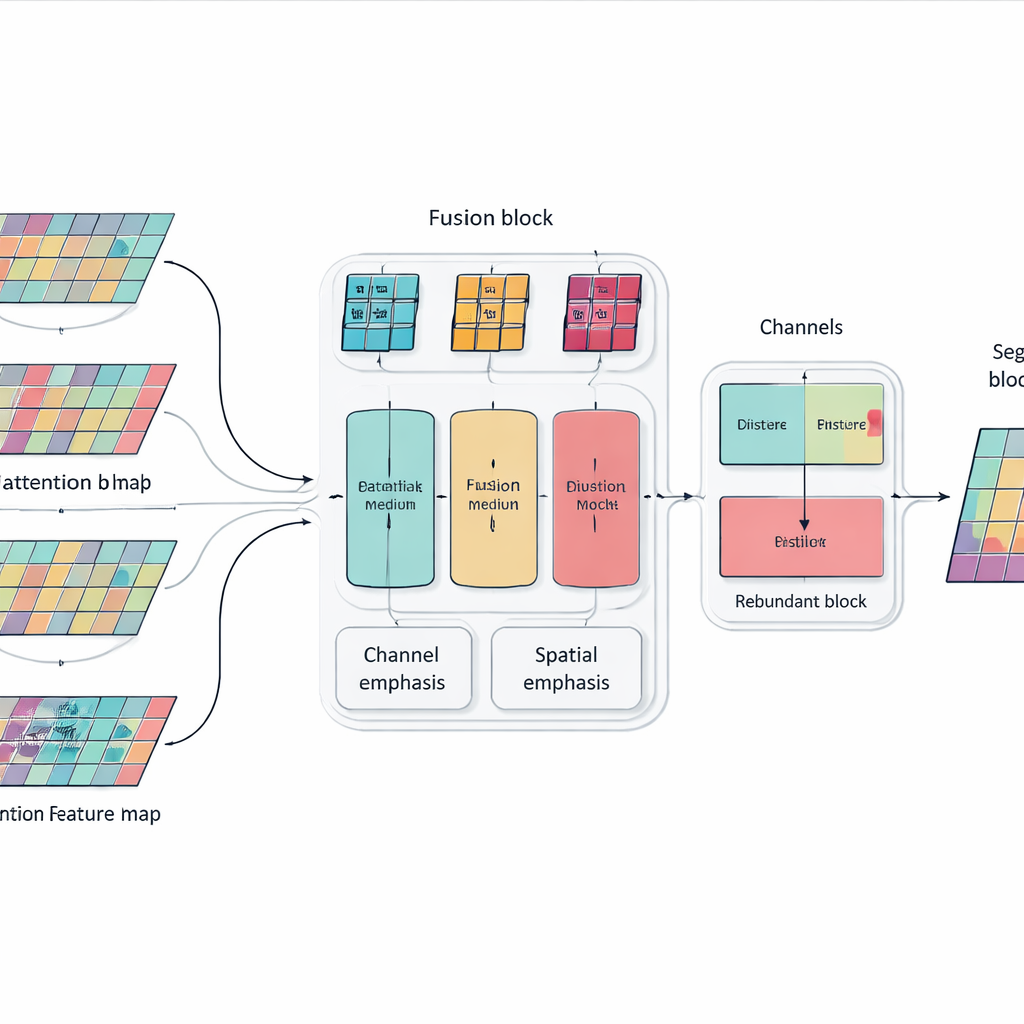

Het stapelen van meer lagen en attention-blokken kan een model krachtig maken, maar ook omvangrijk en onscherp. Om dit aan te pakken introduceren de auteurs een Multi-dimensional Selective Fusion-module die werkt als een slimme mixer voor beeldkenmerken. Deze kijkt tegelijk naar informatie over drie aspecten: de verschillende "kanalen" die uiteenlopende visuele aanwijzingen coderen, de ruimtelijke indeling die vastlegt waar randen en texturen voorkomen, en meerdere schalen die variëren van fijne details tot brede context. Door gerichte wegingsfactoren te gebruiken in plaats van alle kenmerken gelijk te behandelen, versterkt deze module informatie die echt helpt bij het onderscheiden van organen—zoals de subtiele, onregelmatige omtrek van de alvleesklier—terwijl afleidingen door ruis en achtergrondweefsel worden gedempt.

Het netwerk leren niet te herhalen

Een ander probleem bij zeer diepe netwerken is redundantie: latere lagen kunnen patronen herhalen die al eerder geleerd zijn, waardoor capaciteit wordt verspild en het beslissingsproces soms wordt verstoord. In plaats van extra pruning-modules toe te voegen, introduceren de onderzoekers een eenvoudige trainingsregel geïnspireerd op kennisdistillatie. Binnen elk blok van het netwerk stimuleren ze diepere kanalen om de meest bruikbare informatie van ondiepere kanalen over te nemen, terwijl onnodige duplicatie wordt vermeden. Deze interne "leraar–leerling"-relatie stuurt het model naar compacte, consistente representaties, wat helpt om beter te generaliseren naar nieuwe patiënten en verschillende scanners zonder de uitvoeringskosten te verhogen.

Aantoonbare verbeteringen over organen en modaliteiten

Om hun benadering te testen evalueerde het team CSWin-MDKDNet op drie veeleisende benchmarks. Op multi-orgaan abdominale CT-scans behaalde het systeem de hoogste gemiddelde overlap tussen zijn voorspellingen en expertslabels, met name een verbetering bij moeilijk af te bakenen organen zoals de alvleesklier. Bij cardiale MRI leverde het preciezere contouren van de hartkamers en -spier, wat cruciaal is voor het meten van hartfunctie. Op een grote verzameling huidslaesiefoto’s produceerde het schonere grenzen dan verschillende sterke concurrerende modellen. Opmerkelijk is dat deze verbeteringen gepaard gingen met minder parameters en lagere rekenkosten dan klassieke Transformer-gebaseerde ontwerpen, wat betekent dat de methode geschikter is voor praktische inzet in klinieken en ziekenhuizen.

Heldere contouren voor betere zorg

In gewone bewoordingen laat dit werk zien hoe slimmer software de vormen van organen en laesies in medische beelden nauwkeuriger kan volgen, terwijl computerbronnen efficiënter worden gebruikt. Door een breed beeld van de afbeelding te combineren met zorgvuldig afgestelde aandacht voor belangrijke details, en door verspilling door herhaling binnen het netwerk tegen te gaan, levert CSWin-MDKDNet betrouwbaardere digitale contouren waarop artsen kunnen vertrouwen. Zulke verbeteringen zijn voor patiënten niet altijd direct zichtbaar, maar ze kunnen wel bijdragen aan preciezere chirurgische planning, consistenter ziektevolgen in de tijd en uiteindelijk zekerder beslissingen aan het bed van de patiënt.

Bronvermelding: Cui, G., Lin, H., Sun, L. et al. CSWin-MDKDNet: cross-shaped window network with multi-dimensional fusion and knowledge distillation for medical image segmentation. Sci Rep 16, 11532 (2026). https://doi.org/10.1038/s41598-026-40690-5

Trefwoorden: medische beeldsegmentatie, deep learning, transformernetwerken, orgaan- en laesieanalyse, computerondersteunde diagnose