Clear Sky Science · de

CSWin-MDKDNet: Kreuzförmiges-Window-Netzwerk mit multidimensionaler Fusion und Wissensdistillation für die Segmentierung medizinischer Bilder

Scharfere Einblicke in den Körper

Die moderne Medizin stützt sich stark auf Bilder — CT-Scans, MRTs und Hautfotos —, um Organe, Tumore und andere Strukturen zu erkennen. Bevor Ärztinnen, Ärzte oder Computer Krankheiten messen oder verfolgen können, müssen sie jedoch oft jedes Organ oder jede Läsion präzise „ausmalen“, eine Aufgabe, die als Segmentierung bezeichnet wird. Diese Arbeit stellt ein neues KI-System vor, CSWin-MDKDNet, das diesen Umrissschritt über verschiedene Arten medizinischer Bilddaten hinweg genauer und effizienter macht und damit potenziell Diagnose, Therapieplanung und Nachsorge vieler Patientinnen und Patienten verbessert.

Warum das Ziehen von Grenzen wichtig ist

Wenn Radiologinnen und Radiologen eine Operation planen, die Pumpleistung des Herzens messen oder die Größe einer Hautläsion schätzen, sind klare Grenzen in den Bildern entscheidend. Traditionell zeichnen Expertinnen und Experten diese Umrisse von Hand, was langsam, ermüdend ist und zwischen Personen variieren kann. Frühere computergestützte Methoden auf Basis von Faltungsnetzwerken lernten lokale Muster wie Kanten und Texturen und revolutionierten die Analyse medizinischer Bilder. Dennoch hatten diese Systeme Probleme, das „große Ganze“ zu erfassen — also wie weit auseinanderliegende Bildregionen zueinander in Beziehung stehen —, ohne dabei feine Details an Organrändern zu verlieren. Dieser Zielkonflikt zwischen globalem Kontext und lokaler Präzision hat die Zuverlässigkeit automatisierter Werkzeuge in anspruchsvollen klinischen Situationen eingeschränkt.

Eine neue Perspektive auf medizinische Bilder

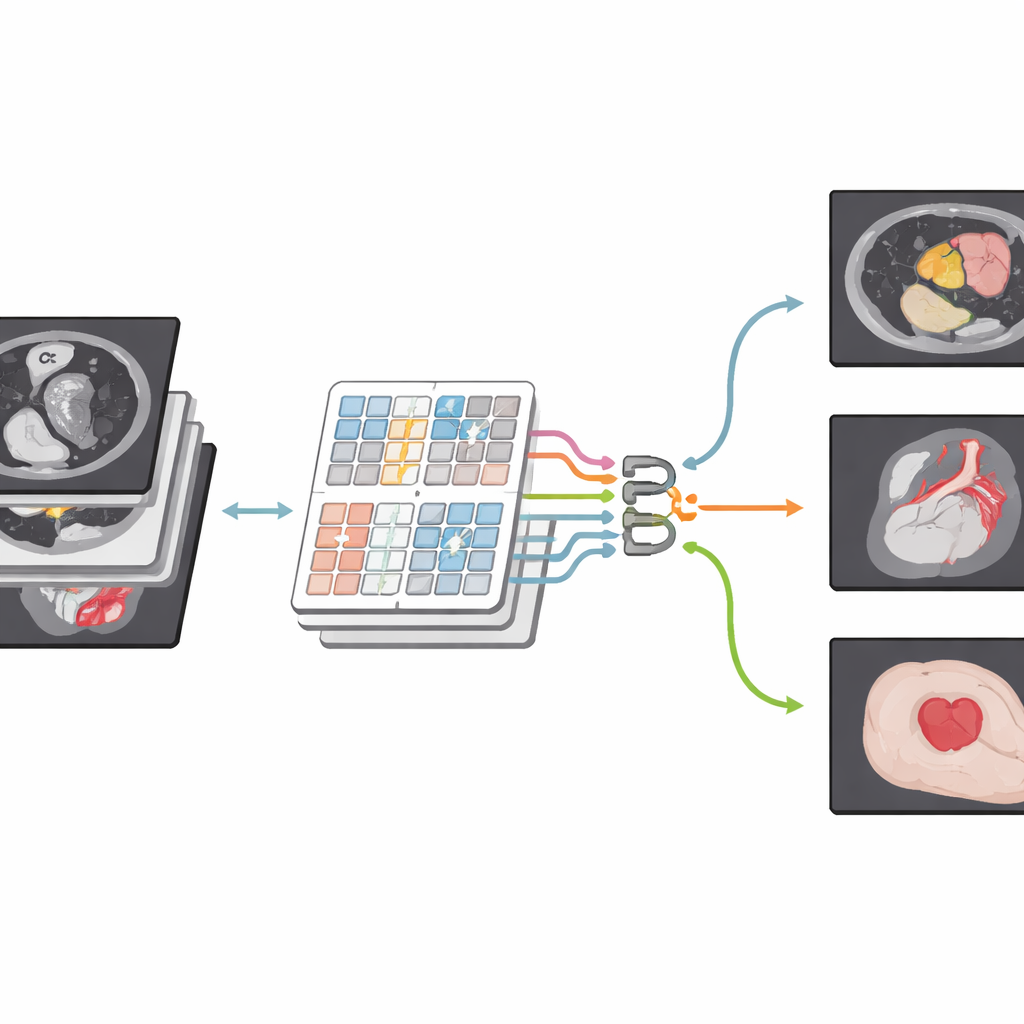

Die Autorinnen und Autoren bauen auf einer neueren Modellfamilie auf, die als Transformer bekannt ist, ursprünglich für Sprache entwickelt, inzwischen aber weitverbreitet in der Computer Vision eingesetzt wird. Ihr Netzwerk CSWin-MDKDNet beginnt damit, ein medizinisches Bild in Patches zu zerlegen und durch ein Transformer-Modul zu leiten, das das Bild in kreuzförmigen Streifen horizontal und vertikal betrachtet. Dieses Design ermöglicht es dem System, weit auseinanderliegende Regionen — etwa Ober- und Unterrand der Leber — miteinander zu verbinden, ohne die Rechenkosten explodieren zu lassen. Um diesen Kern herum verwendet das Modell eine U-förmige Encoder–Decoder-Architektur, die in der medizinischen Bildverarbeitung zum Standard geworden ist: Auf einem Pfad wird das Bild schrittweise verkleinert, um hochrangige Strukturen zu erfassen, während ein anderer Pfad es wieder auf volle Größe bringt und so eine detaillierte Segmentierungsmaske erzeugt, die mit dem Originalscan übereinstimmt.

Details aus vielen Richtungen zusammenführen

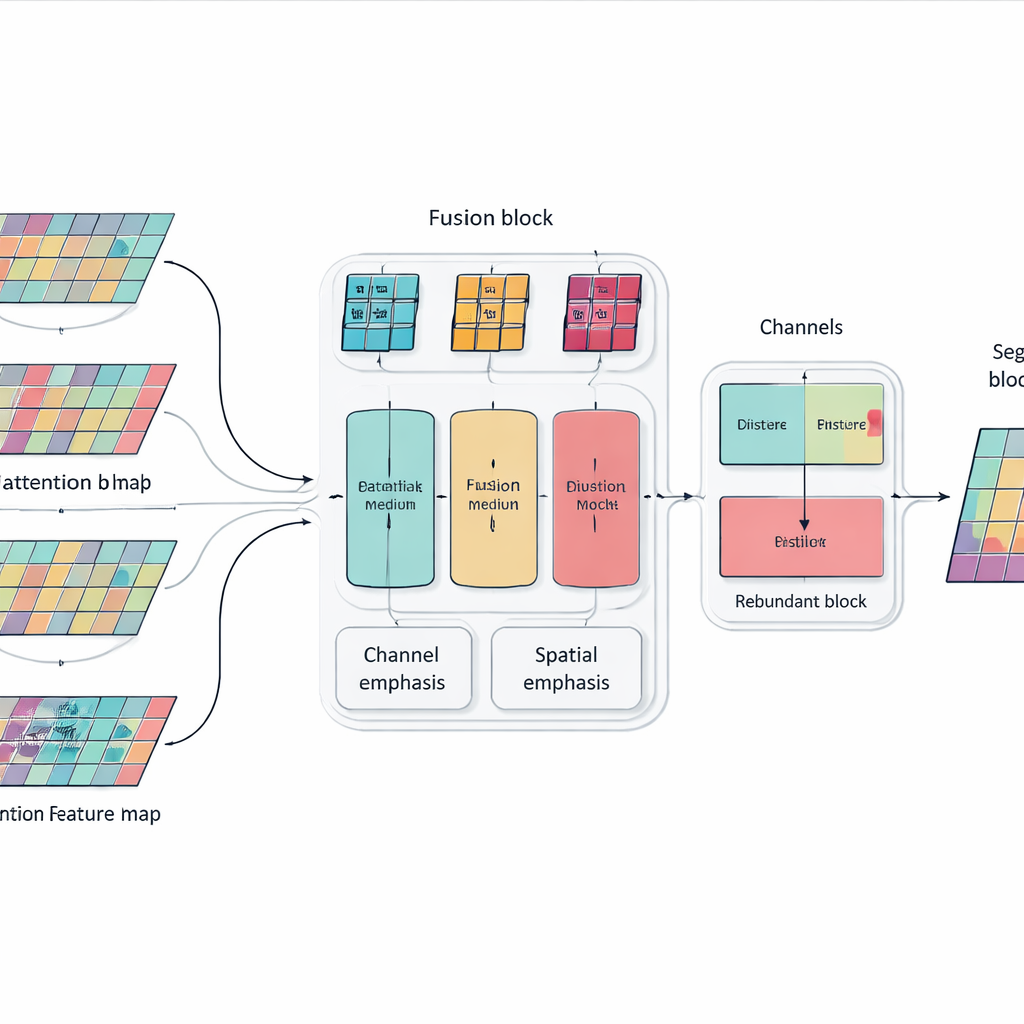

Einfach mehr Schichten und Attention-Blöcke zu stapeln kann ein Modell zwar leistungsfähiger, aber auch aufgebläht und unkonzentriert machen. Um dem entgegenzuwirken, führen die Autorinnen und Autoren ein Multi-dimensionales Selektives-Fusionsmodul ein, das wie ein intelligenter Mixer für Bildmerkmale wirkt. Es betrachtet Informationen gleichzeitig in drei Aspekten: die verschiedenen Kanäle, die unterschiedliche visuelle Hinweise kodieren; die räumliche Anordnung, die erfasst, wo Kanten und Texturen auftreten; und mehrere Skalen, die von feinen Details bis zu breitem Kontext reichen. Durch gezielte Gewichtung statt einer Gleichbehandlung aller Merkmale verstärkt dieses Modul Informationen, die wirklich helfen, ein Organ vom anderen zu unterscheiden — etwa die feine, unregelmäßige Kontur der Bauchspeicheldrüse — und dämpft Ablenkungen durch Rauschen und Hintergrundgewebe.

Dem Netzwerk beibringen, sich nicht zu wiederholen

Ein weiteres Problem sehr tiefer Netzwerke ist Redundanz: Spätere Schichten können Muster wiederholen, die bereits früher gelernt wurden, wodurch Kapazität verschwendet und die Entscheidungsfindung manchmal verwirrt wird. Statt zusätzliche Pruning-Module hinzuzufügen, führen die Forschenden eine einfache Trainingsregel ein, inspiriert von Wissensdistillation. Innerhalb jedes Blocks des Netzwerks ermutigen sie tiefere Kanäle, die nützlichsten Informationen von flacheren Kanälen zu übernehmen und unnötige Duplikation zu vermeiden. Diese interne „Lehrer–Schüler“-Beziehung lenkt das Modell zu kompakten, konsistenten Repräsentationen, was ihm hilft, besser auf neue Patientinnen und Patienten und unterschiedliche Scanner zu generalisieren, ohne die Laufzeitkosten zu erhöhen.

Nachgewiesene Verbesserungen über Organe und Modalitäten hinweg

Um ihren Ansatz zu testen, evaluierten die Autorinnen und Autoren CSWin-MDKDNet an drei anspruchsvollen Benchmarks. Bei Mehrorgan-Abdomen-CTs erreichte das System die höchste durchschnittliche Überlappung zwischen seinen Vorhersagen und Expertenmarkierungen, mit besonders deutlicher Verbesserung bei schwer zu umrissenden Organen wie der Bauchspeicheldrüse. Bei kardialen MRTs lieferte es präzisere Konturen der Herzkammern und des Herzmuskels, was für die Messung der Herzfunktion entscheidend ist. Bei einer großen Sammlung von Hautläsionsfotos erzeugte es sauberere Grenzen als mehrere starke Konkurrenzmodelle. Bemerkenswert ist, dass diese Verbesserungen mit weniger Parametern und geringerem Rechenaufwand als bei klassischen Transformer-basierten Entwürfen einhergingen, was die Methode besser für den praktischen Einsatz in Kliniken und Krankenhäusern geeignet macht.

Klarere Umrisse für bessere Versorgung

Vereinfacht gesagt zeigt diese Arbeit, wie klügere Software die Formen von Organen und Läsionen in medizinischen Bildern genauer nachzeichnen kann, während sie Computerressourcen effizienter nutzt. Durch die Kombination einer weiten Sicht auf das Bild mit sorgfältig abgestimmter Aufmerksamkeit für wichtige Details und durch das Verhindern verschwenderischer Wiederholungen innerhalb des Netzwerks liefert CSWin-MDKDNet zuverlässigere digitale Umrisse, denen Ärztinnen und Ärzte vertrauen können. Solche Verbesserungen sind für Patientinnen und Patienten möglicherweise nicht unmittelbar sichtbar, können aber genauere Operationsplanungen, konsistentere Verlaufsverfolgung von Krankheiten und letztlich sicherere Entscheidungen am Krankenbett unterstützen.

Zitation: Cui, G., Lin, H., Sun, L. et al. CSWin-MDKDNet: cross-shaped window network with multi-dimensional fusion and knowledge distillation for medical image segmentation. Sci Rep 16, 11532 (2026). https://doi.org/10.1038/s41598-026-40690-5

Schlüsselwörter: Segmentierung medizinischer Bilder, Tiefes Lernen, Transformer-Netzwerke, Analyse von Organen und Läsionen, computerassistierte Diagnose