Clear Sky Science · es

CSWin-MDKDNet: red de ventanas en forma de cruz con fusión multidimensional y destilación de conocimiento para segmentación de imágenes médicas

Vistas más nítidas del interior del cuerpo

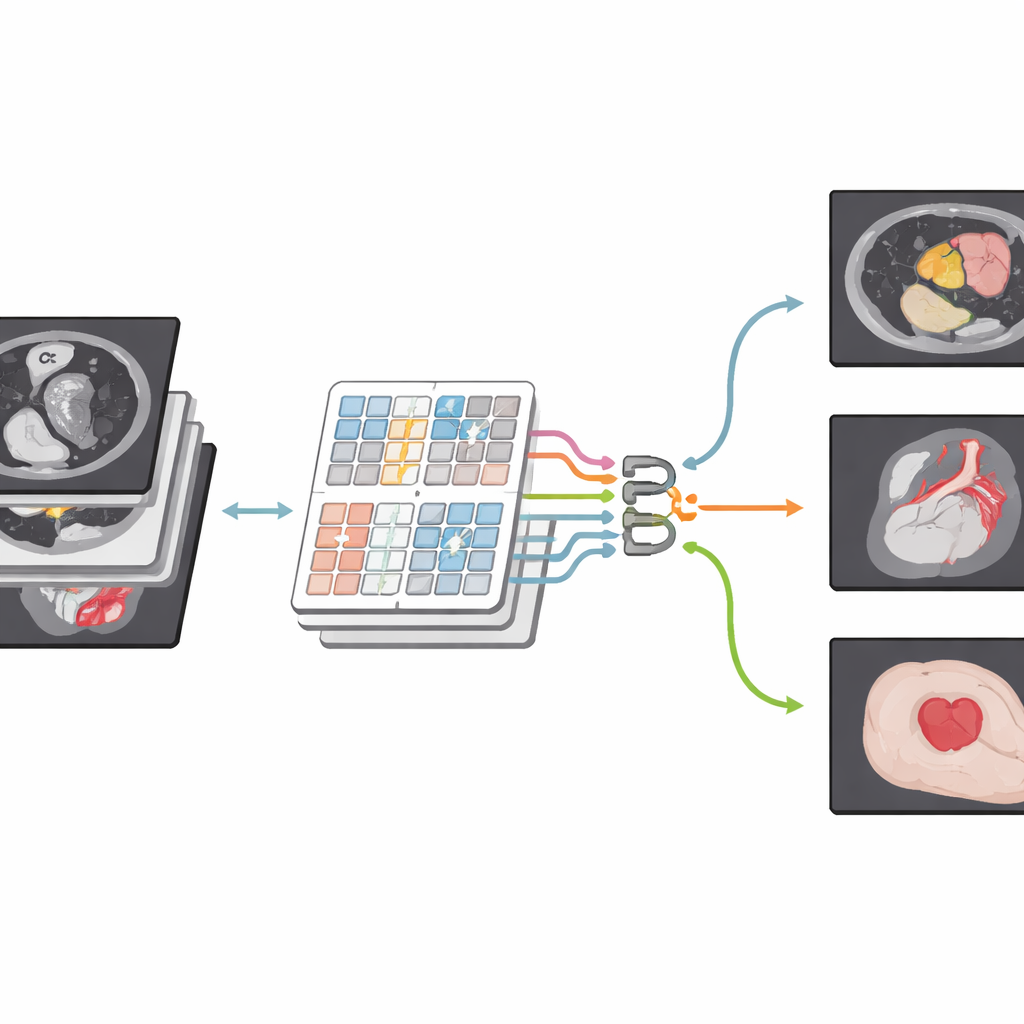

La medicina moderna depende en gran medida de las imágenes —escáneres CT, resonancias magnéticas y fotografías de la piel— para identificar órganos, tumores y otras estructuras. Pero antes de que los médicos o los sistemas automáticos puedan medir o seguir una enfermedad, a menudo es necesario "colorear" cada órgano o lesión de forma precisa, una tarea conocida como segmentación. Este artículo presenta un nuevo sistema de inteligencia artificial, CSWin-MDKDNet, que hace este paso de delineado más preciso y eficiente en varios tipos de imágenes médicas, con el potencial de mejorar el diagnóstico, la planificación del tratamiento y el seguimiento de muchos pacientes.

Por qué importa trazar límites

Cuando los radiólogos planifican una cirugía, miden la capacidad de bombeo del corazón o estiman el tamaño de una lesión cutánea, dependen de límites claros en sus imágenes. Tradicionalmente, los expertos humanos dibujan estos contornos a mano, lo que es lento, fatigoso y puede variar entre personas. Métodos previos basados en redes neuronales convolucionales aprendieron a reconocer patrones locales como bordes y texturas, y transformaron el análisis de imágenes médicas. Sin embargo, esos sistemas aún luchaban por captar la "visión global": cómo se relacionan entre sí las partes alejadas de una imagen, sin perder los detalles finos en los bordes de los órganos. Este compromiso entre contexto global y precisión local ha limitado la fiabilidad de las herramientas automatizadas en entornos clínicos exigentes.

Una nueva forma de mirar las imágenes médicas

Los autores se basan en una familia más reciente de modelos conocidos como Transformers, desarrollados originalmente para lenguaje pero ahora ampliamente usados en visión por computador. Su red, CSWin-MDKDNet, comienza dividiendo una imagen médica en parches y pasándolos por un módulo Transformer que examina la imagen en bandas en forma de cruz, horizontal y verticalmente. Este diseño permite al sistema conectar regiones distantes —por ejemplo, la parte superior e inferior del hígado— sin un aumento desmesurado del coste computacional. En torno a este núcleo, el modelo adopta una arquitectura en forma de U con codificador y decodificador que se ha convertido en estándar en imagen médica: una ruta reduce gradualmente la imagen para capturar estructura de alto nivel, mientras que la otra la reconstruye hasta el tamaño original, produciendo un mapa de segmentación detallado alineado con la exploración.

Fusionando detalles desde muchas direcciones

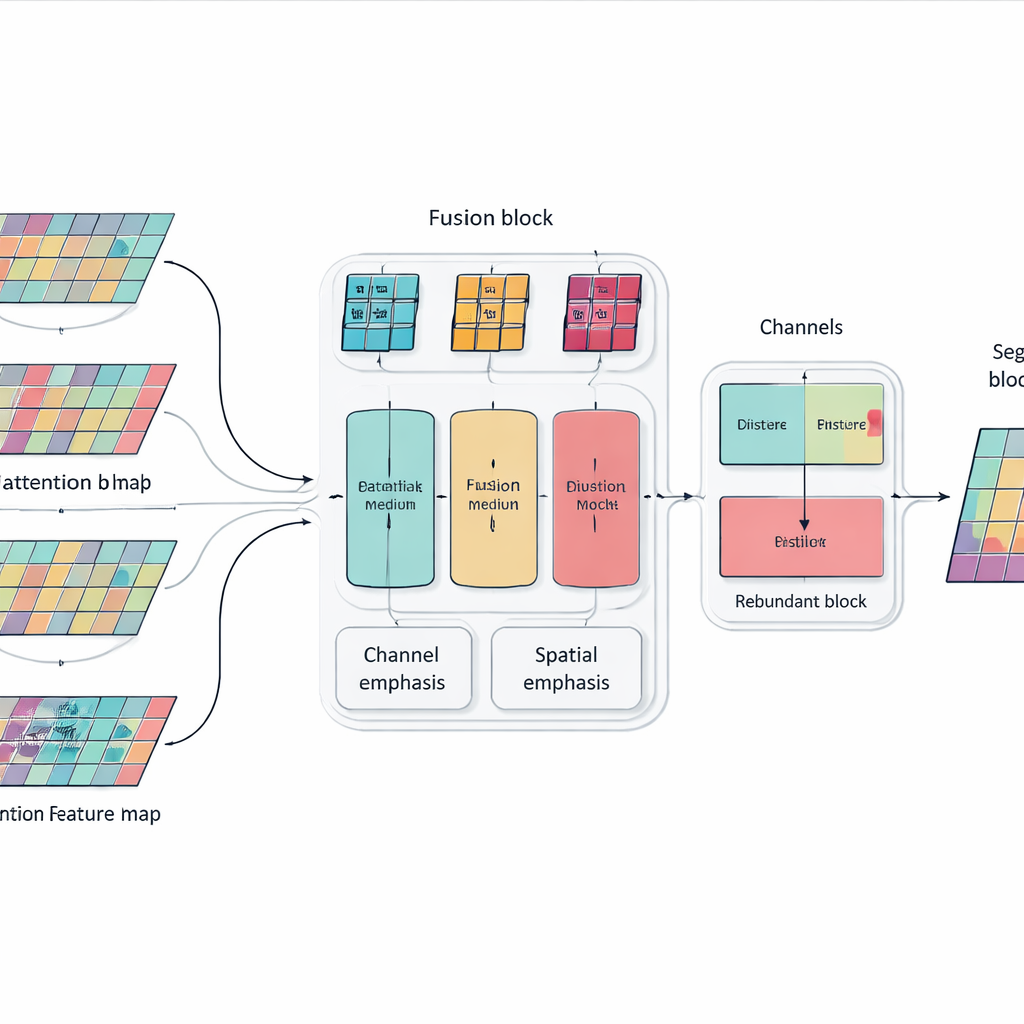

Apilar más capas y bloques de atención puede hacer un modelo potente, pero también voluminoso y poco centrado. Para solucionar esto, los autores introducen un módulo de Fusión Selectiva Multidimensional que actúa como un mezclador inteligente de características de imagen. Observa la información en tres aspectos a la vez: los diferentes "canales" que codifican diversas señales visuales, la disposición espacial que captura dónde ocurren bordes y texturas, y varias escalas que van de detalles finos a contexto amplio. Al utilizar ponderaciones dirigidas en lugar de tratar todas las características por igual, este módulo potencia la información que realmente ayuda a distinguir un órgano de otro —como el contorno sutil e irregular del páncreas— mientras atenúa distracciones procedentes de ruido y tejido de fondo.

Enseñar a la red a no repetirse

Otro problema de las redes muy profundas es la redundancia: las capas posteriores pueden acabar repitiendo patrones ya aprendidos en etapas anteriores, desaprovechando capacidad y a veces confundiendo el proceso de decisión. En lugar de añadir módulos de poda adicionales, los investigadores introducen una regla de entrenamiento sencilla inspirada en la destilación de conocimiento. Dentro de cada bloque de la red, fomentan que los canales más profundos absorban la información más útil de los canales más superficiales evitando la duplicación innecesaria. Esta relación interna de "profesor–alumno" empuja al modelo hacia representaciones compactas y coherentes, lo que le ayuda a generalizar mejor a nuevos pacientes y distintos escáneres sin aumentar el coste de ejecución del sistema.

Beneficios demostrados en órganos y modalidades

Para probar su enfoque, el equipo evaluó CSWin-MDKDNet en tres conjuntos de referencia exigentes. En tomografías abdominales multicorporales, el sistema alcanzó el mayor solapamiento promedio entre sus predicciones y las etiquetas de expertos, mejorando especialmente en órganos difíciles de delinear como el páncreas. En resonancias cardíacas, ofreció contornos más precisos de las cavidades y del músculo cardiaco, críticos para medir la función cardíaca. En una amplia colección de fotografías de lesiones cutáneas, produjo bordes más limpios que varios modelos competidores fuertes. Cabe destacar que estas mejoras vinieron con menos parámetros y menor coste computacional que los diseños Transformer clásicos, lo que hace que el método sea más adecuado para su despliegue práctico en clínicas y hospitales.

Contornos más claros para una mejor atención

En términos cotidianos, este trabajo muestra cómo un software más inteligente puede trazar las formas de órganos y lesiones en imágenes médicas con mayor precisión, usando los recursos informáticos de forma más eficiente. Al combinar una visión amplia de la imagen con una atención cuidadosamente ajustada a los detalles importantes, y al desalentar la repetición inútil dentro de la red, CSWin-MDKDNet ofrece contornos digitales más fiables en los que los médicos pueden confiar. Tales mejoras tal vez no sean visibles directamente para los pacientes, pero pueden apoyar una planificación quirúrgica más precisa, un seguimiento más consistente de la enfermedad a lo largo del tiempo y, en última instancia, decisiones en la cama del paciente con mayor confianza.

Cita: Cui, G., Lin, H., Sun, L. et al. CSWin-MDKDNet: cross-shaped window network with multi-dimensional fusion and knowledge distillation for medical image segmentation. Sci Rep 16, 11532 (2026). https://doi.org/10.1038/s41598-026-40690-5

Palabras clave: segmentación de imágenes médicas, aprendizaje profundo, redes transformer, análisis de órganos y lesiones, diagnóstico asistido por ordenador